PINN再出圈!与注意力机制结合,霸榜一区顶刊和各大顶会!光是ICLR25就有多篇。其中模型AC-PKAN,更是取得了预测误差直降99.2%,收敛速度狂提的拔群效果!

其热度可见一斑!主要在于:一方面,这两者结合非常好出创新点。PINN作为好“水”论文的顶流,传统的改进方法,早已卷成麻花,而与注意力机制结合,则是新兴思路,还在起步阶段。另一方面,其为处理复杂数据和多种模态数据的任务,提供了全新的解决方案。注意力机制动态权重分配的特点,能够克服PINN面临梯度消失或计算效率低的缺陷,助力模型的预测准确性和泛化能力的提升。

目前好发论文的思路有:多模态物理信息融合、动态稀疏注意力融合、硬件协同设计……为让大家能够早日发出顶会,每种思路,都给大家准备了必读论文和源码,共8篇!

论文原文+开源代码需要的同学看文末

MAD-SCIENTIST: AI-BASED SCIENTIST SOLVING CONVECTION-DIFFUSION-REACTION EQUATIONS US ING MASSIVE PINN-BASED PRIOR DATA

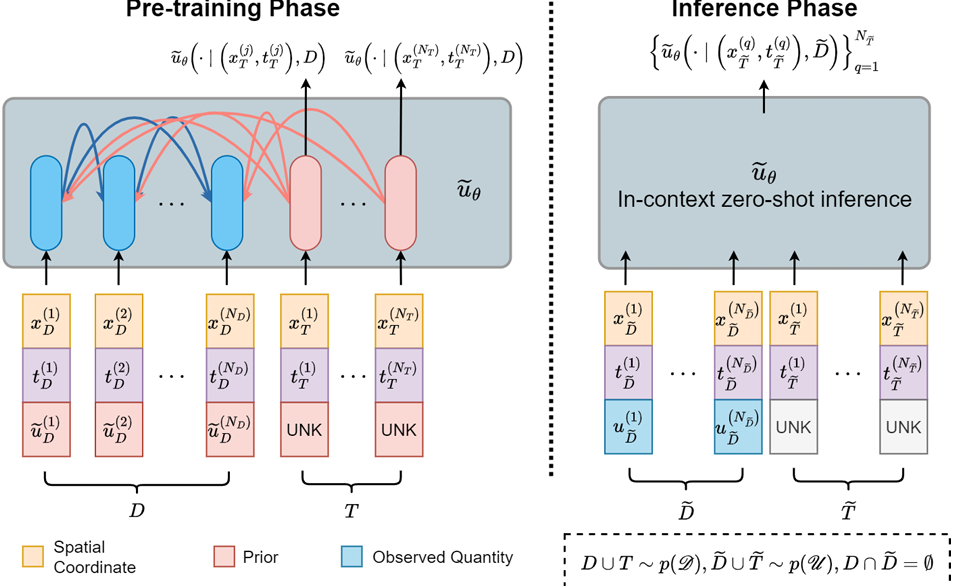

内容:本文提出了一种名为“MaD-Scientist”的基于人工智能的科学模型,旨在利用大规模的物理信息神经网络(PINN)生成的近似先验数据来解决对流-扩散-反应方程等偏微分方程(PDE)。该方法通过Transformer架构结合自注意力和交叉注意力机制,在无需已知控制方程的情况下,以零样本学习的方式预测PDE的解。实验表明,即使使用近似先验数据进行预训练,模型依然能够在一维对流-扩散-反应方程上保持鲁棒性,并且对测试精度的影响微乎其微。这一研究为科学基础模型(SFM)的发展提供了新的思路,类似于自然语言处理中大型语言模型(LLM)的学习方式,为解决复杂科学问题提供了新的可能性。

AC-PKAN: ATTENTION-ENHANCED AND CHEBY SHEV POLYNOMIAL-BASED PHYSICS-INFORMED KOLMOGOROV–ARNOLDNETWORKS

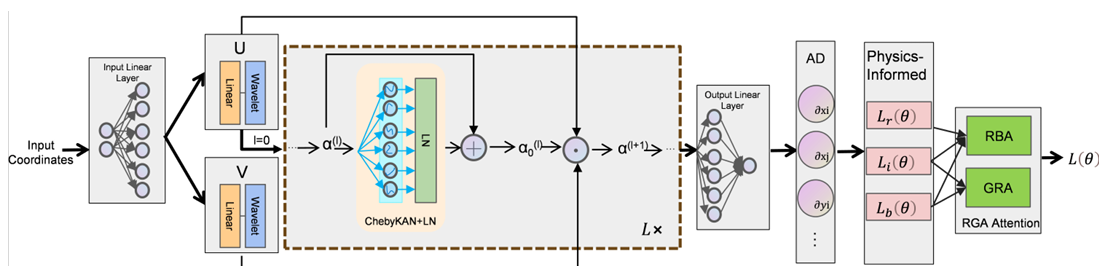

内容:AC-PKAN是一种新型的物理信息神经网络框架,旨在通过引入切比雪夫多项式和注意力机制来提高解决复杂偏微分方程(PDEs)的效率和准确性。该框架结合了Kolmogorov–Arnold Networks(KANs)的强大逼近能力和切比雪夫多项式的高效性,同时通过内部和外部的注意力机制优化模型性能。实验结果表明,AC-PKAN在多个基准任务中表现优异,能够有效解决传统PINNs在处理复杂PDEs时面临的梯度消失、可解释性不足和计算效率低等问题。

A physics-informed transformer neural operator for learning generalized solutions of initial boundary value problems

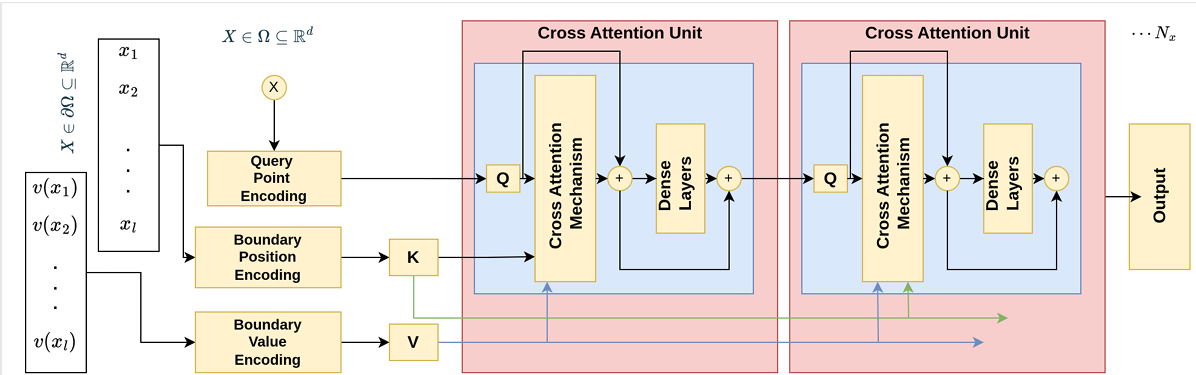

内容:本文介绍了一种名为PINTO的新型物理信息神经算子,用于高效求解具有初始和边界条件的偏微分方程(PDE)的广义解。PINTO通过引入基于交叉注意力机制的迭代核积分算子单元,将PDE解的时空域点转换为初始/边界条件感知的表示向量,从而实现对新场景的高效学习。该模型仅使用物理损失(PDE残差)进行训练,无需数值模拟数据。PINTO在多个重要工程方程的测试中表现出色,相对误差仅为其他领先物理信息算子学习方法的五分之一到三分之一,并且能够准确求解训练中未包含的时间步长的解。

LSA-PINN: A new method based on Physics-Informed Neural Network with lightweight self-attention for solving modified Bloch equation

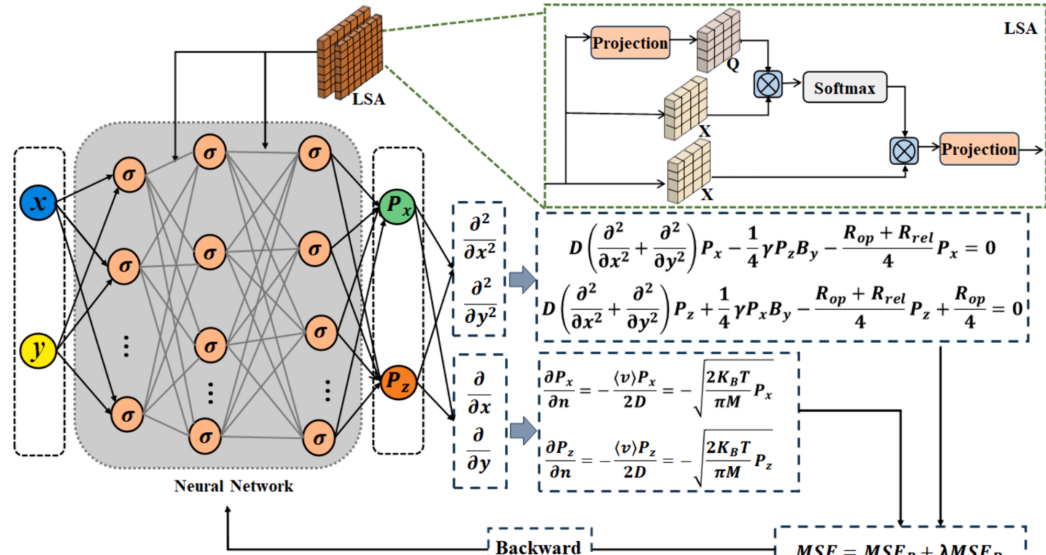

内容:本文提出了一种名为LSA-PINN的新方法,用于求解修正后的布洛赫方程。LSA-PINN结合了物理信息神经网络(PINN)和轻量级自注意力机制,通过在布洛赫方程中引入扩散项来更准确地描述原子自旋与磁场的演化和相互作用。实验结果表明,LSA-PINN相比传统PINN方法能够显著降低损失值,从而获得更准确的数值解。该方法不仅提高了求解精度,还展示了在其他物理领域应用的潜力。

码字不易,欢迎大家点赞评论收藏!

关注下方《AI科研技术派》

回复【物理注意】获取完整论文

👇

1049

1049

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?