public void testInsertCacheBlogId() {

Blog build = Blog.builder()

.authorId(1)

.state(“ACTIVE”)

.style(“333”)

.featured(false)

.title(“三国演义”)

.build();

new BlogDao().insertCacheId(build);

logger.info(“after blog is:{}”, build);

}

测试结果:

2.查询所有数据,步骤同上:

public List selectAllBlogs() {

return mapper.selectAllBlogs();

}

List selectAllBlogs();

select * from Blog

@Test

public void testSelectAllBlogs() {

final List blogs = new BlogDao().selectAllBlogs();

blogs.stream().forEach(blog -> logger.info(blog));

}

3.模糊查询

public List selectBlogsByTitle(String title) {

return mapper.selectBlogsByTitle(title);

}

List selectBlogsByTitle(String title);

select * from Blog where title like concat(‘%’, #{title}, ‘%’)

@Test

public void testSelectBlogsByTitle() {

final List blogs = new BlogDao().selectBlogsByTitle(“三”);

blogs.stream().forEach(blog -> logger.info(blog));

}

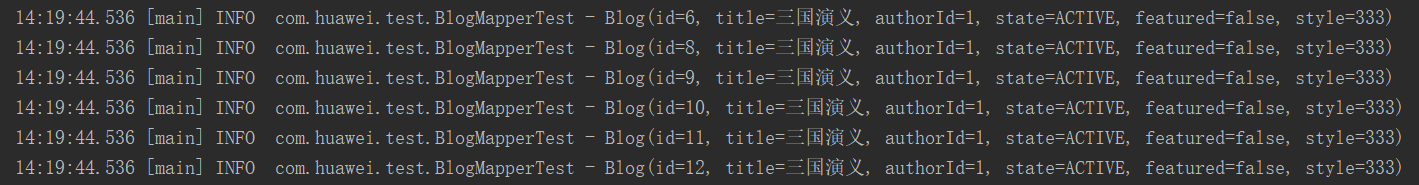

测试结果:

4.多条件查询

public List selectBlogsByCondition(Map<String, Object> map) {

return mapper.selectBlogsByCondition(map);

}

List selectBlogsByCondition(Map<String, Object> map);

Kafka实战笔记

关于这份笔记,为了不影响大家的阅读体验,我只能在文章中展示部分的章节内容和核心截图

- Kafka入门

- 为什么选择Kafka

- Karka的安装、管理和配置

- Kafka的集群

- 第一个Kafka程序

afka的生产者

- Kafka的消费者

- 深入理解Kafka

- 可靠的数据传递

- Spring和Kalka的整合

- Sprinboot和Kafka的整合

- Kafka实战之削峰填谷

- 数据管道和流式处理(了解即可)

- Kafka实战之削峰填谷

]

- Spring和Kalka的整合

- Sprinboot和Kafka的整合

- Kafka实战之削峰填谷

- 数据管道和流式处理(了解即可)

[外链图片转存中…(img-MiUJZ1wp-1714419995256)]

- Kafka实战之削峰填谷

[外链图片转存中…(img-l6BHy2ul-1714419995256)]

584

584

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?