在大型语言模型(LLMs)的研究和应用中,如何通过微调来适应特定任务是一个关键问题。尽管提示工程(PE)在提升LLMs的零样本学习和上下文内学习方面取得了显著成效,但关于如何设计有效的微调样本以进一步提升LLMs性能的研究还相对欠缺。

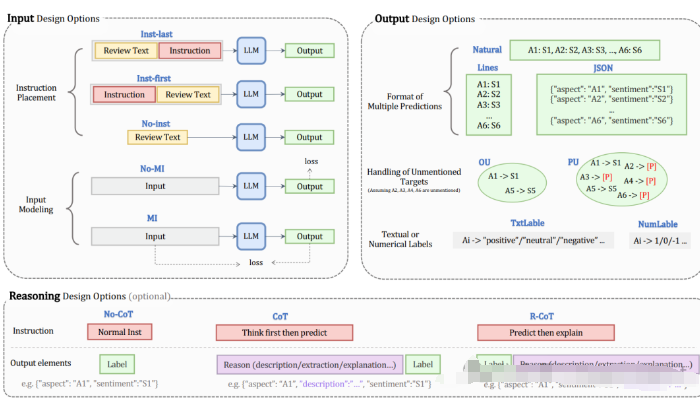

为解决上述问题,提出了样本设计工程SDE(Sample Design Engineering),这是一种系统化的方法,旨在通过精细化设计输入、输出和推理环节来增强LLMs在特定任务上的表现。以多方面情感分析(MASA)任务为例,分析了不同的SDE选项,包括指令放置、输入建模、多种预测格式化、未提及目标的处理、文本或数值标签的使用,以及推理设计选项,如链式思考(CoT),得出10条重要的结论!

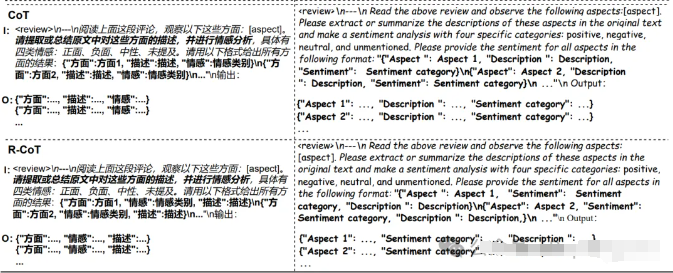

在设计下游微调样本时需要考虑的典型SDE选项,以MASA任务为例。Ai表示第i个方面,Si表示其情感标签,[P]指的是占位符。

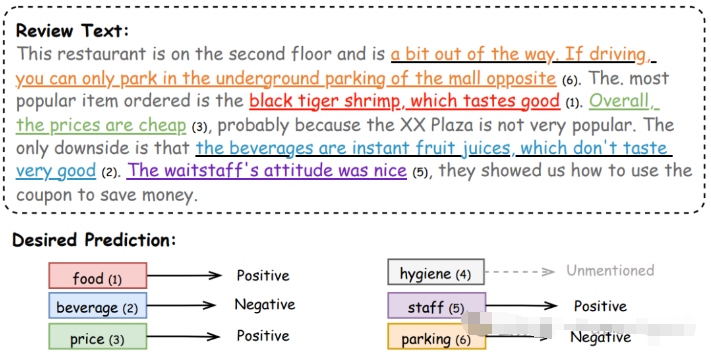

MASA任务的一个示例

10条实验结论:

- 指令位置的重要性:将指令放在输入文本的前面(Inst-first)比放在后面(Inst-last)能更好地提升LLMs在下游任务中的表现。这强调了在微调过程中指令放置的重要性。

- 输入建模的影响:在微调过程中对输入部分进行建模(MI)相比于不将输入包括在损失计算中(No-MI)会降低性能。这表明在微调时可能需要谨慎考虑对任务的哪些方面进行建模。

- 输出格式的选择:对于需要多个预测的任务,“Lines”(每行一个方面)的输出格式在不同模型和任务中表现稳定且高效。它在提供结构化信息的同时保留了自然语言的可读性。

- 未提及目标的处理:与在输出中省略未提及的目标(OU)相比,使用占位符(PU)保持一致的输出格式有助于模型学习。

- 推理设计的影响:链式思考(CoT)对提升模型在不熟悉场景中的推理和适应性具有显著作用,特别是在OOD任务中。

- 集成SDE策略的有效性:基于实验结果,提出了一种集成的SDE策略(ES-SDE),它结合了表现最佳的选项,并在不同下游任务中验证了其相对于其他启发式设计的优越性。

- 稳定性与理解能力的平衡:在考虑LLMs的格式一致性的同时,还需要考虑其在下游应用中的理解能力,这表明在工业场景中需要一种平衡的方法。

- PE与SDE的关系:通过额外的分析,有效的提示设计(PE)并不一定能够指导样本设计(SDE),这表明PE和SDE之间存在复杂的关系。

- SDE的稳健性:ES-SDE策略在不同的训练大小、解码随机性或指令变化下显示出了良好的稳定性,表明其对于LLMs的下游任务是一个可靠和强大的方法。

- SDE的适用性和局限性:尽管ES-SDE在当前实验中表现出色,但对于未测试的其他场景,其适用性仍不确定。此外,随着LLMs的快速发展,可能需要对新模型进行进一步的SDE研究。

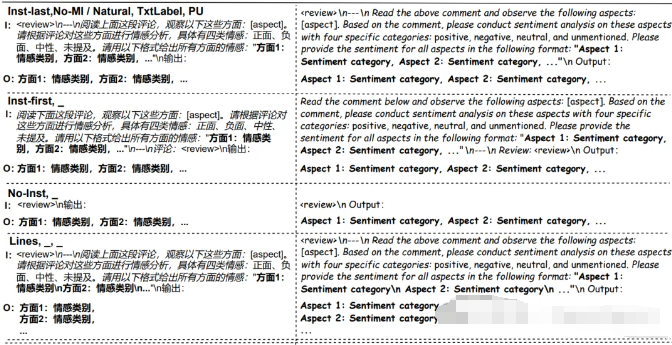

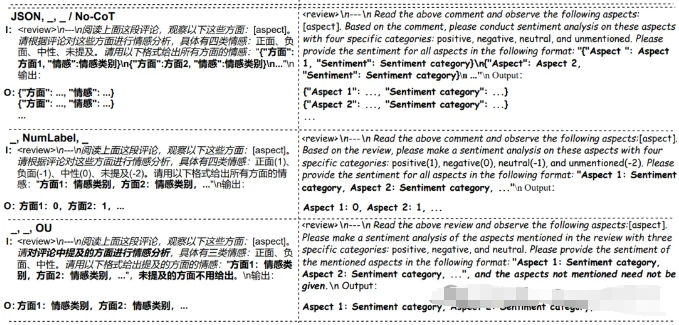

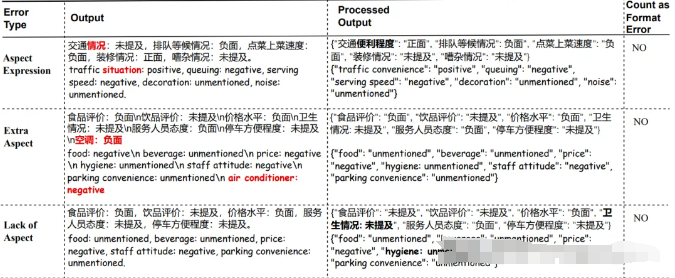

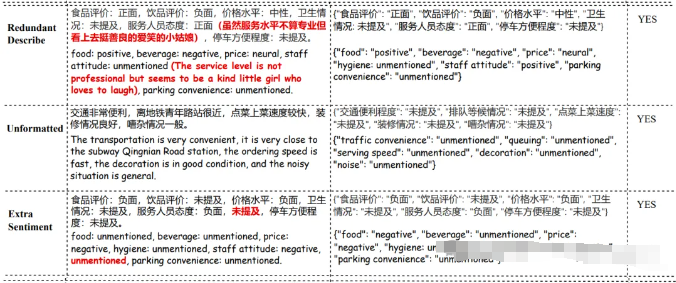

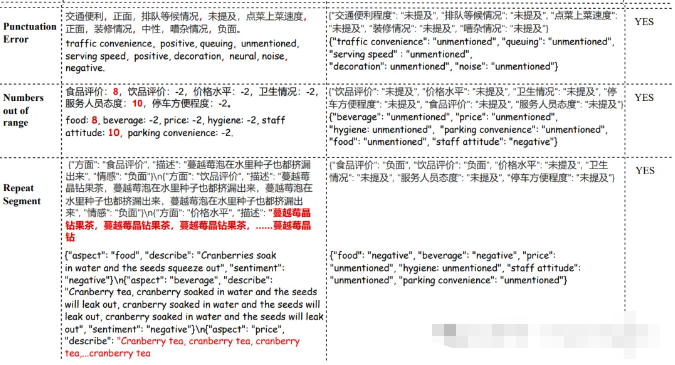

多方面情感分析(MASA)任务上不同样本设计的示例

格式错误类型及其处理方式的示例

一、大模型全套的学习路线

学习大型人工智能模型,如GPT-3、BERT或任何其他先进的神经网络模型,需要系统的方法和持续的努力。既然要系统的学习大模型,那么学习路线是必不可少的,下面的这份路线能帮助你快速梳理知识,形成自己的体系。

L1级别:AI大模型时代的华丽登场

L2级别:AI大模型API应用开发工程

L3级别:大模型应用架构进阶实践

L4级别:大模型微调与私有化部署

一般掌握到第四个级别,市场上大多数岗位都是可以胜任,但要还不是天花板,天花板级别要求更加严格,对于算法和实战是非常苛刻的。建议普通人掌握到L4级别即可。

以上的AI大模型学习路线,不知道为什么发出来就有点糊,高清版可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

365

365

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?