前言

上篇文章,为各位同学介绍了如何搭建ComfyUI + FLUX.1,为了让大家用好这套强大的文生图工具,本篇将为大家详细介绍一下ComfyUI + FLUX.1 各个节点的作用,以便于大家用好这套强大的工具。

所有的AI设计工具,安装包、模型和插件,都已经整理好了,👇获取~

01

ComfyUI+FLUX.1-schnell节点介绍

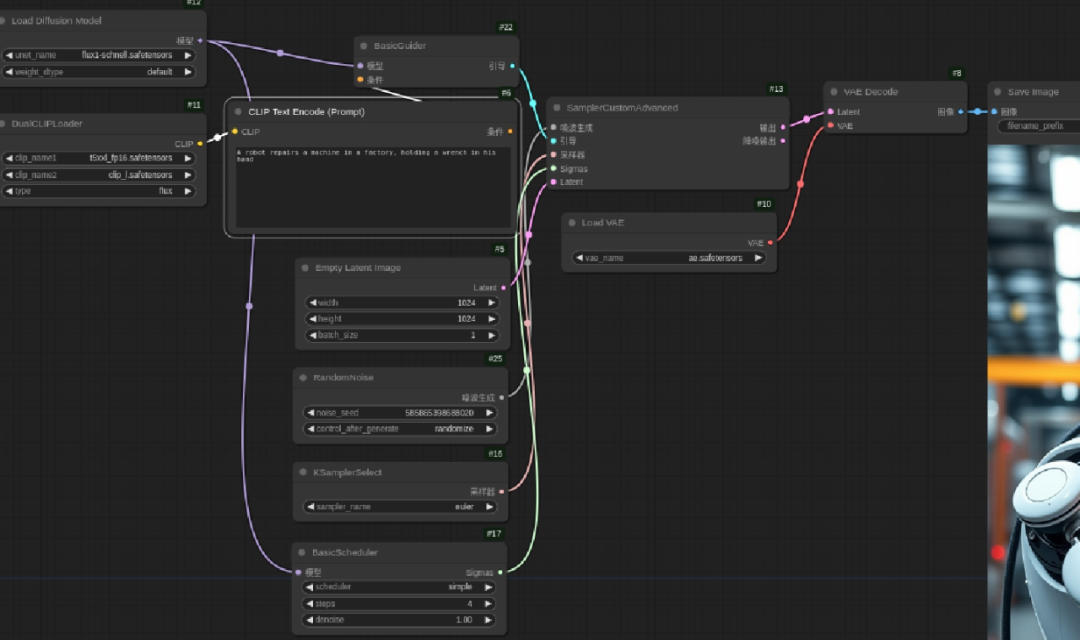

我们启动ComfyUI ,用浏览器打开网页,加载FLUX.1 - schnell 的工作流后,可以看到已经配置了好几个节点。这些节点是ComfyUI中用于构建工作流的基本单元,我们可以配置若干节点共同构成了ComfyUI的工作流,使得用户可以根据自己的需求灵活搭建工作流,实现图像处理和生成的自动化和智能化,每个节点都有其特定的功能和作用。

上图是在ComfyUI 中加载了 FLUX.1 - schnell 模型后的工作流,我们对其中的节点逐一介绍。

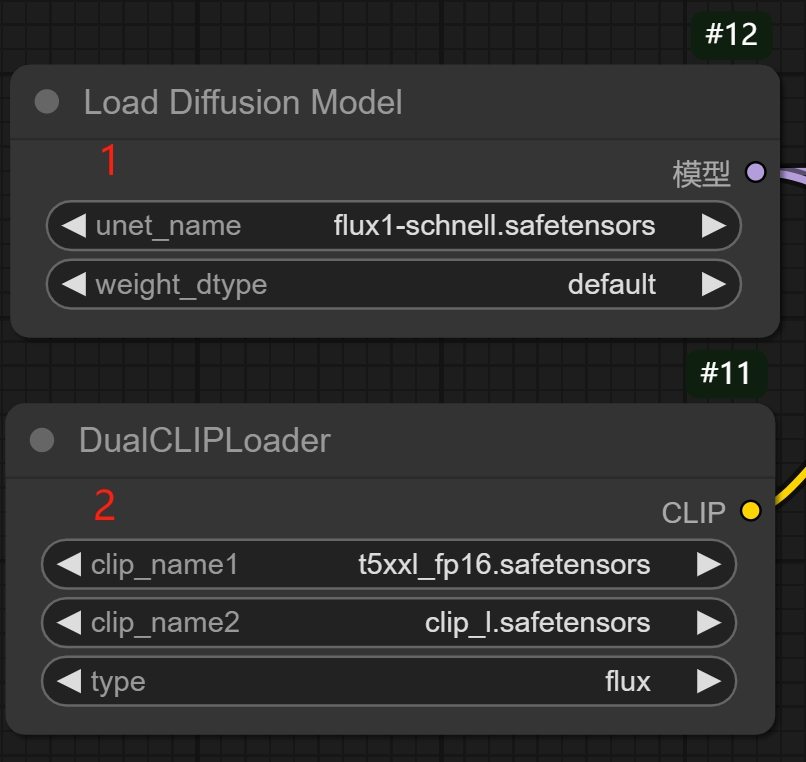

1. Load Diffusion Model : 在不同版本的ComfyUI中,这个节点也叫 “Load Checkpoint”,主要功能是加载一个预训练的Stable Diffusion模型,以便在后续的节点中进行图像生成或其他相关操作,这里我们加载了 flus1-schnel.safetensors 模型文件。

**2. DualCLIPLoader:**DualCLIPLoader节点是一个高级加载器节点,其主要功能是同时加载两个CLIP(Contrastive Language-Image Pre-training)模型,以便于执行需要整合或比较这两个模型特征的操作

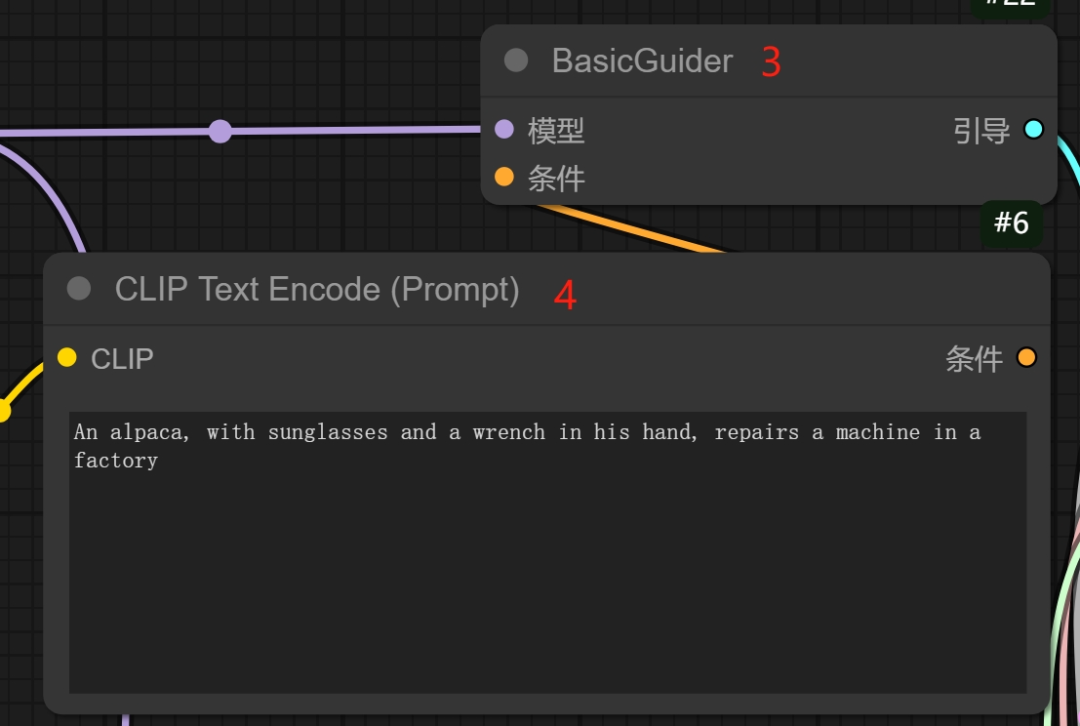

**3. BaseGuider:**据我了解,这个节点可能是用来作为工作流的基础引导节点,帮助用户理解或设置工作流的初始步骤。

**4. CLIP Text Encode(Prompt):**这个节点用于将用户提供的文本提示(正向和负向)编码成模型可以理解的格式。正向提示告诉模型需要生成什么样的图像,而负向提示则告诉模型需要避免哪些特征。

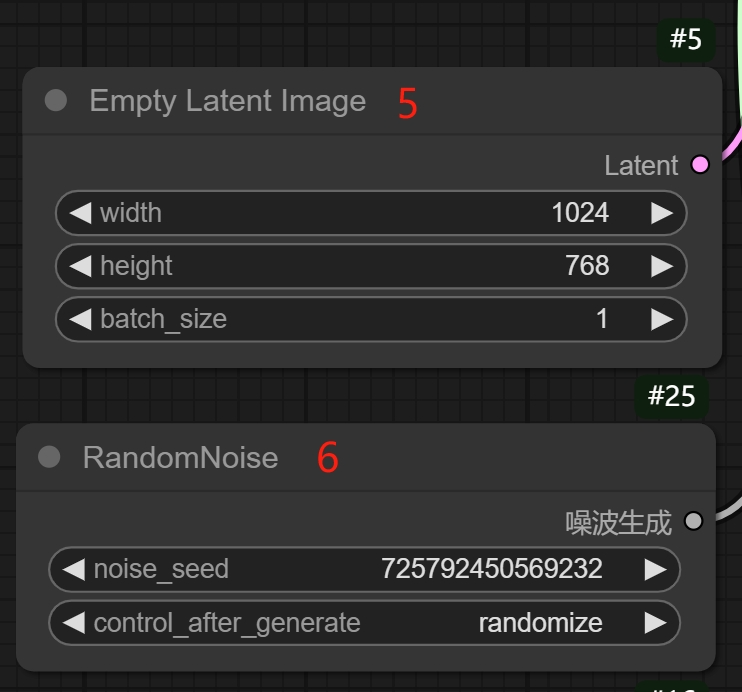

**5. Empty Latent Image:**这个节点用于生成一个空的潜在图像(latent image),作为生成图像过程的起点。这个节点生成的图像通常是一个随机噪声图像,后续通过模型的迭代过程逐渐转化为目标图像,这里我们可以配置生成图像的分辨率。

**6. RandomNoise:**这个节点用于生成基于指定种子值的可控随机噪声。这种噪声可以用于AI艺术和图像处理任务中,引入控制的随机性以创造独特和多样的输出。通过使用种子值,该节点确保生成的噪声是可重现的,即相同的种子总是产生相同的噪声模式。这对于想要在保持重现特定结果能力的同时实验不同噪声模式的艺术家来说非常有用。

**7. KSamplerSelect:**这个节点可能用于选择或配置采样器(sampler),采样器在图像生成过程中负责从潜在空间中抽取样本,以生成最终的图像。

**8. BasicScheduler:**这个节点可能用于调度或管理图像生成过程中的迭代步骤,控制生成过程的进度和效率。

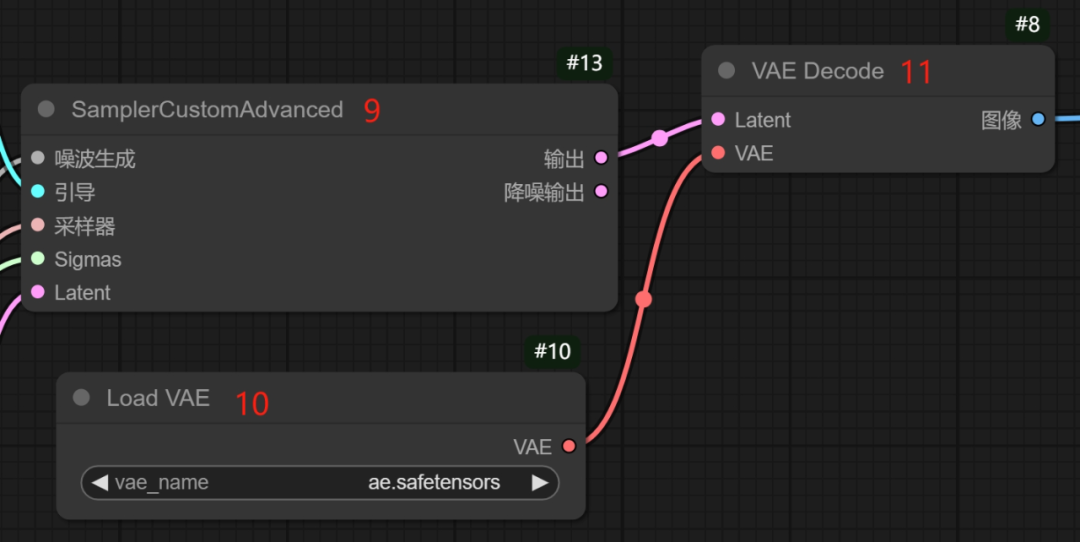

**9. SamplerCustomAdvanced:**这个节点提供高级的采样器定制功能,允许用户根据特定的需求调整采样器的行为,以优化图像生成的效果。

**10. Load VAE:**这个节点用于加载变分自编码器(VAE)模型,VAE模型在图像生成过程中用于将潜在空间的图像解码成像素空间的图像。

**11. VAE Decode:**这个节点用于执行VAE模型的解码过程,将潜在空间的图像转换回像素空间的图像,即生成最终的可视化图像。

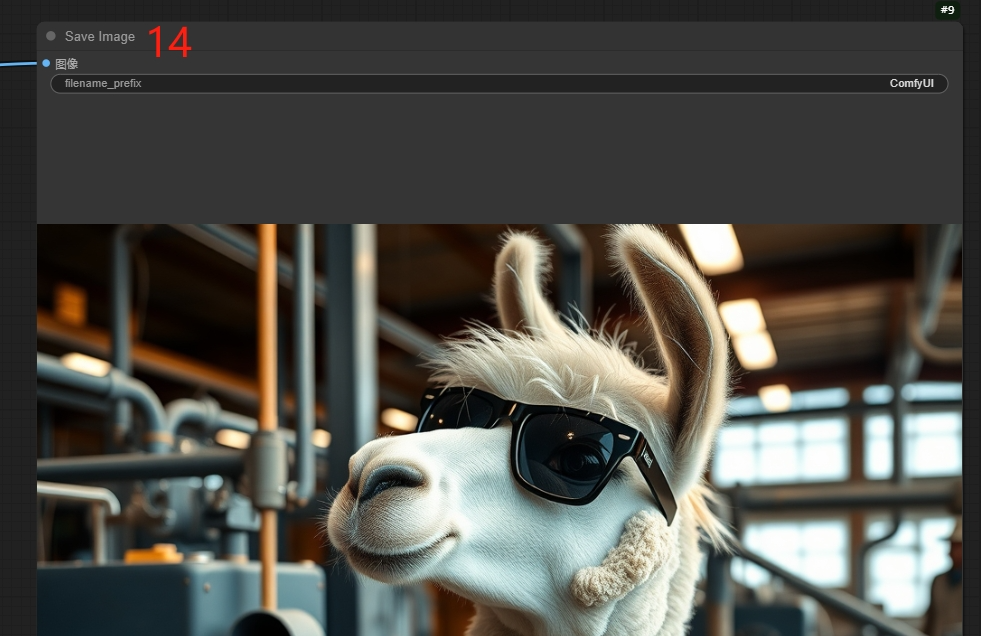

**12. Save Image:**这个节点用于保存生成的图像到文件系统,通常支持多种图像格式,允许用户将AI生成的艺术作品保存下来。

02

其它ComfyUI常用节点

除了以上配置 FLUX.1-schnell 模型的工作流节点外,我们还可以在ComfyUI中见到这些常用节点:

1. CLIP Set Last Layer:****该节点对CLIP进行微调并调整最后一层的(Set Last Layer)。该节点用来设置选择CLIP模型在第几层的输出数据,提高模型在目标任务上的表现。

**2.Load Checkpoint with config:**该节点是一个高级的节点,用于加载checkpoint大模型并同时应用config文件中指定的设置。

**3. Apply Controlnet:**该节点用于在生成图像的过程中应用控制网络(ControlNet)

**4. Conditioning Average:**该节点用于合并多个条件信息流,生成一个平均条件信息流。这在多个条件输入需要整合时特别有用,如将多条文本提示或其他控制信号组合起来。

**5. Conditioning(Set Area):**该节点用于设置图像生成过程中特定区域的条件或者属性,以控制生成图像的局部特征或者风格。

**6. Conditioning(Combine):**该节点用于将多个条件信息流合并为一个单一的条件信息流,以用于控制图像生成过程中的各个方面。

**7. Image Blur:**该节点用于对输入的图像进行模糊处理,以改变图像的视觉效果或者减少图像中的细节,通常用于创建柔和或者抽象化的视觉效果。

**8. Image Sharpen:**该节点用于增强图像的清晰度和细节,通常用于提升图像的视觉效果和边缘锐化。

**9 . Image Quantize:**该节点用于将输入的图像进行量化处理,即将图像中的颜色数目减少到较少的色彩级别。

**10. Image Blend:**该节点用于将两幅图像混合在一起,生成一个结合了两幅图像特征的图像。

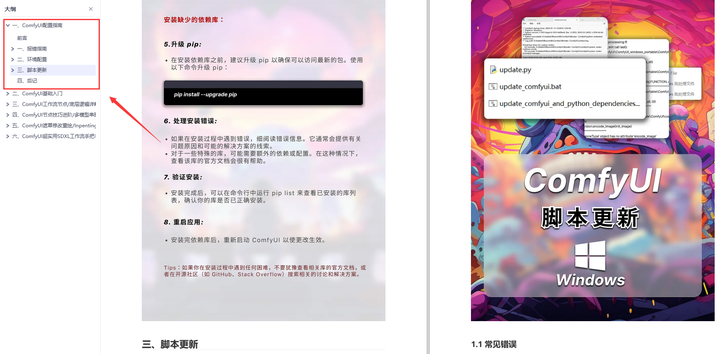

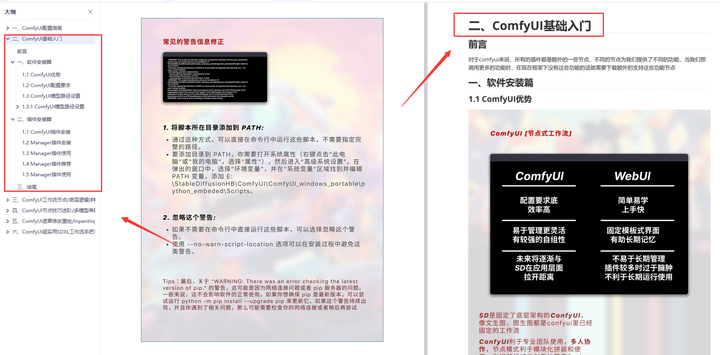

为了帮助大家更好地掌握 ComfyUI,我在去年花了几个月的时间,撰写并录制了一套ComfyUI的基础教程,共六篇。这套教程详细介绍了选择ComfyUI的理由、其优缺点、下载安装方法、模型与插件的安装、工作流节点和底层逻辑详解、遮罩修改重绘/Inpenting模块以及SDXL工作流手把手搭建。

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

一、ComfyUI配置指南

- 报错指南

- 环境配置

- 脚本更新

- 后记

- …

二、ComfyUI基础入门

- 软件安装篇

- 插件安装篇

- …

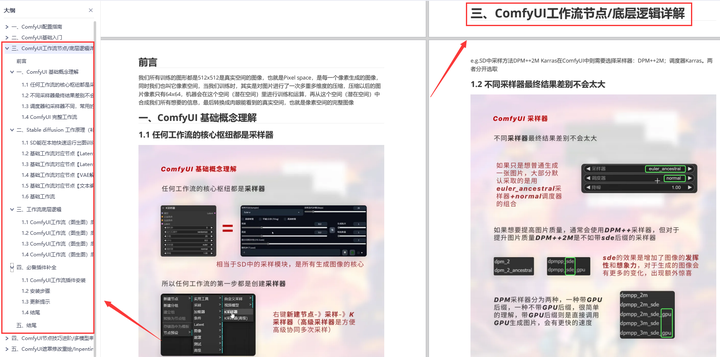

三、 ComfyUI工作流节点/底层逻辑详解

- ComfyUI 基础概念理解

- Stable diffusion 工作原理

- 工作流底层逻辑

- 必备插件补全

- …

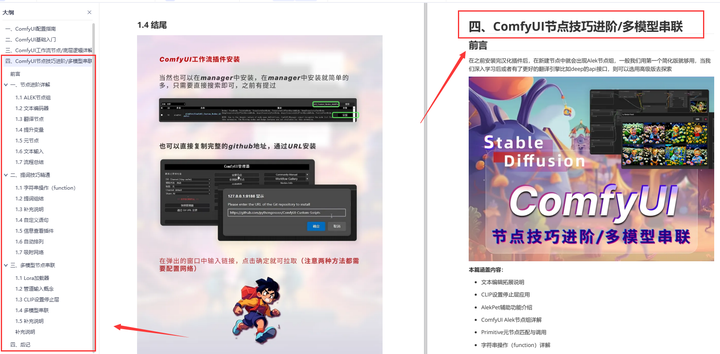

四、ComfyUI节点技巧进阶/多模型串联

- 节点进阶详解

- 提词技巧精通

- 多模型节点串联

- …

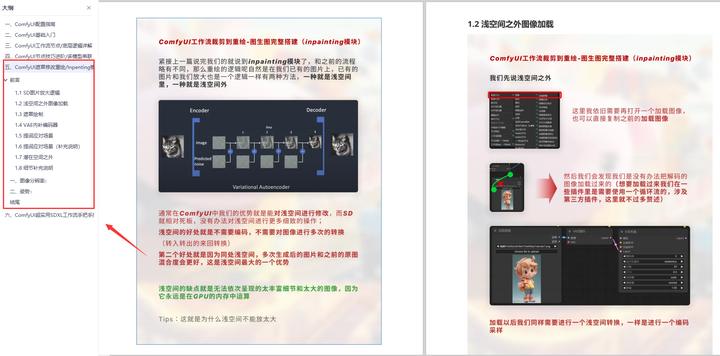

五、ComfyUI遮罩修改重绘/Inpenting模块详解

- 图像分辨率

- 姿势

- …

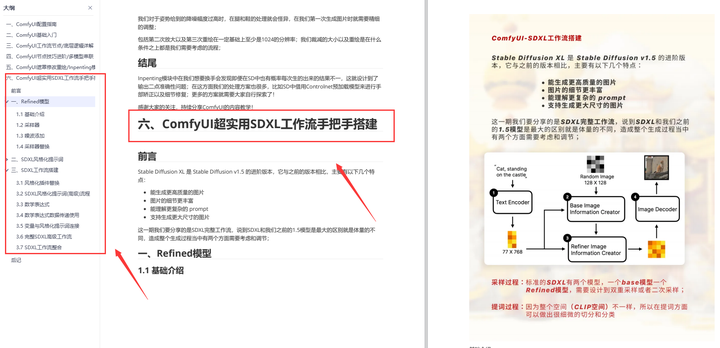

六、ComfyUI超实用SDXL工作流手把手搭建

- Refined模型

- SDXL风格化提示词

- SDXL工作流搭建

- …

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

4666

4666

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?