Recurrent Neural Network

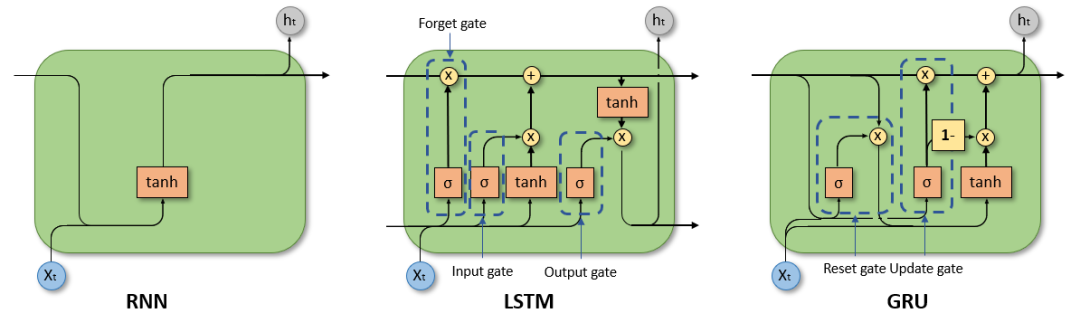

RNN(循环神经网络)是构建Seq2Seq模型中编码器和解码器的一种常用方式。 通过RNN的循环机制,Seq2Seq模型能够实现对序列数据的整体编码和解码,从而完成从输入序列到输出序列的转换。

RNN的核心在于其内置的循环机制,这种机制能够有效地捕捉序列数据中的依赖关系。

Seq2Seq

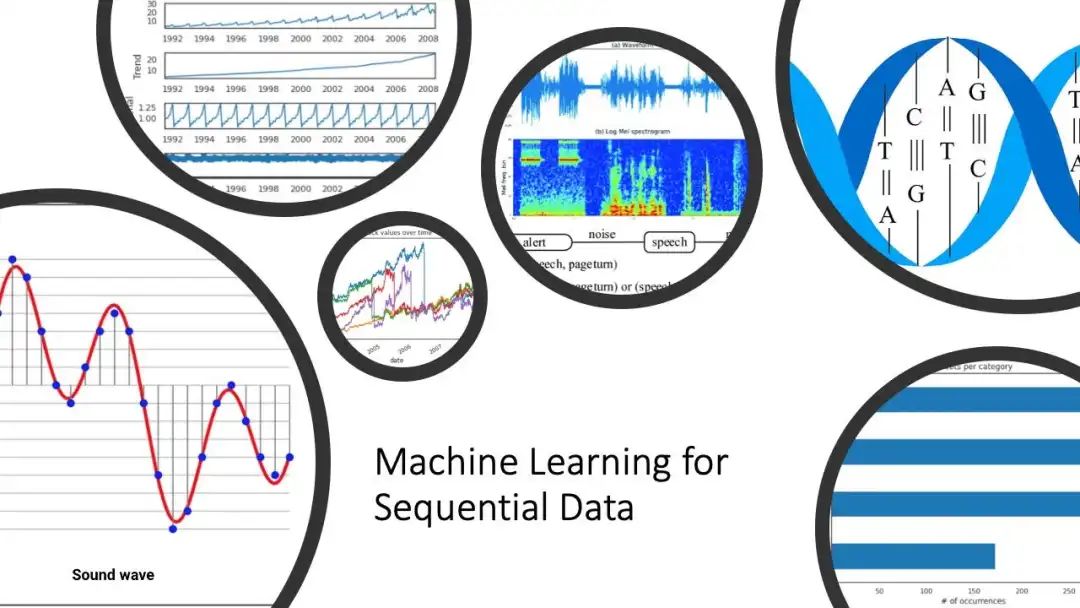

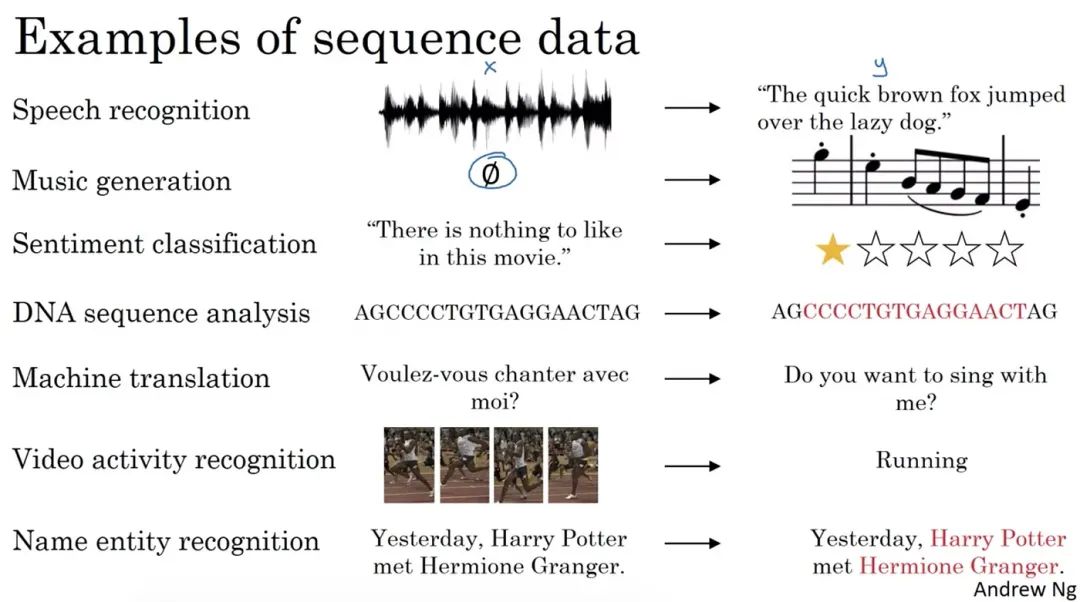

序列数据(Sequence Data) 是指按照一定顺序排列的数据集合,其中的每个元素被称为序列的一个项(item)。

序列数据的特点是按顺序排列,元素之间存在时间或空间上的依赖关系。

Sequence Data

根据数据产生的领域不同,序列数据可以包含多种类型,包括但不限于以下几种:

-

文本型序列数据:如句子、段落、文章等。在自然语言处理(NLP)中,文本数据通常会被切分成一个个单词或字符,形成序列。这些单词或字符按照它们在文本中出现的顺序排列,构成了文本型序列数据。

-

时间序列数据:这是一种按照时间顺序记录的数据,如股票价格、气温、心电图等。每个时间点的数据都可以看作是序列的一个项,它们按照时间顺序排列,形成了时间序列数据。

-

音频信号:音频信号可以被看作是一个连续的序列,每个时间点的振幅值构成了序列的一部分。音频处理中经常需要对这些序列数据进行分析和处理。

-

生物序列数据:如DNA序列和蛋白质序列。DNA序列由一系列的碱基组成,而蛋白质序列则是由氨基酸组成的。这些生物序列数据在生物学和生物信息学领域中具有重要的应用价值。

-

视频帧:视频可以被看作是一系列的图像帧,每一帧都是序列的一个项。视频处理中经常需要对这些图像帧序列进行分析和处理,以实现视频的压缩、传输和编辑等功能。

Sequence Data

二、序列到序列(Sequence-to-Sequence)

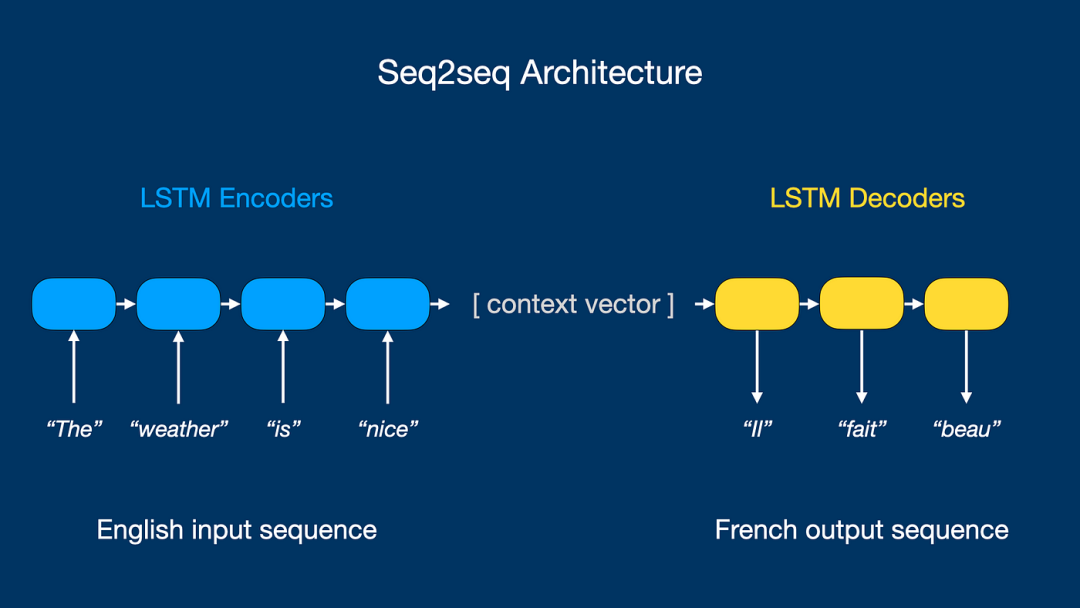

序列到序列模型: 序列到序列(Sequence-to-Sequence,简称Seq2Seq)模型是一种深度学习模型,广泛应用于自然语言处理(NLP)和其他序列数据处理任务中。

其核心思想是将一个输入序列映射到一个输出序列,通过编码器和解码器的结构实现不定长输入到不定长输出的转换。

Seq2Seq

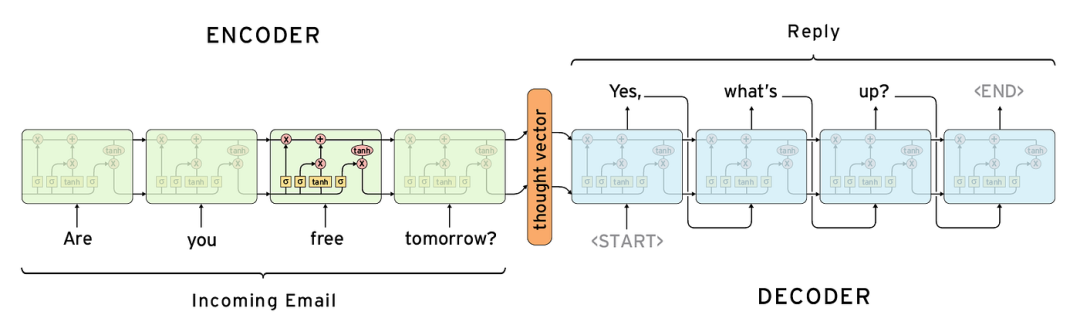

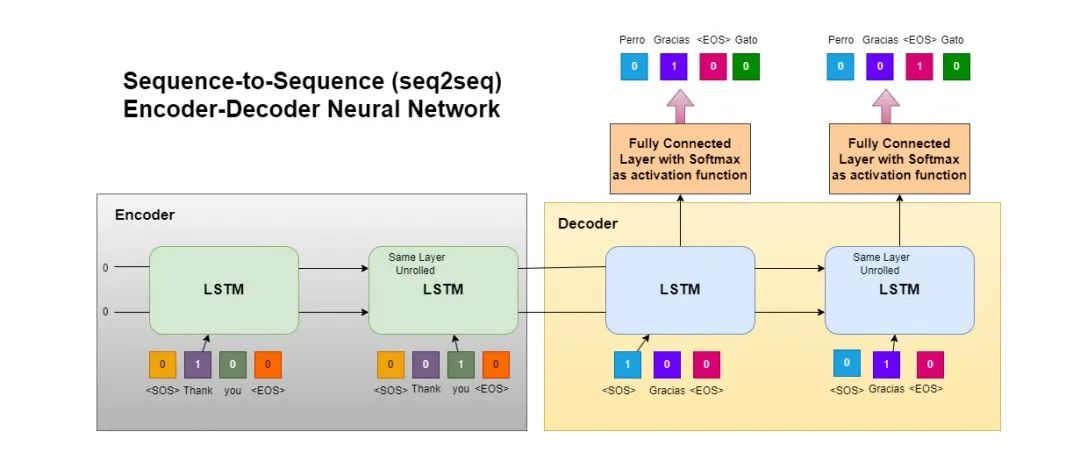

序列到序列模型由两个主要部分组成:编码器(Encoder)和解码器(Decoder)。

- 编码器(Encoder):

-

编码器负责将输入序列转换为一个固定长度的上下文向量(Context Vector)或隐藏状态序列,以捕捉输入序列中的语义信息。

-

常用的编码器是循环神经网络(RNN),包括其变体如长短时记忆网络(LSTM)和门控循环单元(GRU)。此外,也有使用卷积神经网络(CNN)或Transformer等结构作为编码器的。

- 解码器(Decoder):

-

解码器根据编码器输出的上下文向量或隐藏状态序列,逐步生成输出序列。

-

在每个时间步,解码器接收上一个时间步的输出(或起始标记)和编码器的上下文信息,生成当前时间步的输出,并更新其内部状态。

-

解码器同样可以是RNN、LSTM、GRU或Transformer等结构。

Seq2Seq

序列到序列的工作流程:

- 输入处理:

-

将输入序列(如源语言句子)进行预处理,如分词、转换为索引等。

-

将处理后的输入序列输入到编码器。

- 编码过程:

-

编码器逐步处理输入序列中的每个元素,生成隐藏状态序列或上下文向量。

-

隐藏状态序列或上下文向量包含了输入序列的语义信息。

- 解码过程:

-

解码器以起始标记为输入,开始生成输出序列。

-

在每个时间步,解码器根据编码器输出的上下文信息和上一个时间步的输出,生成当前时间步的输出。

-

重复解码过程,直到生成终止标记或达到预设的输出序列长度。

Seq2Seq

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

9408

9408

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?