深度学习目标检测中构建基于YOLOv8和PyQt的车流量检测统计系统,构建到车辆检测、分类、计数、测速以及车牌识别等功能。

YOLOv8+pyqt车流量检测统计系统

Python语言

需要装CUDA电脑需要英伟达gpu

本机测试win10+Python3.8+Python包+CUDA11.1+pytorch—gpu1.9.0

实现功能:

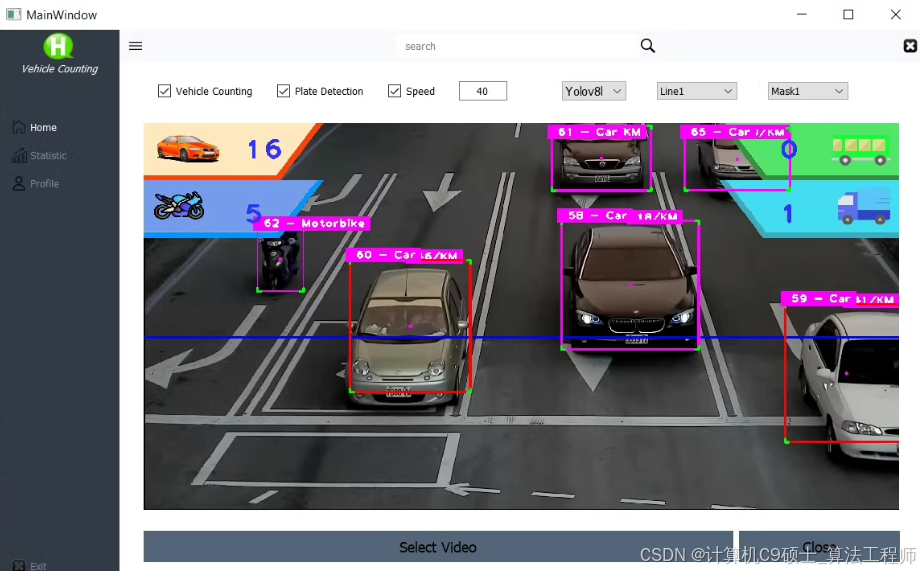

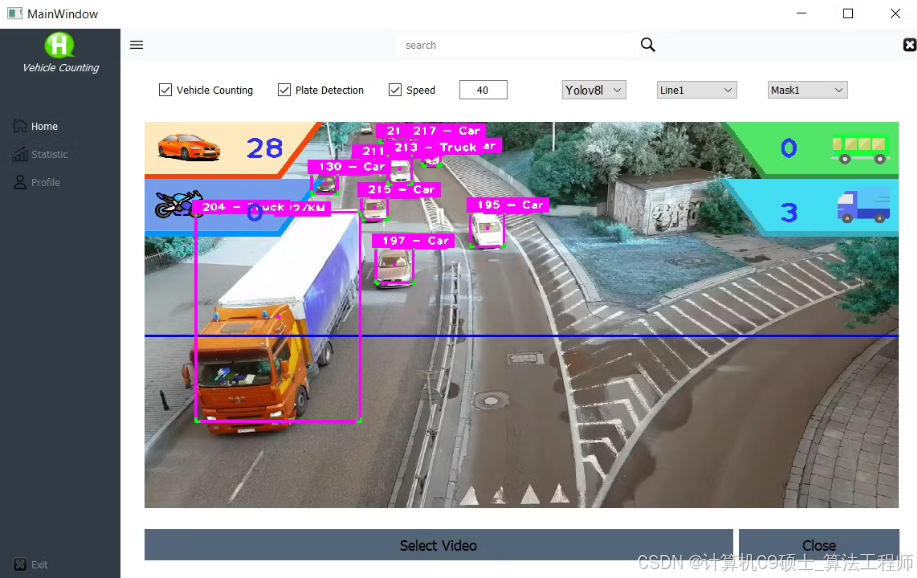

车辆检测:实时检测不同类型的车辆,包括:汽车,卡车,公共汽车,摩托车。

车流量统计:对四种类型车辆实时计数,并生成统计信息报告;

车辆测速:用于车速估计;

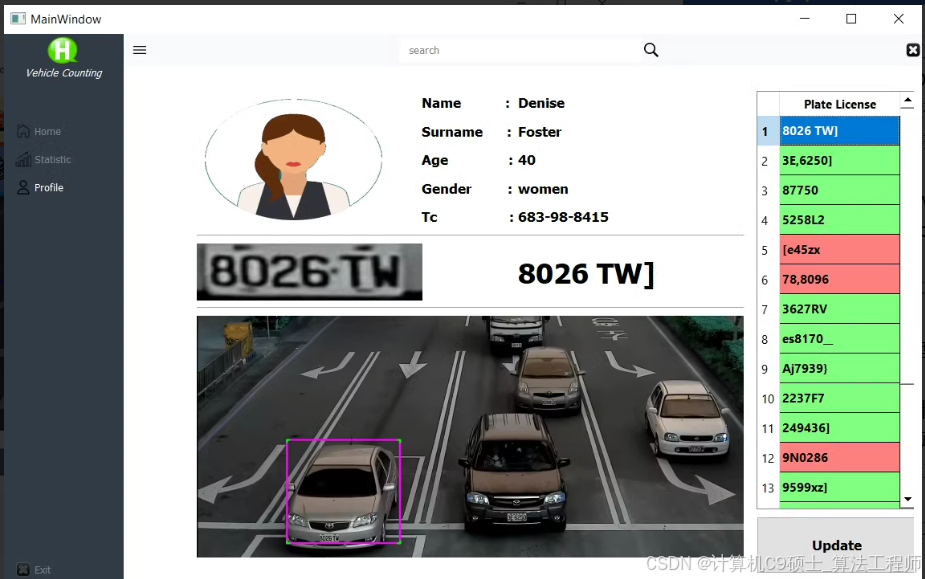

车牌识别:实时车牌检测与识别,并对OCR车牌信息进行提取,点击车牌获取对应车主信息;

实现一个基于YOLOv8和PyQt的车流量检测统计系统,涉及到车辆检测、分类、计数、测速以及车牌识别等功能。下面是一个高层次的设计思路和具体实现步骤。

1. 环境准备

首先确保你的环境满足以下要求:

- 操作系统:Windows 10

- Python版本:3.8

- CUDA版本:11.1

- PyTorch版本:GPU支持的1.9.0

- 其他依赖包:

opencv-python,ultralytics,pytesseract,torchvision,PyQt5

你可以通过以下命令安装必要的Python包(假设你已经正确配置了CUDA环境):

pip install torch==1.9.0+cu111 torchvision==0.10.0+cu111 torchaudio===0.9.0 -f https://download.pytorch.org/whl/torch_stable.html

pip install opencv-python ultralytics pytesseract PyQt5

2. 车辆检测与分类

使用YOLOv8进行车辆检测和分类。首先,加载预训练模型或在特定数据集上微调模型以识别汽车、卡车、公共汽车和摩托车。

加载YOLOv8模型

from ultralytics import YOLO

model = YOLO('yolov8n.pt') # 或者加载针对车辆优化的权重

3. 车流量统计

为了统计车流量,你需要定义一个区域作为检测区,并对穿越该区域的车辆进行计数。可以使用帧差分技术或深度学习方法来追踪车辆移动。

示例代码

class VehicleCounter:

def __init__(self, line):

self.line = line

self.counts = {'car': 0, 'truck': 0, 'bus': 0, 'motorcycle': 0}

def update(self, detections):

for det in detections:

if self._crossed_line(det['bbox']):

self.counts[det['label']] += 1

def _crossed_line(self, bbox):

# 判断车辆是否穿过线

pass

4. 车辆测速

可以通过计算车辆在连续帧之间的位移来估计速度。需要知道摄像头视角下的实际距离比例。

5. 车牌识别

使用OCR技术(如Tesseract)从图像中提取车牌信息。可以先用YOLOv8定位车牌位置,然后用Tesseract识别字符。

import cv2

import pytesseract

def recognize_license_plate(image, plate_bbox):

x, y, w, h = plate_bbox

plate_img = image[y:y+h, x:x+w]

config = '--oem 3 --psm 6'

text = pytesseract.image_to_string(plate_img, config=config)

return text.strip()

6. PyQT界面设计

创建一个简单的GUI来展示实时视频流、检测结果、统计数据等。

from PyQt5.QtWidgets import QApplication, QLabel, QVBoxLayout, QWidget

from PyQt5.QtGui import QImage, QPixmap

from PyQt5.QtCore import QTimer

import sys

class MainWindow(QWidget):

def __init__(self):

super().__init__()

self.initUI()

self.timer = QTimer()

self.timer.timeout.connect(self.update_frame)

self.timer.start(20) # 每20ms更新一帧

def initUI(self):

layout = QVBoxLayout()

self.video_label = QLabel()

layout.addWidget(self.video_label)

self.setLayout(layout)

def update_frame(self):

ret, frame = cap.read()

if ret:

# 处理帧并显示

self.display_image(frame)

def display_image(self, img):

qformat = QImage.Format_Indexed8

if len(img.shape) == 3: # [0]=rows, [1]=cols, [2]=channels

if img.shape[2] == 4:

qformat = QImage.Format_RGBA8888

else:

qformat = QImage.Format_RGB888

outImage = QImage(img, img.shape[1], img.shape[0], img.strides[0], qformat)

self.video_label.setPixmap(QPixmap.fromImage(outImage))

if __name__ == '__main__':

app = QApplication(sys.argv)

mainWindow = MainWindow()

mainWindow.show()

sys.exit(app.exec_())

7. 集成所有功能

将上述各个部分集成到一起,形成一个完整的应用。注意处理多线程问题,避免阻塞主界面。

这个框架提供了一个基本的指南,根据实际情况可能需要调整和扩展,比如更复杂的车辆跟踪算法、更精确的速度测量方法以及更高效的车牌识别策略。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?