在工业自动化生产的过程中,印刷缺陷检测是一个至关重要的环节,它直接影响到产品的质量和生产效率。传统的印刷缺陷检测方法往往依赖于人工视觉检查或者简单的图像处理技术,这些方法不仅效率低下,而且检测精度有限,难以满足现代工业生产对于高精度和高效率的要求。随着深度学习技术的飞速发展,卷积神经网络(CNN)在图像识别和分割领域取得了巨大的成功,为印刷缺陷检测提供了新的思路和方法。

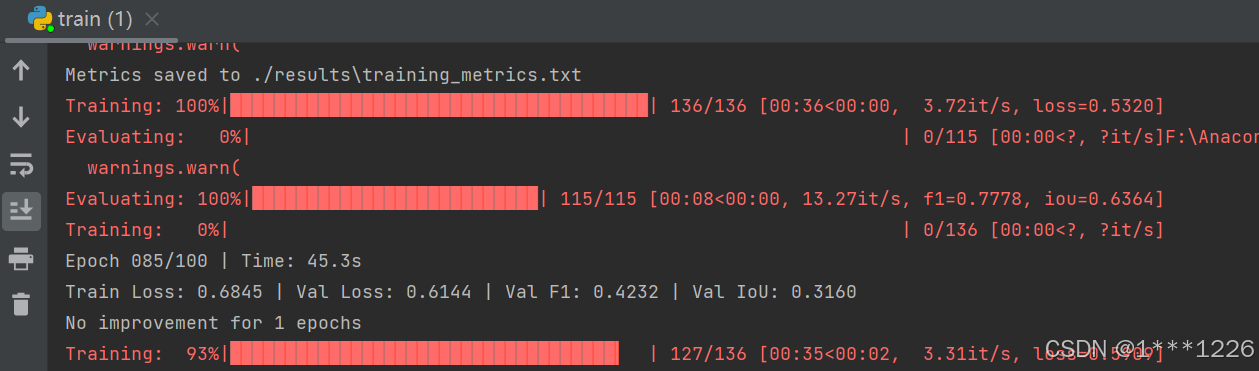

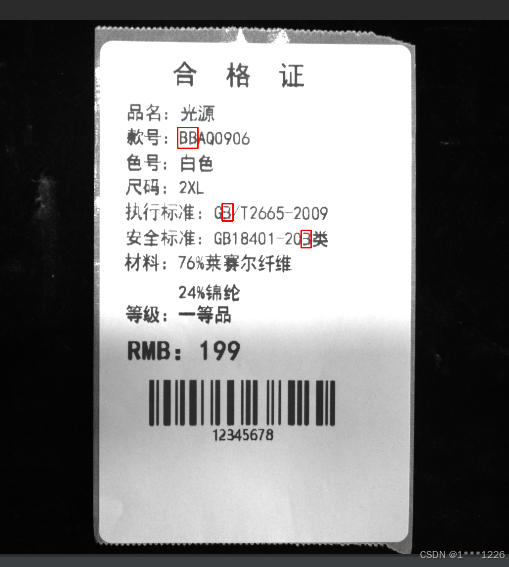

本文将从实践的角度出发,详细介绍如何利用增强型U-Net模型进行印刷缺陷检测,包括模型的构建、数据的准备和预处理、模型的训练以及实验结果的分析等方面。

一、模型构建

(一)增强型U-Net模型的结构

U-Net模型因其在医学图像分割领域的出色表现而广为人知,其独特的编码器-解码器结构以及跳跃连接的设计,使得它能够有效地捕捉图像的上下文信息和细节特征。在此基础上,我们构建了增强型U-Net模型,进一步提升了模型的性能。

增强型U-Net模型的编码器部分由多个卷积块组成,每个卷积块包含两个卷积层和一个ReLU激活函数,通过逐步下采样,提取图像的高级特征。解码器部分则通过转置卷积进行上采样,逐步恢复图像的分辨率,并通过跳跃连接将编码器部分的特征图与解码器部分的特征图进行融合,有效地解决了梯度消失问题,同时保留了图像的细节信息。

class EnhancedUNet(nn.Module):

def __init__(self):

super().__init__()

features = Config.init_featuresself._initialize = nn.init.kaiming_normal_

# 编码器

self.encoder1 = self._build_block(Config.in_channels, features)

self.pool1 = nn.MaxPool2d(2)

self.encoder2 = self._build_block(features, features * 2)

self.pool2 = nn.MaxPool2d(2)

self.encoder3 = self._build_block(features * 2, features * 4)

self.pool3 = nn.MaxPool2d(2)

self.encoder4 = self._build_block(features * 4, features * 8)

self.pool4 = nn.MaxPool2d(2)# 瓶颈层

self.bottleneck = self._build_block(features * 8, features * 16)# 解码器

self.upconv4 = nn.ConvTranspose2d(features * 16, features * 8, 2, 2)

self.decoder4 = self._build_block(features * 16, features * 8)

self.upconv3 = nn.ConvTranspose2d(features * 8, features * 4, 2, 2)

self.decoder3 = self._build_block(features * 8, features * 4)

self.upconv2 = nn.ConvTranspose2d(features * 4, features * 2, 2, 2)

self.decoder2 = self._build_block(features * 4, features * 2)

self.upconv1 = nn.ConvTranspose2d(features * 2, features, 2, 2)

self.decoder1 = self._build_block(features * 2, features)# 注意力机制

self.attention4 = AttentionBlock(features * 8, features * 8)

self.attention3 = AttentionBlock(features * 4, features * 4)

self.attention2 = AttentionBlock(features * 2, features * 2)

self.attention1 = AttentionBlock(features * 1, features * 1)self.final_conv = nn.Conv2d(features, Config.out_channels, 1)

self._initialize_weights()def _bui

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1346

1346

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?