一、微调概述

1.什么是大模型微调

大模型微调(Fine-tuning)是指基于预训练的大型语言模型(如GPT、BERT等),通过特定领域或任务的数据进行二次训练,使模型适应具体应用场景的技术过程。与从零开始训练相比,微调能够以较低成本实现模型的领域适配,是AI大模型落地应用的核心技术路径。

2.为什么需要微调

领域适配:通用大模型在专业领域表现欠佳(如医疗、法律)

任务定制:适应具体任务需求(如客服对话、文本摘要)

数据隐私:企业可利用内部数据定制专属模型

成本效益:比从头训练节省90%以上的计算资源

3.微调方法分类

| 微调类型 | 数据需求 | 计算成本 | 典型应用场景 |

|---|---|---|---|

| 全参数微调 | 大量 | 高 | 专业领域深度适配 |

| 参数高效微调 | 中等 | 中 | 大多数企业场景 |

| 提示微调 | 少量 | 低 | 快速原型开发 |

二、技术架构

1.典型微调技术架构

[数据准备层]

│

├─ 数据清洗工具

├─ 标注平台

└─ 数据增强模块

│

[微调算法层]

│

├─ 全参数微调

├─ LoRA/Adapter

└─ 提示微调

│

[训练优化层]

│

├─ 分布式训练框架

├─ 混合精度训练

└─ 梯度检查点

│

[评估部署层]

│

├─ 自动评估指标

├─ 模型压缩工具

└─ 服务化封装2.关键技术组件

数据处理流水线

领域数据采集与清洗、智能标注与数据增强、数据格式统一化处理

微调算法库

支持多种微调策略、超参数自动优化、灾难性遗忘防护机制

分布式训练框架

支持多GPU/TPU并行、弹性计算资源调度、断点续训功能

三、关键技术实现

1.参数高效微调技术

LoRA(Low-Rank Adaptation)

# PyTorch实现示例

class LoRALayer(nn.Module):

def __init__(self, in_dim, out_dim, rank=8):

super().__init__()

self.A = nn.Parameter(torch.randn(in_dim, rank))

self.B = nn.Parameter(torch.zeros(rank, out_dim))

def forward(self, x):

return x @ (self.A @ self.B) # 低秩矩阵乘积优势:仅训练新增参数(通常<1%总参数量),保持原始模型权重不变

Adapter结构

[Transformer层结构]

│

├─ 多头注意力

├─ LayerNorm

└─ FeedForward

│

[插入Adapter]

│

├─ 下投影(d→r)

├─ 非线性激活

└─ 上投影(r→d)特点:在每层Transformer中插入小型网络模块,典型r=64

2.混合专家微调(MoE)

适用于超大规模模型的微调策略:

仅激活与当前任务相关的专家网络

典型实现:

class MoELayer(nn.Module):

def __init__(self, num_experts, expert_fn):

self.experts = nn.ModuleList([expert_fn() for _ in range(num_experts)])

self.gate = nn.Linear(d_model, num_experts)

def forward(self, x):

gate_logits = self.gate(x)

weights = F.softmax(gate_logits, dim=-1)

outputs = torch.stack([e(x) for e in self.experts], dim=-1)

return (weights.unsqueeze(-1) * outputs).sum(dim=-1)3.基于强化学习的微调

人类反馈强化学习(RLHF)三阶段流程:

监督微调(SFT)

奖励模型训练

PPO策略优化

关键创新点:

基于偏好的奖励建模、近端策略优化算法、安全约束注入

四、未来前景与挑战

1.技术发展趋势

①自动化微调

自动超参数搜索(AutoML)、神经架构自动优化、数据选择自动化

②多模态微调

跨模态联合微调框架、统一表征空间构建、模态间知识迁移

③终身学习系统

持续学习不遗忘、知识增量更新、模型版本管理

2.行业应用前景

| 行业 | 应用场景 | 技术特点 |

|---|---|---|

| 金融 | 智能投研报告生成 | 高精度数值处理 |

| 医疗 | 电子病历分析 | 隐私保护微调 |

| 教育 | 个性化学习助手 | 小样本适应 |

| 制造 | 设备故障诊断 | 多模态融合 |

AI不会淘汰人类,但会淘汰不会用AI的人

这不是科幻电影,而是2025年全球职场加速“AI化”的缩影。从最新数据看,全球已有23%的知识型岗位因AI大模型缩减规模,而在编程、翻译、数据分析等领域,替代率更飙升至40%以上。当AI开始撰写法律合同、设计建筑图纸、甚至独立完成新药分子结构预测时,一个残酷的真相浮出水面:人类与AI的竞争,已从辅助工具升级为生存战争。

留给人类的时间窗口正在关闭。学习大模型已不是提升竞争力的可选项,而是避免被淘汰的必选项。正如谷歌CEO桑达尔·皮查伊所说:“未来只有两种人:创造AI的人,和解释自己为什么不需要AI的人。”你,选择成为哪一种?

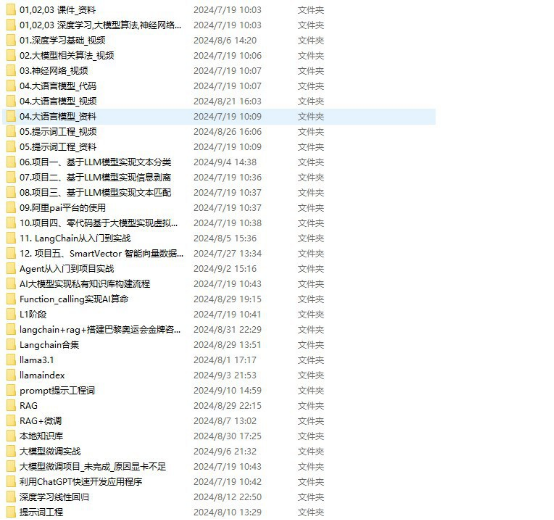

1.AI大模型学习路线汇总

L1阶段-AI及LLM基础

L2阶段-LangChain开发

L3阶段-LlamaIndex开发

L4阶段-AutoGen开发

L5阶段-LLM大模型训练与微调

L6阶段-企业级项目实战

L7阶段-前沿技术扩展

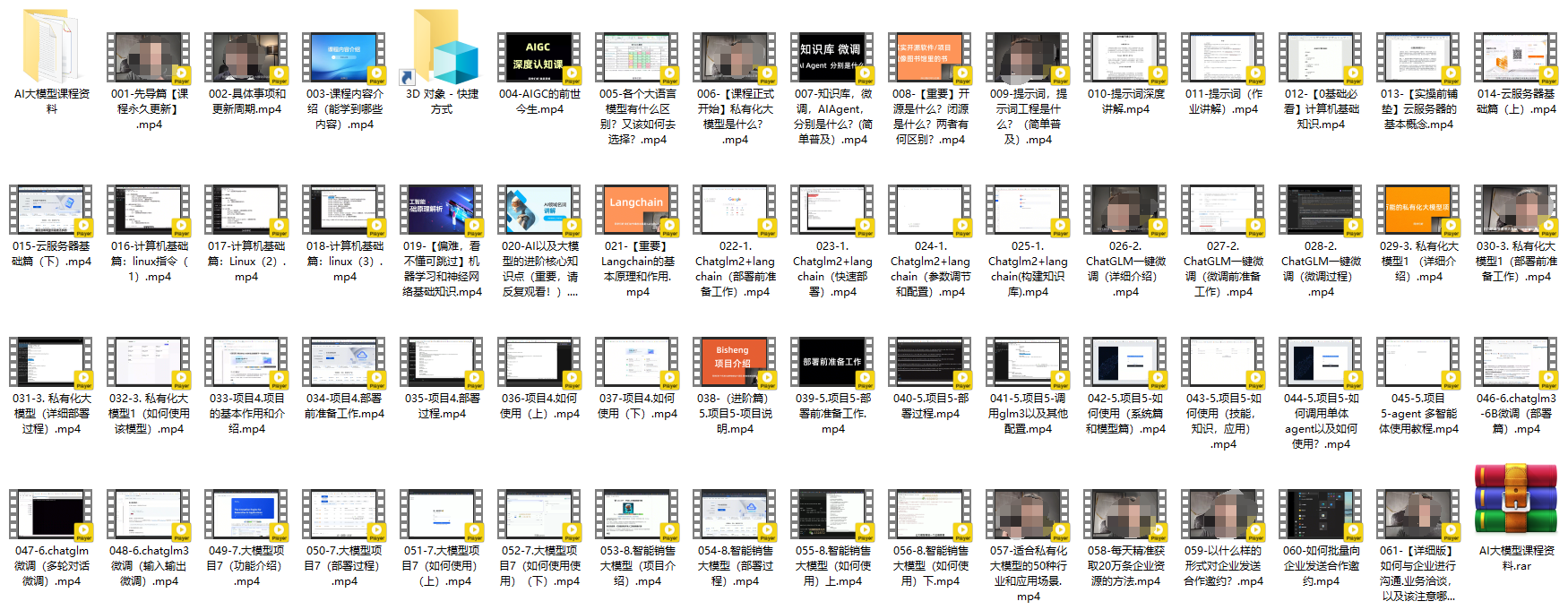

2.AI大模型PDF书籍合集

3.AI大模型视频合集

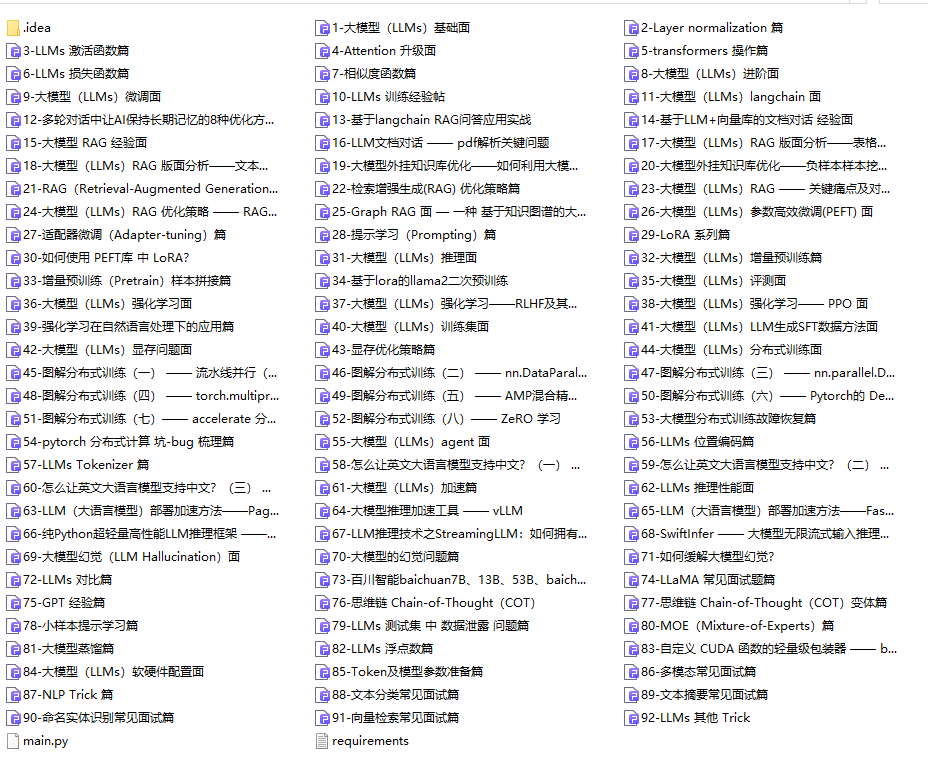

4.LLM面试题和面经合集

5.AI大模型商业化落地方案

📣朋友们如果有需要的话,可以V扫描下方二维码联系领取~

909

909

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?