1. 线性分类与感知机

线性分类与感知机部分包含了线性回归、线性二分类问题、对数回归与多分类回归、神经元模型和感知机模型等部分。

1.1线性回归

线性回归是一种通过拟合自变量与因变量之间的线性关系来预测目标值的统计方法。线性回归要素如下:

(1)训练集或者训练数据,是我们流程中的输入数据,一般称为𝑥;

(2)输出数据,一般称为𝑦;

(3)拟合的函数(或者称为假设或者模型):一般写做 𝑦 = ℎ(𝑥);若为直线,则为𝑦 = 𝑘𝑥 + 𝑏;

(4)训练数据的条目数:一条训练数据是由一对输入数据和输出数据组成的,输入数据的维度𝑛。

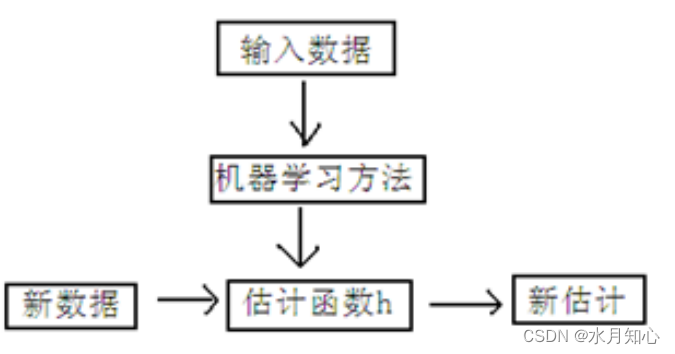

线性回归的学习过程如图:

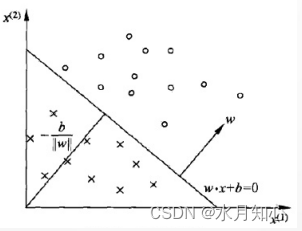

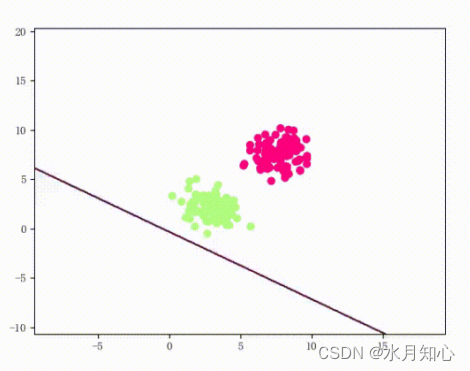

1.2线性二分类

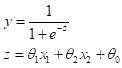

线性分类器透过特征的线性组合来做出分类决定。简言之,样本通过直线(或超平面)可分。对于二分类问题,借助Sigmoid函数计算概率,将不同的数据划分为0和1两类,从而将回归问题转化为分类问题,并使用梯度下降法使得误差函数最小,甚至趋近于0。Sigmoid函数:

1.3对数回归

对数回归引入概率的概念,结合贝叶斯公式和极大似然法,将线性回归的输出映射到0到1之间,重新修改指标函数,并对其最小化,取似然函数

从而实现概率预测,使得分类结果更加具有解释性。在实际应用中,根据这个概率值,可以进行更灵活的决策。

1.4多分类回归

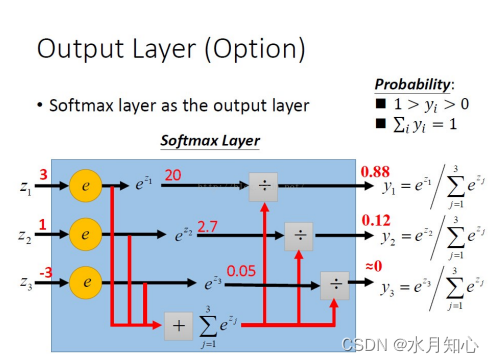

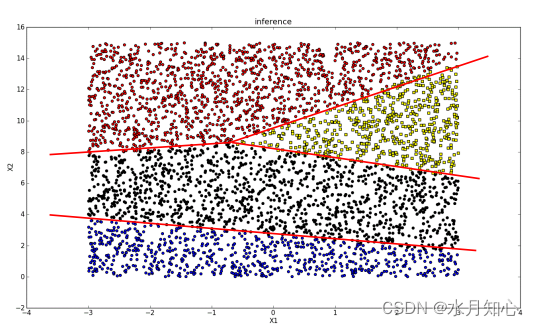

多分类回归通过构建多个二分类器或者使用softmax函数等方式,将问题转化为多个二分类问题或者一次性解决多分类问题。这种处理方式不仅扩展了分类问题的应用范围,而且在实际操作中,也展现了其强大的分类能力。Softmax演示结果:

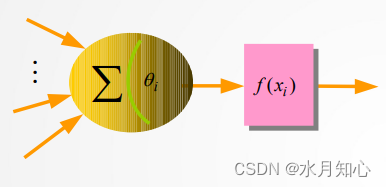

1.5神经元模型

生物神经元模型包括了Spiking模型和Integrate-and-fire模型和由此衍生的人工神经元模型(M-P模型)。此外还有单神经元模型,即当输入大于等于0时输出为1,输入小于0时输出为0。作用函数有非对称型Sigmoid函数和对称型Sigmoid函数和对称型阶跃函数。

1.6 感知机模型

引入权重和偏置,将输入数据进行线性组合,并通过符号函数来得到最终的分类结果。

该模型能通过更新权值不断迭代调整模型参数,使得模型能够更好地拟合数据,并达到良好的分类效果。

2 多层感知机与BP网络

由前文所示,线性回归的局限性也显而易见,它只能处理线性关系,对于非线性问题往往束手无策。这时,BP神经网络的出现为我们提供了一种新的解决方案。

2.1多层感知机

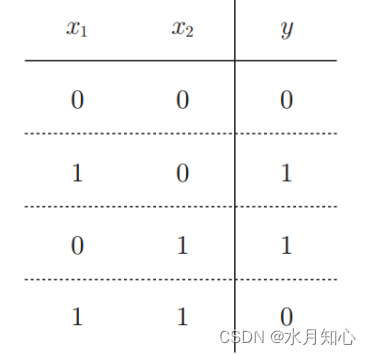

首先讨论一下线性不可分(XOR)问题。

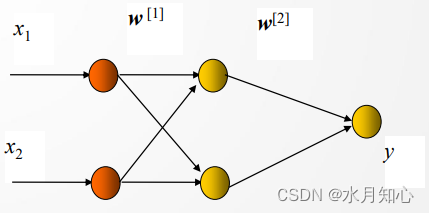

解决方法是使用多层感知机。在输入和输出层间加一或多层隐单元,构成多层感知器(多层前馈神经网络);加一层隐节点(单元)为三层网络,可解决异或(XOR)问题 由输入得到两个隐节点、一个输出层节点的输出。

多层感知器网络定理:

1.若隐层节点(单元)可任意设置,用三层阈值节点的网络,可以实现任意的二值逻辑函数。

2.若隐层节点(单元)可任意设置,用三层S型非线性特

性节点的网络,可以一致逼近紧集上的连续函数或按范数逼近紧集上的平方可积函数。

2.2 BP网络

多层前馈网络的反向传播(BP)学习算法,简称BP算法,是有导师的学习,它是梯度下降法在多层前馈网中的应用。

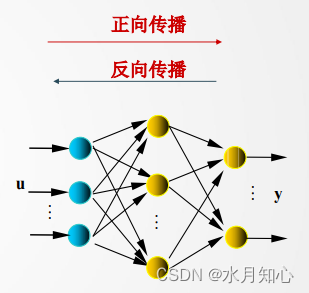

BP神经网络的基本结构和工作原理如图所示。

它由输入层、一个或多个隐藏层(图中为单隐层)以及输出层组成,前层至后层节点通过权连接,通过逐层传递和反向传播误差的方式,不断调整网络中的权重和偏置,以最小化输出误差。BP学习算法由正向传播和反向传播组成:

① 正向传播是输入信号从输入层经隐层,传向输出层,若输出层得到了期望的输出,则学习算法结束;否则,转至反向传播。

② 反向传播是将误差(样本输出与网络输出之差)按原联接通路反向计算,由梯度下降法调整各层节点的权值和阈值,使误差减小。

3 性能优化

(1)训练中常用技巧包括样本选择、权重衰减、暂退等。

(2)动量法可有效改善收敛速度,以及避免一些陷入局部极小值。

(3)AdaGrad及Adam等算法可自适应调节学习速率,加速收敛。

630

630

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?