本讲大纲:

1.VC维(VC dimension)

2.模型选择(model selection)

—交叉验证(cross validation)

—特征选择(feature selection)

1.VC维

给定猜想类

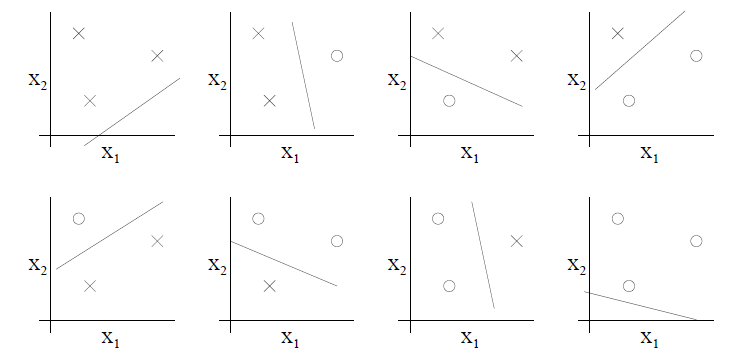

例如,考虑下面几个的三个点:

在二维中线性分类器能够把它们分开吗(

但是,这个猜想不能分开四个点的集合,因此VC(H)=3.

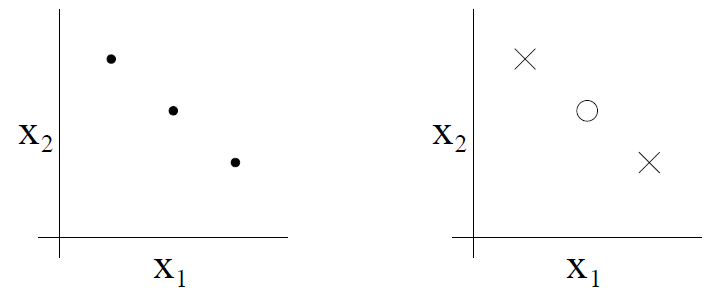

注意,即使可能有大小为3的集合不能被分开,VC维依然为3. 例如,三个点在同一条线上时(左图),那么没有办法找到线性分隔器(右图).

本文探讨了机器学习中的VC维概念,解释了如何确定VC维以及其在一致收敛性上的作用。此外,还详细介绍了模型选择,特别是交叉验证的方法,如保留交叉验证、k-fold交叉验证和留一交叉验证,以及特征选择的重要性,提到了向前搜索和向后搜索等策略。

本文探讨了机器学习中的VC维概念,解释了如何确定VC维以及其在一致收敛性上的作用。此外,还详细介绍了模型选择,特别是交叉验证的方法,如保留交叉验证、k-fold交叉验证和留一交叉验证,以及特征选择的重要性,提到了向前搜索和向后搜索等策略。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4009

4009

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?