本讲大纲:

1.最优间隔分类器(optimal margin classifier)

2.原始/对偶优化问题(KKT)(primal/dual optimization problem)

3.SVM对偶(SVM dual)

4.核方法(kernels)(简要,下一讲详细)

1.最优间隔分类器

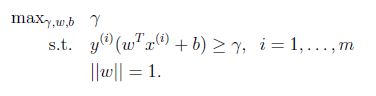

假设给我们的数据集是线性可分的(linearly separable). 就是说用超平面可以分隔正负样本. 我们要找到最大的几何间隔. 我们可以转化为下面的优化问题:

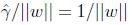

由于||W|| = 1,这保证了函数间隔等于几何间隔,只要解决了上面的优化问题我们就解决了这个问题,但是||W||是一个不好的(非凸性)的限制,这不是我们能够直接用软件解决的优化问题. 因此转化为更好的一个问题:

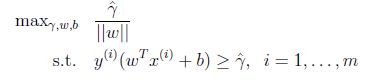

我们最大化

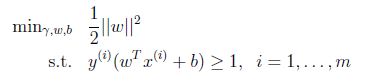

前面有讨论过对w和b加上任意比例的限制不会改变什么. 因此,加上规模的限制,对训练集的函数间隔设置为1:

因此

上面的优化问题变为一个凸二次目标函数(convex quadratic objective). 这给我们一个最优间隔分类器的解决方案. 这个优化问题可以用商用的二次编程代码解决.

2.原始/对偶优化问题

2.1 拉格朗日二元性(Lagrange duality)

考虑下面

本文介绍了最优间隔分类器的概念,重点探讨了SVM的原始优化问题和对偶优化问题,包括KKT条件。通过拉格朗日乘数法,将原始问题转换为对偶问题,揭示了支持向量在SVM中的关键作用。最后,简要提及了在高维空间中核方法的应用。

本文介绍了最优间隔分类器的概念,重点探讨了SVM的原始优化问题和对偶优化问题,包括KKT条件。通过拉格朗日乘数法,将原始问题转换为对偶问题,揭示了支持向量在SVM中的关键作用。最后,简要提及了在高维空间中核方法的应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9352

9352

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?