前言

在自然语言处理(NLP)领域,Transformers 模型已经成为了主流技术之一。无论是文本分类、情感分析,还是机器翻译,Transformers 都展现了强大的性能。今天,我们来详细解析一下 Transformers Pipelines 的运行原理,帮助大家更好地理解其内部机制。

一、基本流程

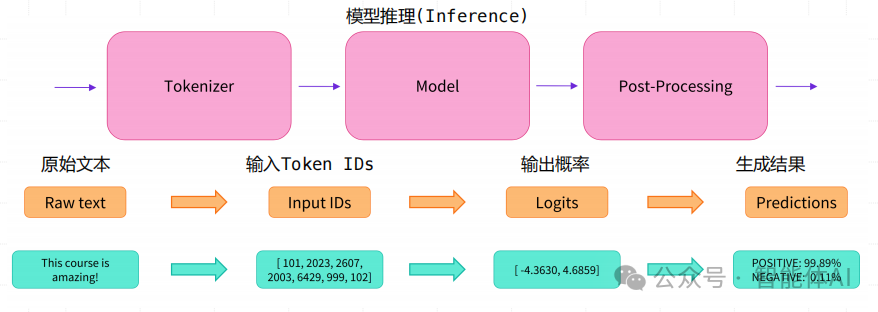

Transformers Pipeline 的运行流程主要分为四个阶段:Tokenization、Model Inference、Post-Processing 和 Prediction。下面我们详细讲解每一个阶段的具体作用,并通过代码示例进行演示。

1. Tokenization(分词)

原始文本(Raw Text)首先会经过Tokenizer进行处理。Tokenizer的任务是将输入的自然语言文本转换为模型能够理解的输入格式。这一过程包括:

-

分词: 将句子拆分成一个个单词或子词。

-

映射到ID:将这些单词或子词映射到预定义的词汇表中的唯一标识符(Token IDs)。

代码示例:

from transformers import BertTokenizer

# 初始化BERT的Tokenizer

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

# 输入句子

sentence = "This course is amazing!"

# 使用Tokenizer进行分词和映射到Token IDs

input_ids = tokenizer.encode(sentence, add_special_tokens=True)

print(f"Token IDs: {input_ids}")

在这个示例中,我们使用BERT的Tokenizer对句子进行处理,得到的Token IDs如下:

Token IDs: [101, 2023, 2607, 2003, 6429, 999, 102]

2. Model Inference(模型推理)

接下来,Token IDs 会被输入到预训练的Transformers模型中。这一阶段的主要任务是通过模型的多层神经网络结构,计算出每个Token的特征表示。模型的输出通常是Logits,即每个类别的未归一化的概率值。

代码示例:

import torch

from transformers import BertModel

# 初始化BERT模型

model = BertModel.from_pretrained('bert-base-uncased')

# 将Token IDs转化为Tensor

input_ids = torch.tensor([input_ids])

# 模型推理,得到输出

with torch.no_grad():

outputs = model(input_ids)

# 获取最后一层的隐状态

last_hidden_states = outputs.last_hidden_state

print(f"Last Hidden States: {last_hidden_states}")

在这个示例中,我们将Token IDs输入到BERT模型中,得到最后一层的隐状态(即Logits)。

3. Post-Processing(后处理)

在得到Logits之后,需要对其进行后处理。在大多数情况下,后处理过程包括将Logits转化为实际的概率值(通过Softmax函数),并根据具体任务进行进一步的处理。

代码示例:

from torch.nn.functional import softmax

# 假设模型的输出是logits

logits = torch.tensor([-4.3630, 4.6859])

# 对logits进行Softmax处理

probabilities = softmax(logits, dim=-1)

print(f"Probabilities: {probabilities}")

在这个示例中,我们对Logits进行Softmax处理,得到每个类别的概率值。

4. Prediction(生成结果)

最后一步是生成最终的预测结果。根据后处理得到的概率值,选择概率最高的类别作为最终的预测结果。例如,对于情感分析任务,可能会输出正面和负面情感的概率值:

-

POSITIVE: 99.89%

-

NEGATIVE: 0.11%

代码示例:

from torch.nn.functional import softmax

# 假设模型的输出是logits

logits = torch.tensor([-4.3630, 4.6859])

# 对logits进行Softmax处理

probabilities = softmax(logits, dim=-1)

print(f"Probabilities: {probabilities}")

在这个示例中,我们根据概率值选择了概率最高的类别作为最终的预测结果。

二、具体示例

让我们通过一个具体的例子来更好地理解这个过程:

-

输入句子:“This course is amazing!”

-

经过Tokenizer处理,得到Token IDs [101, 2023, 2607, 2003, 6429, 999, 102]。

-

将Token IDs输入模型,得到Logits [-4.3630, 4.6859]。

-

通过后处理,将Logits转化为概率值。

-

最终预测结果:POSITIVE 99.89%,NEGATIVE 0.11%。

完整代码示例:

from transformers import BertTokenizer, BertForSequenceClassification

import torch

from torch.nn.functional import softmax

# 初始化BERT的Tokenizer和模型

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertForSequenceClassification.from_pretrained('bert-base-uncased', num_labels=2)

# 输入句子

sentence = "This course is amazing!"

# 分词和映射到Token IDs

input_ids = tokenizer.encode(sentence, add_special_tokens=True)

input_ids = torch.tensor([input_ids])

# 模型推理,得到logits

with torch.no_grad():

outputs = model(input_ids)

logits = outputs.logits

# 对logits进行Softmax处理

probabilities = softmax(logits, dim=-1)

# 定义类别

labels = ["NEGATIVE", "POSITIVE"]

# 获取概率最高的类别

predicted_label = labels[torch.argmax(probabilities)]

print(f"Prediction: {predicted_label}")

在这个完整的代码示例中,我们一步步地完成了从原始文本到最终预测结果的整个过程。

三、总结

通过以上详细解析和代码示例,我们可以看出Transformers Pipelines的运行过程是高度模块化的,每个阶段都承担着特定的任务。理解这些过程不仅能帮助我们更好地使用这些模型,还能为我们在实际应用中优化模型提供指导。

最后的最后

感谢你们的阅读和喜欢,我收藏了很多技术干货,可以共享给喜欢我文章的朋友们,如果你肯花时间沉下心去学习,它们一定能帮到你。

因为这个行业不同于其他行业,知识体系实在是过于庞大,知识更新也非常快。作为一个普通人,无法全部学完,所以我们在提升技术的时候,首先需要明确一个目标,然后制定好完整的计划,同时找到好的学习方法,这样才能更快的提升自己。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

7万+

7万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?