文章目录

显著性 Visual Saliency Analysis

- 自底而上的注意力机制,能否"注意到" 红外小目标:

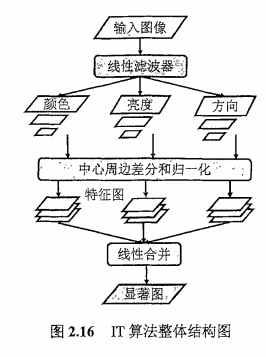

- Itti模型:颜色、亮度和方向 三种特征

- 自顶而下的注意力机制,任务驱动

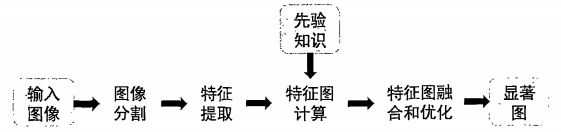

- 自底向上阶段是在无意识的情况下仅根据场景中目标本身的特性,如颜色、亮度、位置等快速定位感兴趣目标

- 而自顶向下阶段是在特定任务以及经验知识的指导下,注意到所需要的

目标 - 自底向上的显著性检测是一种快速的、无意识的、纯粹由图像数据驱动的方法,通过分析图像内容来检测显著性。

- 自顶向下的显著性检测是慢速的、有意识的、由特定任务驱动的方法,需要高层先验知识的引导。

图像显著性检测

基本原理

视觉注意力机制1

- 对比度原理:局部对比度 + 全局对比度

- 中心效应原理:中心-周边(Center-Surround)原理

- 人类视觉系统在观察一个场景的时候,一般只关心其中的某一个或多个中心区域,对于中心区域之外的其他区域关注程度会逐渐减弱

- 这个中心区域不一定是图像的中心位置,可以是引起人类视觉注意的目标区域

- 显著性检测是应该使图像的中心位置或者靠近中心的位置具有较高的显著值,而远离中心区域的位置应该得到抑制

- 多通道并行原理

- 视觉系统中具有不同的细胞来处理各种通道的信息, 各个通道是相互

独立的 - 通过不同的特征通道分别提取并处理这些特征来实现对人类视觉系统的模型, 在这个阶段提取得到的特征被称为早期视觉特征,然后根据不同的显著性计算方法并行处理这些特征之后再融合,这样可以更好地模拟人眼对场景进行选择的过程

- 视觉系统中具有不同的细胞来处理各种通道的信息, 各个通道是相互

- 格式塔原理

- 双色对立原理

- 高频抑制原理

基本流程?1

- 特征提取

- 传统手工特征:颜色特征(RGB,YCrCb,HSV等),纹理特征(LBP,灰度共生矩阵等)方向特征(Gabor滤波,HOG等)

- 上述均为稠密特征,稀疏局部特征不适合目标检测分割而更加适用于场景分类和图片检索等

- 深度特征

- 传统手工特征:颜色特征(RGB,YCrCb,HSV等),纹理特征(LBP,灰度共生矩阵等)方向特征(Gabor滤波,HOG等)

- 特征计算(计算的是显著图所需的特征):

- Uniqueness(唯一性特征),假设(如果一个图像区域突出于其他区域,则该区域更容易吸引人的注意力,其显著值也因此应该标记为更大)

- 设计等方面有不同的考虑。以算法2为例,给定超像素

i

i

i 的特征

f

i

f_{i}

fi 及其位置

p

i

,

p_{i},

pi, 则 Uniqueness 的定义为(一般w采用高斯窗作为加权)

U i = ∑ j = 1 N ∥ f i − f j ∥ 2 ⋅ w ( p i , p j ) U_{i}=\sum_{j=1}^{N}\left\|f_{i}-f_{j}\right\|^{2} \cdot w\left(p_{i}, p_{j}\right) Ui=j=1∑N∥fi−fj∥2⋅w(pi,pj)

- 设计等方面有不同的考虑。以算法2为例,给定超像素

i

i

i 的特征

f

i

f_{i}

fi 及其位置

p

i

,

p_{i},

pi, 则 Uniqueness 的定义为(一般w采用高斯窗作为加权)

- Distribution(分布性特征),假设(特征在空间变化越低/空间分布范围小,意味着对应物体的空间分布越紧凑,其显著性也应该越高。)

- 同样以算法 2 为例,定义超像素

i

i

i 的 Distribution 为其特征在空间上的变化

D

i

:

D_{i}:

Di:

D i = ∑ j = 1 N ∥ p j − μ i ∥ 2 ⋅ w ( f i , f j ) D_{i}=\sum_{j=1}^{N}\left\|p_{j}-\mu_{i}\right\|^{2} \cdot w\left(f_{i}, f_{j}\right) Di=j=1∑N∥pj−μi∥2⋅w(fi,fj)

其中 p i p_{i} pi 是超像素 i i i 的位置。通常情况下,图像中各超像素的特征不会完全一致, 为了真实反映特征的空间分布情况,必须考虑相近特征的影响, 即用 w ( f i , f j ) w\left(f_{i}, f_{j}\right) w(fi,fj) 来描述超像素 i i i 和 j j j 的特征 f i 、 f j f_{i} 、 f_{j} fi、fj 的相似性,其定义为:

w ( f i , f j ) = 1 Z i exp ( − 1 2 σ f 2 ∥ f i − f j ∥ 2 ) w\left(f_{i}, f_{j}\right)=\frac{1}{Z_{i}} \exp \left(-\frac{1}{2 \sigma_{f}^{2}}\left\|f_{i}-f_{j}\right\|^{2}\right) w(fi,fj)=Zi1exp(−2σf21∥fi−fj∥2)

μ i \mu_{i} μi 是特征 f i f_{i} fi 的加权平均位置:

μ i = ∑ j = 1 N w ( f i , f j ) p j \mu_{i}=\sum_{j=1}^{N} w\left(f_{i}, f_{j}\right) p_{j} μi=j=1∑Nw(fi,fj)pj

- 同样以算法 2 为例,定义超像素

i

i

i 的 Distribution 为其特征在空间上的变化

D

i

:

D_{i}:

Di:

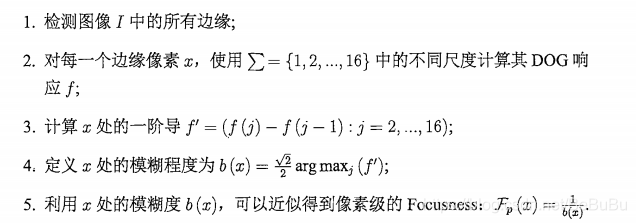

- Focusness(聚焦性特征),(对焦先验『48],即图像中人们感兴趣的物体通常位于焦点处,因此可以用区域聚焦程度来衡量其显著性。聚焦程度通常与模糊程度呈负相关,即区域边缘越模糊,越不可能位于焦点处。

- Objectness(物体性特征),(Objectness度量了一个窗口或区域属于完整物体的可能性大小,可以用于区域显著性估计),(假设 ① 在图像空间中有良好定义的闭合边界;② 外表特征与周围区域明显不同 ③ 有时是独一无二的,并显著地突出在整个图像中)

- Alexe等3提出五种窗口特征来估计窗口的Objectness:多尺度显著性(Multiscale Saliency,MS)、颜色对比度(Color Contrast.cc)、边缘密度(Edge Density,ED)、超像素跨度(Superpixels Straddling,ss)、位置和大小(Location and Size,LS)

- 再整合所有特征,利用分类器得到 objectness图

- Backgroundness(边界性特征)… …

- Uniqueness(唯一性特征),假设(如果一个图像区域突出于其他区域,则该区域更容易吸引人的注意力,其显著值也因此应该标记为更大)

- 特征融合:非线性融合(用sigmoid函数处理后做加权) 线性融合(加权和),文章1 里面没有研究如 字典学习稀疏表示这方面的内容

- 显著图检测

- 图像分割:

- 阈值分割

- 形态学分割:分水岭算法,漫水法等

- 基于图的分割,GraphCut,GrabCut等

- 超像素分割:SLIC等

经典自底向上的显著图计算算法 1

- IT算法4

- FT算法5,基于频域分析的显著性区域检测方法。

- MZ算法6,基于局部对比度分析来检测显著性,并利用模糊

增长(fuzzy growing)来模拟人类的感知功能 - RC算法7,基于全局对比度的显著性检测方法。

- DRFI算法8,显著图计算问题视为回归问题,利用有监督学习的方法将

区域特征映射为显著值,(1)图像多层分割;(2)区域显著值计算;(3)多层显著性融合。 - MR算法9,基于图模型流形排序来估计区域显著值

- MDF算法10,基于深度卷积神经网络(Convolutional Neural Network,CNN)的显著性检测方法,

- wCtr 算法11,基于边界先验,利用区域与图像边界的连接性来检测显著性,并构造优化模型提高显著图的质量

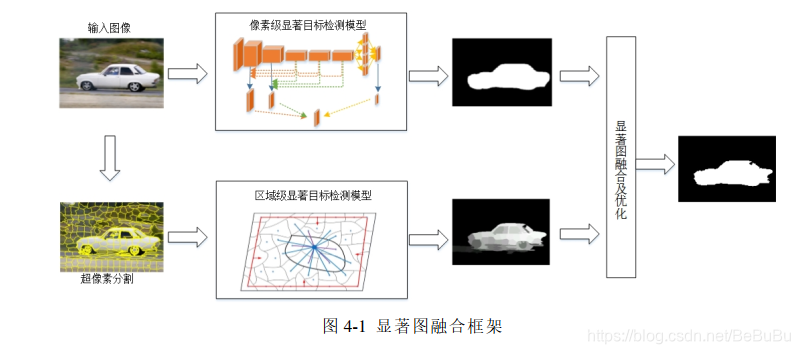

全卷积网络 + 超像素分割 结合的显著图计算方法12

- 上面一个分支是全卷积网络,得到像素级的显著性图(或者叫分割后的图)

- 下面的一个分支是超像素分割得到的显著性图

Perazzi F, Krähenbühl P, Pritch Y, et al. Saliency filters: Contrast based filtering for salient region detection[C]//2012 IEEE conference on computer vision and pattern recognition. IEEE, 2012: 733-740. ↩︎ ↩︎

Alexe B, Deselaers T, Ferrari V. Measuring the objectness of image windows[J]. IEEE transactions on pattern analysis and machine intelligence, 2012, 34(11): 2189-2202. ↩︎

Itti L, Koch C, Niebur E. A model of saliency-based visual attention for rapid scene analysis[J]. IEEE Transactions on pattern analysis and machine intelligence, 1998, 20(11): 1254-1259. ↩︎

Achanta R, Hemami S, Estrada F, et al. Frequency-tuned salient region detection[C]//2009 IEEE conference on computer vision and pattern recognition. IEEE, 2009: 1597-1604. ↩︎

Ma Y F, Zhang H J. Contrast-based image attention analysis by using fuzzy growing[C]//Proceedings of the eleventh ACM international conference on Multimedia. 2003: 374-381. ↩︎

Cheng M M, Mitra N J, Huang X, et al. Global contrast based salient region detection[J]. IEEE transactions on pattern analysis and machine intelligence, 2014, 37(3): 569-582. ↩︎

Jiang H, Wang J, Yuan Z, et al. Salient object detection: A discriminative regional feature integration approach[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2013: 2083-2090. ↩︎

Yang C, Zhang L, Lu H, et al. Saliency detection via graph-based manifold ranking[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2013: 3166-3173. ↩︎

Li G, Yu Y. Visual saliency based on multiscale deep features[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2015: 5455-5463. ↩︎

Zhu W, Liang S, Wei Y, et al. Saliency optimization from robust background detection[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2014: 2814-2821. ↩︎

复杂场景下的视觉显著目标检测方法研究 ↩︎

20万+

20万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?