优势

批量爬取数据

高效率

架构图

各模块的功能

1,Scrapy Engine(引擎):Scrapy框架的核心部分。负责在Spider和ItemPipeline、Downloader、Scheduler中间通信、传递数据等。

2,Spider(爬虫):发送需要爬取的链接给引擎,最后引擎把其他模块请求回来的数据再发送给爬虫,爬虫就去解析想要的数据。这个部分由我们自己写,因为我们爬取的对象是我们自己决定的

3,Scheduler(调度器):负责接收引擎发送过来的请求,并按照一定的方式进行排列和整理,负责调度请求的顺序等。

4,Downloader(下载器):负责接收引擎传送过来的下载请求,然后去网络上下载对应的数据再交还给引擎。

5,Item Pipeline(管道):负责将Spider(爬虫)传递过来的数据进行保存。

6,Downloader Middlewares(下载中间件):可以扩展下载器和引擎之间通信功能的中间件。

Spider Middlewares(Spider中间件):可以扩展引擎和爬虫之间通信功能的中间件。

项目创建

进入cmd,进入到你想创建的目录,然后输入以下命令

scrapy startproject [项目名称]

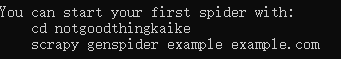

然后得到以下语句,表示创建成功

项目文件介绍

1,items.py:用来存放爬虫爬取下来数据的模型。

2,middlewares.py:用来存放各种中间件的文件。

3,pipelines.py:用来将items的模型存储到本地磁盘中。

4,settings.py:本爬虫的一些配置信息(比如请求头、多久发送一次请求、ip代理池等)。

5,scrapy.cfg:项目的配置文件。

6,spiders包:以后所有的爬虫,都是存放到这个里面。

使用命令创建一个爬虫

scrapy genspider qsbk "qiushibaike.com"

创建了一个名字叫做qsbk的爬虫,并且能爬取的网页只会限制在qiushibaike.com这个域名下。

注意,要进去项目文件夹里才能写这个命令

爬虫文件启动命令

scrapy crawl 爬虫文件名

环境进入命令

workon crawler-env

954

954

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?