“ 高性能大模型的打造,是一项复杂的系统性工程 ”

在上一篇文章中讲了学习大模型的基础路线,而如果是对有一定基础的人来说,应该怎么进阶呢?也就是说大模型更加高级的技术栈有哪些?

一个好的基础能够让你在学习的道路上事半功倍,但绝对不是学习的终点,大模型技术也不外如是。

大模型的进阶学习路线

在上一篇的文章中介绍了大模型的基础学习路线,比如基础理论,编程,深度学习框架等等。

以上技术都属于大模型技术的基础,不论是做学术研究,还是个人学习都已经足够;但是一项技术并不仅仅用来学习的,还需要能够在企业生产中应用,而在生产环境中对稳定性的要求要远高于对技术的追求。

那么怎么才能打造一款能够在企业生产中使用的大模型呢?而这就属于大模型技术的进阶;如果说大模型的基础是能够做出来一个大模型,那么大模型的进阶就是怎么把大模型做的更好。

下面也将从几个方面介绍一下大模型的进阶:

-

模型优化

-

硬件加速

-

分布式并行计算

模型优化

我们知道大模型目前最大的瓶颈就是算力问题,而算力就代表着成本,大模型技术面临着高昂的成本问题。这也间接导致了很多小微企业对大模型望而却步,原因就是无法承担大模型巨大的资金成本和技术成本。

因此,就有很多模型优化的技术,比如说迁移学习,模型剪枝,模型蒸馏等;目的就是用最小的成本,快速的打造出一款能用的,好用的大模型。

模型剪枝:模型剪枝通过删除冗余神经元和连接,减少模型的大小而不牺牲性能。

模型量化:模型量化通过降低精度,如从float32转化为int8,降低模型的计算量和存储需求。

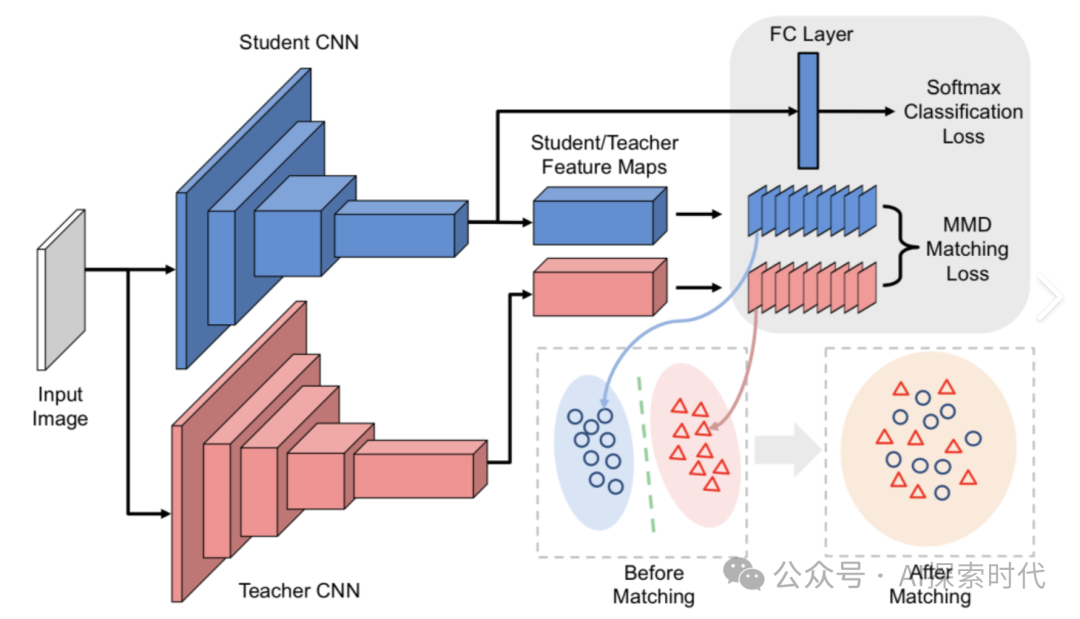

知识蒸馏:知识蒸馏则是将大模型的知识转移到小模型,保持小模型的准确性。

通过以上方法,能够大大提高模型部署效率和资源利用率,降低企业成本。

硬件加速

关于硬件加速每个了解大模型的人应该都知道一些,最简单也是最知名的方式就是增加GPU的数量;而英伟达市值的飙升,以是因为其强大的算力芯片。

那么硬件加速具体是什么情况呢?

其实加速有多种方式,成本最低的就是优化模型架构,使用更加高效的算法,这些叫做软件加速。但以目前的技术来说,软件加速的能力有限,因此唯一的办法就是堆量,通过大量的计算硬件资源的堆积来解决算力不足的问题。

大模型常见的硬件加速除了GPU之外,还有FPGA和ASIC等。

CPU,GPU,FPGA,ASIC是目前AI计算过程中最主流的四种芯片类型,CPU这玩意不用多说,任何电子产品都离不开它的存在;但CPU这玩意功能强大,但并不是很适合AI处理。

原因就是CPU就是一个大学生,它能够处理复杂的数学问题;但AI算力更多的需求并不是处理复杂的逻辑问题,而是计算一大段100以内的加减法,大学生再厉害它的时间和精力也是有限的,远不如找几百个小学生每人算一题来的快。

因此,GPU这玩意就是大力出奇迹的典型代表,我不需要多么高深的知识储备,只需要简单的1加1等于2就行了。

而FPGA是指现场可编程门阵列,它是一个可以现场编程的,并按照预定设计意图来工作的集成电路。FPGA最厉害的地方是可以通过配置的方式来实现任意需要的功能组合,并且可以以大规模并行的方式实施算法,这意味着我们可以非常迅速和高效的执行大数据处理。

ASIC——特定应用集成电路,它是用来专门针对某一领域设计的芯片,比如神经网络计算芯片——NPU,Tensor计算芯片TPU等。因为针对特定领域,所以ASIC往往可以表现出比GPU和CPU更强的性能。

分布式并行计算

大模型由于其强大的算力需求,在单台机器上已经很难完成大模型的训练和微调,因此采用分布式并行计算是一个无法避免的选择。

所谓的并行计算,就是把大模型根据模块或功能拆分,然后部署到多台机器上进行计算。其难点是模块的拆分,以及不同机器上的数据协调和整合。

在传统的分布式系统中,比如web开发是根据功能模块进程拆分,不同服务之间通过API的方式进行交互,而且不同服务之间没有强关联性。

但大模型不同,大模型是一个整体它的任何环节出问题都会导致模型的失效,因此大模型只能采用并行计算的方式进行分布式部署。

而根据不同的并行方式,大模型并行计算又分为多种类型,如:

-

数据并行

-

张量并行

-

流水线并行

不同的并行方式有其独特的特点和实现方式,不同的模型根据实现方式不同也有其最适合的并行计算方式。但总体来说,并行计算是大模型训练和微调的基础,没有并行计算,大模型也很难存在。

打造一款能用好用且高性能的大模型并不是一件简单的事情,其中涉及到很多复杂的理论和难点,同时还要面临着巨大的技术和资金成本,因此打造大模型并不是人人都能参与的工作。

那么,如何系统的去学习大模型LLM?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

所有资料 ⚡️ ,朋友们如果有需要全套 《LLM大模型入门+进阶学习资源包》,扫码获取~

篇幅有限,部分资料如下:

👉LLM大模型学习指南+路线汇总👈

💥大模型入门要点,扫盲必看!

💥既然要系统的学习大模型,那么学习路线是必不可少的,这份路线能帮助你快速梳理知识,形成自己的体系。

路线图很大就不一一展示了 (文末领取)

👉大模型入门实战训练👈

💥光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉国内企业大模型落地应用案例👈

💥两本《中国大模型落地应用案例集》 收录了近两年151个优秀的大模型落地应用案例,这些案例覆盖了金融、医疗、教育、交通、制造等众多领域,无论是对于大模型技术的研究者,还是对于希望了解大模型技术在实际业务中如何应用的业内人士,都具有很高的参考价值。 (文末领取)

👉GitHub海量高星开源项目👈

💥收集整理了海量的开源项目,地址、代码、文档等等全都下载共享给大家一起学习!

👉LLM大模型学习视频👈

💥观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。 (文末领取)

👉640份大模型行业报告(持续更新)👈

💥包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

👉获取方式:

这份完整版的大模型 LLM 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

😝有需要的小伙伴,可以Vx扫描下方二维码免费领取🆓

689

689

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?