文章目录

参考文章:https://zhuanlan.zhihu.com/p/26012348

监督学习是机器学习中发展最为成熟的分支,不仅由于监督学习框架下有各种学习模型,更因为监督学习框架有着坚实的理论支撑。这套理论包括VC理论、PAC理论和PAC-Bayes理论,它们以概率的方式回答了哪些问题可以学习以及学习成功的概率多大的问题。

下边从几个视角来对监督学习模型进行分类。

1. 判别模型VS生成模型

假设一组数据X和标签Y。

两的本质区别在于训练的目标函数不同。

1.1 判别模型

判别模型的目标函数是对

Y

Y

Y建模,直接划定一个判别边界,没一个新的数据直接根据判别边界判断他属于哪一类。

比如,

- 非概率模型只有假设函数 H H H的训练,只可能是判别模型;

- 概率模型,直接对 P ( Y / X ) P(Y/X) P(Y/X)进行建模,则是判别模型。

感知机、逻辑斯特回归、支持向量机、神经网络、k近邻都属于判别学习模型。

1.2 生成模型

生成模型的目标函数是训练数据X和Y的一个概率分布 P ( X , Y ) P(X,Y) P(X,Y),每来一个 X X X都通过 P ( X , Y ) P(X,Y) P(X,Y)来推导 P ( Y / X ) P(Y/X) P(Y/X)求得分类结果。

高斯判别分析、朴素贝叶斯属于生成学习模型。

2. 概率模型VS非概率模型

两者的本质区别在于是否涉及到概率分布。

2.1 概率模型

凡是涉及到求解 P ( X , Y ) P(X,Y) P(X,Y)或者 P ( Y / X ) P(Y/X) P(Y/X),都是概率模型。

感知机、支持向量机、神经网络、k近邻都属于非概率模型。

2.2 非概率模型

凡是只涉及到假设空间H的,都是非概率模型。

对应到判别模型中,已经说过非概率模型都是判别模型。

逻辑斯特回归、高斯判别分析、朴素贝叶斯都属于概率模型。

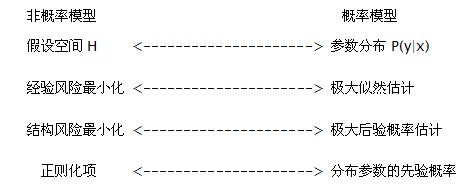

2.3 两者对应关系图

3. 参数模型VS非参数模型

我们知道任何模型都有参数,这里必须注意,所谓参数模型的参数是假设的数据分布的参数,而不包括模型超参。

因此,二者的本质区别,是否有对数据分布的假设。

3.1 参数模型

当我们具备一些先验知识,对学习目标有了一定的假设不论是 f ( x ) f(x) f(x)还是 P ( Y / X ) P(Y/X) P(Y/X)。此时,对模型的求解就变成了对模型的参数估计。此为参数模型的要义。

参数模型的特点,如果对模型假设正确,则很少的训练数据即可得到很好的模型。但是,如果假设错误,尽管数据量足够大,所得模型依然会存在较大的系统偏差。

感知机、逻辑斯特回归、高斯判别分析、朴素贝叶斯、线性支持向量机都属于参数模型。

3.2 非参数模型

相对而言,非参数模型即对数据的分布没有任何假设。只关注样本数据,并不关心其整体分布。

非参数模型的特点,由于没有任何假设,所以也不存在假设错误的问题。理论上数据量足够大,一定能逼近真实模型。

决策树模型,K近邻就是典型的非参数模型。

时下流行的深度学习,其本质是一个半参数模型的神经网络。通过加大网络的深度(加大隐层数目)以及宽度(增加每一层神经元的个数),使假设空间的复杂度得到极大的提高。复杂的假设空间有极强的表达能力,当训练数据量很大的时候,不会陷入过拟合。所以,深度学习的成功,从理论上讲,一方面来源于海量的训练数据,另一方面来源于其复杂的网络结构。

4112

4112

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?