作者 | 汽车人 编辑 | 自动驾驶Daily

点击下方卡片,关注“自动驾驶之心”公众号

ADAS巨卷干货,即可获取

点击进入→自动驾驶之心【3D目标检测】技术交流群

本文只做学术分享,如有侵权,联系删文

ClusterFusion:利用毫米波雷达空间特征进行自动驾驶车辆中的毫米波雷达-摄像头3D目标检测

原标题:ClusterFusion: Leveraging Radar Spatial Features for Radar-Camera 3D Object Detection in Autonomous Vehicles

论文链接:https://arxiv.org/pdf/2309.03734.pdf

作者单位:School of Electrical Engineering and Informatics, Institut Teknologi Bandung, Bandung 40132, Indonesia

期刊:IEEE Access

论文思路:

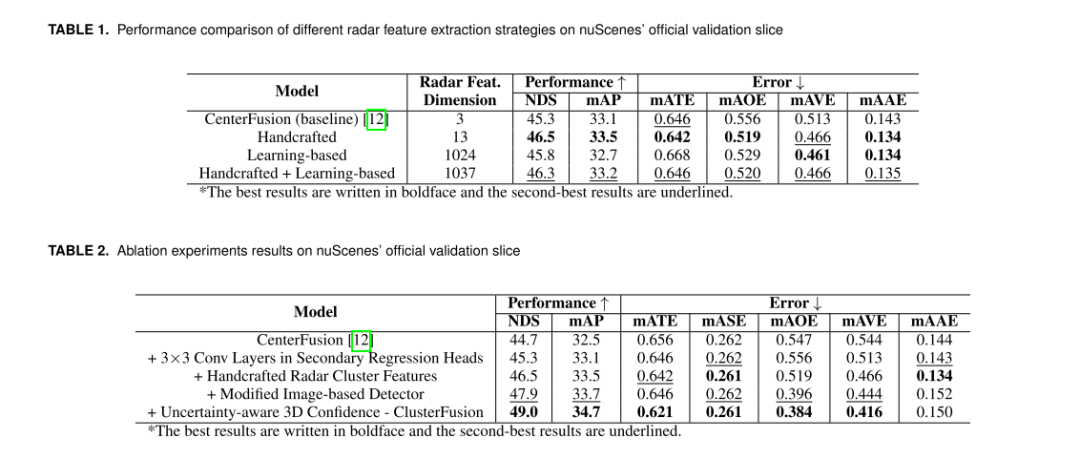

由于毫米波雷达和摄像机的互补性,基于深度学习的毫米波雷达-摄像机3D目标检测方法可以可靠地在低能见度条件下产生准确的检测。这使得它们更适合用在自动驾驶车辆的感知系统中,特别是当两个传感器的综合成本比激光雷达的成本更低的时候。最近的毫米波雷达-摄像机方法通常进行特征级融合,通常涉及到将毫米波雷达点投射到与图像特征相同的平面上,并融合从两种模态中提取的特征。在图像平面上进行融合一般比较简单和快速,但将毫米波雷达点投影到图像平面上会使点云的深度维数变平,这可能会导致信息损失,使得提取点云的空间特征更加困难。本文提出的ClusterFusion,这是一种利用毫米波雷达点云的局部空间特征的架构,它通过对点云进行聚类,并在将特征投影到图像平面之前直接对点云进行特征提取。ClusterFusion在nuScenes数据集的test slice上取得了所有毫米波雷达-单目摄像机方法中最先进的性能,nuScenes检测分数(NDS)为48.7%。本文还研究了不同毫米波雷达特征提取策略在点云集群上的性能:手工策略、基于学习的策略以及两者的结合,并发现手工策略的性能最好。本工作的主要目标是探索利用毫米波雷达的局部空间和点向特征,直接从毫米波雷达点云中提取,用于毫米波雷达-单目摄像机3D目标检测方法,在图像平面上进行跨模态特征融合。

主要贡献:

本文提出的了一种基于毫米波雷达-单目摄像机融合的3D目标检测方法ClusterFusion,该方法直接在毫米波雷达点云上进行特征提取,使其能够从clusters的空间和点向特征中获益。该算法在图像平面上进行跨模态特征融合,使融合过程更简单、更快。

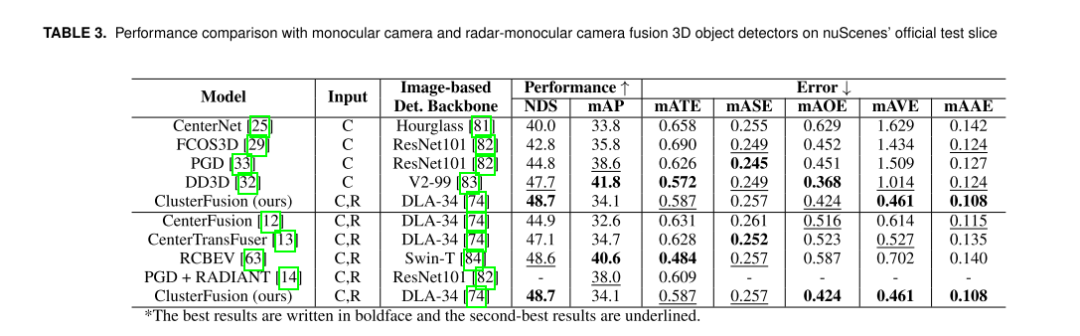

ClusterFusion的性能在nuScenes的test slice上得到了验证,在nuScenes的目标检测排行榜上,其NDS达到了所有毫米波雷达-单目摄像机方法中最高的48.7%。

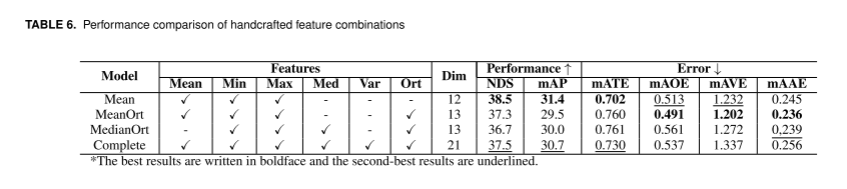

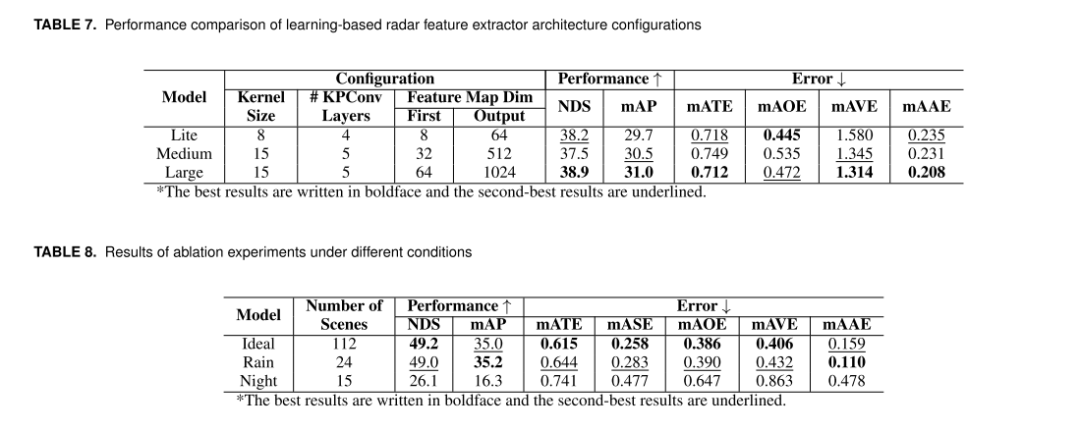

研究不同毫米波雷达特征提取策略在毫米波雷达点云团特征提取中的有效性。本文发现,提出的手工特征提取策略取得了最好的性能。

网络设计:

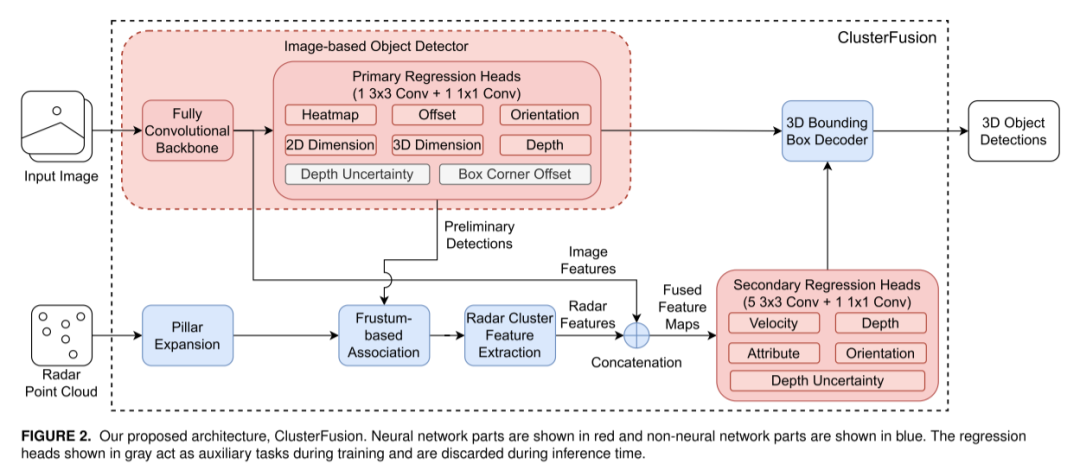

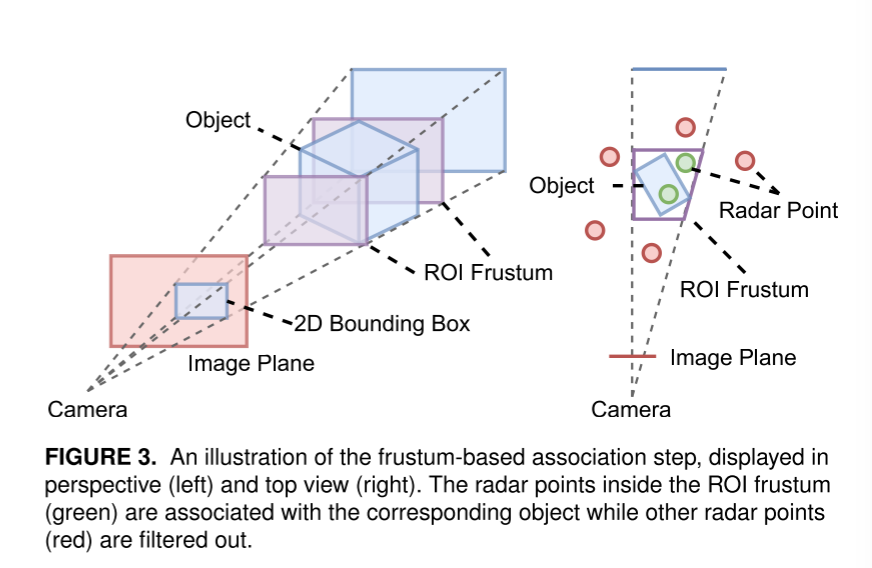

理想情况下,我们希望能够有效地提取毫米波雷达点云的局部空间特征,同时在图像平面上执行特征级融合。为此,本文推出了 ClusterFusion,这是一种毫米波雷达-单目摄像机 3D 目标检测架构,它受益于图像平面特征级融合的简单性,同时能够提取并受益于毫米波雷达点云的局部空间和逐点特征。ClusterFusion 首先使用基于图像的初步 3D 目标检测,通过受 CenterFusion [12] 启发的基于平截头体的关联机制来过滤和聚类毫米波雷达点云中的点,从而实现这一目标。然后,它直接从这些点云clusters中提取特征,而不执行任何投影,从而能够更有效地提取局部空间特征。只有在提取毫米波雷达clusters特征后,它们才会被投影到图像平面上并与图像特征融合。然后将融合的特征输入回归头以生成最终的 3D 目标检测。

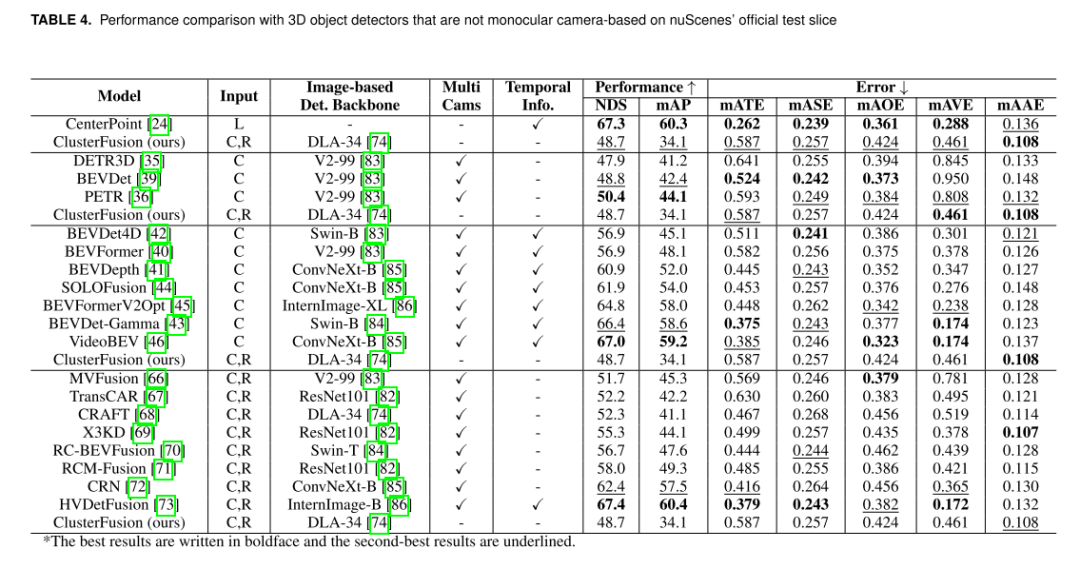

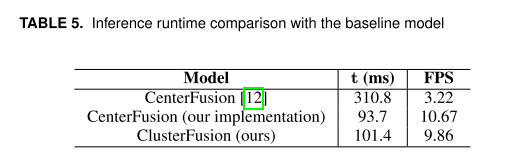

为了确保公平和严格的比较,本文对 ClusterFusion 的性能进行了两次基准测试:第一次针对其他基于毫米波雷达-单目摄像机融合的方法,第二次针对使用其他传感器设置的方法,包括基于多个摄像机的方法。使用多个摄像头的传感器设置可以解析深度并使用交叉视图信息,从而提高 3D 检测性能。能够解析深度是一个特别重要的帮助,因为单目方法的性能主要受到较差的深度估计的限制 [15]。在nuScenes [16]test slice上的所有毫米波雷达-单目摄像机方法中,ClusterFusion实现了最高的nuScenes检测分数(NDS)48.7%,lowest mean orientation(mAOE),velocity(mAVE)和attribute error(mAAE)分别为0.424,0.461和0.108,第二低的 mean translation(mATE)和scale error(mASE)分别为0.587和0.257。与使用其他传感器设置的方法相比,ClusterFusion 成功实现了具有竞争力的 mAAE。

图2。本文的提出的架构,ClusterFusion。神经网络部分用红色表示,非神经网络部分用蓝色表示。灰色显示的回归头在训练过程中充当辅助任务,在推理过程中被丢弃。

图3。frustum-based 关联步骤的说明,显示在透视图(左)和俯视图(右)中。ROI frustum内的毫米波雷达点(绿色)与对应的目标相关联,其他毫米波雷达点(红色)则被过滤掉。

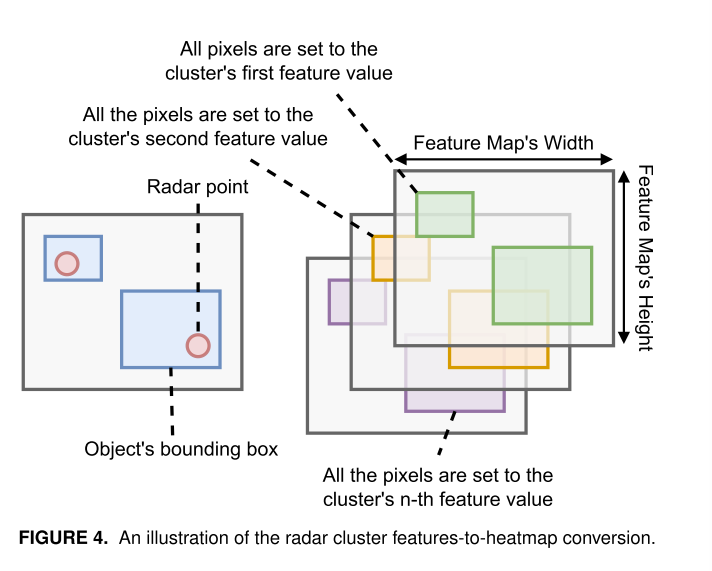

图4。毫米波雷达cluster 特征到热力图(features-to-heatmap)转换的图解。

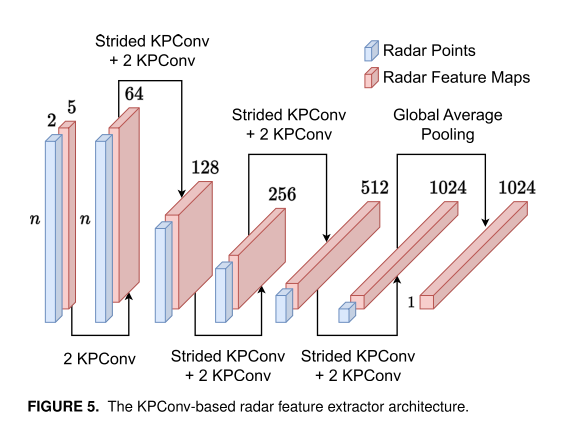

图 5. 基于 KPConv 的毫米波雷达特征提取器架构。

实验结果:

引用:

Kurniawan, I. T., & Trilaksono, B. R. (2023). ClusterFusion: Leveraging Radar Spatial Features for Radar-Camera 3D Object Detection in Autonomous Vehicles. ArXiv. /abs/2309.03734

① 全网独家视频课程

BEV感知、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、协同感知、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

视频官网:www.zdjszx.com

视频官网:www.zdjszx.com

② 国内首个自动驾驶学习社区

近2000人的交流社区,涉及30+自动驾驶技术栈学习路线,想要了解更多自动驾驶感知(2D检测、分割、2D/3D车道线、BEV感知、3D目标检测、Occupancy、多传感器融合、多传感器标定、目标跟踪、光流估计)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、AI模型部署落地实战、行业动态、岗位发布,欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频,期待交流!

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦目标检测、语义分割、全景分割、实例分割、关键点检测、车道线、目标跟踪、3D目标检测、BEV感知、多模态感知、Occupancy、多传感器融合、transformer、大模型、点云处理、端到端自动驾驶、SLAM、光流估计、深度估计、轨迹预测、高精地图、NeRF、规划控制、模型部署落地、自动驾驶仿真测试、产品经理、硬件配置、AI求职交流等方向。扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】平台矩阵,欢迎联系我们!

220

220

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?