作者 | Jinwei Lin 编辑 | 3D视觉之心

点击下方卡片,关注“自动驾驶之心”公众号

戳我-> 领取自动驾驶近15个方向学习路线

本文只做学术分享,如有侵权,联系删文

站在巨人的肩膀上

在2021年NeRF横空出世后,出现了各种与原始NeRF相关的研究工作。NeRF的最大优势在于它可以使用少量图像或单视图图像进行高分辨率3D场景合成。NeRF的出现建立了一个新的隐式3D重建研究领域,使得3D视图合成具有极高的分辨率,并且可以轻松利用少量图像或单视图图像进行复杂的3D场景重建。NeRF技术通过多层感知器(MLP)网络,将5D输入(3D位置和2D视图方向)映射到颜色和密度值,从而实现高质量的3D重建。

但这些研究工作的渲染结果都是静态的。

与静态图像相比,动态视频更能吸引观众的注意力、包含更多信息、应用领域也更广泛。同样,在3D重建或NeRF领域,动态NeRF可以表示更丰富的信息,应用领域比静态NeRF更广泛。所以,未来NeRF研究的趋势将更多地集中在动态NeRF上。

最新的综述[1]分析和讨论动态NeRF的发展和实现原理,帮助研究人员理解其研究方向和应用潜力。主要内容包括:

动态NeRF的发展历史,从2021年到2023年间的主要研究成果。

动态NeRF的实现方法及其关键技术。

对不同动态NeRF项目的详细比较和分析。

动态NeRF在实际应用中的潜在方向和未来研究趋势。

该综述本文引用了大量与动态NeRF相关的研究论文,其陈述和分析将集中在两个维度的评审:基于发展时间的横向分析和基于相同范围的纵向分析,其特点为:

采用了横纵向分析法

参考文献数量丰富,分析了与动态NeRF相关的大部分已发表论文

设计了很多原创图表

分析了当前动态NeRF的发展原理和技术,根据充足的相关材料分析和讨论了未来动态NeRF的潜在发展方向

从不同方向追踪动态NeRF研究领域的最新研究成果

(大拇指往上滑,点击最上方的卡片关注我,整个操作只会花你 1.328 秒,然后带走未来、所有、免费的干货,万一有内容对您有帮助呢~)

动态NeRF的历史

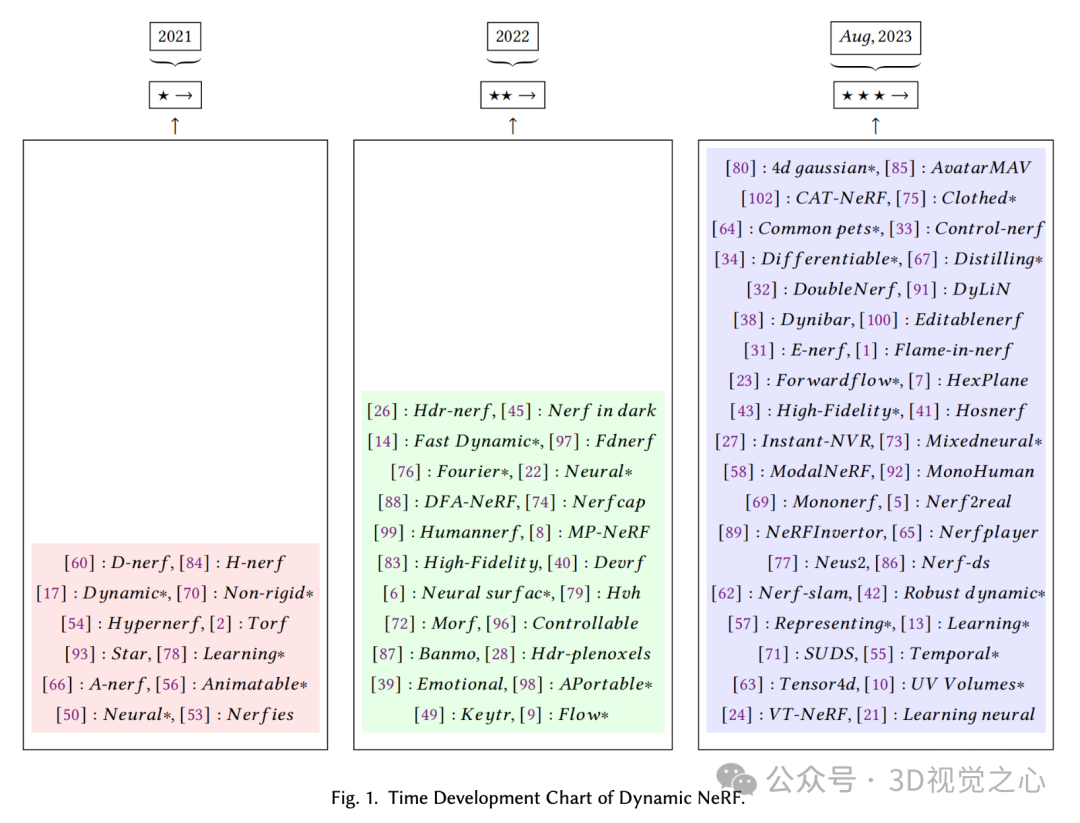

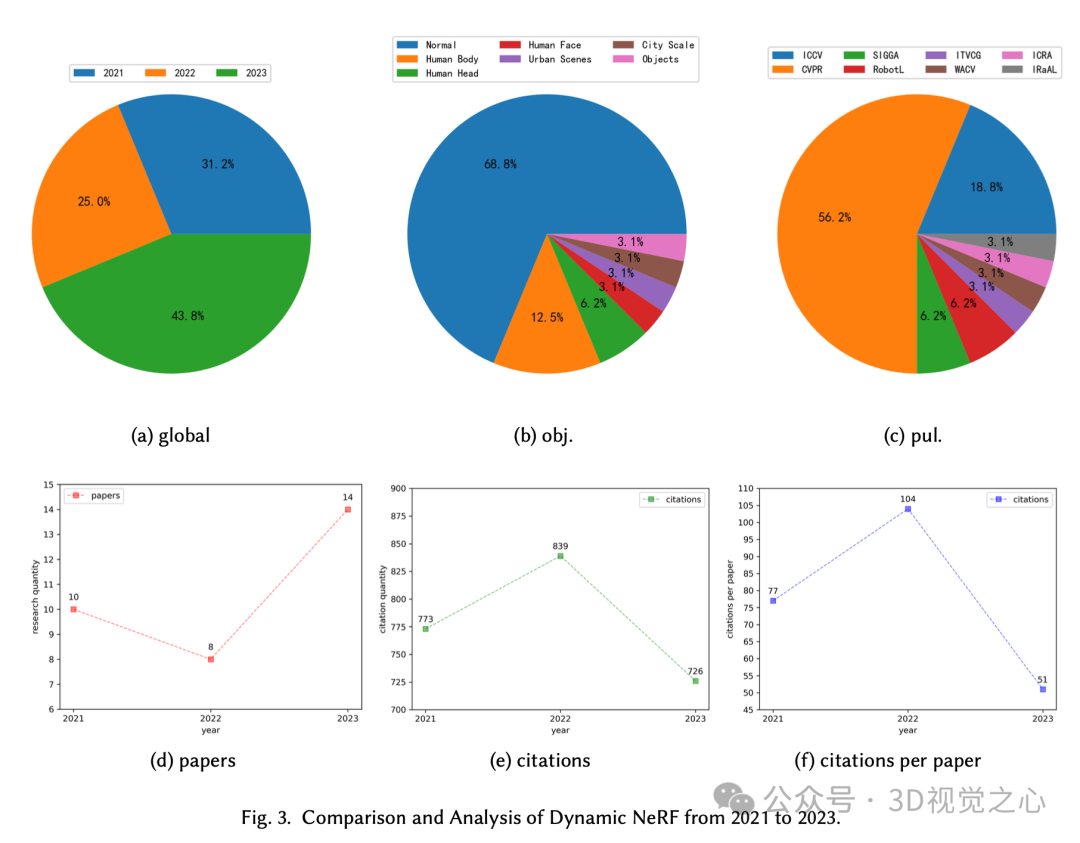

本文对2021年至2023年动态NeRF的发展进行了全球总结,设计了一个特殊的时间发展图(TDC) 来描述它们。TDC由三部分组成:2021年、2022年和2023年动态NeRF的发展。在每年的发展部分中,使用不同颜色的方框来包含该年的研究工作项。绿色、黄色和粉红色分别表示2021年、2022年和2023年的内容框。

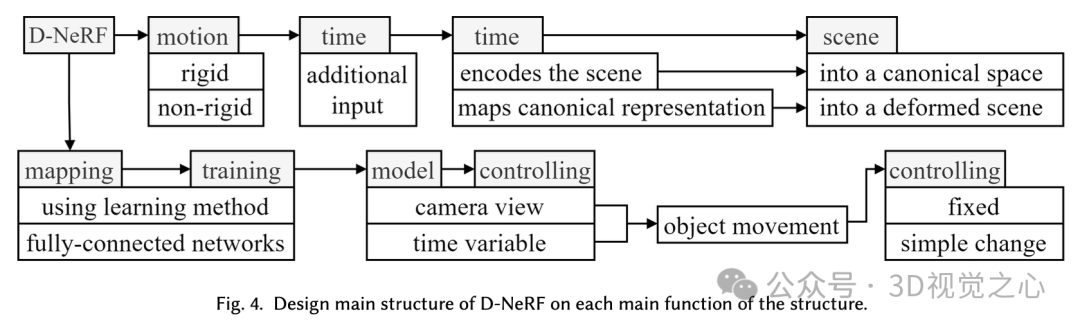

2021年:NeRF的研究领域仍然集中于原始NeRF的研究,即静态NeRF,直到其他研究人员开始关注动态NeRF。动态NeRF的渲染场景可以分为刚性场景和非刚性场景,分别由刚性物体和非刚性物体组成。在这个阶段,构建动态NeRF的主要方法是进行输入图像坐标数据的变形场映射的深度学习,然后将变形场映射到具有规范模板的坐标空间。

2022年:研究人员开始更加关注提高动态NeRF的性能,动态NeRF在不同环境下的影响开始受到重视。提高动态NeRF的性能或处理速度仍然是这个阶段的重要研究方向。

2023年:动态NeRF的研究数量几乎每年翻倍。不仅是纯基础的动态类型,还发展了更多类型的动态NeRF。快速NeRF和可编辑NeRF的发展得益于动态NeRF的演变。在这个阶段,提高动态NeRF的性能或处理速度仍然是一个重要的研究方向。

NeRF综述论文分析

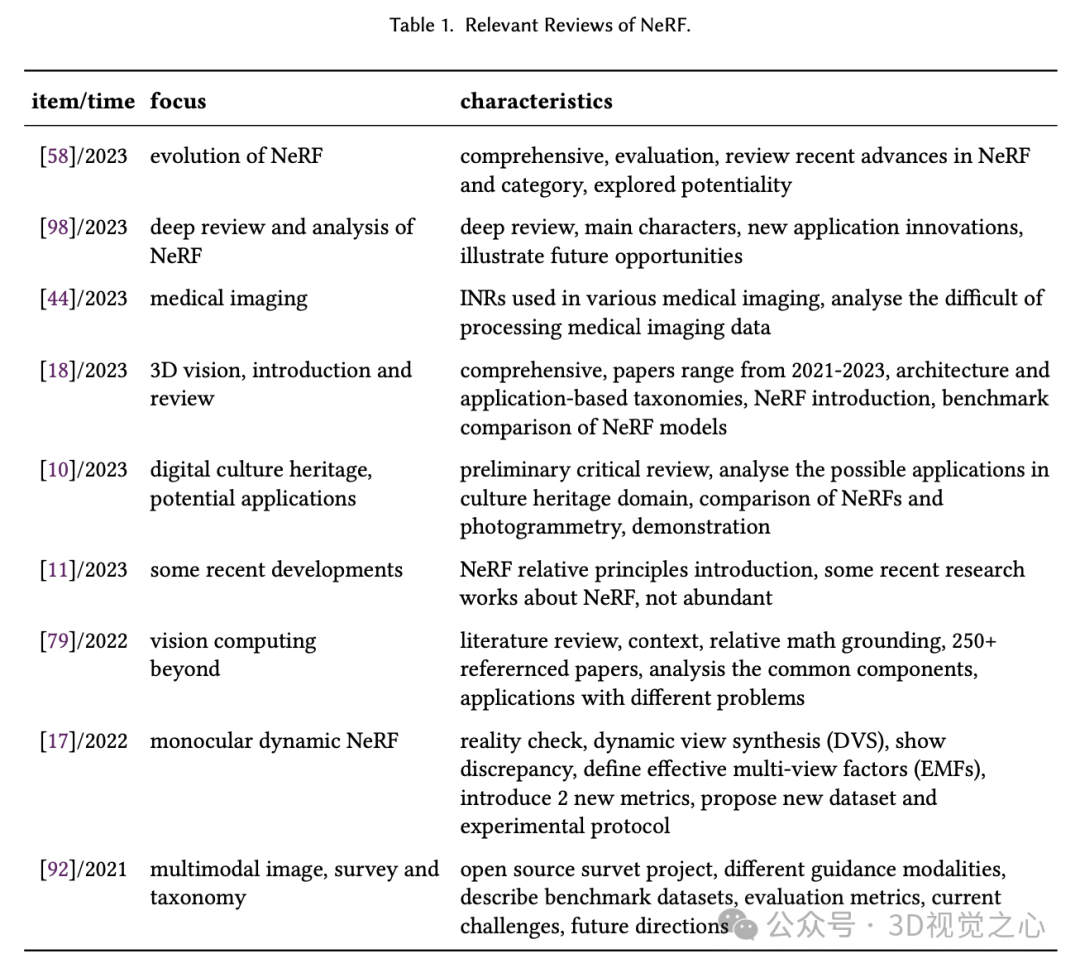

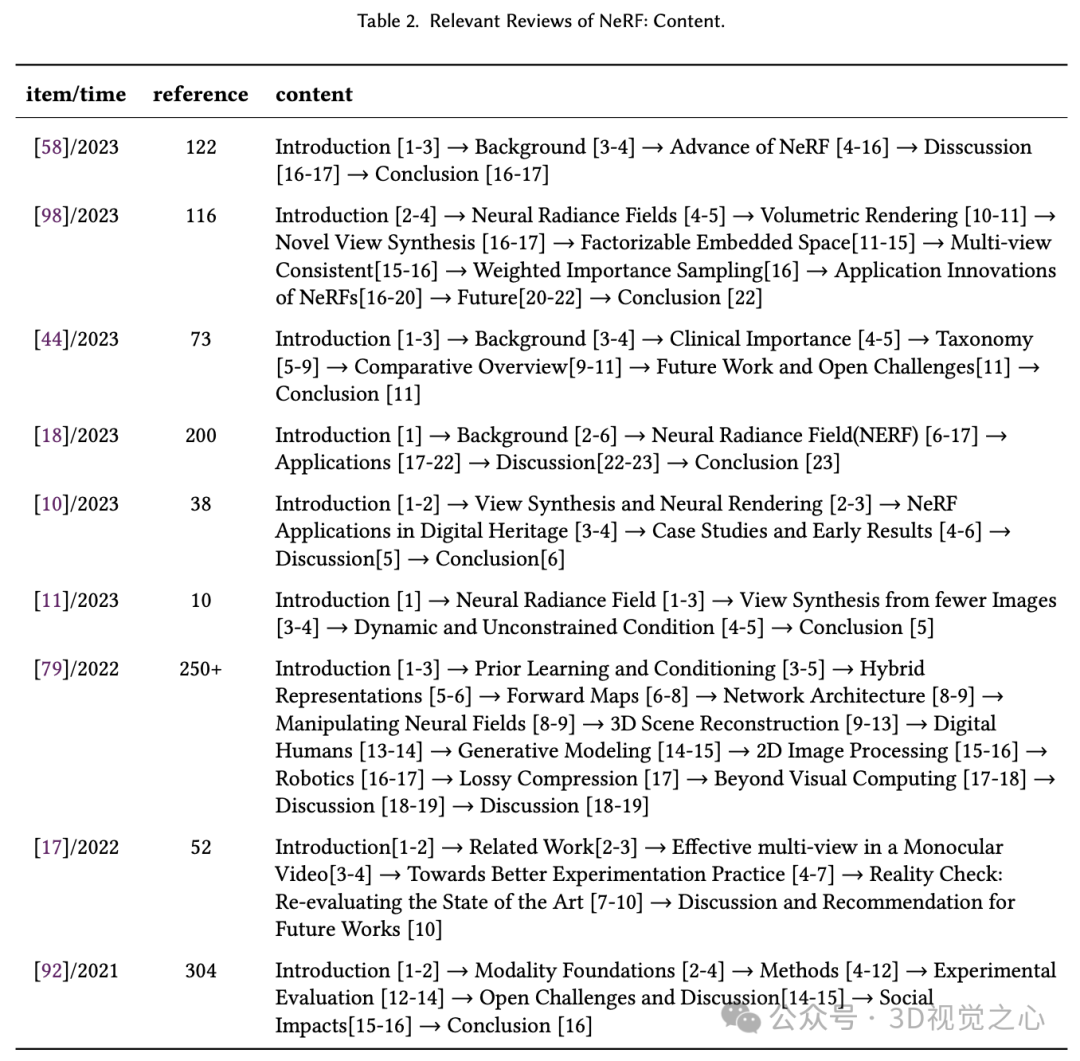

我们比较了近年来发表的与NeRF相关的综述论文,包括其发表时间、研究重点和特点。表1展示了这些综述论文的对比情况。作者选取了九篇综述论文,这些论文占据了NeRF综述的大多数。

从发表数量的分析来看,从2021年到2023年,与NeRF相关的综述论文数量迅速增长。不同的综述关注不同的研究领域,例如:评估、医学成像、最新发展等。每篇综述在不同的研究主题上具有不同的结构和侧重点。

原始NeRF的基本方法

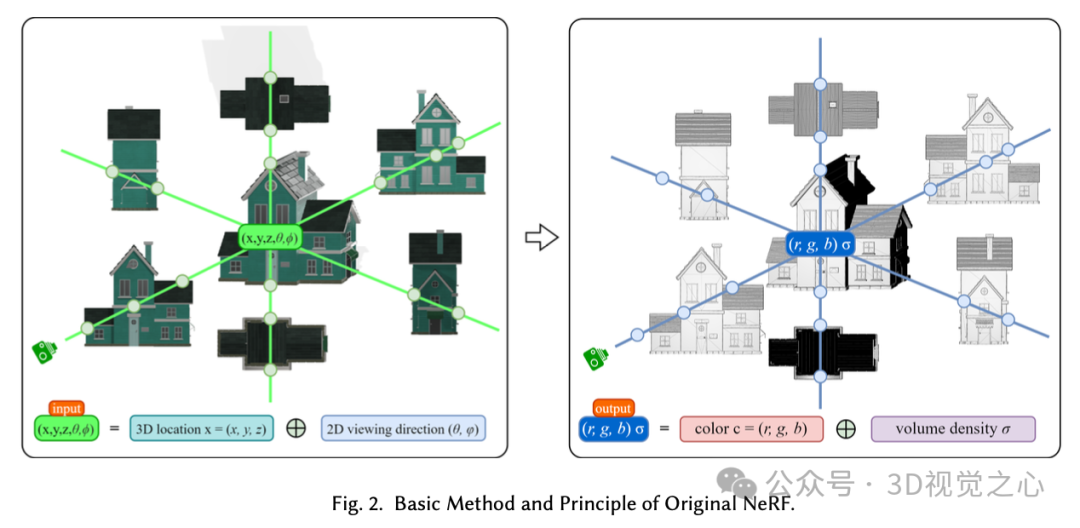

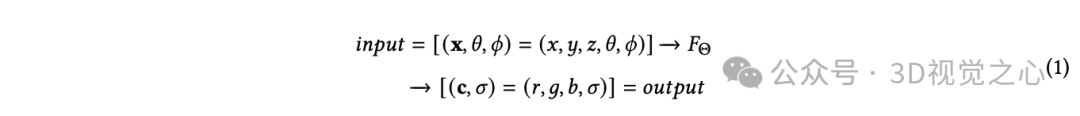

原始NeRF(Neural Radiance Fields)的一项重要贡献是使用一个5D向量值函数来表示连续3D场景的表达。NeRF的输入数据是沿着摄像机射线采样的。摄像机射线在图中用绿色射线表示。每个射线上的采样点由两部分组成:第一部分是场景中采样点的3D空间位置数据,表示为 ;第二部分是采样点的2D视图方向数据,表示为 θ 和 ϕ。因此,通过结合3D位置数据和2D视图方向数据,5D向量值函数的输入数据可以表示为 θϕ。随后,这些输入数据将被用作函数 的输入,输出为颜色和密度值 σ

NeRF的最大优势在于它可以通过少量图像或单视图图像进行高分辨率3D场景重建。这一方法通过多层感知器(MLP)网络,将5D输入(3D位置和2D视图方向)映射到颜色和密度值,从而实现高质量的3D重建。NeRF技术利用了深度学习和神经网络的优势,通过计算和调整残差来获得真实世界的渲染结果。

其主要局限性在于计算资源需求高,训练时间长,且在处理动态场景时表现较弱。这些限制推动了动态NeRF的发展,旨在解决原始NeRF在处理时间变化场景时的不足。

详细总结

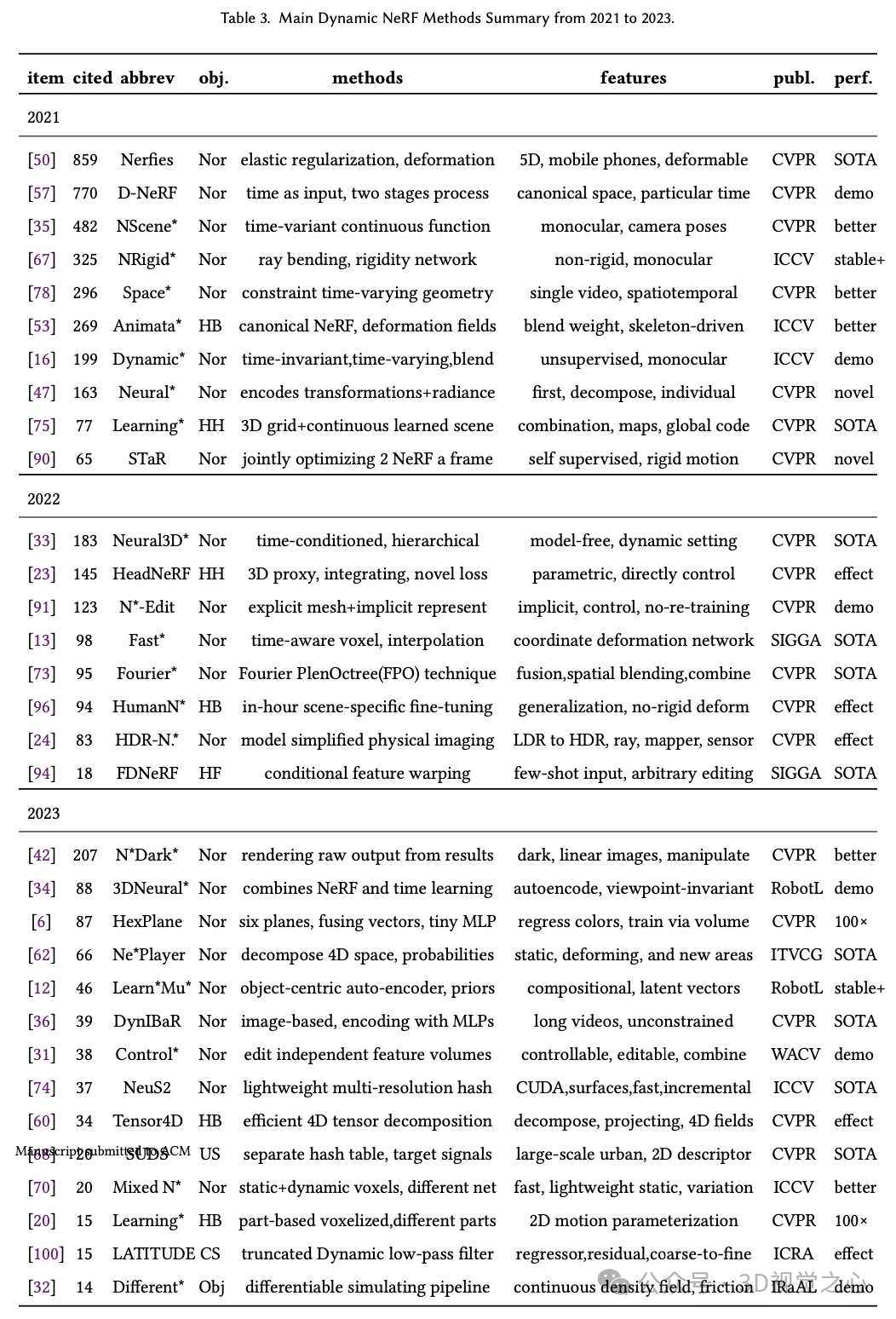

(有兴趣的朋友请看下方参考章节的原文)按时间顺序总结了从2021年到2023年的主要动态NeRF方法,并进行了详细比较:

2021年

Nerfies: 使用弹性正则化和变形5D方法,通过移动设备实现非刚性场景的动态渲染。

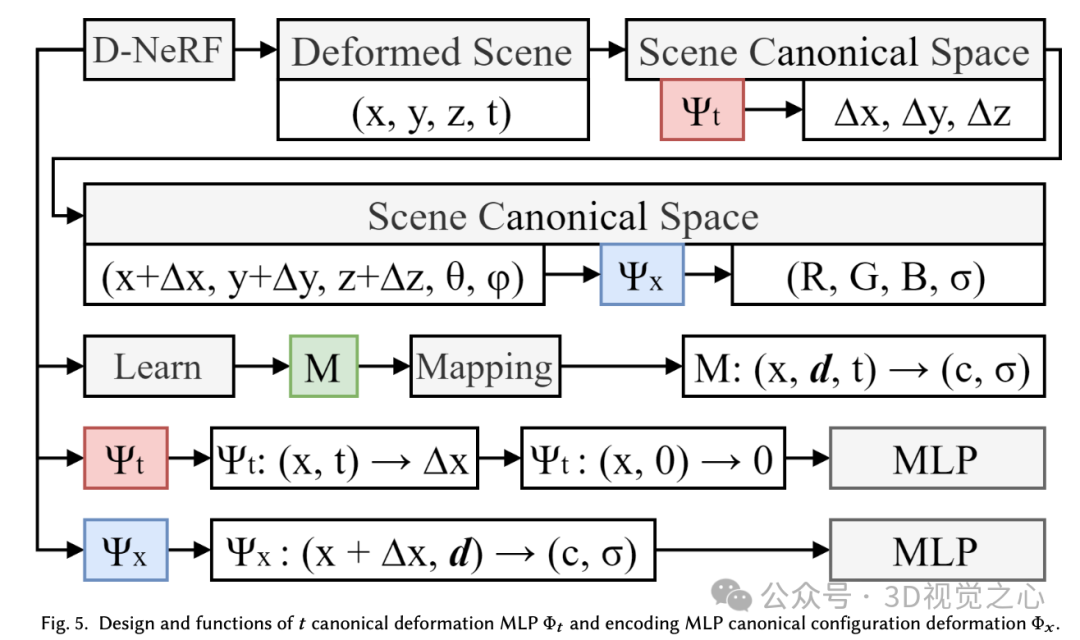

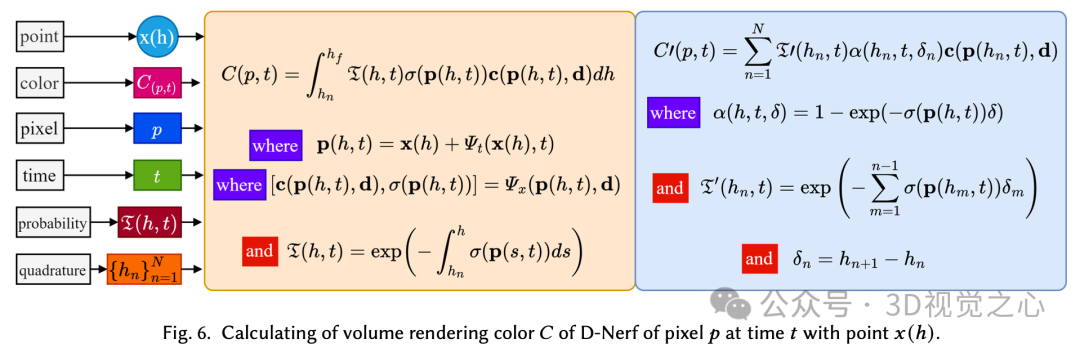

D-NeRF: 通过时间作为输入参数,在规范空间和特定时间内渲染动态场景。

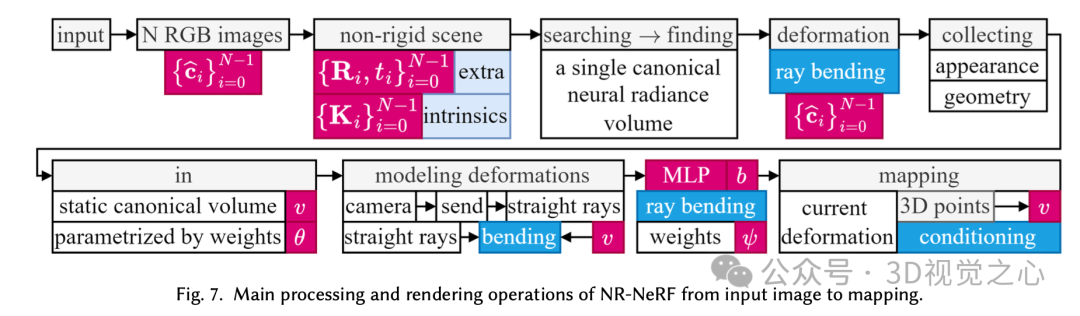

NR-NeRF: 使用射线弯曲和刚性网络,渲染非刚性场景。

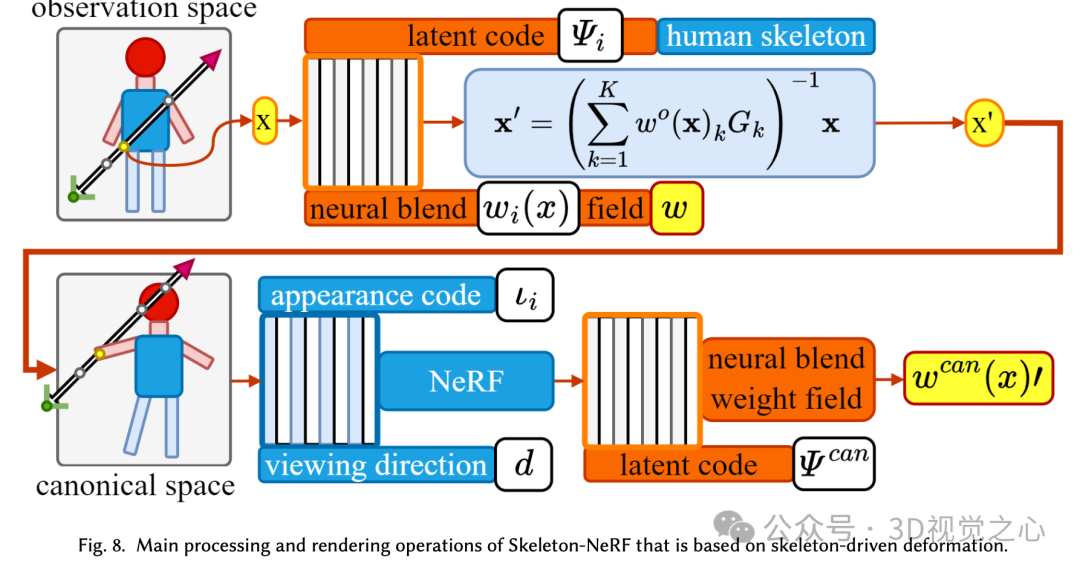

Animatable NeRF: 基于骨架驱动的混合权重场实现动态人体模型的渲染。

Learning4D: 使用3D网格和连续学习场景组合的方法,实现大规模动态场景的渲染。

2022年

Neural3D: 通过时间条件和分层模型实现无模型动态设置。

HeadNeRF: 集成3D代理和新颖损失函数,实现动态人脸的直接控制。

FastNeRF: 使用时间感知体素和插值坐标变形网络,实现快速动态NeRF。

Fourier PlenOctree (FPO): 基于傅里叶变换和体积融合的实时NeRF。

2023年

NeRF-In-Dark: 在黑暗或低光环境下渲染动态NeRF。

3DNeural: 结合时间学习和自动编码,实现视点不变的动态渲染。

Hexplane: 使用6个特征平面显式表示3D合成,实现快速动态NeRF。

DyLiN: 基于动态光场网络,处理非刚性变形。

AvatarMAV: 使用4D张量分解,实现高保真动态NeRF。

一些重要方法的总结

利用精心设计的图表,结合公式,以更加直观的形式表现流程

回顾全文

该综述讨论并分析了动态NeRF领域的大量研究项目和成果,几乎涵盖了动态NeRF各个子领域的重要成果。主要特点:

提出了一些图表的新颖展示方法,展示动态NeRF在各个维度的陈述和比较。

将文字公式和图表结合起来,以更简单易懂地展示动态NeRF具体实现方法

与静态NeRF相比,动态NeRF的关键设计在于将变形因素或域添加到原有的静态NeRF网络中。然而,这些动态NeRF不支持可重新编辑的控制或编辑,这一点在未来的研究中应给予更多关注以更新方法。大多数动态NeRF的研究对于未来可编辑或可重新编辑的NeRF研究都是有用的。在某些维度上,动态NeRF的一些原理甚至对高斯泼溅的设计有用。

参考

[1] Dynamic NeRF: A Review

投稿作者为『自动驾驶之心知识星球』特邀嘉宾,欢迎加入交流!

① 全网独家视频课程

BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、大模型与自动驾驶、Nerf、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

② 国内首个自动驾驶学习社区

国内最大最专业,近3000人的交流社区,已得到大多数自动驾驶公司的认可!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(2D/3D检测、语义分割、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型、端到端等,更有行业动态和岗位发布!欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦感知、定位、融合、规控、标定、端到端、仿真、产品经理、自动驾驶开发、自动标注与数据闭环多个方向,目前近60+技术交流群,欢迎加入!扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】全平台矩阵

1240

1240

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?