点击下方卡片,关注“自动驾驶之心”公众号

戳我-> 领取自动驾驶近15个方向学习路线

编辑 | 自动驾驶之心

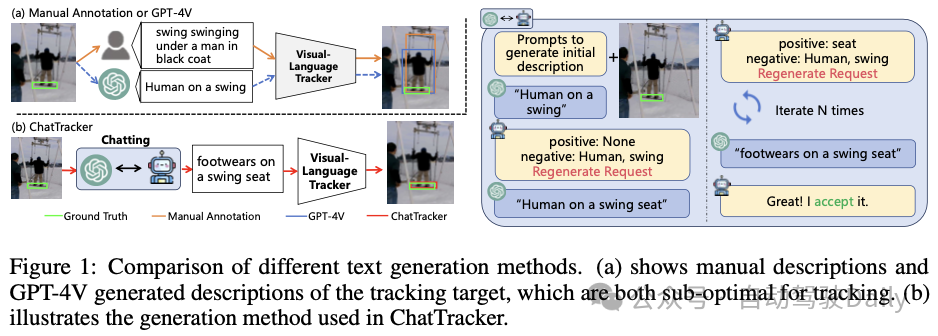

写在前面 & 笔者的个人理解

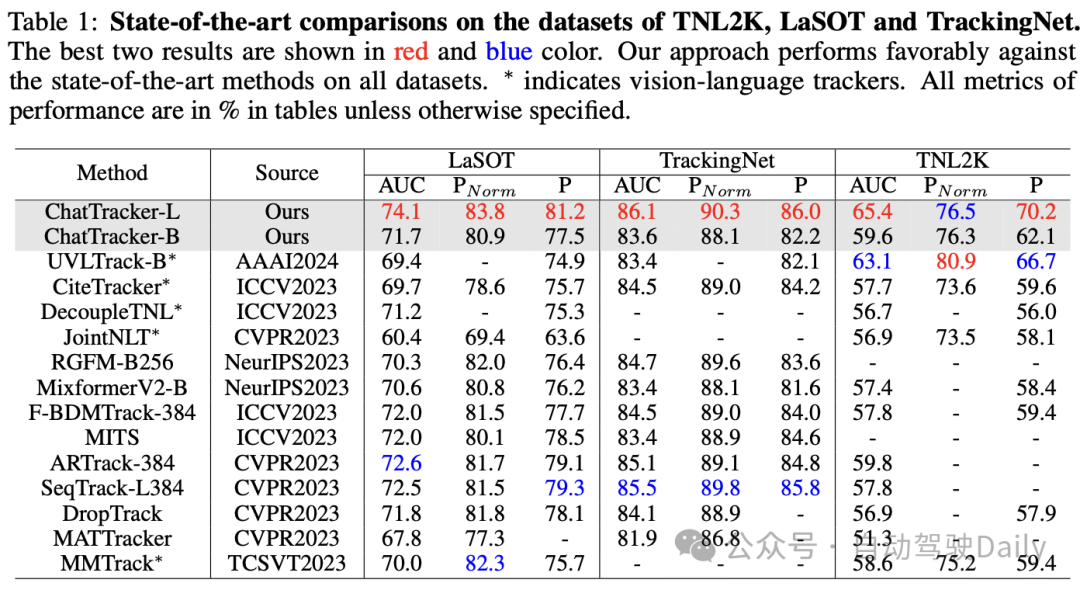

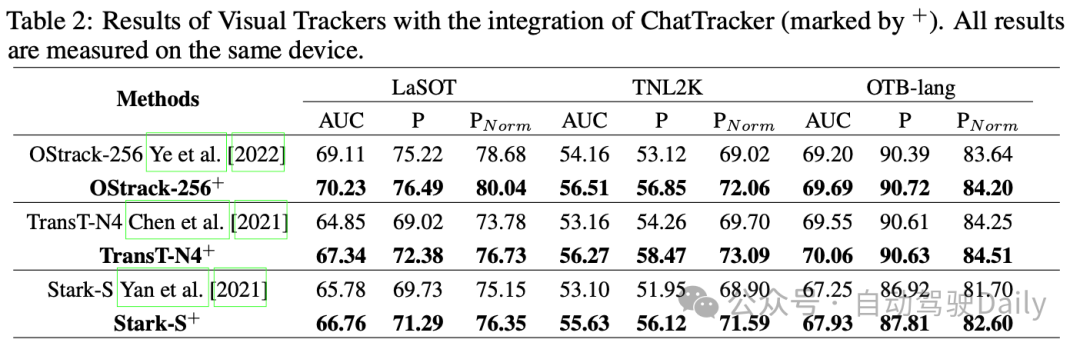

视觉对象跟踪旨在基于初始边界框在视频序列中定位目标对象。最近,视觉语言(VL)跟踪器已经提出利用额外的自然语言描述来增强各种应用中的通用性。然而,VL跟踪器在跟踪性能方面仍然不如最先进的视觉跟踪器(SoTA)。我们发现,这种劣势主要是由于他们严重依赖手动文本注释,其中包括频繁提供模糊的语言描述。在本文中,我们提出了ChatTracker,利用多模态大语言模型(MLLM)中丰富的世界知识来生成高质量的语言描述并提高跟踪性能。为此,我们提出了一种新的基于反射的提示优化模块,通过跟踪反馈迭代地改进目标的模糊和不准确的描述。为了进一步利用MLLM产生的语义信息,提出了一种简单而有效的VL跟踪框架,该框架可以很容易地集成为即插即用模块,以提高VL和视觉跟踪器的性能。实验结果表明,我们提出的ChatTracker实现了与现有方法相当的性能。

总结来说,本文的主要贡献如下:

我们提出了ChatTracker,这是一种利用MLLM进行视觉对象跟踪的新框架。据我们所知,这是将MLLM纳入跟踪框架的第一项工作。它为现有的视觉和VL跟踪器提供了即插即用的模块增强功能,计算开销有限。

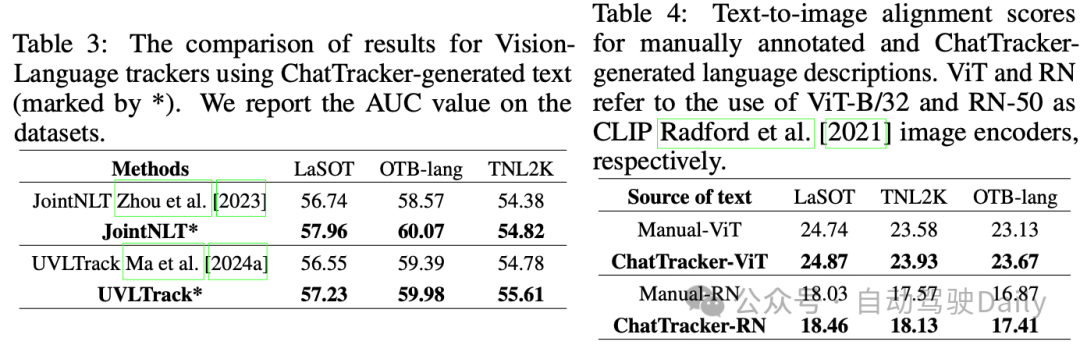

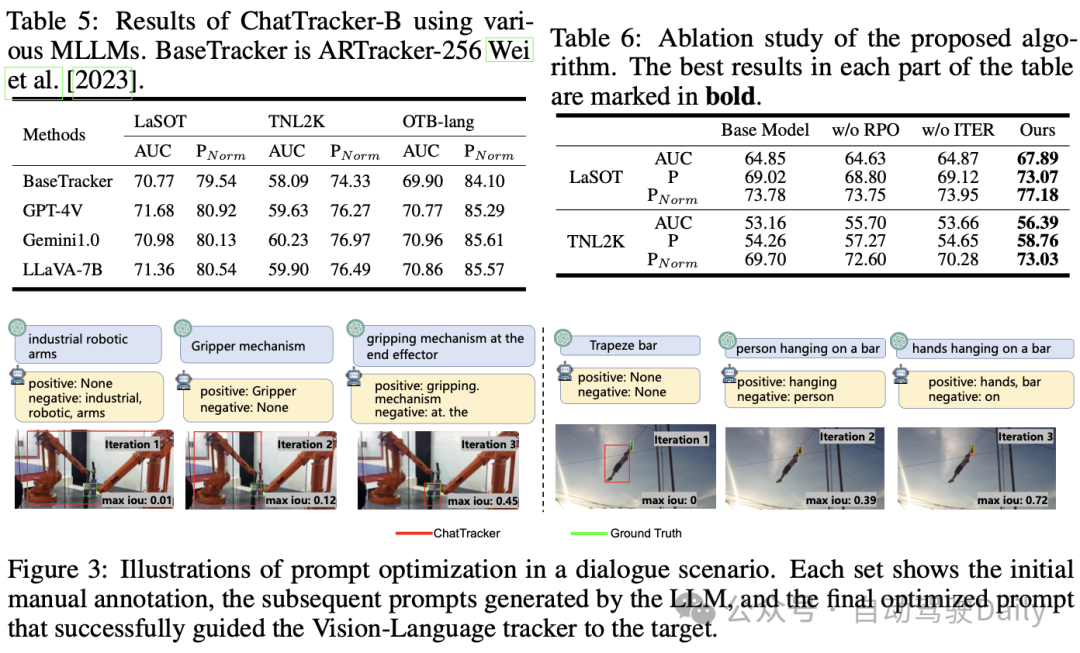

我们引入了一个基于反射的提示优化(RPO)模块,以缩小VL跟踪器和MLLM之间的知识差距。通过反思跟踪反馈,RPO模块可以迭代优化MLLM的提示,最终为跟踪目标生成准确和相关的描述。与数据集中的人工标注文本相比,这些描述在跟踪性能和图像文本对齐方面都更优越。

我们提出的ChatTracker在多个跟踪数据集上实现了SoTA性能。我们进行了广泛的实验,包括消融研究,以证明所提出的方法及其各个模块的有效性。

相关工作回顾

Vision-Language Trackers

视觉语言跟踪方法Zhou等人、Ma和Wu等人探索了使用语言线索来增强视觉对象跟踪。这些方法可以根据其文本来源进行分类:使用手动注释文本的方法和从预定义词典生成描述的方法。在第一类中,手动注释文本已被广泛用于目标跟踪任务。LaSoT、TNL2K和MGIT等数据集为每个序列提供了手动注释的语言描述。SNLT跟踪器利用视觉和语言描述来预测目标状态,然后动态组合这些预测以产生最终结果。JointNLT将视觉基础和自然语言引导的跟踪相结合,有效地满足了这两个过程的不同要求。第二类利用预定义的词典生成语言描述。CiteTracker精心开发了一个类别词汇表,其中包括目标的颜色、纹理和材料等属性。在跟踪过程中,它使用CLIP来比较图像和文本之间的相似性,选择与图像非常匹配的文本作为目标的描述。与这些方法相反,我们的工作专门采用MLLM来获取目标的精确文本描述。这种方法有效地消除了对手动文本注释或预定义词典的依赖。

Large Language Model in Vision Tasks

大语言模型(LLM),如ChatGPT和Llama是在广泛的互联网规模文本上训练的自回归模型。它们在权重中包含了广泛的世界知识。最近,GPT-4V发布,因其出色的多模态感知和推理能力而立即引起了社区的关注。在此之后,使用CLIP模型对图像进行分类,提高了分类任务的精度。这些进步主要针对基本的视觉识别,如分类和检测。在这项工作中,我们致力于将LLM中包含的丰富世界知识整合到视觉对象跟踪领域。

ChatTracker方法详解

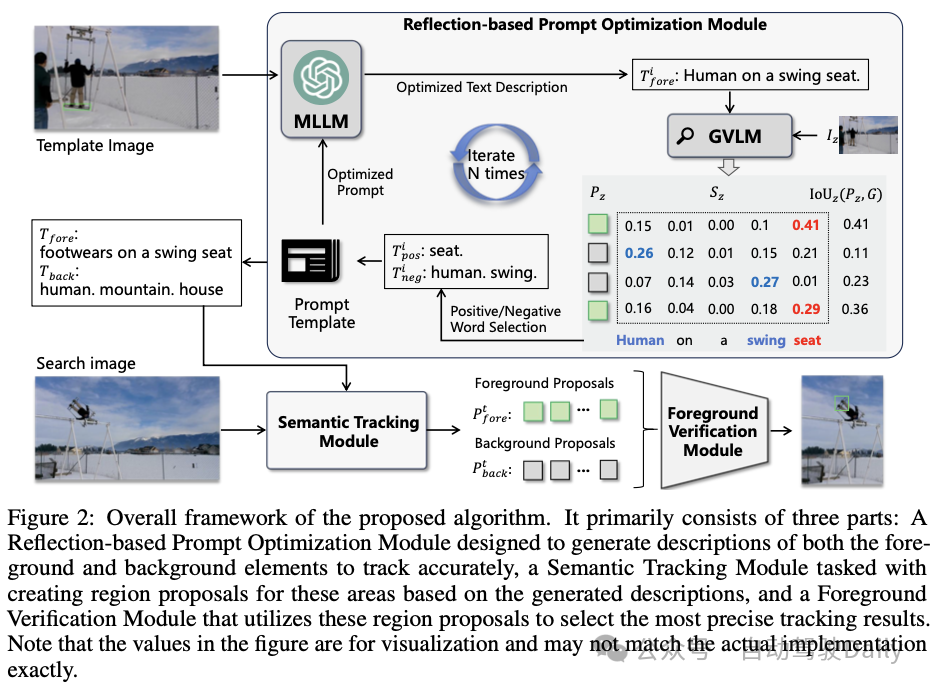

所提出的ChatTracker由三个部分组成:基于反射的提示优化(RPO)模块、语义跟踪模块和前景验证模块。

Reflection-based Prompt Optimization Module

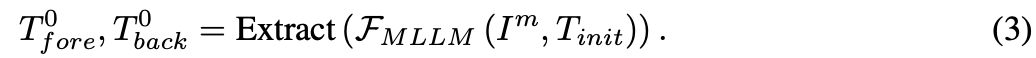

初始化。我们在第一帧I1中的跟踪目标上绘制一个绿色边界框,创建一个新的图像输入Im。预定义的人工提供的提示模板Tinit和Im被输入到MLLM中,从而对前景和背景进行初始描述:

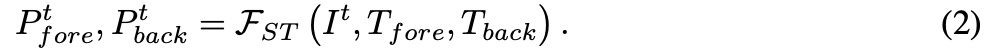

RPO模块将模板图像作为输入,并生成前景和背景的文本描述。然后,对于每一帧,语义跟踪模块将前景和背景的文本描述作为输入,利用GVLM获得前景和背景region proposals:

语义跟踪模块还包括一个现成的单对象视觉跟踪器。最后,前景验证模块通过考虑前景建议、背景建议和模板之间的关系,选择置信度最高的前景建议作为跟踪结果。

实验结果

结论

在这项工作中,我们介绍了ChatTracker,这是第一种利用多模态大语言模型(MLLM)来提高视觉跟踪性能的方法。我们提出了一种基于反射的提示优化(RPO)模块,通过跟踪反馈迭代地改进目标的模糊和不准确的语言描述。此外,提出了一种简单而有效的视觉语言跟踪框架,作为即插即用的方法来提高现有跟踪器的性能。在多个数据集上的实验结果表明,我们的方法优于最先进的方法。这表明,将MLLM纳入视觉跟踪对提高跟踪性能有显著效果。

参考

[1] ChatTracker: Enhancing Visual Tracking Performance via Chatting with Multimodal Large Language Model

『自动驾驶之心知识星球』欢迎加入交流!重磅,自动驾驶之心科研论文辅导来啦,申博、CCF系列、SCI、EI、毕业论文、比赛辅导等多个方向,欢迎联系我们!

① 全网独家视频课程

端到端自动驾驶、仿真测试、自动驾驶C++、BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、CUDA与TensorRT模型部署、大模型与自动驾驶、NeRF、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

② 国内首个自动驾驶学习社区

国内外最大最专业,近4000人的交流社区,已得到大多数自动驾驶公司的认可!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(端到端自动驾驶、世界模型、仿真闭环、2D/3D检测、语义分割、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型,更有行业动态和岗位发布!欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦感知、定位、融合、规控、标定、端到端、仿真、产品经理、自动驾驶开发、自动标注与数据闭环多个方向,目前近60+技术交流群,欢迎加入!扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】全平台矩阵

3533

3533

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?