原文链接:https://ieeexplore.ieee.org/abstract/document/8972542/

总体评价:感觉更侧重机器学习

Abstract

脑电图(EEG)自发现以来一直是识别患者某些健康状况的主要方法。由于有许多不同类型的分类器可供使用,因此分析方法也同样众多。在这篇综述中,我们将专门研究用于脑电图分析的生物工程应用的机器学习方法。我们回顾了从1988年到2018年的文献,以捕获在多种应用中以前和当前的EEG分类方法。从这些信息中,我们能够确定每种机器学习方法的总体有效性以及关键特征。我们发现机器学习中使用的所有主要方法都以某种形式应用于EEG分类。这包括从朴素贝叶斯到决策树/随机森林,再到支持向量机(SVM)。监督学习方法的平均准确率高于非监督学习方法。这包括SVM和KNN。虽然每一种方法在各自的应用中都有各自的精度限制,但是当正确实现这些方法的组合时,有希望获得更高的总体分类精度。本文提供了在脑电图分析中使用的机器学习应用的全面概述。本文还概述了每种方法以及每种方法最适合的一般应用程序。

I. Introduction

脑电图(EEG)是一种测试大脑电信号的方法。它经常被用作数据分析技术,如时间和频率序列分析。大脑的神经元包含离子电流,它会产生脑电图可以测量的电压波动。这种电活动是自发的,在一段时间内被许多头皮电极记录下来,形成脑电图信号[22]。传统上,脑电图信号是在头皮表面采集的,但也有脑电图信号,它是在大脑内部采集的。在本文中,我们将主要关注传统的头皮脑电图信号。

通常,脑电图记录可以通过使用导电凝胶将电极连接到头皮来获得。然后使用差分放大器将每个有源电极与参考电极进行放大,然后通过抗混叠滤波器发送。最后,用模数转换器对滤波后的信号进行转换。

在临床上,脑电图信号主要用于诊断和治疗各种脑部疾病,如癫痫、震颤、脑震荡、中风和睡眠障碍。脑电图最近的应用包括使用机器学习作为分析方法。特别是结合机器学习对癫痫发作检测和睡眠障碍研究的研究较多。此外,由于EEG监测任务期间的大脑活动,人们对研究游戏中的EEG信号也越来越感兴趣,以使用脑电波来控制和操纵物体[36]

EEG波形随频带的变化而变化,频带表示频率范围。δ波段是振幅最高的最慢波,频率范围低于4hz。对于成人,它位于前部,而对于儿童,它位于后部。θ波段在4到7赫兹之间,在幼儿中最常见,而在成人中则表示困倦或觉醒。由于对运动或反应的积极抑制,这个波段趋于尖峰。alpha波段在8到14赫兹之间,它与眼部肌肉运动有关。它位于头部后部两侧。β波段高于14hz,与一般运动行为相关。它位于头部额叶区域的两侧[44]

与其他技术相比,使用脑电图研究大脑功能的一些优点是成本低,对受试者运动的耐受性,以及没有辐射暴露风险。使用脑电信号的缺点是空间分辨率低、信噪比差。

II. MACHINE LEARNING METHODS FOR EEG

A. Overview

机器学习是使用一组数学模型和算法来逐步提高单个任务的性能。它将训练数据集作为输入,作为进行估计的指南,而无需专门编程。在这个领域中,任务变化很大,可以分为两大类:监督学习和无监督学习。无监督学习是指算法从只包含输入而不包含输出的数据集构建识别模式的情况。监督式学习有一部分是半监督式学习。它们在某种意义上是相同的,它们都是从给定输入和已知输出的数据集中学习,除了半监督的数据集缺少部分数据集。监督学习主要用于分类和回归的应用,而无监督学习则适用于特征学习和相反的降维。本文将讨论一些最流行的机器学习方法,并根据学习类型对它们进行分类,并在脑电图中的一些实际应用。

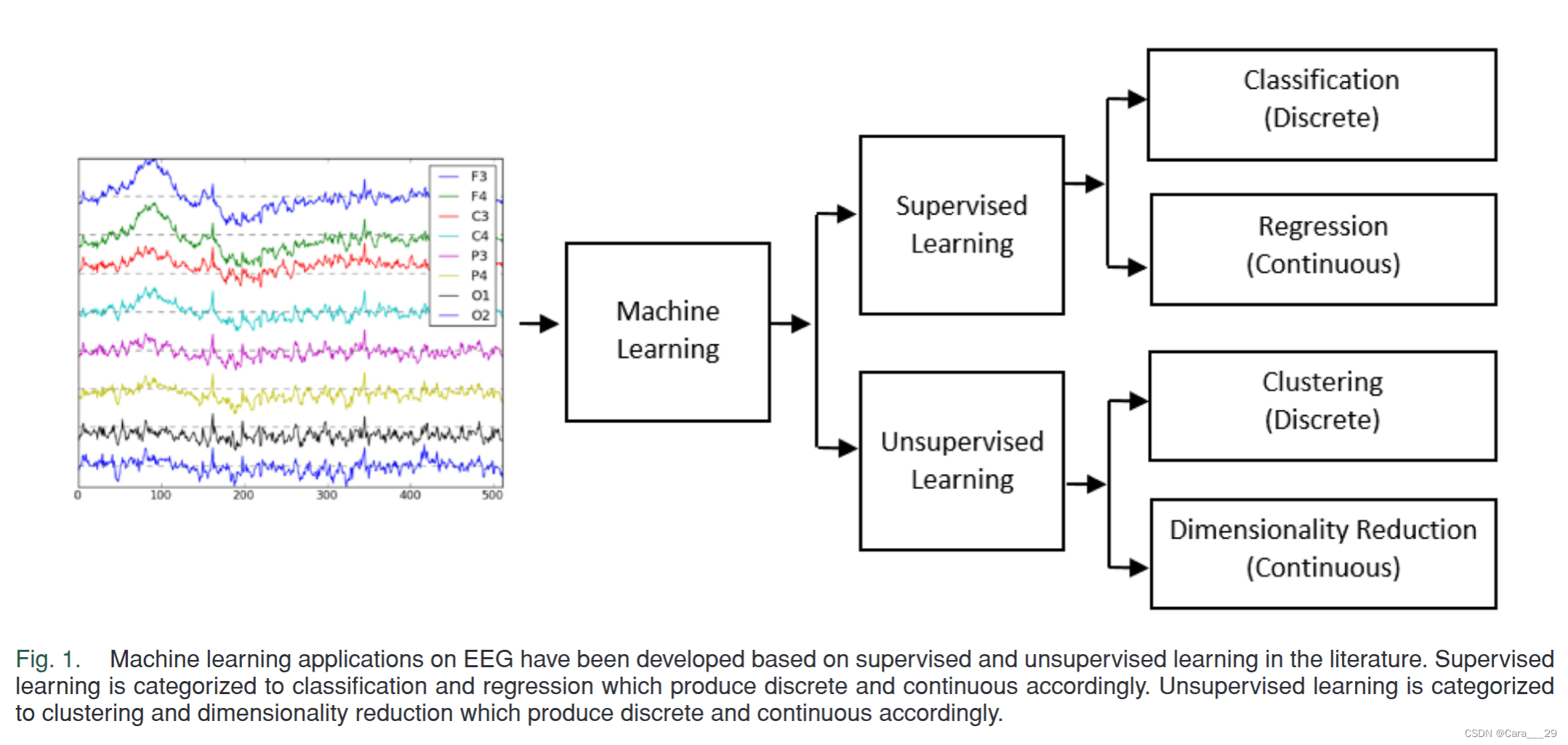

在机器学习方法的辅助下,脑电图信号可以作为难以检测的医疗状况的指标。图1展示了基于监督学习和无监督学习的机器学习在脑电信号上的应用。监督学习使用输入和期望输出数据开发预测模型,并将其分类为分类和回归,从而产生离散和连续。无监督学习开发了一种仅使用输入数据的预测模型,将其分类为聚类和降维,从而产生离散和连续。

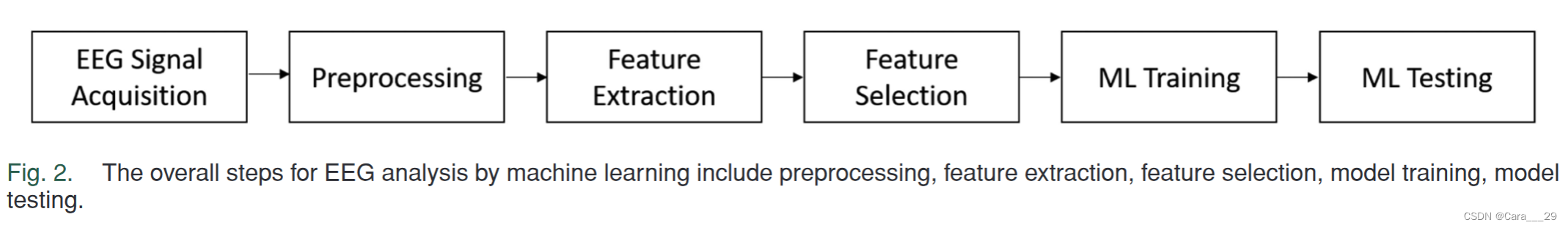

图2描述了如何实现机器学习以获得所需的数据集分类的一般流程。第一步是信号采集。这基本上是未经编辑的原始数据。预处理包括去除数据集中的噪声和其他异常值。特征提取决定了数据点分组的频谱以及它们对应的特征。特征选择是机器学习方法将在接下来的训练中测试的所需分类器的隔离。机器学习训练涉及使用训练数据集,无论是否有已知输出来改进分类方法。最后,测试阶段是对真实的测试数据集进行处理,并比较期望特征的总体精度。

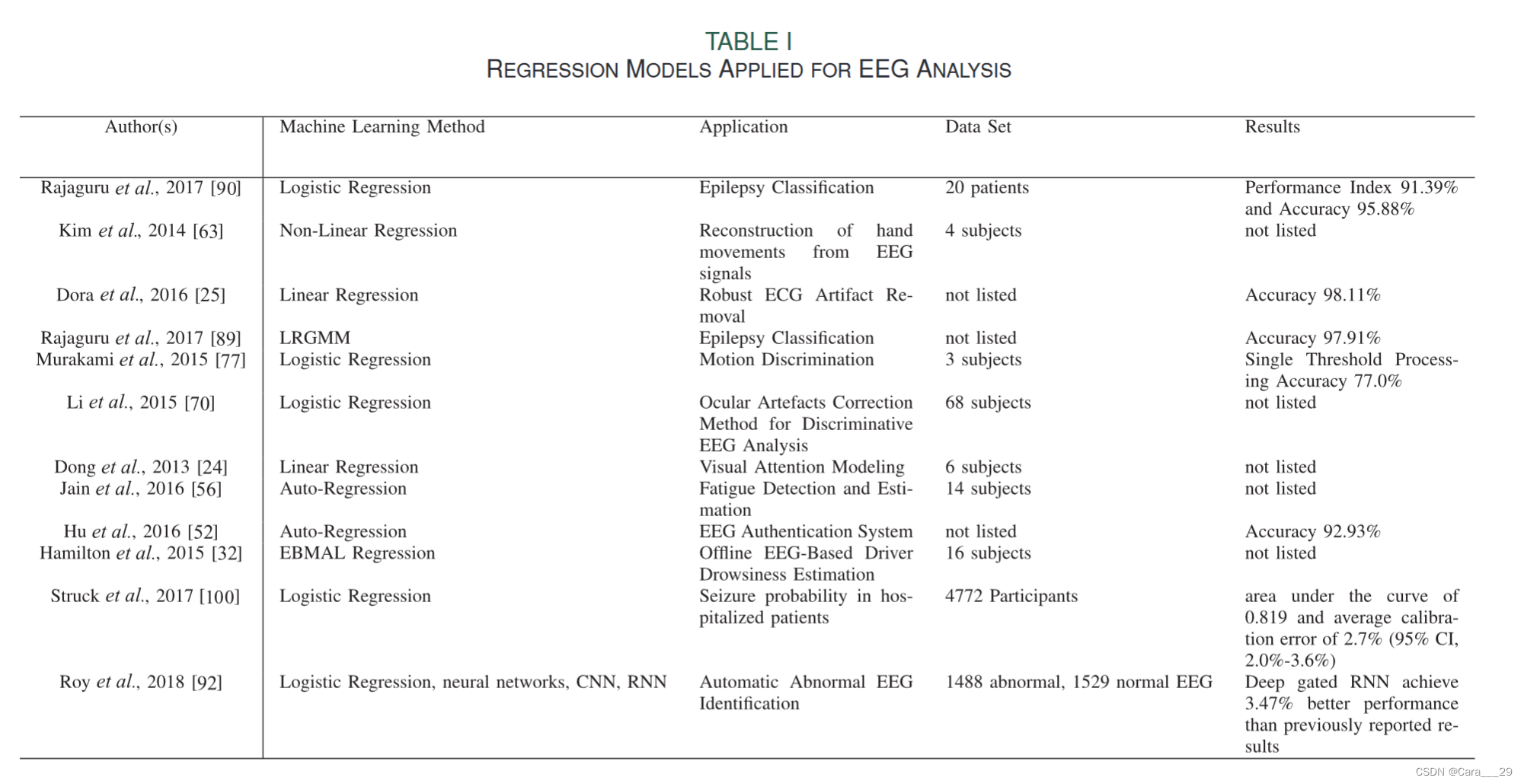

B. Regression

回归建模是统计学中流行的工具,因为它是在变量之间创建函数关系的一种简单方法。各种类型的回归包括:单变量和多变量的定量响应变量;预测变量的简单和多重;线性表示线性可变换的数据;非线性可变换数据的非线性;定性变量预测因子的方差分析定量与定性变量组合预测因子的协方差分析对定性反应变量采用logistic回归分析[84]。

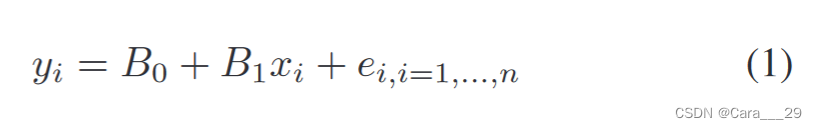

勒让德和高斯首先使用最小二乘法应用回归。该方法通过对各方程残差的平方和进行逼近,以获得最优拟合数据,并应用于线性回归。如下面的等式所示。

线性回归是最常用的回归技术之一。在该模型中,参数以线性组合的形式指定,而每个自变量不一定是线性的。多元线性回归是类似的,除了有几个自变量,而不是只有一个。当参数不是线性时,必须使用非线性回归。这也使用平方和技术,尽管它使用迭代过程来最小化函数。

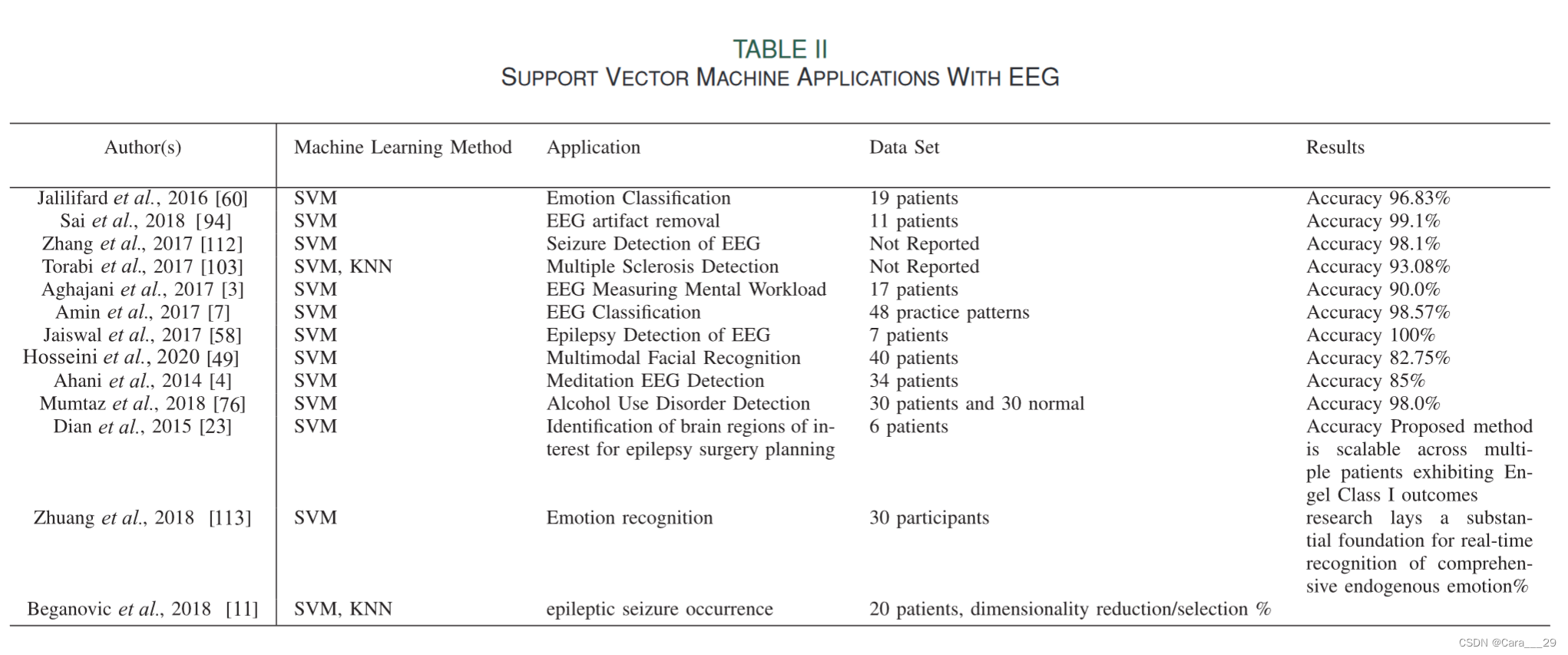

C. SVM

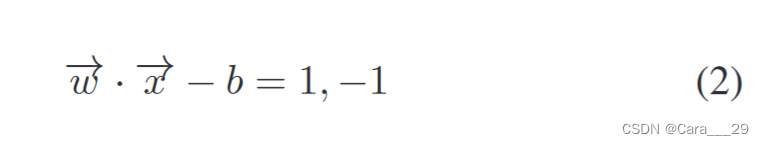

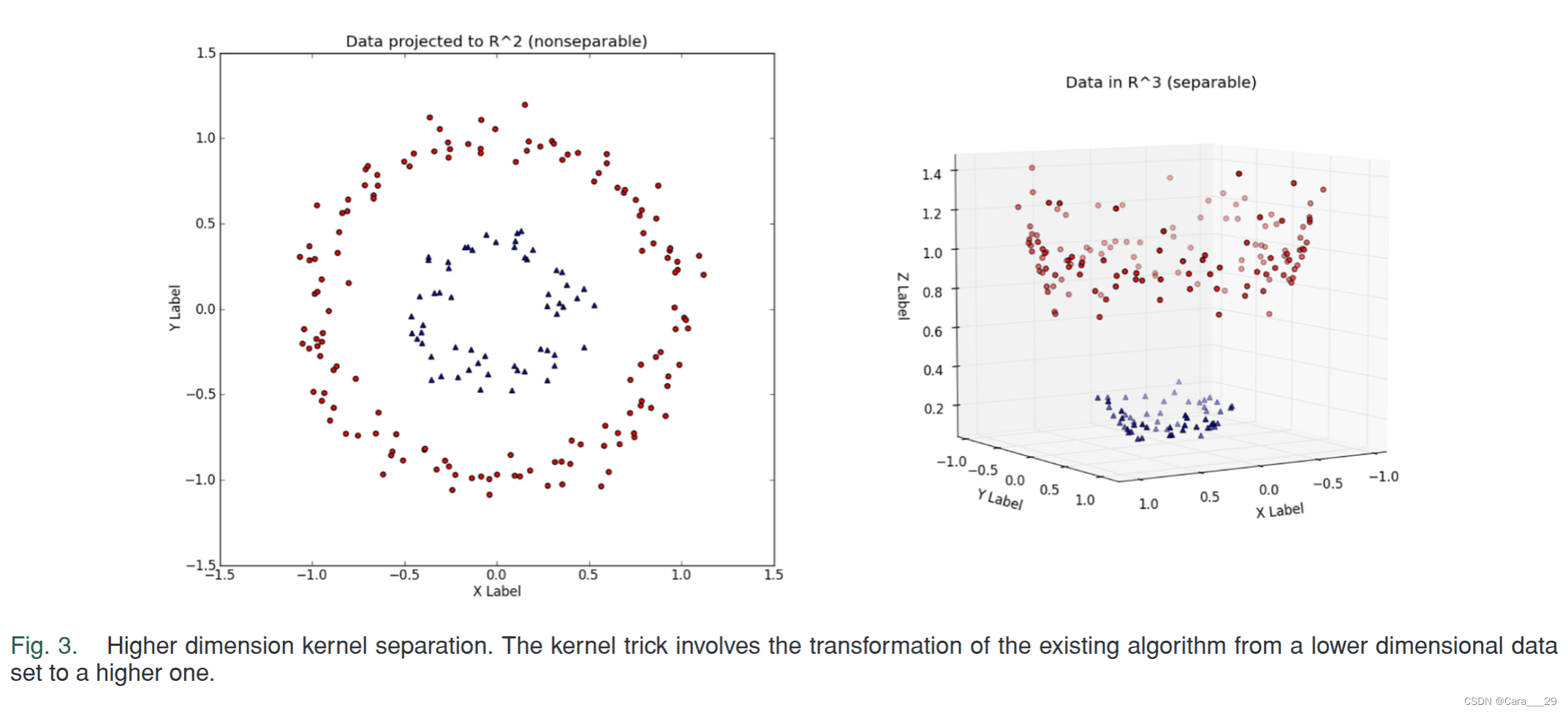

支持向量机是监督学习的一个子类,用于分析数据进行分类和回归分析。其目的是映射空间中的点,使目标类别的示例被尽可能大的边界划分。这使得SVM作为分类器具有较低的泛化误差[39]。目标是在n维空间中找到一个超平面或一组超平面。支持向量是更接近给定超平面的数据点。它们通过改变超平面的位置和方向来最大化分类器的边缘。此外,在这个空间内,由于数据的位置,这些点也可能不是线性可分的。支持向量机能够利用生成的核函数或更常见的对数据集的“核技巧”来解决这个问题。这个技巧涉及到现有算法从低维数据集到高维数据集的转换。信息量保持不变,但在这个高维空间中,可以创建一个线性分类器。为每个点分配几个K核,然后帮助确定新变换的特征空间的最佳拟合超平面。有了足够的K个函数,就有可能得到精确的分离。唯一的主要问题是过度拟合。[110]。图3描述了二维和三维的数据分离示例。

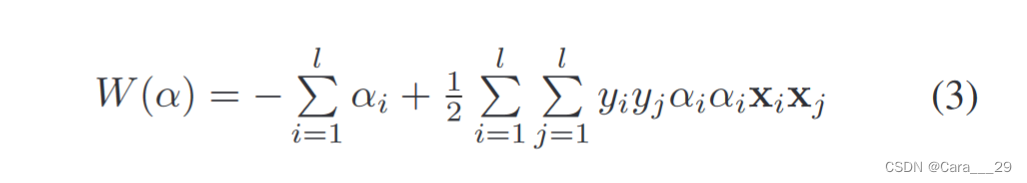

Linear SVM classifier with hard margin

Kernel trick equation minimizing W subject to:

D. KNN K-Nearset Neighbours

KNN是一种监督式机器学习算法。在监督学习中,对于训练数据集,输入和输出之间的关系是已经建立的,即对于给定的输入,输出是已知的。监督学习分为回归学习和分类学习。KNN既可以用于分类也可以用于回归。分类和回归的输入是相同的,但输出分别不同。示例输入输出对用于预测未训练数据集的输出。KNN基于K个邻居的分类对输入进行分类。为了找到最近的邻居,从输入到所有已知数据点计算欧几里得距离或马氏距离。计算出距离后,选择K个最近邻。然后,它根据输入与K近邻之间的相似性对输入进行分类。K的选择是基于数据集的大小。取数据集大小的平方根,如果结果是偶数,则将其加1或减1。然后将结果确定为该数据集的K。选择K为奇数,以避免输入预测中的偏差。

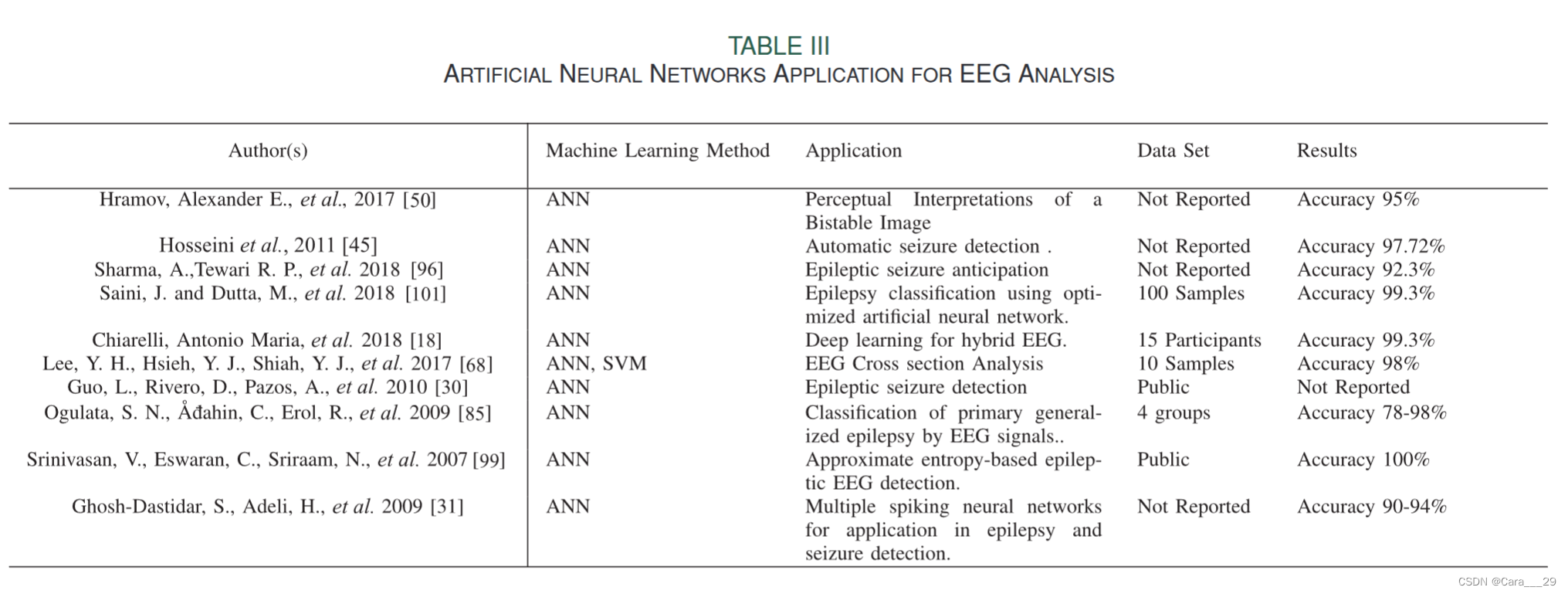

E. ANN

神经网络,在计算机世界中通常被称为人工神经网络,是一种与人类大脑中的神经网络结构非常相似的数学模型。为了理解模型是如何工作的,研究人员提出了一些理论和例子来展示神经网络不同层之间的相互作用,将给定的输入转换为期望的输出。

想象一下,你在酒吧里,看着菜单点了一杯好啤酒。你最喜欢的是印度淡啤,一旦你在单子上看到它,你就会点它。所以在你的大脑中发生的是,你为你的大脑神经网络提供了多种啤酒选择的输入,印度淡啤酒的选择有一个更有利的权重,因为它是你最喜欢的啤酒;大脑做了一个决定,然后给你输出。这是神经网络如何运作的一个基本例子。该模型的体系结构显示了决策过程,其中涉及位于输入层和输出层之间的更深层次的交互。

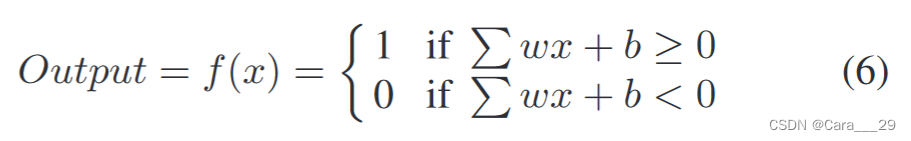

对于人工神经网络,分类技术可以通过以下方式实现:

输入权重乘积和偏差的总和

Activation Layer 激活层

由于每个应用都是不同的,并且必须有特定的方法-长期或短期脑电信号段分析,实时过程或延时过程,脑电信号通道分析类型(单个或多个)-可以很容易地使用人工神经网络进行针对性和合成。一旦脑电图信号在用户友好的gui中转换成波形,这些信号的分类就会与人工神经网络一起发生,并为特定用例选择特定类型的网络-前馈反向传播,径向基函数,循环神经网络。了解不同类型的人工神经网络是如何操作的以及促进这种操作的体系结构是很重要的。

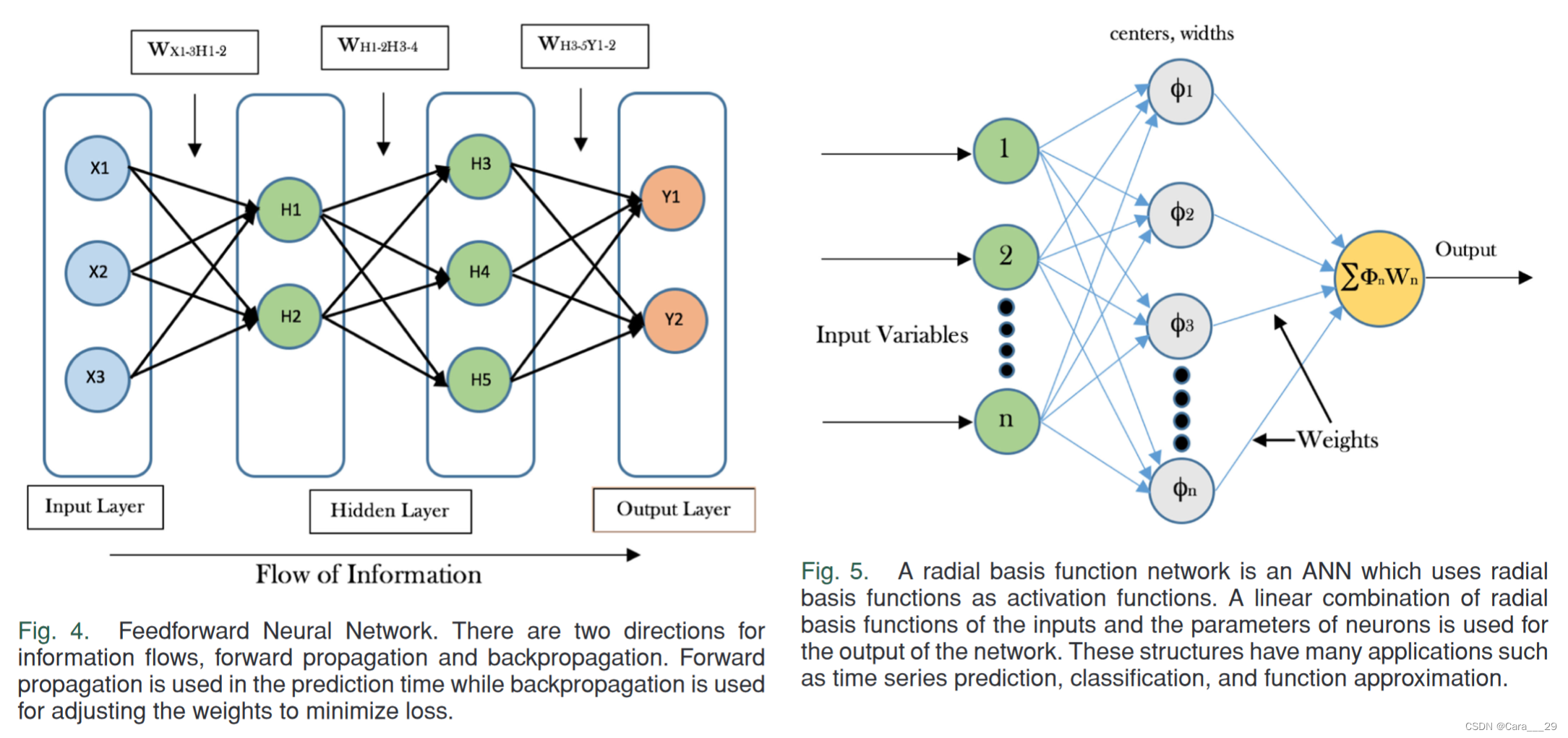

1)前馈神经网络:这是一种数据只向一个方向流动的网络,从输入节点开始,经过隐藏节点,到达输出节点。这种网络保证不形成环路或循环,使信息只向一个特定的方向流动。前馈网络机制架构如图4所示。

2)径向基函数:在人工神经网络和数学建模领域,径向基函数是一种利用径向基函数(一种任意实值函数,其值由函数离原点的位置决定)的人工神经网络。因此,网络通过输入和给定神经元参数的RBF的线性组合来确定输出。如图5所示,该结构通过将点的中心/宽度与相关权重相加来得到最终输出。

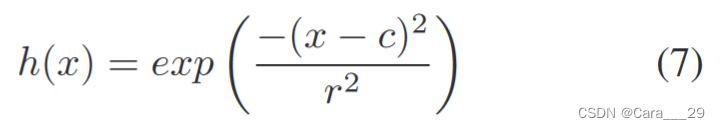

A typical RBF is a Gaussian distribution, in case of a scalar input, and is given by:

Where c is the center, and r is the radius parameters. A Gaussian RBF distribution decreases as the distance from the center increases.

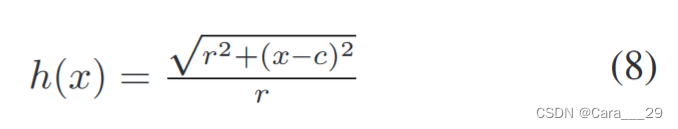

For a multiquadric RBF with a scalar input can be shown as:

In this case the Gaussian RBF increases with increase in the distance from the center.

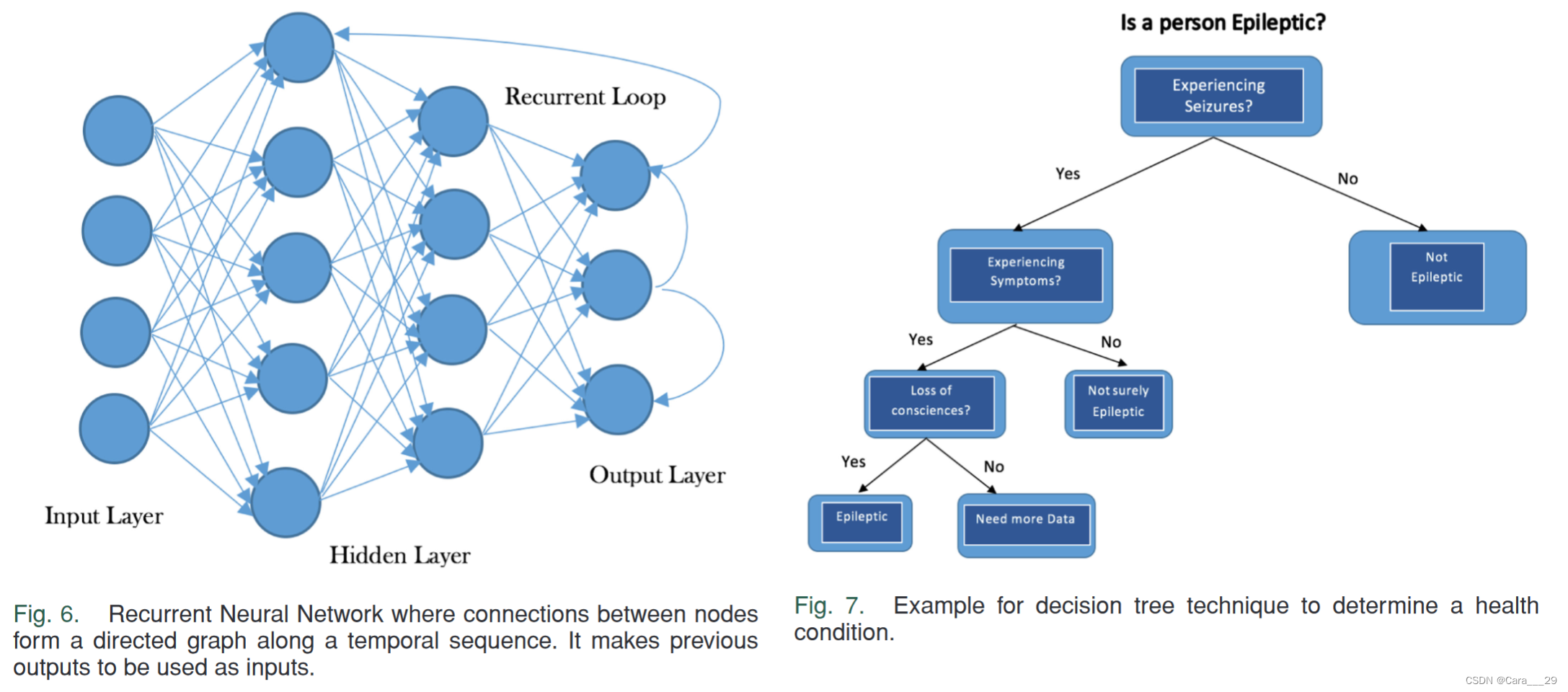

3)递归神经网络:顾名思义,RNN是一种人工神经网络,它在不同的节点之间有连接,输出流到特定的节点有特定的指定方向。在这里,数据流可以形成循环,以便按预期将数据反馈给特定节点。该技术如图6所示,图6显示了信息从一层到另一层以及到特定节点的反向传播。

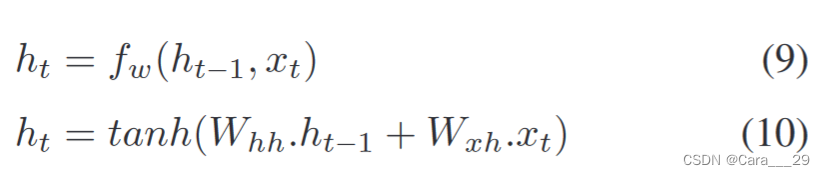

为了理解RNN的工作原理,定义从前一个状态到新状态的转换是很重要的。设t是输入向量,t是新的状态,t-1是之前的状态。RNN被观察到是输入向量和前一个状态的函数,这将使我们到达新的状态Ht。我们可以通过获得权重函数Fw并实现它来找到输出函数Yt来表示一个简单的香草版本的RNN。这可以表示为:

通过应用tan双曲函数前状态相关权值的点积和相关权值与输入状态的点积,我们将得到新状态的值。我们可以将最终输出函数设为:

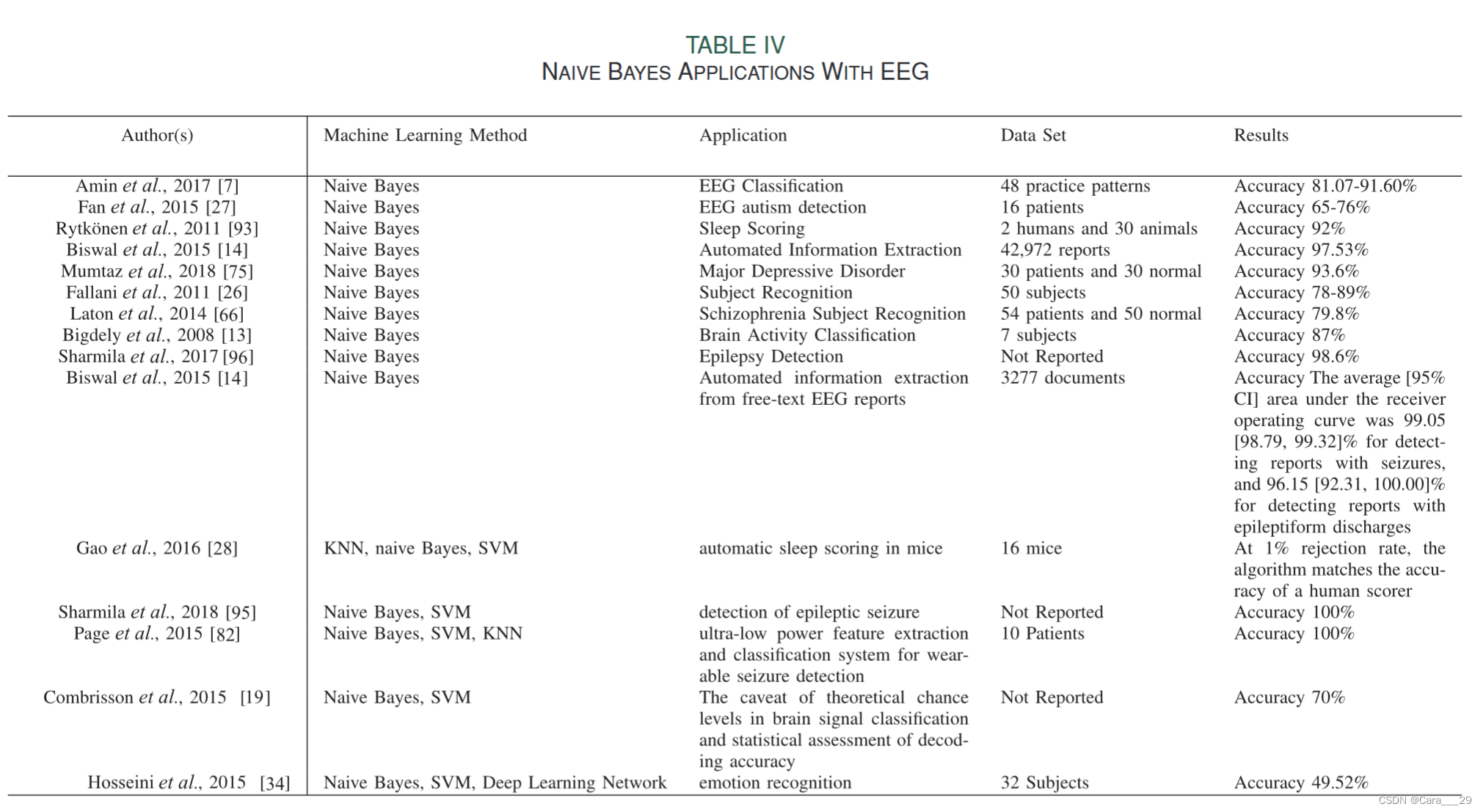

F. Naive Bayes

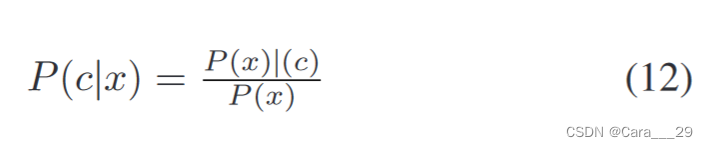

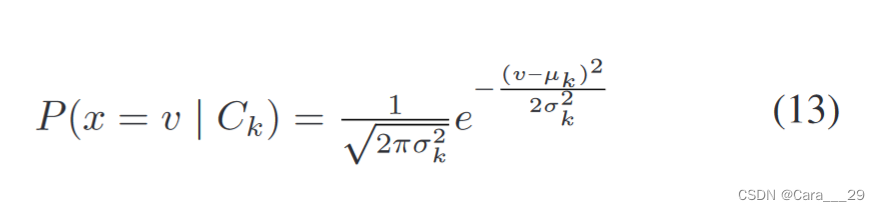

朴素贝叶斯分类器是一种流行的文本分类方法,它将贝叶斯定理应用于基于简单训练特征的数据分离。本质上,该模型将标签分配为有限集合内的特征向量。虽然本质上很简单,但经过适当的预处理,它可以与上面讨论的SVM等更高级的方法相匹配。朴素贝叶斯[45]方法的一个缺点是,它认为所有的特征向量是相互独立的,而不考虑任何真正的相关性。它的主要优点是,它只需要少量的训练数据集就可以开始正确估计分类所需的参数。贝叶斯方法可以实现几个模型。其中最常见的是概率模型。在该模型中,特征由向量表示,并为给定的结果或情况分配概率。事件模型可以分为两大类:高斯朴素贝叶斯和多项朴素贝叶斯。在具有连续值的数据集中,一个好的假设是它遵循高斯分布。使用这种方法,贝叶斯方法根据曲线分配概率。多项事件模型表示由多项产生的特定事件的频率,通常为直方图。一个潜在的问题是当一个特征在数据集中根本没有出现时。这导致所有估计值的倍数为零。它可以用伪计数来纠正,以平滑数据集中的任何异常值[91]。

The probabilistic Naive Bayes Model

The Gaussian Naive Bayes Model

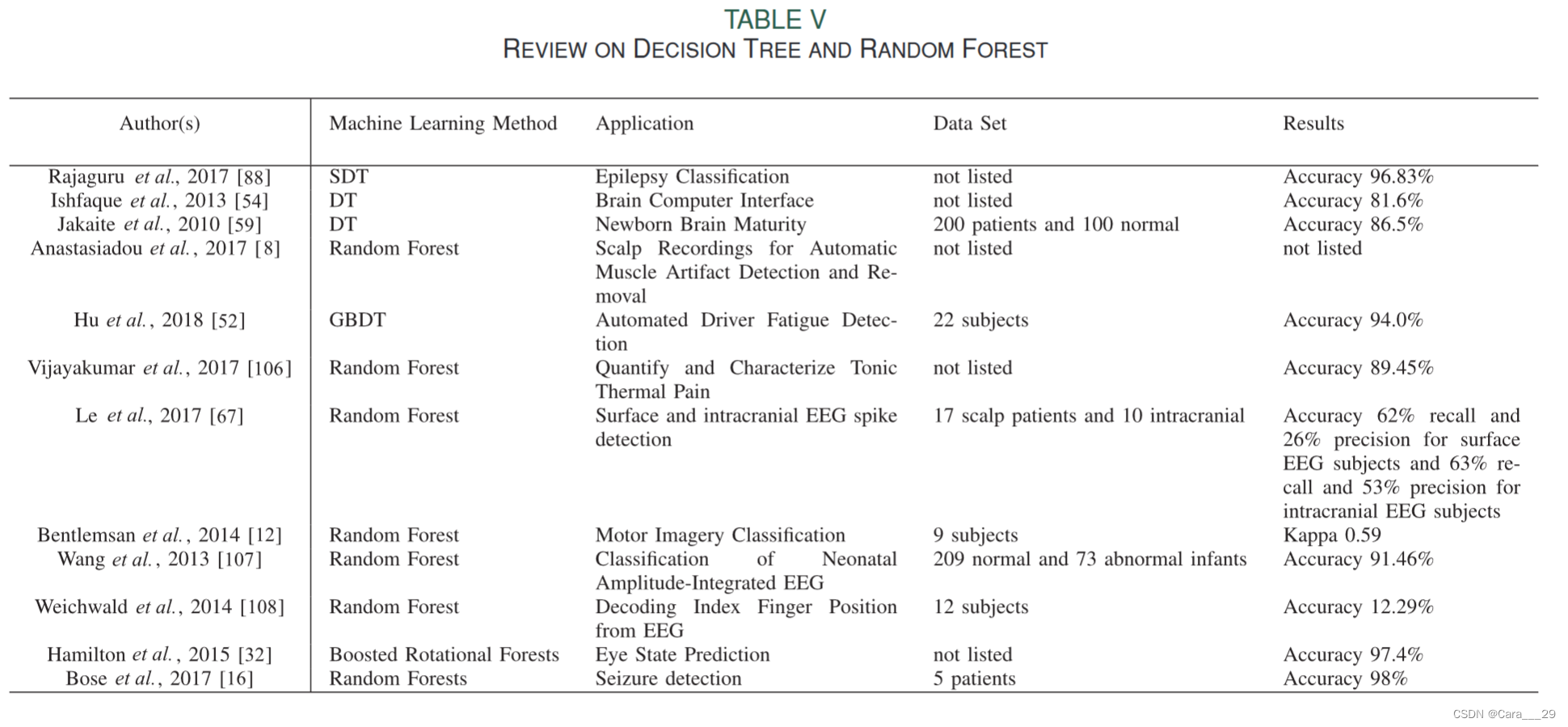

G. Decision Tree and Random Forest

决策树使用关于项目特征的问题来对数据进行分类。每个问题都可以表示为一个节点,其中每个问题的答案都有一个子节点。这创建了一个层次结构,换句话说,就是一个树。最基本的树是一个二叉树,其中每个问题的答案都是“是”或“否”。因此,每个父节点问题都有一个yes和no子节点。数据通过树进行排序,从最顶部的节点(也称为根节点)开始,然后向下移动到叶子节点(即没有子节点的节点)。所采取的路径取决于数据的特征。一旦数据到达叶,就可以将其分类到与该特定叶相关联的类下[64]。

决策树的优点是它们很简单,并且可以很容易地与其他决策技术相结合。决策树的缺点是它们在某种程度上是不稳定的和不准确的,特别是在不同的级别大小下,这会导致对更大级别的偏差。

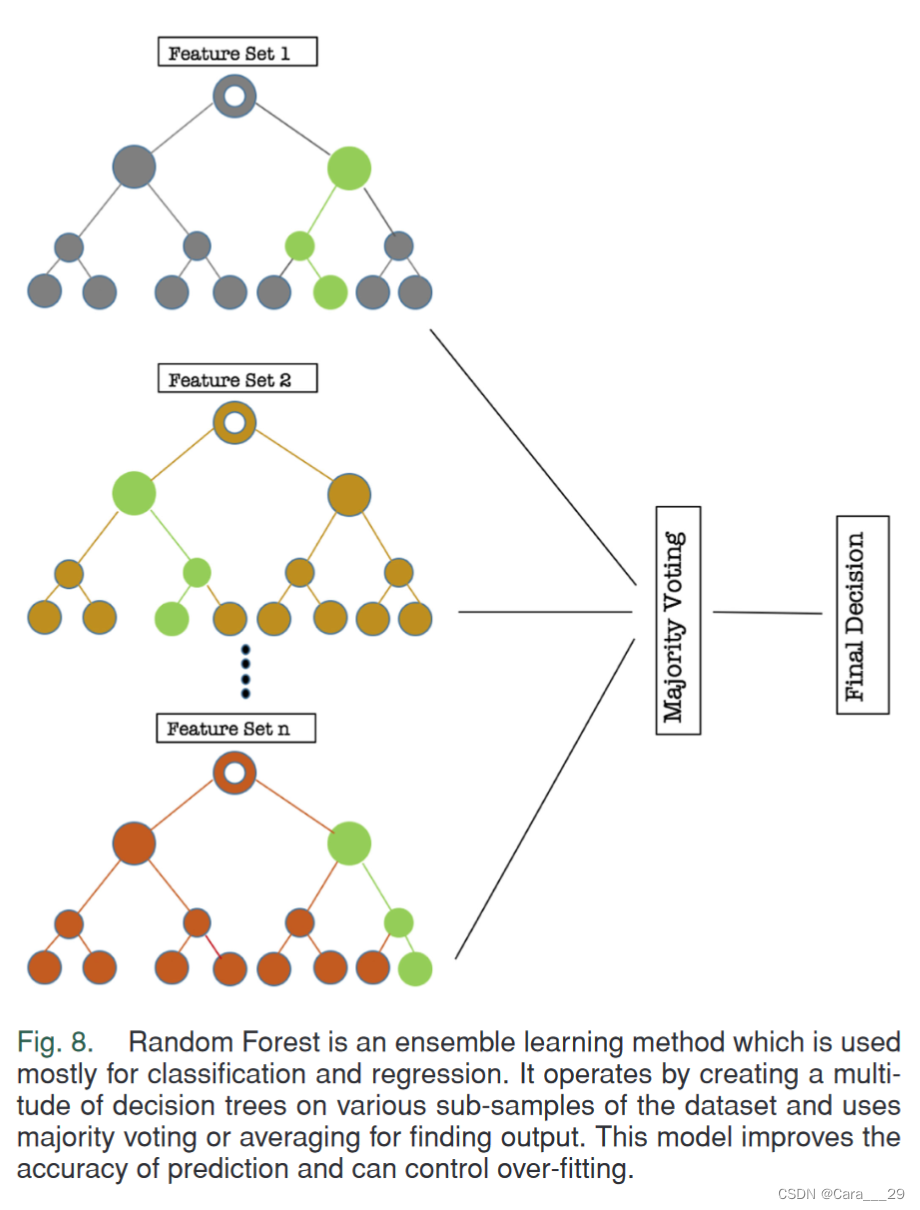

在机器学习和不同分类和分布方法的研究中,我们遇到了随机森林技术,它既可以用于数据分类,也可以用于回归操作。顾名思义,随机森林通过产生大量的决策树,并通过进行bagging操作进行训练,将多个决策树或模型组合在一起,以达到更稳定和准确的数据预测。随机森林为结构化的数据创造了额外的随机性;也就是说,它不是从给定的集合中寻找最重要的特征,而是在一个定义的特征子集的随机集合中寻找最佳特征。这将产生更加多样化和更好的结果模型。

在随机森林中,所有树的解被总结,分类通过多数投票进行,选择最合适的分类。然而,如果发现树是不稳定的,数据集的微小变化可能会改变整个决策树,我们可能会以错误的分类告终。

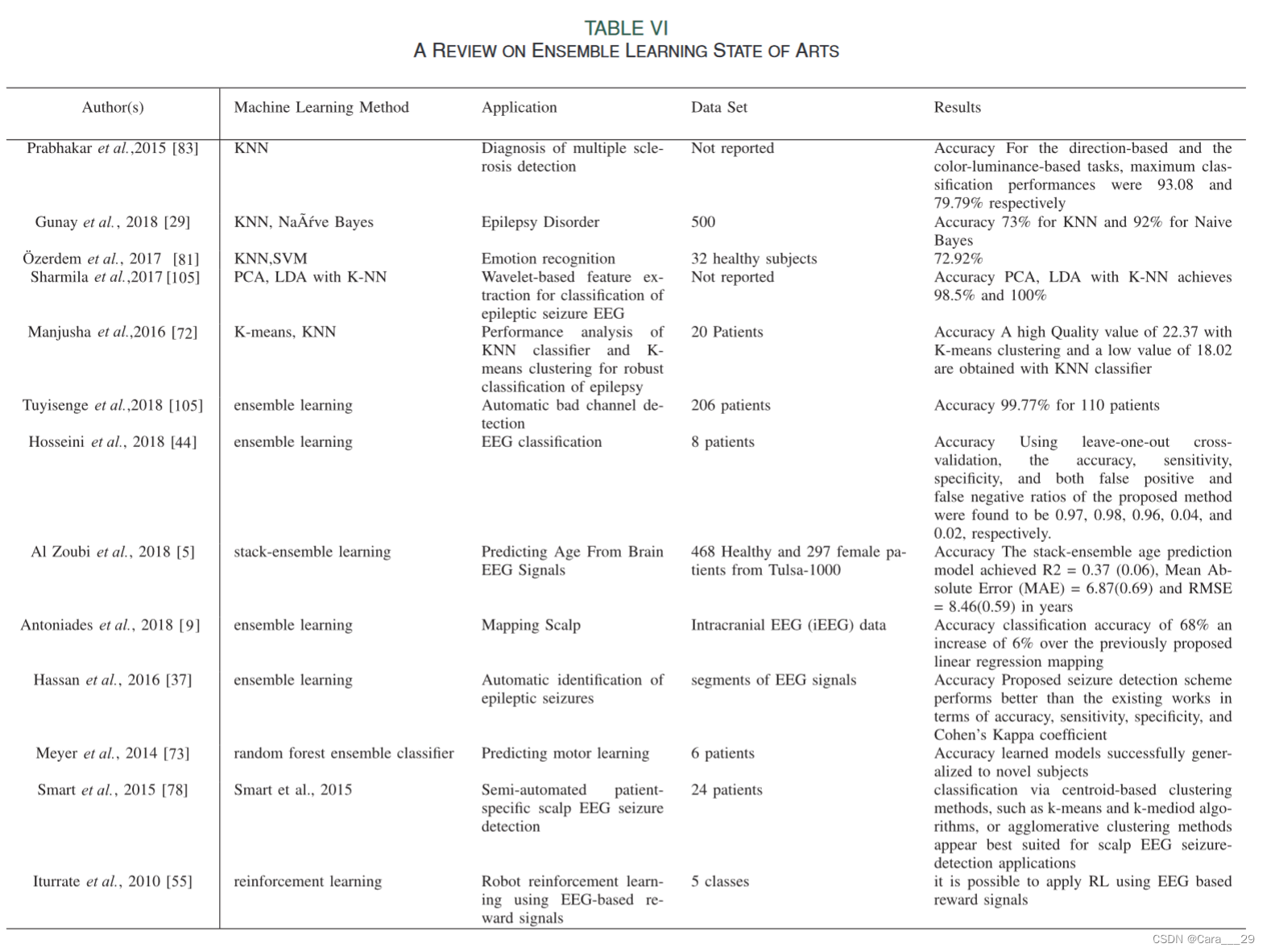

H. Ensemble Learning

集成学习是一种监督学习算法。顾名思义,集成学习集成了许多不同的算法,使模型具有更好的预测性能。一般的想法是通过组合从不同的多个模型接收到的决策来提高整体性能。它基于多样性的概念,与单一模型相比,考虑更多的模型来获得同一问题的结果。这给出了一组假设,这些假设可以结合起来获得更好的性能。所有的单个模型被称为基本学习器,当它们组合在一起时被称为集成。合奏通常比组成合奏的基础学习器要好。集成学习可以应用于医学、欺诈检测、银行、恶意软件和入侵检测、人脸和情感识别等领域。

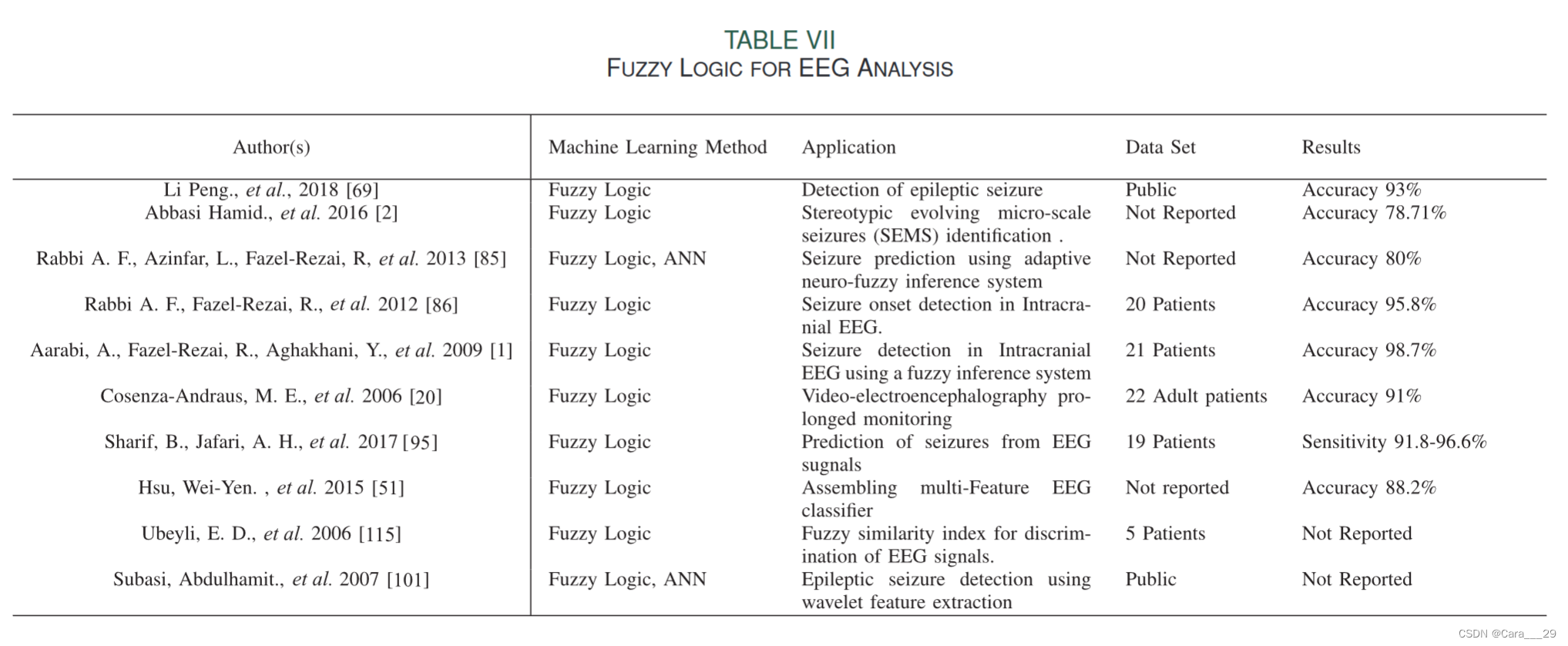

I. Fuzzy Logic

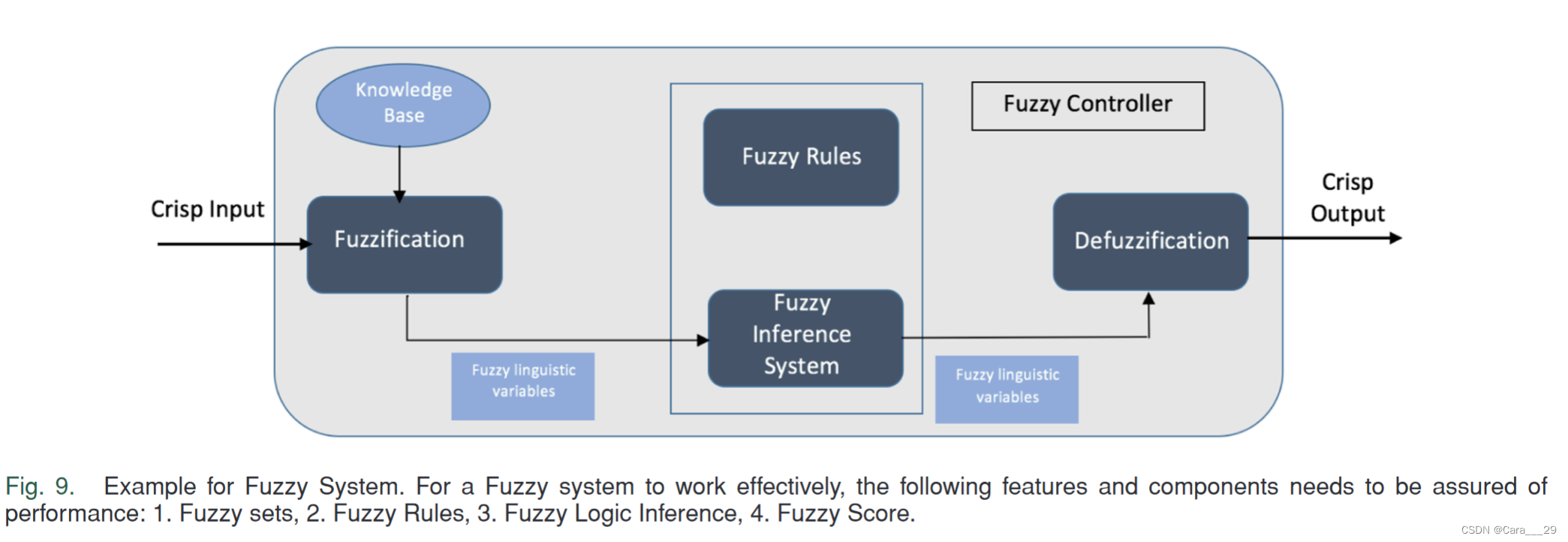

几乎每台家用机器或设备(如空调、洗衣机等)都是在模糊逻辑的概念上运行的。这种逻辑被馈送到通常称为模糊系统控制的控制系统中,其中每个组件都被设计为运行并改变另一个物理操作系统,以实现所需的功能。为了理解模糊系统是如何工作的,有必要分析系统需求和使用模糊系统的意图[20]。为了使系统成为一个基于知识的功能元素,具有应用人类认知过程(如推理和思考)的能力,必须有一个稳定的组件,可以根据给定输入变量集的真实程度提供输出。图9显示了一个典型模糊系统的分解。为了使模糊系统有效地工作,需要确保以下组成部分的性能:

1)模糊集:认为模糊集对应于成员函数,成员函数定义在变量设置的模糊空间中。成员函数的特征是在定义良好的模糊集中提供对任何元素的隶属度。然后成员函数赋予这些元素一个介于0到1之间的数值,其中0表示对应的元素不是模糊集中的元素,1表示对应的元素是模糊集中的元素。

2)模糊规则:模糊逻辑的工作方式是由一组应用的模糊规则定义的,这些规则决定了IF-THEN规则指定的输出。观察IF-THEN规则来创建由模糊逻辑组成的条件语句。例如,IF-THEN假设其中X和Y是预期项,并通过范围为U和v的模糊集项进行评估。这将语句分为两部分,即先行项和后项。如果先行词是指定项X和U的前句,则后句应该以Y和v结尾。这些组合形成了一个规则:如果X是U,那么Y是v。然而,这些规则是基于自然语言和模型表示,基于给定的模糊集和逻辑。

3)模糊逻辑推理或模糊推理系统(FIS):一旦定义了一组模糊规则和隶属函数,FIS就可以通过所提供的数据或知识类型来实现过程仿真和控制。FIS系统通常分三个阶段运行:在第一阶段,提供给系统的数值输入变量被映射为各自模糊集的兼容性程度。这就是所谓的模糊化过程。这个过程允许系统用模糊可读的语言术语来表示输入和输出。在第二阶段,系统根据每个输入变量的强度来处理规则。第三阶段,将得到的模糊值转换回数值,进行去模糊化处理。因此,这个过程将模糊域输出映射回清晰域,从而使输出清晰。

4)模糊分数:对于已知由系统生成的所有个人输入分数,FIS系统以模糊分数的形式输出。FIS系统通过考虑所有已定义的模糊约束和隶属函数来计算模糊分数。分数取决于应用的规则类型和输入变量的类型。FIS根据模糊规则标准为每个输入变量分配一个分数。

由于机器学习的主要应用是脑电信号的模式识别,模糊逻辑可以用于确定不同阶段脑电信号分类的正确识别率。然而,采用模糊逻辑与神经网络的结合,通常称为神经模糊系统,其中系统可以应用模糊参数(如模糊集,模糊规则)并将其与神经网络近似技术相结合进行广泛的分析。NeuroFuzzy系统[85]被发现在医疗状况诊断、密度和回归估计、模式识别和数据分析方面非常有益。

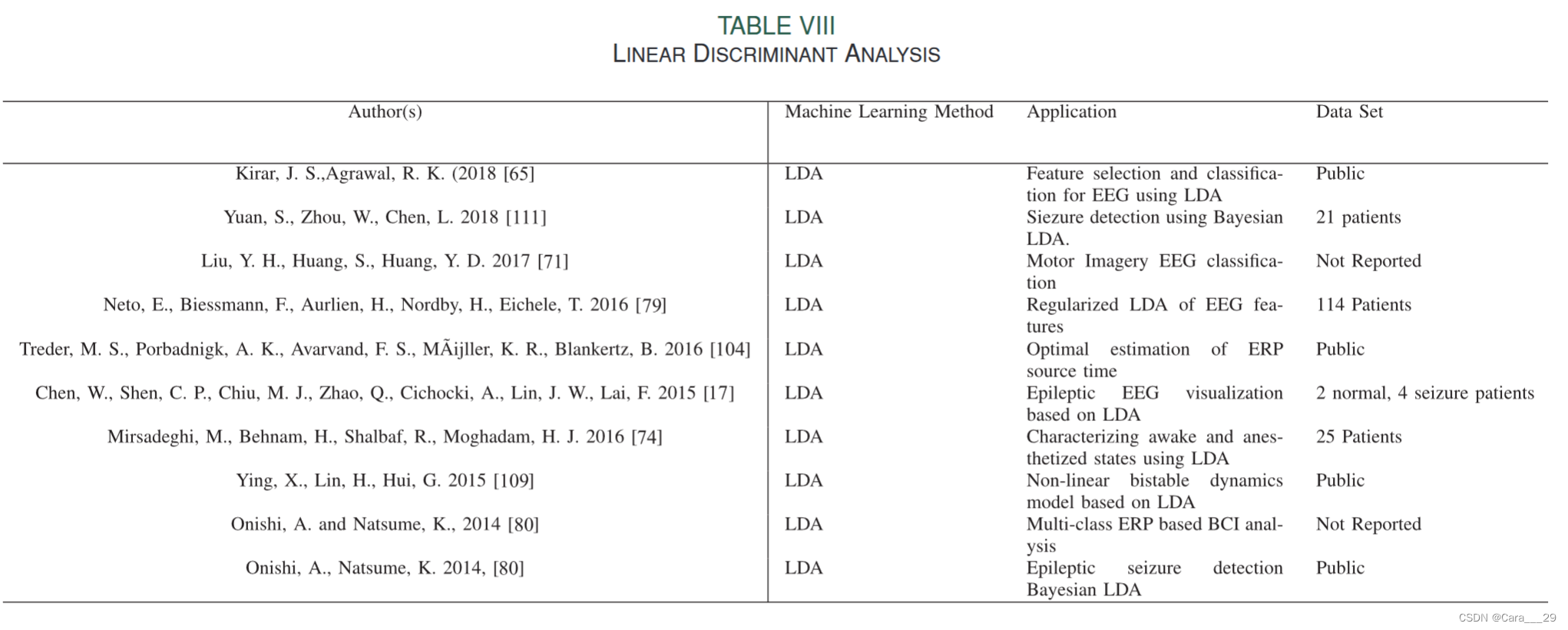

J. Linear Discriminant Analysis

对于具有广泛随机变量选择的给定数据集,有必要进行降维,将参数数量减少到特定的主变量,以降低数据集的维空间。由于有许多可能的方法对数据进行分类,降维技术通过两种技术实现:主成分分析和线性判别分析。PCA和LDA具有相似的功能和应用。然而,LDA技术可以处理类内频率不相等的情况,突出的因素是它提供了类间方差和类内方差之间的高比率和显著分离。PCA与LDA的主要区别在于,PCA更适用于特征的分类,LDA更适用于数据的分类。

最常用的降维技术是线性判别分析(LDA)。这种技术背后的主要标准是在不同类别之间提供良好的可分离性,并避免曲线的过拟合。这将显著降低计算成本,并提供更好的分类,通过将给定的n维样本特征空间投影到精确和更小的特征子空间。在典型的PCA分析中,数据集的位置、形状和结构完全改变。但对于LDA,该技术在转换到不同的较小空间时保持数据集的位置和形状。这是通过在变换后的空间上定义一组向量来区分和分离。在LDA技术中,这通常通过两种不同的方法实现:

1)类独立变换:该方法主要侧重于增加总体方差与类内方差的比值,只使用一个准则来优化数据集变换过程。这将转换所有必要的数据点,而不考虑它们的类。在这里,每个类被观察到与所有其他类是分开的。

2)类相关变换:这里的主要目标是增加类变量与类内变量的比值,为分类提供足够的可分性范围。

针对脑电信号分析和脑计算接口的应用,探索对多变量数据集进行有效分离和隔离的先进方法。接收到的脑电信号可能会受到噪声干扰而失真,为了获得准确的结果,必须对其进行有效的分离。为此,正在实施降维技术,以减少数据集并将不需要的信号频率与感兴趣的信号频率分离。

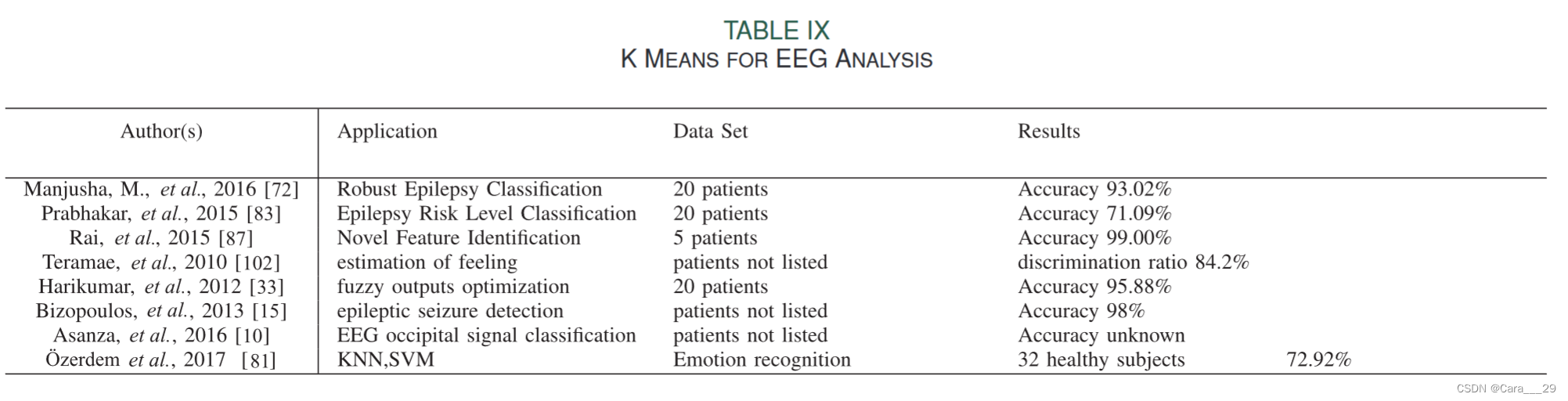

K. K-Means

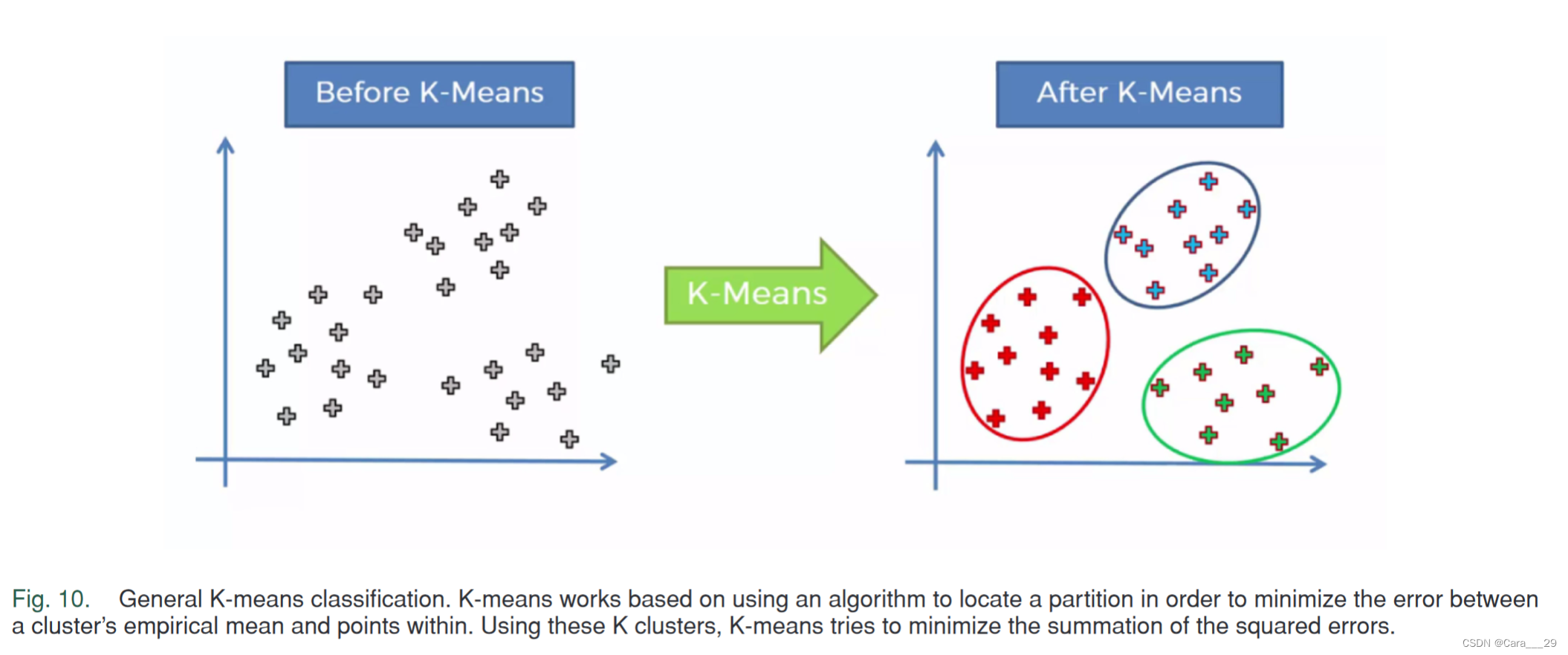

K-means是一种用于聚类问题的无监督学习方法。它的工作方式是使用一种算法来定位一个分区,以最小化集群的经验平均值与内部点之间的误差。使用这些K簇,K-means试图最小化平方误差的总和[57]。

有两种常用的初始化方法:Forgy和Random Partition。使用Forgy方法,从数据集中随机选择K个观测值。然后将这些观测值用作初始均值。对于随机分区方法,首先为每个观测值分配一个随机聚类。然后随着初始均值的计算更新,使其位于聚类的中心。

K-means的优点之一是在K相对较小的情况下易于实现高计算速度。K-means的一些缺点包括初始条件对最终输出的高度重要性、对缩放的敏感性以及数据顺序与最终结果之间的相关性。

L. Reinforcement Learning

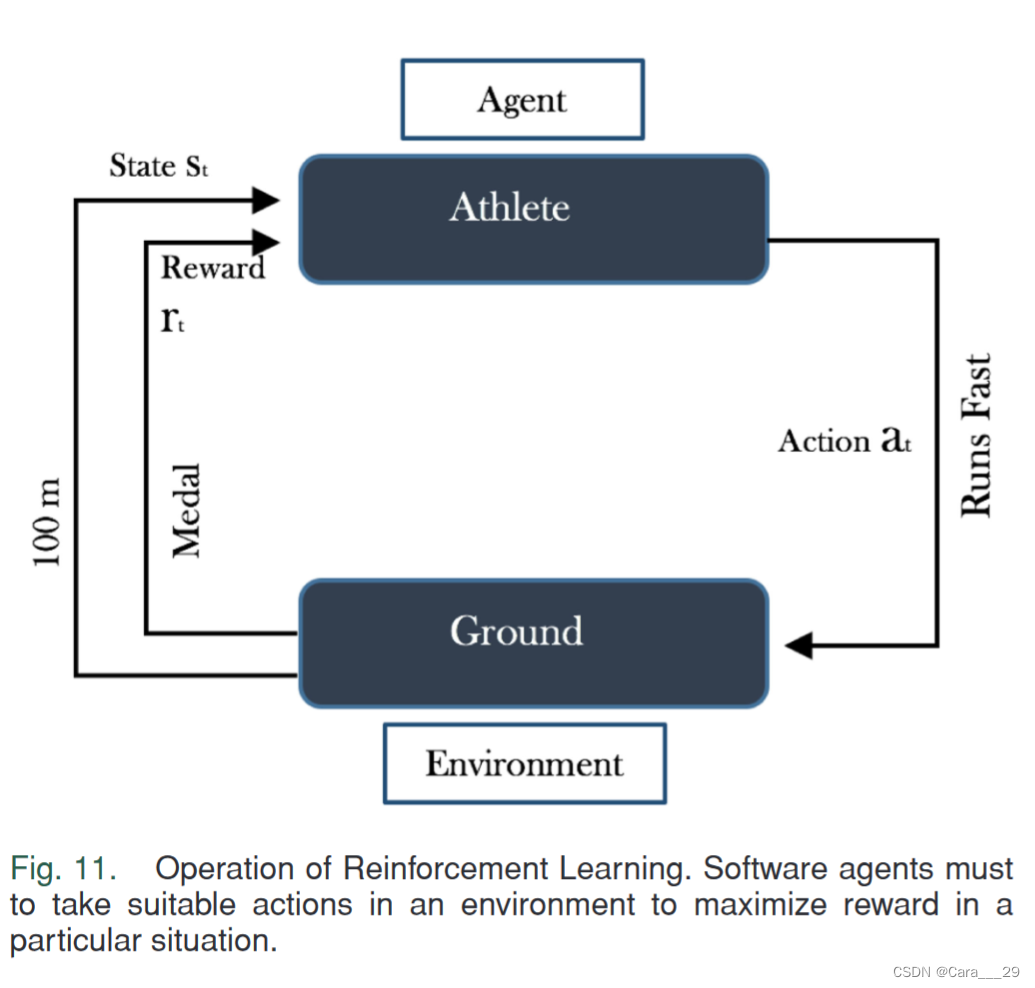

现代脑机接口(BCI)系统的最大问题是,这些系统在控制BCI方面的性能因素可能并且将会随着时间的推移而显著下降。由于这个问题,控制BCI的必要性增加了,而这背后的动机因素很低。为了消除这种情况并找到解决问题的解决方案,我们必须启用一个来自主体的持续反馈系统,并将其提供给强化学习代理,以训练和支持案例找到准确的解决方案。这里的目的是使用RL代理来控制给定任务的动作,随着过程的进行,来自代理的支持影响减少,主体将接管控制机制。当主体接管控制时,标准是维持主体的状态,并通过实施奖励系统来衡量表现,奖励系统会根据主体在没有任何代理在场的情况下对任务的控制程度给予一定的分数。强化智能体的主要目标是在不确定的条件下与被试互动,并最大化被试的长期数值奖励,基本上是将被试从一种状态带到另一种状态。例如,如果在每个状态St中,存在一个代理,它可以采取行动At到达新的状态St+1。通过增加智能体的长期数值奖励,智能体将获得在不同状态下学习和交互的能力。如图11所示。

使用RL模型的优点之一是它保持了探索和开发之间的平衡。其他监督算法无法实现这种平衡。在脑电分析应用方面,RL模型在脑机接口系统的控制机制方面不断取得进展,在状态转换和奖励机制之间保持平衡,以实现最佳功能。

M. Combination of Methods

方法的组合包括使用两种或两种以上的机器学习算法,以利用每种方法所具有的独特特征。这允许多模态算法提取额外的所需特征[49]。多模态集成的意义在于,它允许主要使用现有方法进行高分辨率分类[21],[46]。此外,该分辨率通常高于单独使用单个方法的分辨率[34]。然而,多模态提取并非没有局限性。由于算法的复杂性增加,可能难以确定真正的准确性,因为它不能直接与现有方法进行比较。这种方法在脑电图中的一个应用是多发性硬化症患者的诊断。本文采用t检验[40]、[42]、[45]和Bhattacharyya进行特征提取作为预处理的一部分。随后将KNN和SVM结合作为主要的分类算法。这导致了93%的总准确率[103]。虽然上面的其他部分有专门的文献综述表,但我们希望引起对多模态分析的关注,因为上面的一些文献已经展示了方法组合的应用[37]。

III. CONCLUSION

由于癫痫发作的检测过程是一个有点复杂的生物医学情况,它已经对利用机器学习过程作为解决方案产生了大量的关注[78]。最近关于脑电图信号分析的文献调查大多提出了多种学习模型和不同的人工神经网络算法,如径向偏倚函数、递归神经网络和矢量量化来解释给定脑电图信号中的癫痫发作模式。这个问题也被瞄准并使用其他模型来解决,如支持向量机(SVM)、自适应神经模糊干扰系统(ANFIS)、自适应学习和时频分析。

回顾已发表的癫痫脑电图分析论文,有以下几点值得注意。降维和选择已被确定为使用机器学习方法进行脑电图分析的一个有趣话题[11]。此外,小波变换和自回归方法在EEG的机器学习中也发挥了关键作用,如以下研究[6]。subbasi在[101]中利用自适应神经模糊推理系统将小波特征提取用于癫痫发作检测。多尺度PCA等去噪方法在脑电图分析中的作用见[62]。可以使用PCA、ICA、LDA等数据准备方法来提高分类精度[30]。集成方法和组合分类器在脑电图分析中表现良好,如以下研究[61]。

神经成像和电诊断分析中深度学习模型的结合使得来自多种模式的大量数据能够相互关联[41]。通过监督和无监督学习任务,这些模型已被证明比当前最先进的分析技术执行得更好、更快。在EEG分析中使用深度学习的最新进展和优势可以为大量数据提供更准确和更快的分析。Hosseini等[35],[39],[47]提出了一种基于云的EEG分析方法。在[48]中,卷积神经网络(CNN)已被开发用于脑电图分析。在[43]中,针对脑电分析中的CNN和堆叠自编码器深度学习结构,开发了由PCA、ICA和DSA分析组成的优化模块。

利用小波变换系数和数值自回归模型来识别脑电信号的变化和行为。这些系数被作为输入,并与不同的机器学习算法相结合,如多层神经网络、K-means、支持向量机、k近邻和朴素贝叶斯;将脑电图信号分解成机器可识别的部分,以提取和确定触发癫痫发作的功率点。

由于有多种技术涉及机器学习来分析给定的EEG信号集,因此需要评估给定应用的最适合技术。每个模型都有一个关于应用程序类型和主题数据集的特定用例。至于我们在这里的研究课题,我们关心的是分析波形来确定输出。在这里,我们将看到如何将每种不同的ML模型用于预期用例:

K-NN分类器可以用于数据的回归和分类,对于我们的目的,它可以用于识别和分类不同的采集到的EEG信号,并找到最接近所需分类线的可能输出点,以可能检测异常。另一方面,人工神经网络具有分离EEG波形的物理形状并将其分割成段的能力。通过分析波形,这些部分被赋予相应的特定权重值,并通过对最终方程施加偏差来确定输出。最终选择的偏置将输出降低到期望的范围。随着涉及的数据越来越多,隐藏层中的交互次数也会增加。因此,根据问题的类型和所考虑的数据量,在选择适当的流程时必须做出适当的选择。

3769

3769

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?