(致力结合理论知识与互联网前沿应用场景,给读者全方位的收获)

摘要:

最近多目标模型越来越受到重视,特别在工业界有很好的应用。本文通过讲解MMOE的原理,并根据笔者在工作中应用MMOE的经验,来给大家引出这篇博文。

多目标模型的意义:

现实世界中,我们的业务目标往往不是单一的。

比如购物APP中,我们不仅仅希望你浏览商品,也希望你购买商品,甚至分享商品,评论商品。

比如短视频推荐,我们不单希望你看视频,也希望你点赞、评论、分享视频,还希望你能关注发布的作者。

因此多目标模型的出现,就可以让我们的场景同时服务到这些目标。于此同时,对于一些正样本稀疏的目标,多目标模型甚至可以让他们的目标实现远超预期。

为什么要使用MMOE实现多目标:

1、MMOE通过特殊的模型结构达到了一个模型实现多个目标的能力

2、MMOE通过模型结构的优化使各项目标都很好的实现

3、MMOE可以通过网络共享帮助正样本稀疏的目标更好地达成

论文标题和链接:

论文地址先供上,想硬撸原文的同学请享用:

标题:Modeling Task Relationships in Multi-task Learning with Multi-gate Mixture-of-Experts

链接:https://dl.acm.org/doi/10.1145/3219819.3220007

MMOE网络结构

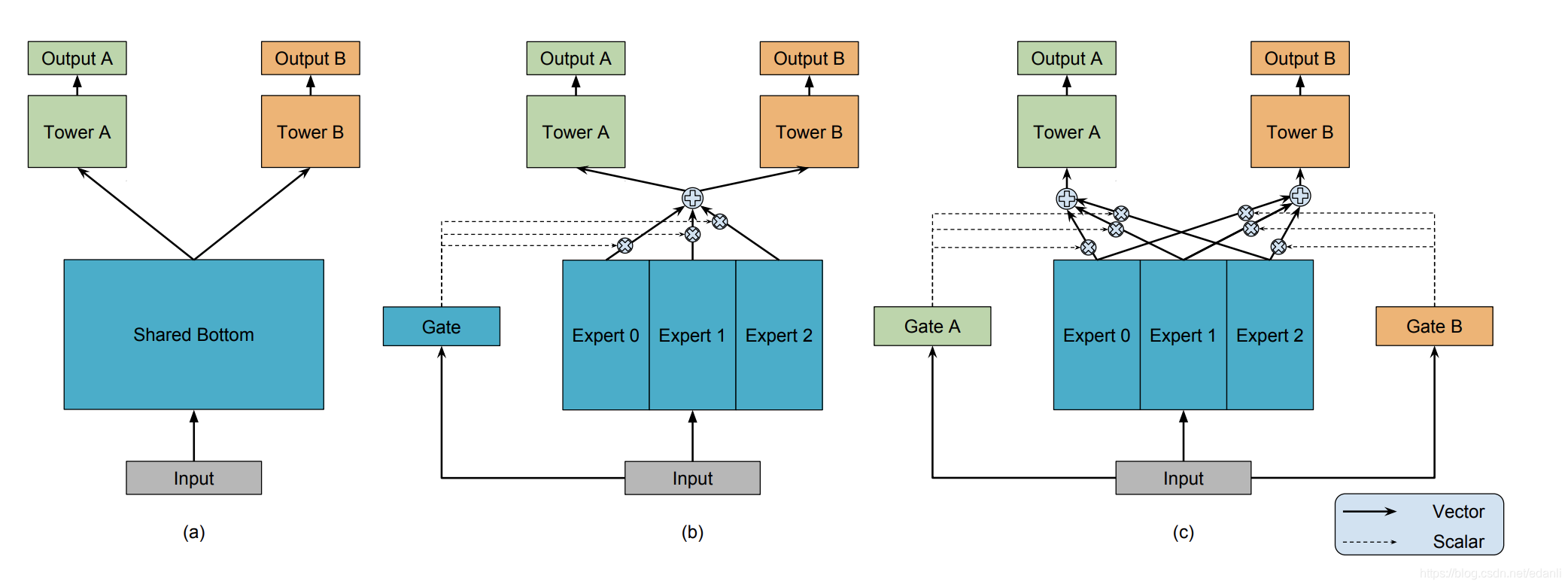

MMOE的网络结构衍化图,衍化的过程是为了更好地解决多目标问题。图( a ) 到

本文探讨了MMOE(Multi-gate Mixture-of-Experts)在多目标学习中的应用,解释了其在网络结构上的优化如何解决不同目标差异化问题。通过MMOE模型,可以在多个业务目标中实现更好的性能,尤其是在正样本稀疏的情况下。论文和实际场景优化展示了MMOE在处理大规模实时数据时的有效性,如使用不同网络结构的expert和引入公用与私有expert机制。

本文探讨了MMOE(Multi-gate Mixture-of-Experts)在多目标学习中的应用,解释了其在网络结构上的优化如何解决不同目标差异化问题。通过MMOE模型,可以在多个业务目标中实现更好的性能,尤其是在正样本稀疏的情况下。论文和实际场景优化展示了MMOE在处理大规模实时数据时的有效性,如使用不同网络结构的expert和引入公用与私有expert机制。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

342

342

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?