输入

每一条文本由n个维度的embedding表征

文本之间存在一定关联,用邻接矩阵adj表示,其为0-1矩阵,0代表两条文本无关联,1代表两条文本有关联

输出

正常的分类 or 回归

计算逻辑

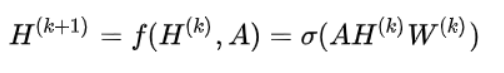

K为网络层数,A为邻接矩阵,W为更新权重,σ为激活函数

乘法:W对应矩阵相乘变换,

加法:A是0-1矩阵,0代表两条文本无关联,1代表两条文本有关联,每个节点(文本)的特征加和通过邻接矩阵进行操作。下图的Z3 = 特征加和(X1, X2, X3, X4)

非线性:σ对应激活函数,添加非线性

确定好输入输出层,构建好文本 or 序列的embedding表示以及邻接矩阵adj,喂入模型训练,训练过程与其他网络无异,就是在不断更新网络的权值。

总结:GCN比CNN多了一邻接矩阵A,A用来表征数据之间的关联,相当于给模型提供了数据之间的关系信息,其余方面与正常的CNN神经网络训练并无差别,就是一个梯度下降的过程。

452

452

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?