目录

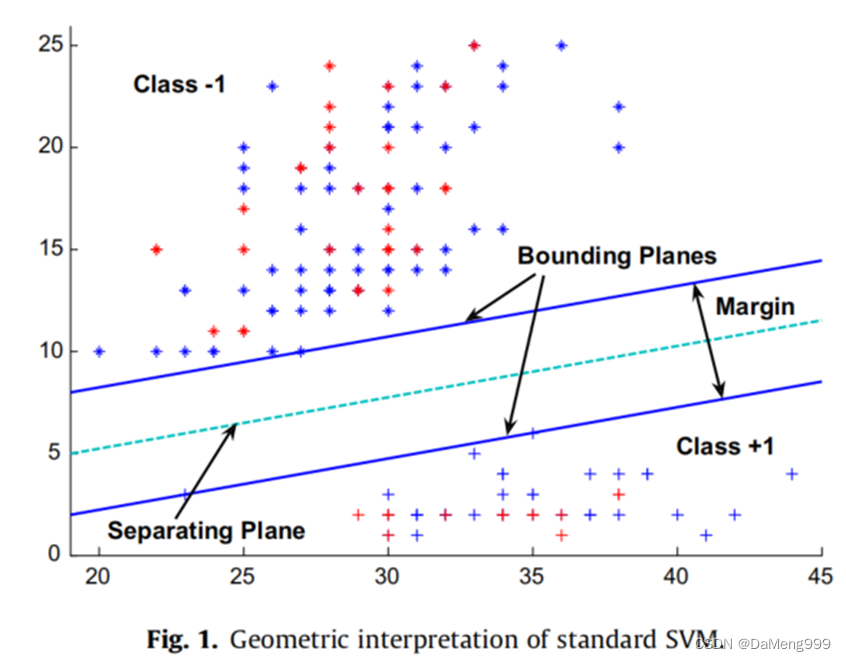

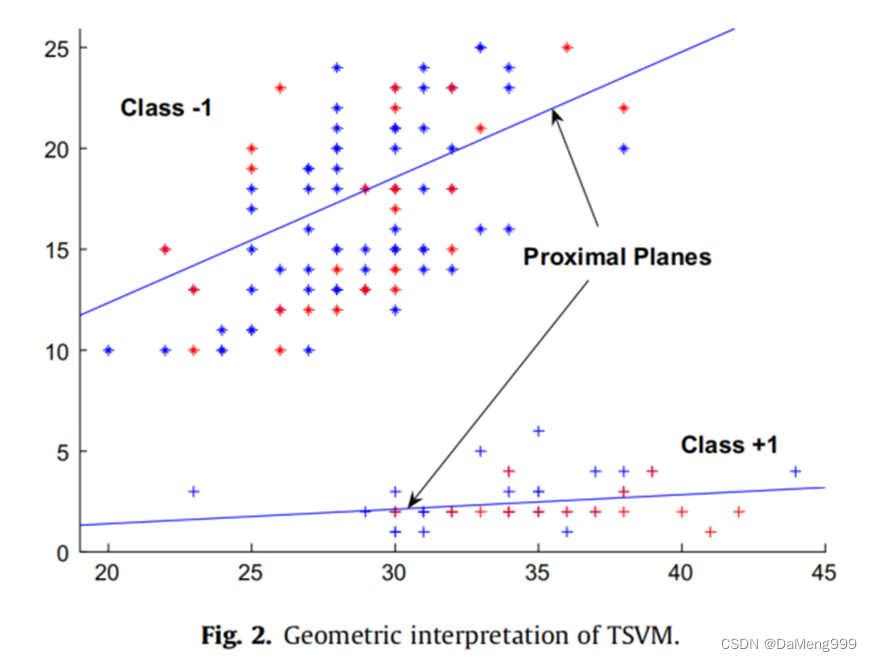

与传统的 SVM 相比,TWSVM 是求解一对非平行的超平面,其中一个超平面离正样本点更近,另一个超平面离负样本点更近;它的模型和 SVM 模型对比结果如下:

1. 原始最优化问题

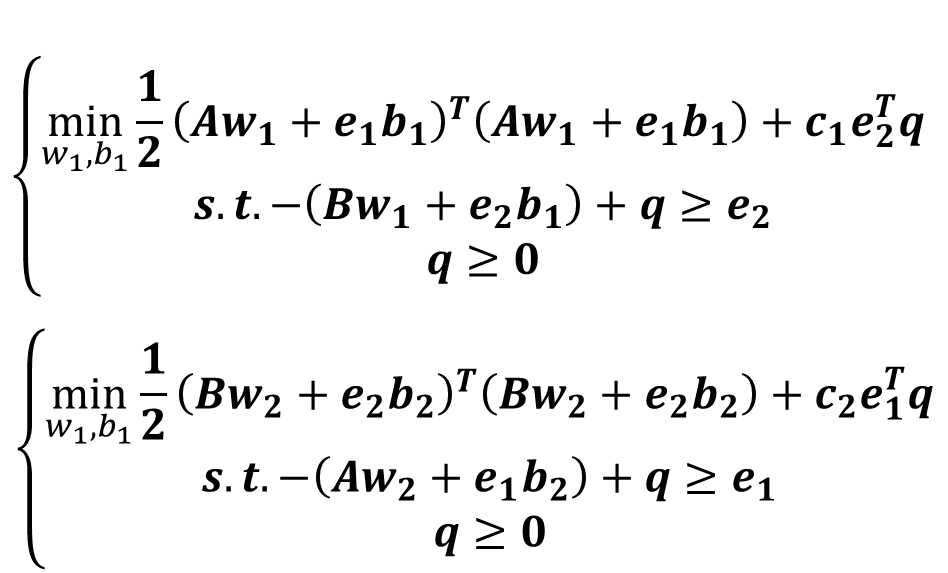

TWSVM 分类器是求解如下一对 QPP 方程:

1.1 符号说明

,是人为调整的超参数;

,

是正样本的数目,

是样本的维数,矩阵

意味着所有的正样本点;

,

是正样本的数目,

是样本的维数,矩阵

意味着所有的负样本点;

是两个超平面的法向量;

是两个超平面的常量;

是全为 1 的向量;

是松弛变量;

1.2 公式说明

在这里以第一个公式为例子,说明该公式的含义:

1.2.1

这个最小化公式的第一项是所有正样本点到第一个超平面的距离的平方和,第二项是误差项;整个公示的含义是最小化所有正确分类样本点到这个超平面的距离的同时使误分类点的误差最小。它的矩阵形式如下所示:

展开后的公式如下所示:

1.2.2

这个不等式约束的含义是,要求负样本点到第一个超平面的距离不严格小于 1,并且允许有一定的误差,允许部分负样本点到第一个超平面的距离可以小于 1 。它的举证形式如下所示:

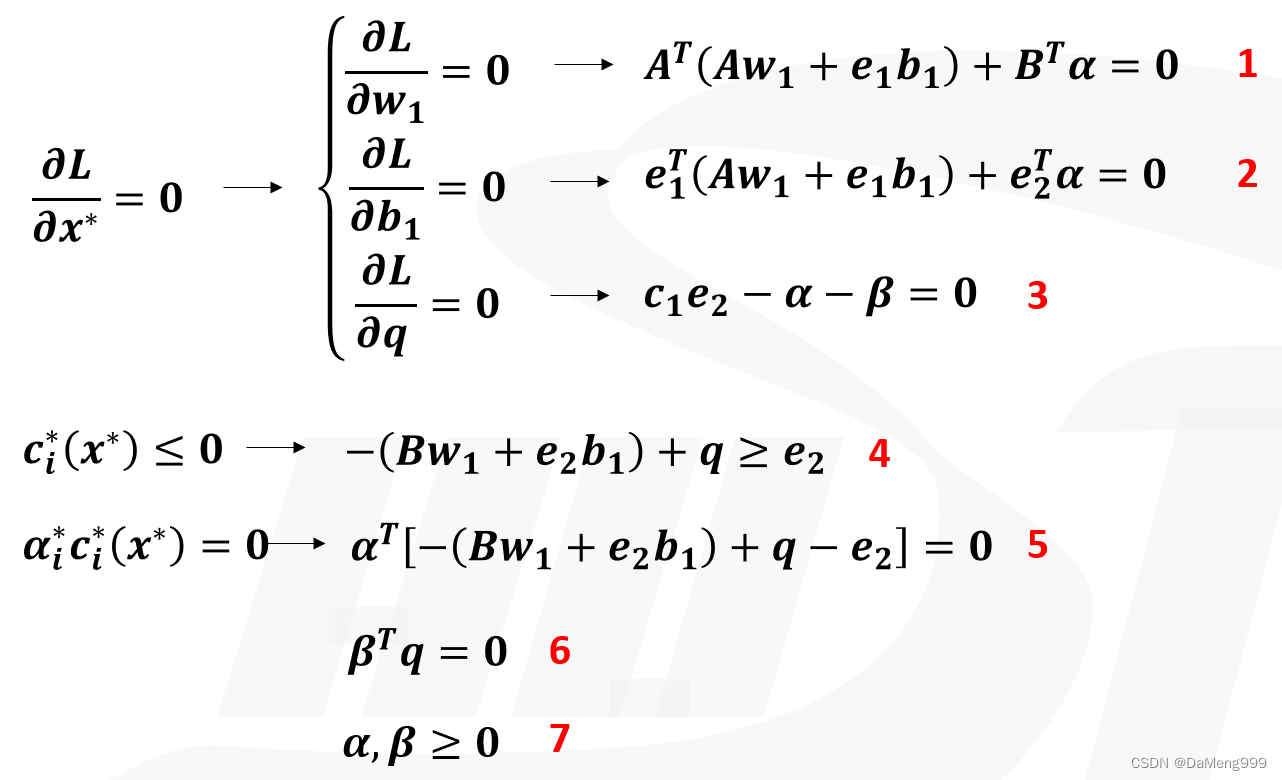

2. 构造对偶问题求解

TWSVM 的原始最优化问题是一对凸二次规划问题,可以通过引入拉格朗日乘子构造拉格朗日函数求解,这里以第一个公式为例,构造得到的拉格朗日函数如下所示:

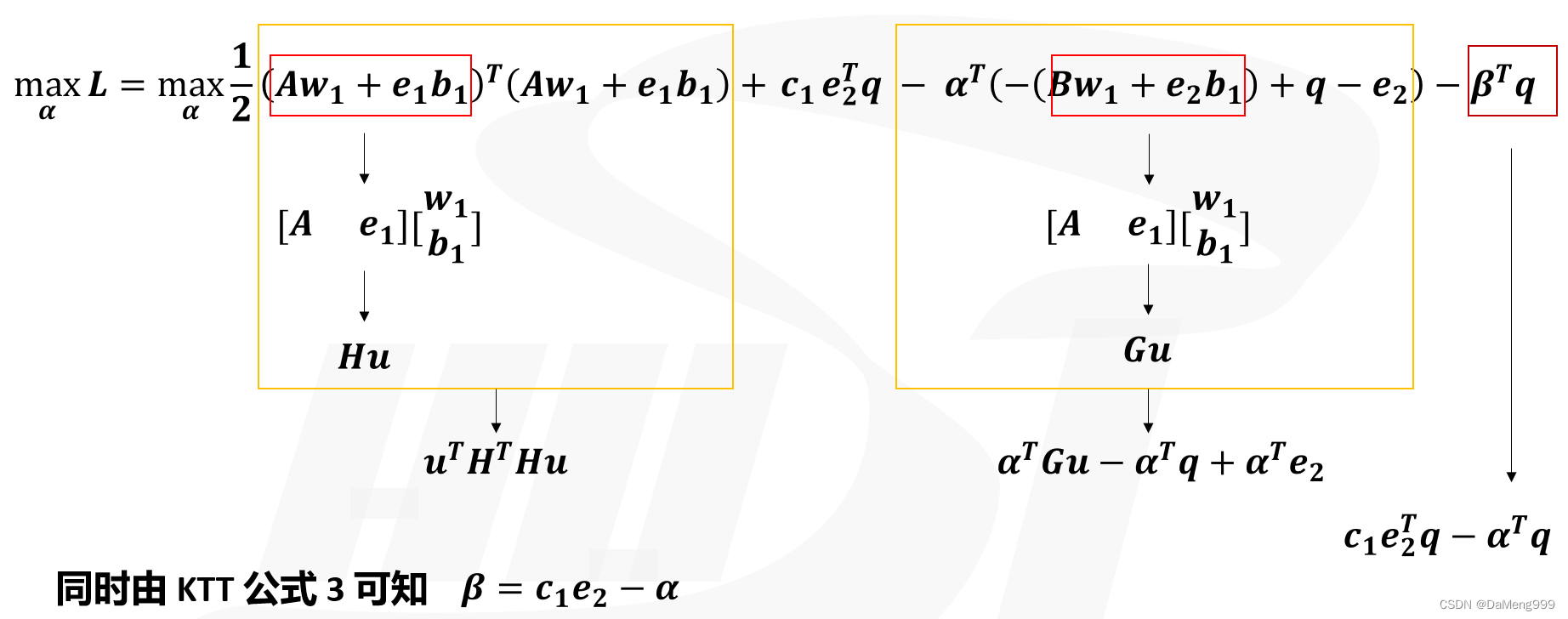

这里引入拉格朗日乘子 ,以向量表示。将矩阵展开得到的公式如下所示:

然后可以转化为对拉格朗日函数求极大极小问题,即

2.1 求极小

2.1.1

在本小节求对 的偏导:

其矩阵表达如下所示:

2.1.2

然后对 求偏导:

其矩阵表示如下:

2.1.3

最后对 q 求偏导:

其矩阵表示如下:

2.2 KKT 条件

由条件 3 和 7 可知:

结合条件 1 和 2 可以得到:

定义:

则有:

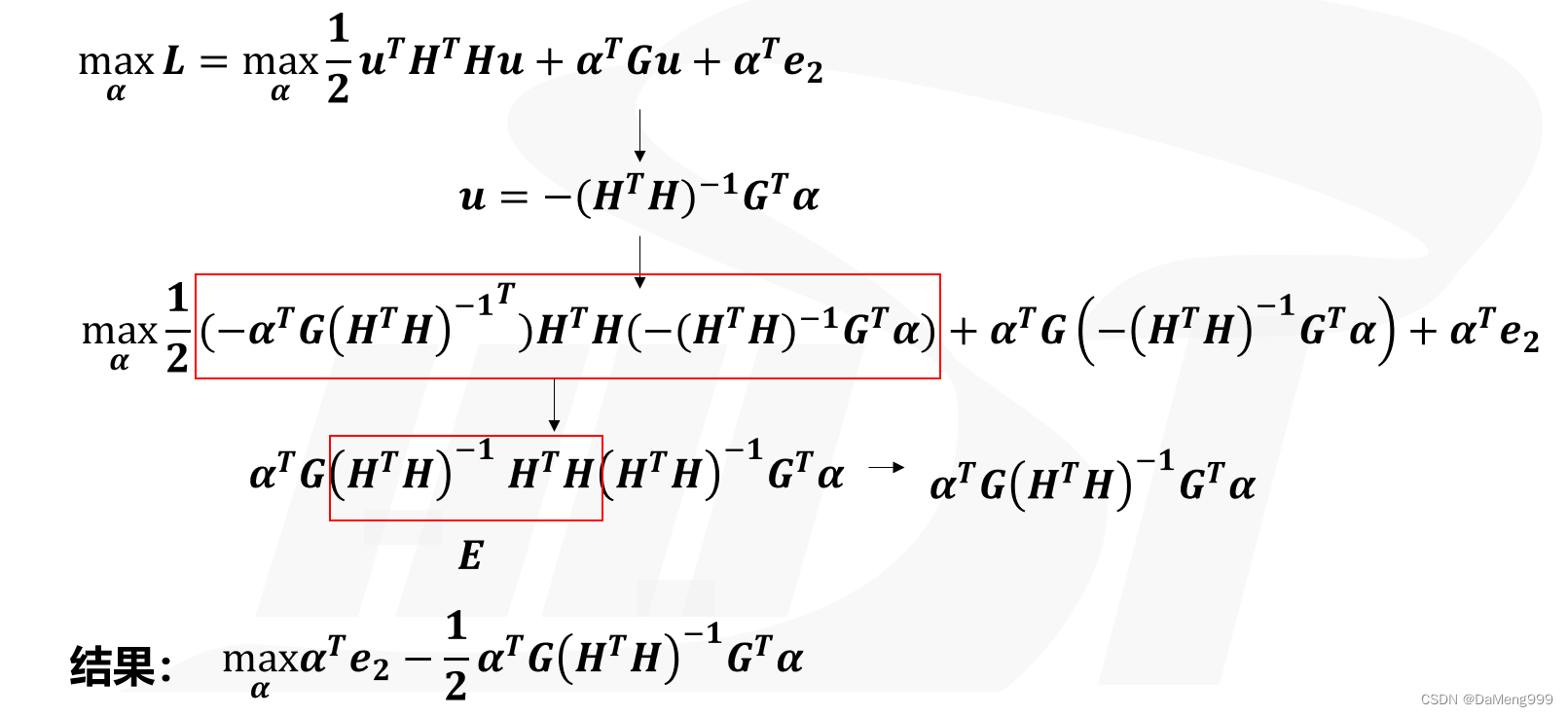

于是解得极小值:

为增强泛化能力,可以引入正则化项:

2.3 求极大

2.4 对偶问题

解得最终的对偶问题解如下:

本文详细介绍了双曲支持向量机(TWSVM)的原始最优化问题,包括符号说明、公式解释以及如何构造对偶问题进行求解。通过对拉格朗日乘子的引入,利用KKT条件解决凸二次规划问题,最终得到对偶问题的解。TWSVM旨在找到两个非平行的超平面,分别靠近正负样本,以提高分类性能并引入正则化项增强泛化能力。

本文详细介绍了双曲支持向量机(TWSVM)的原始最优化问题,包括符号说明、公式解释以及如何构造对偶问题进行求解。通过对拉格朗日乘子的引入,利用KKT条件解决凸二次规划问题,最终得到对偶问题的解。TWSVM旨在找到两个非平行的超平面,分别靠近正负样本,以提高分类性能并引入正则化项增强泛化能力。

2914

2914

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?