文章目录

前言

尽管当前的大模型知识非常全面,但对于细分小方向上的知识储备仍然不足,且这些垂直小领域的很多知识都是需要付费获取的工具书、文献等,不能被大模型在训练阶段所获得。尤其是对于研究生而言,专业细分领域往往各行如隔山,一个能精通于细分小领域的大模型就很有必要。

声明:本方法使用并非免费,但价格很低,问答一次大概花费¥0.01,视问答长短和模型种类而定

一、安装Cherry Studio

Cherry Studio是一个支持多平台的AI客户端,整合了包括ChatGPT、Gemini、DeepSeek等主流大模型。用户可根据自己的系统配置进行选择下载:

https://docs.cherry-ai.com/cherrystudio/download

下载完成后直接不断下一步安装即可。

二、获取大模型API

这里以百度智能云为例展示如何获得大模型API:

先通过以下链接进入百度DeepSeek体验中心:

https://cloud.baidu.com/deepseek.html?track=console

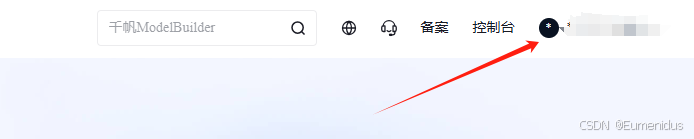

先点击右上角头像处进行实名认证,不进行实名认证的话无法获取后续计算资源

完成认证后选择立即体验,如果你前面已经完成了实名认证,在加载DeepSeek体验的过程中会弹出一个小窗,让你同意并给你授权千帆的资源,这个很重要。完成这一步似乎可以获得20块代金券,不知道有效期有多久。

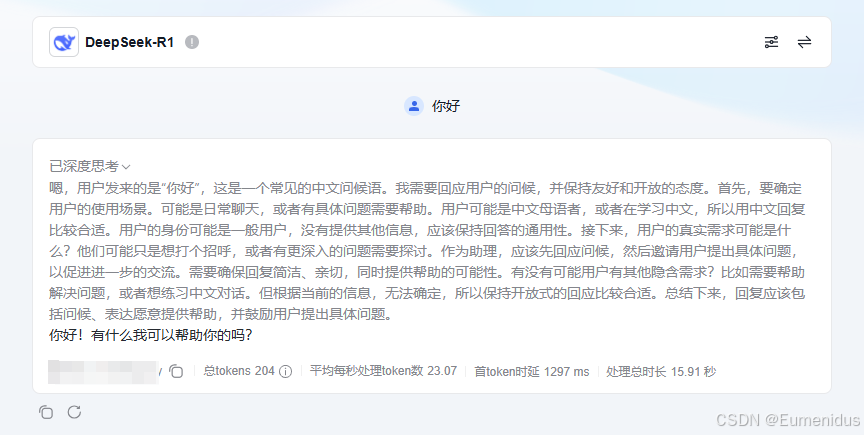

在体验中心处可以跟DeepSeek对话,使用这里的在线体验中心可以获取跟DeepSeek官网一样的体验,但不容易发生繁忙。注意在线体验中心的问答也会消耗token数。

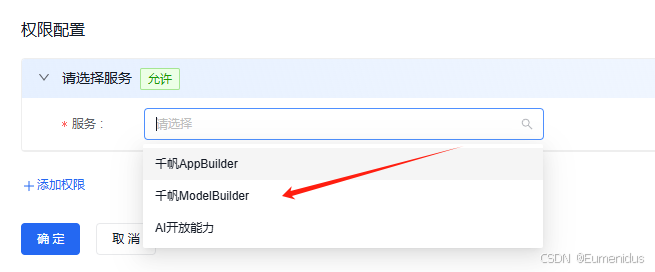

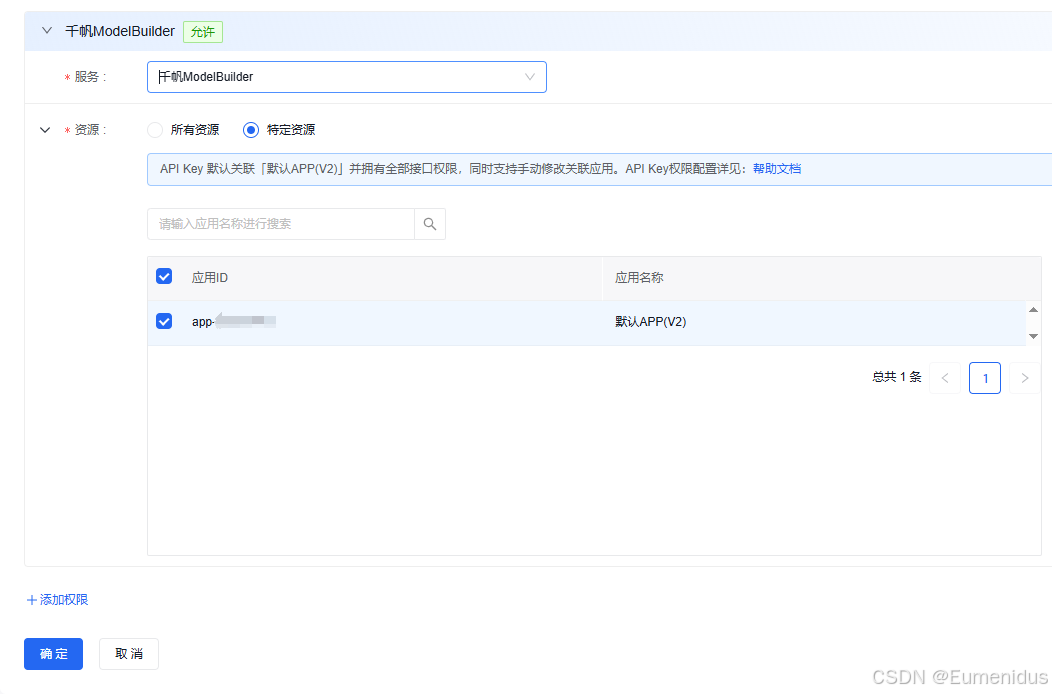

完成实名认证后进入API key页面,点击创建API key,服务选择第二项千帆ModelBuilder,在页面上找不到获取API key的按钮就从这个链接进去就好:

https://console.bce.baidu.com/iam/#/iam/apikey/list

然后会弹出系统默认设置的参数,不用修改,确认即可

如果此处在特定资源里没有可选择的资源可能是因为前面没有进入DeepSeek体验中心获取资源。如果没有资源的话无法选择确定,即使通过修改为所有资源选择了确定在后续Cherry Studio的连接中依然也无法正确连接。

创建完成的API key后续会需要用到,可以先保存好。对于百度智能云平台的API key可以创建后反复打开查看,部分平台的API key在创建后就不再支持打开查看,只能重新创建。

请注意保存好你的API key不要随意分享给他人,后续的token计费就是基于API key所在账户

根据百度智能云计费规则,DeepSeek-R1输入价格0.002元/千tokens,输出价格0.008元/千tokens,个人使用来看单次问答输入加输出大概消耗一千tokens,也就是不到一分钱的价格,所以还是很划算的。建议单次充值充个一两块就好,百度采用的是按量后付费,即先使用再付费。

token 是模型用来表示自然语言文本的基本单位,也是各种大模型的计费单元,可以直观的理解为“字”或“词”;通常1 个中文词语、1 个英文单词、1 个数字或1 个符号计为1 个token。

付费人口在右上角头像旁边的财务处,同时可以设置余额提醒,低于一定余额后会发短信通知。

除了百度智能云以外,其他平台也有提供DeepSeek部署,例如硅基流动、华为云、字节跳动的火山引擎等。

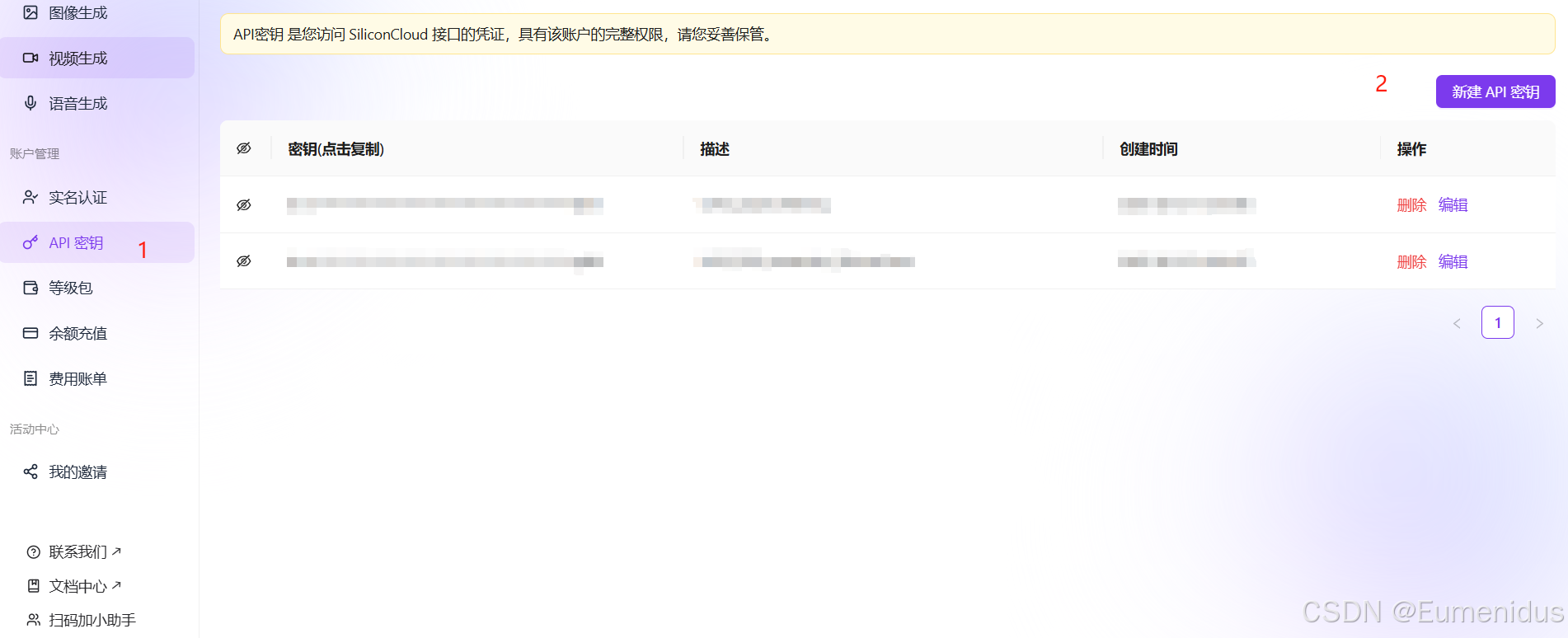

以下是介绍在硅基流动平台上获取API key的方式:

首先进入硅基流动平台:

https://cloud.siliconflow.cn/i/vFvsZ1Px

此处夹带本人邀请码,使用手机号注册成功后双方都可以获得 2000 万 Tokens,实际到账为 14 元平台配额。但根据实际使用情况来看硅基流动更容易出现繁忙,各位可根据自己实际情况自行选择。

选择左侧的API密钥,再点击新建API密钥即可。

三、配置Cherry Studio

Cherry Studio接入API key

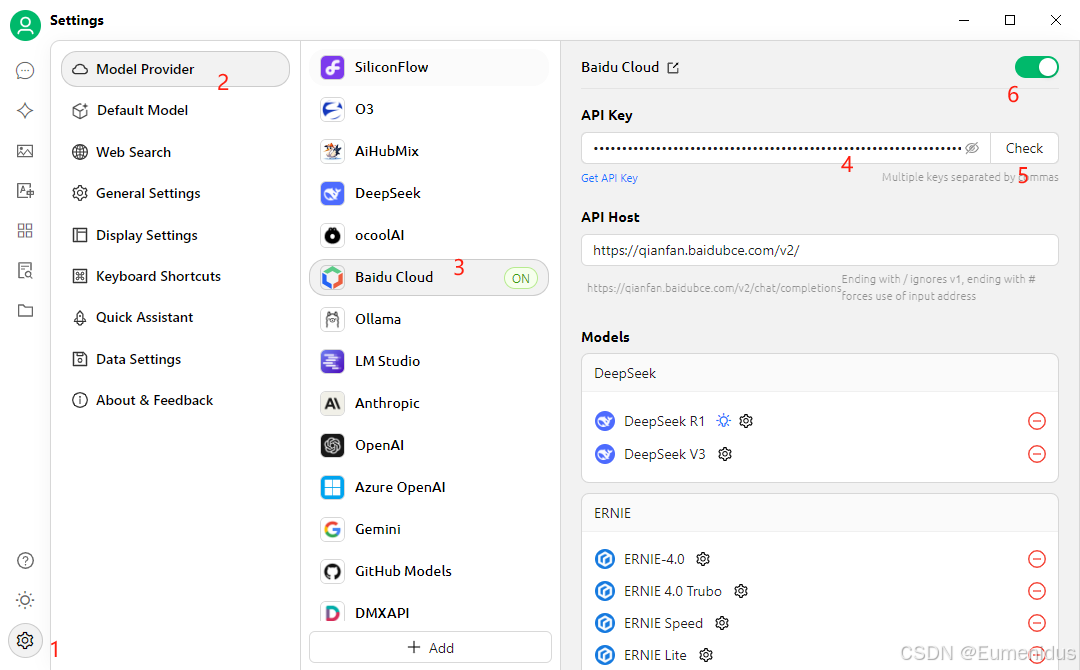

获得API key后,回到Cherry Studio,按下图,依次选择左下角的设置→模型服务→选择提供API的服务商→粘贴API key→点击检查,确保API key能正确连接,如果不能连接检查复制粘贴时是否多了或少了字符,最后打开模型服务

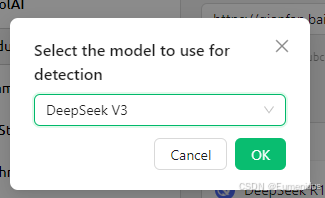

在检查API连接是否成功时,选择后续会使用的模型进行检查,推荐DeepSeek V3和DeepSeek R1

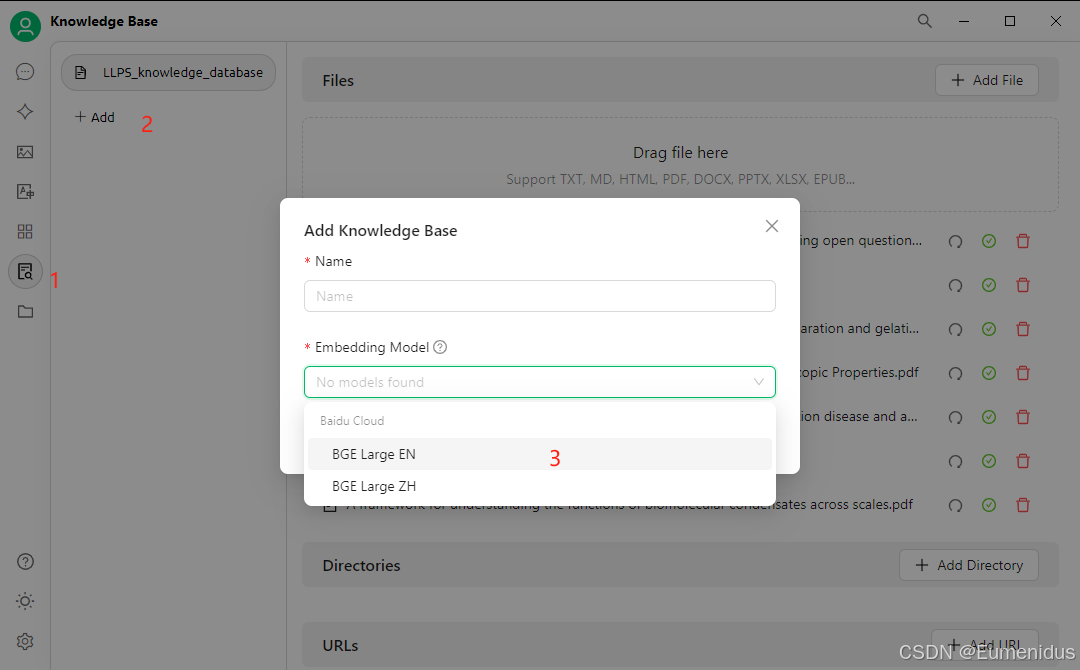

配置Cherry Studio知识库

接着选择左侧工具栏的知识库,添加知识库,给你的知识库命个名,BGE Large EN和ZH则是对应针对英文和中文的模型,这里建议使用英文EN的,毕竟文献多数都是英文文献。这里我是选择了百度智能云的嵌入模型,如果你选择了其他平台提供的API那此处可选模型会有所不同。如果选择的是其他平台的话嵌入模型随便选就行,影响不大。

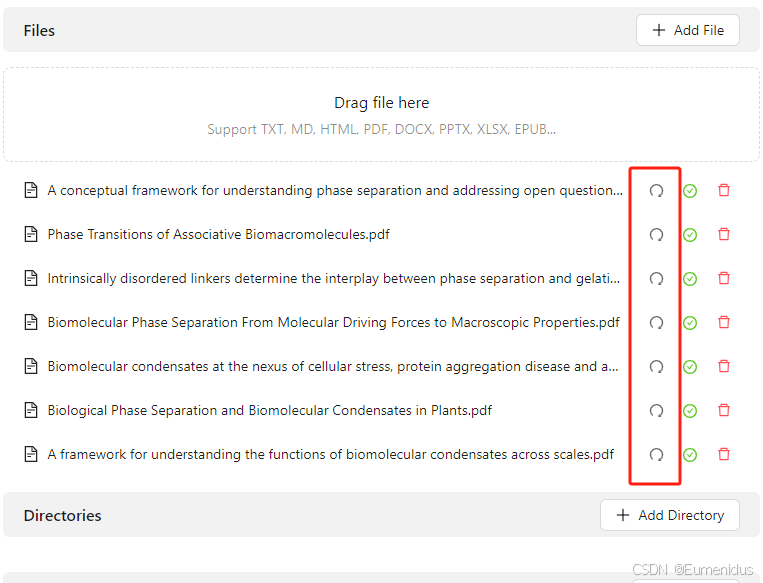

完成后可以通过添加本地文件来完善你的知识库,支持txt,pdf,html,docx,pptx和xlsx等多种格式,也可以直接添加网址和整个文件夹。对于文献,请使用本地导入PDF的方式而不要使用网址的方式,因为Cherry Studio在获取网站内容的时候无法绕过文献出版商的付费墙。

如果你的研究涉及多个不同的领域,还可以构建多个不同的知识库。

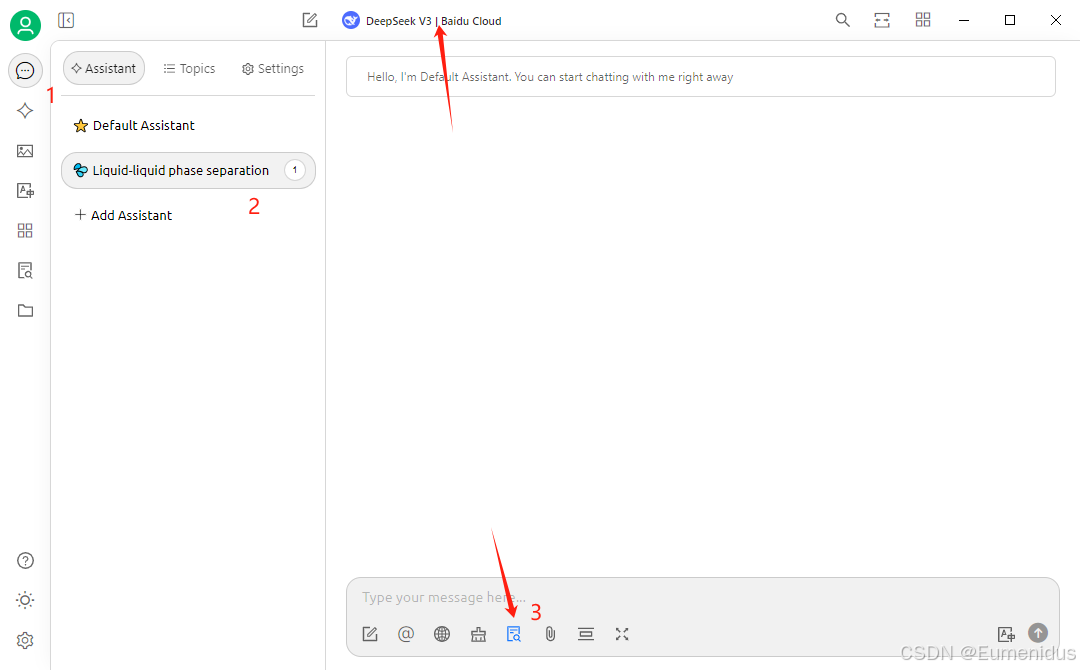

在聊天中导入知识库

通过左侧工具链回到聊天主页,添加一个新的AI助手,助手类型选择一个自己喜欢的就好,默认助手也行。在聊天的时候通过聊天框下方的知识库导入之前配置好的知识库即可,这样模型的回答就会根据你先前配置的文献来进行回答而不会瞎编。

如果需要切换不同模型例如切换DeepSeek-V3和DeepSeek-R1,可以在聊天框顶部选择。

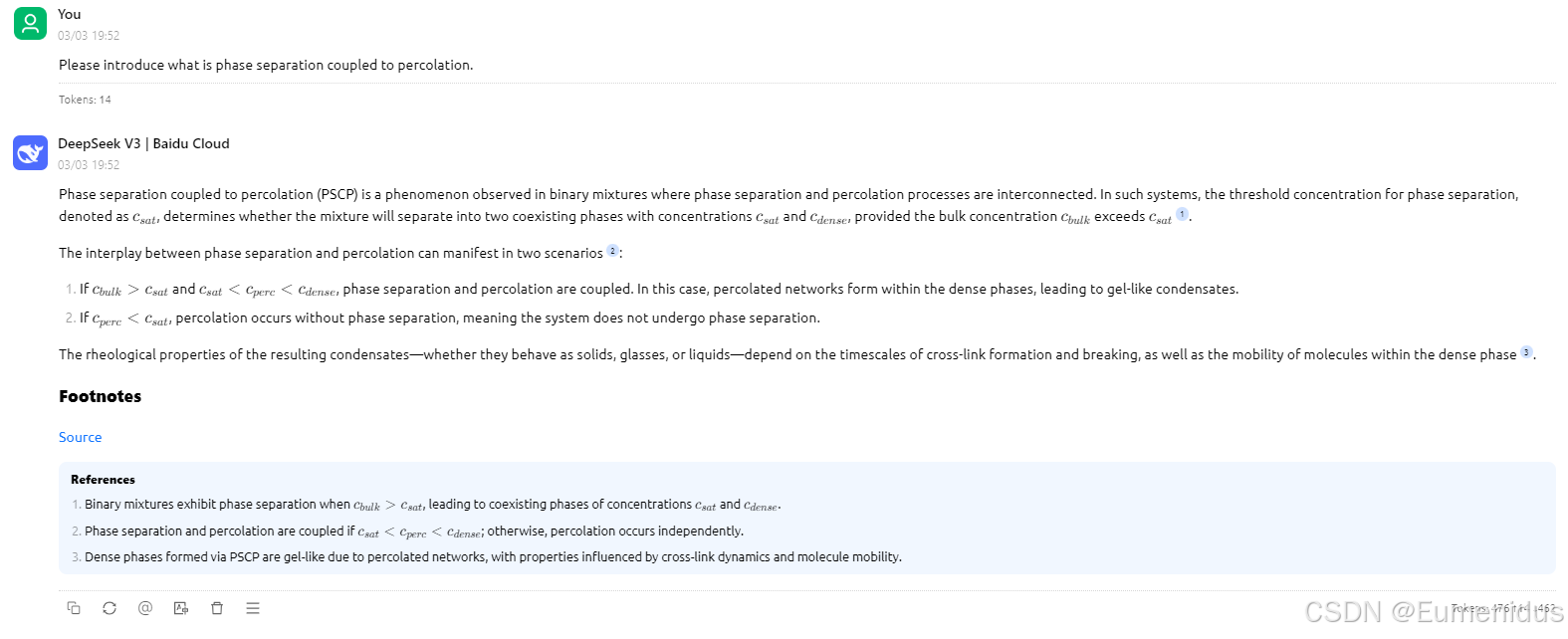

可以看到,本次大模型的回答都是基于给定参考文献中的内容,非常严谨。本次问答共消耗476 tokens,不到¥0.005。

四,高级参数设置

模型参数设置

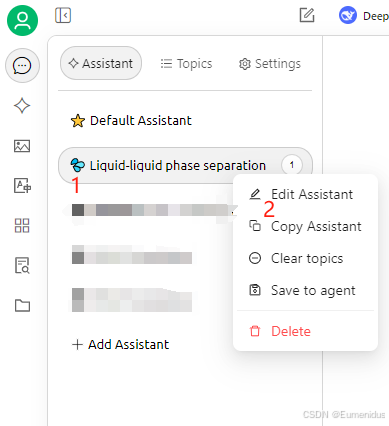

右键点击对话,选择编辑助手

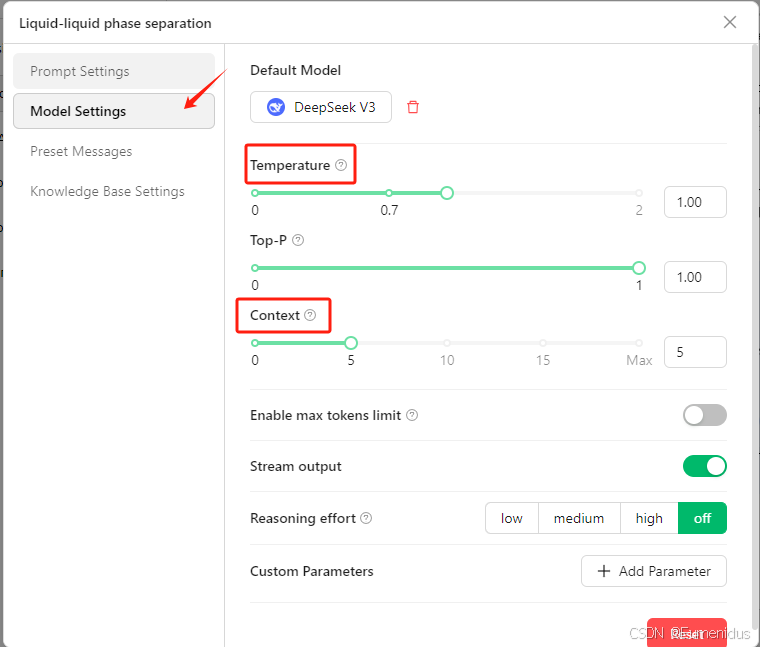

选择模型设置,调节温度和上下文长度

模型温度影响的是模型的创造性,温度越高(越接近2)模型给出的结果就更具有创造性,例如合适用作诗歌创作;而温度越低(越接近0)模型给出的结果就更精确,更合适用于编程和数学证明题。如果这里需要的是根据知识库的内容进行回答,那建议调节温度为0。

上下文长度是模型记忆的上下文对话数,视个人实际需要而调节就好,这个调越多后续对话消耗的token也越多,因为每次对话都会将之前的对话重新发送给模型。

知识库参数设置

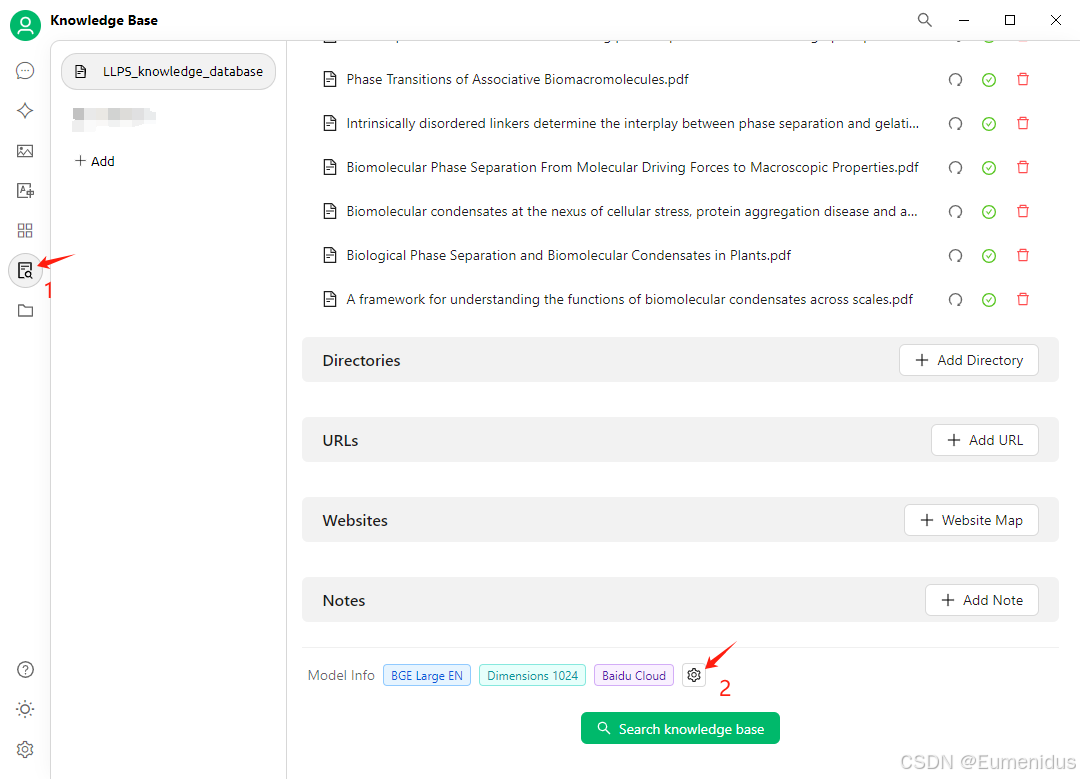

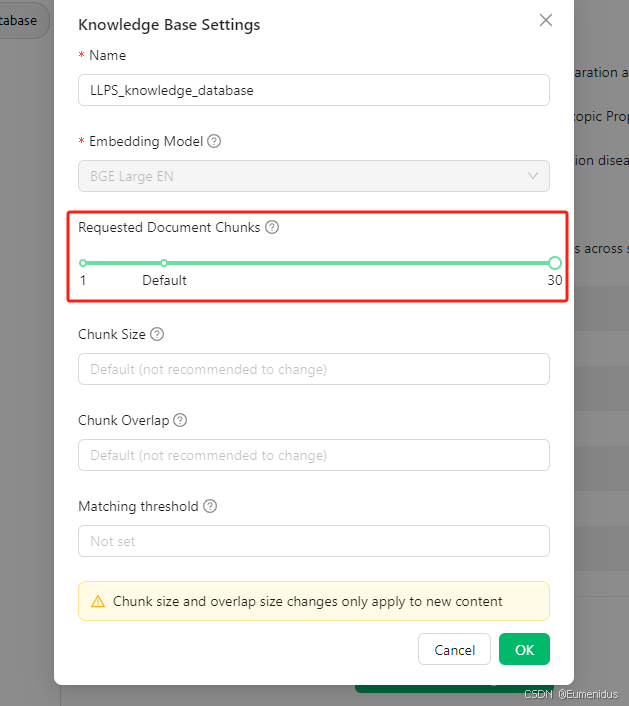

左侧工具栏选择知识库,然后滚动到页面最下方,选择小齿轮的设置

点开后,可以修改文档分块,这里我直接拉到了最高,这部分影响的是模型在根据你的资料进行回答时所采用的参考资料数量,分块越多参考越多。当然分块越多单次回答消耗的token数也会越高。修改后点击OK即可。

由于上面的分块设置只对新导入的文件生效,如果在此前已经导入了文件,可以回到知识库页面,对原有的文件进行刷新操作。

1051

1051

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?