通过本文你将了解到,什么是 RAG(Retrieval-Augmented Generation),为什么需要 RAG,RAG 的整个流程,以及通过一个简单的示例串起了整个流程。

什么是 RAG?

RAG 全称 Retrieval-Augmented Generation,翻译成中文是检索增强生成。检索指的是检索外部知识库,增强生成指的是将检索到的知识送给大语言模型以此来优化大模型的生成结果,使得大模型在生成更精确、更贴合上下文答案的同时,也能有效减少产生误导性信息的可能。打一个形象的比喻就是,把大语言模型看作一个考生,现在在参加一场考试。如果没有 RAG,只有大语言模型自己在答题,这就相当于是在闭卷考试;而结合了 RAG 的大语言模型相当于允许带小抄进考场,是在开卷考试。

Photo by Nguyen Dang Hoang Nhu on Unsplash

为什么需要 RAG?

之所以需要 RAG,是因为大语言模型本身存在一些局限性。

1.时效性

模型的训练是基于截至某一时间点之前的数据集完成的。这意味着在该时间点之后发生的任何事件、新发现、新趋势或数据更新都不会反映在模型的知识库中。例如,我的训练数据在 2023 年底截止,之后发生的事情我都无法了解。另外,大型模型的训练涉及巨大的计算资源和时间。这导致频繁更新模型以包括最新信息是不现实的,尤其是在资源有限的情况下。

2.覆盖性

虽然大模型的训练数据集非常庞大,但仍可能无法涵盖所有领域的知识或特定领域的深度信息。例如,某些专业的医学、法律或技术问题可能只在特定的文献中被详细讨论,而这些文献可能未被包括在模型的训练数据中。另外,对于一些私有数据集,也是没有被包含在训练数据中的。当我们问的问题的答案没有包含在大模型的训练数据集中时,这时候大模型在回答问题时便会出现幻觉,答案也就缺乏可信度。

由于以上的一些局限性,大模型可能会生成虚假信息。为了解决这个问题,需要给大模型外挂一个知识库,这样大模型在回答问题时便可以参考外挂知识库中的知识,也就是 RAG 要做的事情。

RAG 的流程

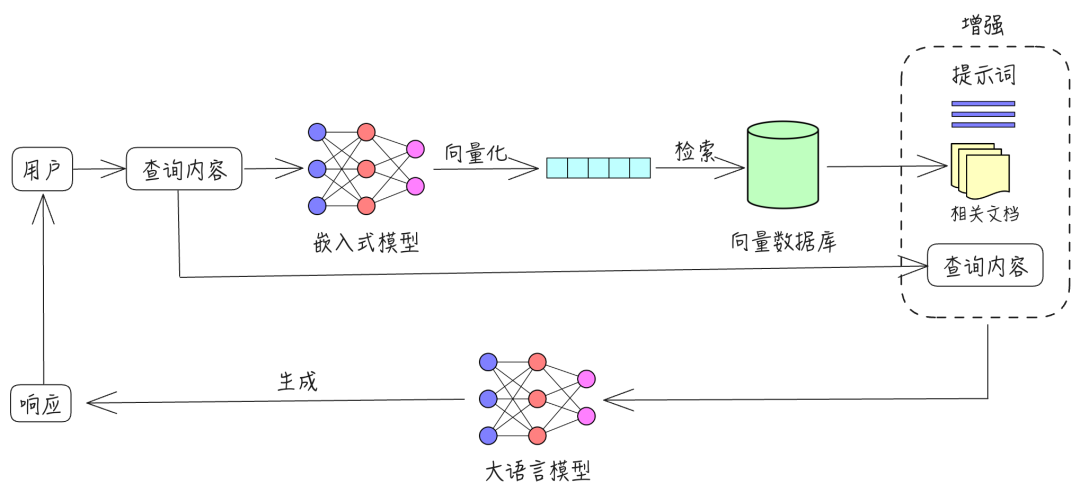

RAG 的中文名称是检索增强生成,从字面意思来理解,包含三个检索、增强和生成三个过程。

-

**检索:**根据用户的查询内容,从外挂知识库获取相关信息。具体来说,就是将用户的查询通过嵌入模型转换成向量,以便与向量数据库中存储的知识相关的向量进行比对。通过相似性搜索,从向量数据库中找出最匹配的前 K 个数据。

-

**增强:**将用户的查询内容和检索到的相关知识一起嵌入到一个预设的提示词模板中。

-

**生成:**将经过检索增强的提示词内容输入到大语言模型(LLM)中,以此生成所需的输出。 流程图如下所示:

简单示例

在下面这个简单示例中,我们使用 Elasticsearch 作为存储向量的数据库。使用讯飞的星火大模型来进行问题的回答。具体代码如下:连接本地的 Elasticsearch 数据库

import os from elasticsearch import Elasticsearch from dotenv import load_dotenv load_dotenv() client = Elasticsearch( "https://localhost:9200", ssl_assert_fingerprint=os.environ["CERT_FINGERPRINT"], basic_auth=("elastic", os.environ["ELASTIC_PASSWORD"]) )

加载向量模型

from sentence_transformers import SentenceTransformer model = SentenceTransformer("./stella-base-zh-v3-1792d")

创建索引

client.indices.create(index = "rag_tutorial_vector_index", mappings = { 'properties': { 'embedding': { 'type': 'dense_vector' } } })

读取本地的文本文件并进行切分,然后向索引中添加数据

from langchain.text_splitter import RecursiveCharacterTextSplitter with open("patent.txt", "r") as fp: text = fp.read() text_splitter = RecursiveCharacterTextSplitter(chunk_size = 200, chunk_overlap=50) chunks = text_splitter.create_documents([text]) doc = {} for doc_id, chunk in enumerate(chunks): chunk_embedding = model.encode(chunk.page_content, normalize_embeddings=True) doc['text'] = chunk.page_content client.index( index = "rag_tutorial_vector_index", id = doc_id, document = { **doc, "embedding": chunk_embedding } )

使用查询从向量数据库中检索数据

query = "本次专利法修改对于更好地鼓励医药产业创新,有哪些新规定?" query_embedding = model.encode(query, normalize_embeddings=True) resp_vector = client.search( knn = { 'field': 'embedding', 'query_vector': query_embedding, 'num_candidates': 10, 'k': 3 }, min_score = 0.8, size = 3, index = 'rag_tutorial_vector_index' )

将检索的结果进行汇总

retrieval_content = "" for hit in resp_vector['hits']['hits']: retrieval_content += hit['_source']['text']

将检索到的结果送到星火大模型,并输出结果

import os from sparkai.llm.llm import ChatSparkLLM, ChunkPrintHandler from sparkai.core.messages import ChatMessage from dotenv import load_dotenv load_dotenv() if __name__ == '__main__': spark = ChatSparkLLM( spark_api_url=os.environ["SPARKAI_URL"], spark_app_id=os.environ["SPARKAI_APP_ID"], spark_api_key=os.environ["SPARKAI_API_KEY"], spark_api_secret=os.environ["SPARKAI_API_SECRET"], spark_llm_domain=os.environ["SPARKAI_DOMAIN"], streaming=False, ) prompt = f""" 你是一个善于回答问题的助手。请使用以下提供的检索内容和自身知识来回答问题。如果你不知道答案,请直接说不知道,不要杜撰答案。请用三句话以内回答,保持简洁。 问题:{query} 检索内容:{retrieval_content} """ messages = [ChatMessage( role = "user", content = prompt )] handler = ChunkPrintHandler() a = spark.generate([messages], callbacks=[handler]) print(a.generations[0][0].text)

总结

本文从大模型的局限性切入,探讨了检索增强生成架构的核心机制及其带来的好处。RAG 通过结合检索和生成能力,能从外部知识库搜索相关信息,生成更准确的回应,有效克服了大模型在知识更新上的短板。

如何系统的去学习大模型LLM ?

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的 AI大模型资料 包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

😝有需要的小伙伴,可以V扫描下方二维码免费领取🆓

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

阶段1:AI大模型时代的基础理解

- 目标:了解AI大模型的基本概念、发展历程和核心原理。

- 内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践 - L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

- 目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

- 内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例 - L2.2 Prompt框架

- L2.2.1 什么是Prompt

- L2.2.2 Prompt框架应用现状

- L2.2.3 基于GPTAS的Prompt框架

- L2.2.4 Prompt框架与Thought

- L2.2.5 Prompt框架与提示词 - L2.3 流水线工程

- L2.3.1 流水线工程的概念

- L2.3.2 流水线工程的优点

- L2.3.3 流水线工程的应用 - L2.4 总结与展望

- L2.1 API接口

阶段3:AI大模型应用架构实践

- 目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

- 内容:

- L3.1 Agent模型框架

- L3.1.1 Agent模型框架的设计理念

- L3.1.2 Agent模型框架的核心组件

- L3.1.3 Agent模型框架的实现细节 - L3.2 MetaGPT

- L3.2.1 MetaGPT的基本概念

- L3.2.2 MetaGPT的工作原理

- L3.2.3 MetaGPT的应用场景 - L3.3 ChatGLM

- L3.3.1 ChatGLM的特点

- L3.3.2 ChatGLM的开发环境

- L3.3.3 ChatGLM的使用示例 - L3.4 LLAMA

- L3.4.1 LLAMA的特点

- L3.4.2 LLAMA的开发环境

- L3.4.3 LLAMA的使用示例 - L3.5 其他大模型介绍

- L3.1 Agent模型框架

阶段4:AI大模型私有化部署

- 目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

- 内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

学习计划:

- 阶段1:1-2个月,建立AI大模型的基础知识体系。

- 阶段2:2-3个月,专注于API应用开发能力的提升。

- 阶段3:3-4个月,深入实践AI大模型的应用架构和私有化部署。

- 阶段4:4-5个月,专注于高级模型的应用和部署。

这份完整版的大模型 LLM 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

😝有需要的小伙伴,可以Vx扫描下方二维码免费领取🆓

1206

1206

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?