❤️点击上方,选择星标或置顶,每天给你送上干货❤️

作者 | godweiyang

出品 | 公众号:算法码上来(ID:GodNLP)

- BEGIN -

之前写过一个教程,教大家如何自己训练出一个文本生成的模型,然后用LightSeq来加速推理:

用了这个技术,我让模型训练和推理快了好几倍

但是,训练好模型之后,别人如果没有显卡的话,就没法体验到快乐了呀!有一个办法,那就是把模型部署在GPU服务器上,然后别人直接发送请求进行访问就行了。更进一步,还可以做成网页,更方便互动!

这里分享一下我本地搭建的网页地址(72小时有效):

https://5858f0fd82132295.gradio.app

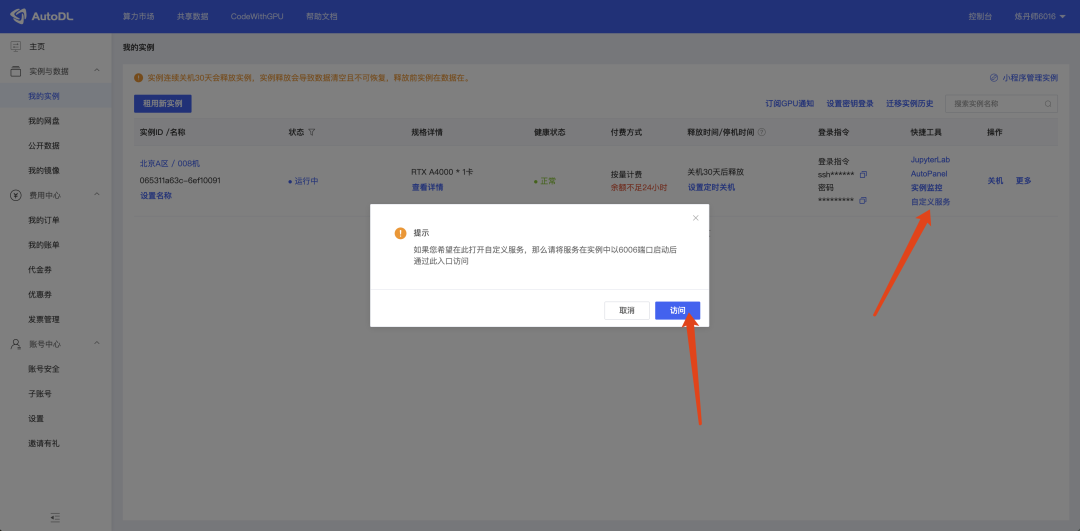

申请GPU服务器

这里我发现了一个能白嫖的GPU服务器:

https://www.autodl.com

注册送10块钱,只需要申请一个便宜点的GPU就行了,几毛钱每小时。但一定要注意了,如果用的是int8量化模型,一定要选择计算能力>=7.5的显卡!下面的表格可以查看NVIDIA所有显卡的计算能力:

https://en.wikipedia.org/wiki/CUDA

服务端部署

按照之前的教程,训练并导出模型之后,就可以用LightSeq进行部署了。

用ssh连接服务器之后,安装一些必要的python库:

pip3 install lightseq transformers然后就可以开始部署了,下面是一个简单的服务端代码。这个代码从6006端口接收用户请求,然后转换成id,送给LightSeq推理,最后还原成文本,发送回去。

import os

import socket

import threading

import time

from transformers import BertTokenizer

import lightseq.inference as lsi

s = socket.socket(socket.AF_INET, socket.SOCK_STREAM)

s.bind(('127.0.0.1', 6006))

s.listen(5)

os.system("wget -nc https://zenodo.org/record/7233565/files/aiai97.hdf5")

tokenizer = BertTokenizer.from_pretrained("uer/gpt2-chinese-cluecorpussmall")

model = lsi.QuantGpt("aiai97.hdf5", 16)

def tcplink(sock, addr):

print('Accept new connection from %s:%s...' % addr)

while True:

data = sock.recv(1024)

if not data or len(data.decode('utf-8')) <= 0:

break

time.sleep(1)

print(data.decode('utf-8'))

inputs_ids = tokenizer([data.decode('utf-8')], return_tensors="pt", padding=True)["input_ids"]

ls_res_ids = model.sample(inputs_ids)

ls_res = tokenizer.batch_decode(ls_res_ids, skip_special_tokens=True)

res = ''.join(ls_res[0].split())

print(res)

sock.send(res.encode('utf-8'))

sock.close()

print('Connection from %s:%s closed.' % addr)

while True:

sock, addr = s.accept()

t = threading.Thread(target=tcplink, args=(sock, addr))

t.start()客户端请求

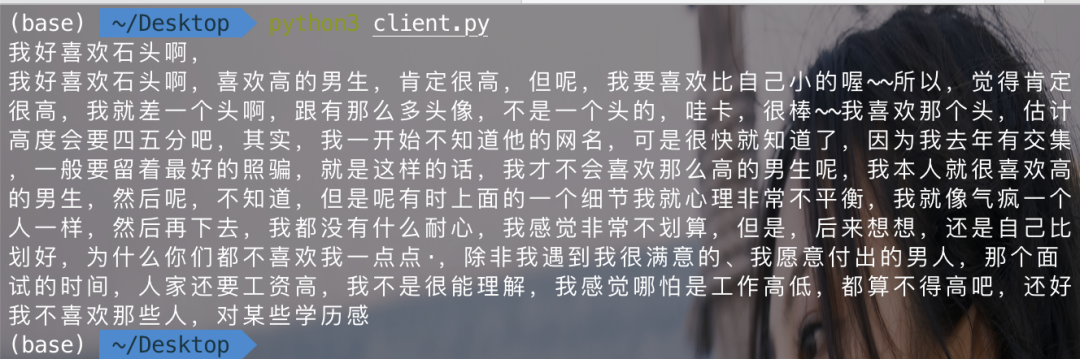

然后任何人就可以使用起来啦!控制台可以看到公网域名和端口号:

然后在任意电脑上,用下面代码就可以请求啦:

import socket

s = socket.socket(socket.AF_INET, socket.SOCK_STREAM)

s.connect(('region-4.autodl.com', 40977))

s.send(input("请输入句子前缀:\n").encode('utf-8'))

print(s.recv(1024).decode('utf-8', 'ignore'))

s.close()注意这里的域名和端口号改成你自己的,然后运行得到结果:

网页互动

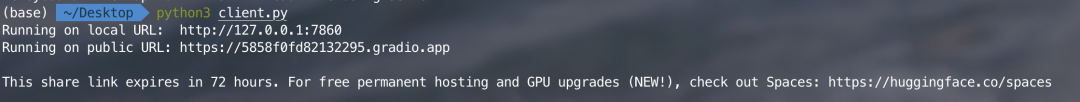

如果你觉得命令行黑漆漆的不方便,那也可以做一个网页,给别人更好的体验!

首先安装gradio库:

pip3 install gradio然后客户端代码改成下面这样就行了:

import socket

import gradio as gr

def predict(text):

s = socket.socket(socket.AF_INET, socket.SOCK_STREAM)

s.connect(('region-4.autodl.com', 40977))

s.send(text.encode('utf-8'))

res = s.recv(1024).decode('utf-8', 'ignore')

s.close()

return res

gr.Interface(fn=predict,

inputs=["text"],

outputs=["text"]).launch(share=True)然后运行就可以看到下面提示:

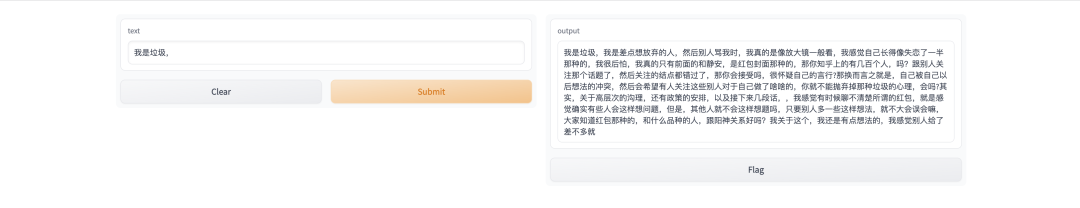

这里会显示一个内网ip和公网地址,公网地址可以分享给你的小伙伴体验,打开后是这样的:

这里分享一下我本地搭建的网页地址(72小时有效):

https://5858f0fd82132295.gradio.app

- END -

我是godweiyang,字节跳动AI Lab NLP算法工程师,华师计算机本硕均专业第一,擅长算法、模型优化和机器翻译。

回复【算法】

获取我面试时写过的100多道算法题解,刷完进大厂没问题。

回复【CUDA】

获取我为新手准备的CUDA入门系列教程。

回复【内推】

内推字节,通过率高,加我微信可随时查催进度、咨询问题。

回复【加群】

进我的技术交流(聊天)群和内推群,群内有字节HR答疑。

求求兄弟们点个在看吧,今天的阅读量靠你们了👇

4674

4674

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?