RCD: Relation Map Driven Cognitive Diagnosis for Intelligent Education Systems

主要内容

- RCD: Relation Map Driven Cognitive Diagnosis for Intelligent Education Systems

- Abstract

- 1 Introduction

- 2 Related Work

- 3 Preliminaries

- 4 RCD: Relation map driven cognitive diagnosis

- 5 Experiments

- 6 Conclusion

Abstract

认知诊断(CD)是智能教育环境中的一个基本问题,它旨在发现学生对不同知识概念的掌握程度。一般来说,以前的工作大多将其视为层间交互建模问题,如IRT中的学生-练习交互或DINA中的学生-概念交互,而内层结构关系,**如概念间的教育相互依赖关系,仍未得到充分探索。**此外,对于CD系统中的学生-练习-概念的层次关系也缺乏全面的建模。为此,在本文中,我们提出了一个新颖的关系图驱动的认知诊断(RCD)框架,通过多层的学生-练习-概念关系图统一建模互动和结构关系。具体来说,我们首先将学生、练习和概念表示为分层布局中的单个节点,并构建了三个定义明确的局部关系图来纳入层间和层内关系,包括学生-练习的交互图、概念-练习的关联图和概念的依赖图。然后,我们利用多级注意力网络,在每个局部地图内整合节点级的关系聚合,并平衡不同地图间的地图级聚合。最后,我们设计了一个可扩展的诊断函数来预测学生的表现并联合训练网络。在真实世界的数据集上的大量实验结果清楚地表明了我们的RCD在提高诊断准确率和关系意识表示学习方面的有效性和可扩展性。

1 Introduction

认知诊断 (CD) 已被公认为智能教育应用 [3, 6, 20] 中的一项关键任务,例如学生评估 [4, 22] 和资源推荐 [25]。原则上,CD 系统由三个部分组成:学生、练习和知识概念。具体来说,鉴于学生的练习记录(例如,答对与否),CD 的目标是发现他们对特定知识概念的实际掌握水平 [27]。

如图 1 (a) 所示,CD 系统可以抽象为三层学生-练习-概念层次结构。**现有的 CD 研究基本上可以概括为从更高的角度对不同层之间的交互进行建模。**例如,项目反应理论 (IRT) [13]、多维 IRT (MIRT) [1, 36] 和矩阵分解 (MF) [24, 41] 尝试用线性函数对学生和练习之间的相互作用进行建模,而神经认知诊断 (NCD) [44] 利用与神经网络的高阶学生练习交互。也有一些研究(例如,确定性输入、噪声与门(DINA)[10])通过使用所谓的 Q 矩阵直接将练习映射到相应概念来对学生-概念交互进行建模。

尽管已经做出了很大的努力,但是学生-练习-概念层次结构中包含的丰富信息尚未得到有效利用。具体而言,沿着这条路线存在两个问题。首先,层次结构之间的多层交互应该完全建模而不是部分建模(即学生练习或学生概念)。如图 1 (b, c) 所示,在学习系统中,学生(例如, s 1 s_1 s1)通过响应练习(例如, 𝑞 2 𝑞_2 q2)与练习进行交互,同时练习与具有知识相关性的概念(例如, 𝑐 1 和 𝑐 3 𝑐_1 和 𝑐_3 c1和c3)相关。由于每一层的实体都具有特定的特征以及与其他层的独特层间交互,因此完整而全面的建模将最有利于 CD 任务。其次,除了层间交互(例如学生和练习之间),还存在复杂的内层结构,尤其是概念之间。足够的教学研究[12, 48]证明了知识概念之间存在相互依赖关系,通常用概念依赖关系图[30]表示。在不失一般性的情况下,图 1(d) 展示了具有两个典型关系的概念依赖图:相似性和先决条件。具体而言,相似关系涉及属于同一主题的一对概念(例如主题几何的概念锥和概念立方)。先决条件关系涉及一对概念,这些概念假定学生应该先逻辑地学习另一个概念(例如,概念数在概念算术之前)。这样的结构信息显然可以帮助 CD 任务。以图1(d)为例,如果已知学生 s 1 s_1 s1已经掌握了概念 𝑐 2 𝑐_2 c2,那么她很可能已经掌握了相似的概念 𝑐 1 和 𝑐 4 𝑐_1和𝑐_4 c1和c4,以及前提概念 𝑐 3 𝑐_3 c3。总之,理想的认知诊断系统应该利用完整的层间学生-练习-概念交互以及内层概念依赖结构。

然而,由于学生-练习-概念层次结构的复杂性,实现理想的 CD 系统仍存在困难。一方面,系统包含不同类型的关系,使其高度异构。另一方面,这些关系并不是完全无组织的,而是分层布局的。为了解决对共存异质性和组织进行建模的挑战,我们提出了一个通用的 CD 框架,即关系图驱动的认知诊断 (RCD),它统一建模了多层学生-练习-概念关系中的交互和结构关系地图。具体来说,与之前的工作不同,RCD 使用嵌入层明确表示学生-练习-概念层次结构中的所有实体。为了有效地学习关系感知表示,我们引入了三个定义明确的局部图,即学生-练习交互图、练习-概念相关图和概念依赖图(在第 3 节中描述),节点在其上递归聚合来自邻居的信息。由于每个节点由多个图共享,因此融合层旨在为每个节点应用复杂的节点级和map级聚合,并利用注意力网络自动平衡多级信息。此后,给定关系感知表示,RCD 使用精心设计的诊断功能预测学生的表现。此外,作为一个总体框架,RCD 有望具有扩展现有方法的能力。换句话说,RCD 设计得很好,因此它可以自然地将额外的相互作用和结构信息融合到当前的方法中并提高它们的性能。最后,对真实世界数据集的大量实验清楚地证明了 RCD 的有效性和可扩展性。总之,我们的主要贡献如下:

- 我们对 CD 的分层学生 - 练习概念关系进行了全面建模,并明确地将交互和结构信息与多种关系整合在一起。 此外,我们设计了一个多级注意力网络来专注地学习模型如何偏好不同的map源。

- 我们提出的RCD与现有的CD方法具有很高的可扩展性,这很容易改进以前仅以自然方式模拟学生-练习互动的CD 研究。

- 我们对真实世界的数据集进行了大量实验,以验证 RCD 的有效性和可扩展性,包括定量比较、定性分析和可解释的可视化。

2 Related Work

认知诊断。认知诊断(CD)的任务源于教学假设,即每个学生的认知状态在静态场景(例如考试)中是稳定的,因此可以通过他们的交互行为(即历史锻炼记录)进行诊断。因此,现有的 CD 研究大体可以分为两种类型,分别建模学生-练习互动和学生-概念互动。第一类工作表征学生特征(例如能力水平)和习题特征(例如难度水平),并用交互函数对习题行为的表现进行建模。作为典型代表,传统的 IRT [13]、MIRT [1, 36] 和 MF [24, 41] 使用线性函数,而最近的 NCD [44] 利用神经网络来学习高阶非线性函数。另一种类型的工作通过简单地忽略练习的特征并用相应的概念代替它们来直接建立学生与概念的互动。例如,DINA [10] 用一个二元向量来表征每个学生,该向量表示学生是否已经掌握了知识概念。现有的方法虽然取得了很大的进步,但都没有对学生、练习和概念进行彻底的建模,从而导致大量信息未被充分利用。

知识概念结构。根据教育理论[12,34,35],知识概念通常不是单独存在的。有许多概念关系指定了概念之间隐含的相互依赖关系。不失一般性,这些关系可以分为有向关系和无向关系。有向关系通常表示概念之间的知识影响传播,例如先决关系[8]和补救关系[38]。相反,无向关系通常表示概念之间的知识重叠或相互作用,例如相似关系[47]和协作关系[19]。概念之间丰富的结构信息已被证明对许多教育任务相当有帮助 [8, 29, 39]。通过这种方式,我们的 RCD 通过对关系图进行建模,将知识概念结构正确地整合到认知诊断中。

图结构建模。近年来,图结构建模 [9] 已成为最受欢迎的主题之一,因为它在对许多图结构数据 [7, 52] 进行建模方面表现出色。基于图的模型 [15, 33, 45] 的目标是学习节点或边的结构表示,以进一步支持各种图挖掘任务。作为最先进的技术,图神经网络 (GNN) [14, 17, 37] 在对图结构建模方面取得了巨大成功。 GNN 背后的关键思想是通过神经网络递归地聚合来自相邻节点的特征信息。然而,之前在 GNN 中的许多工作,例如 GAT [43] 和 GraphSage [16],都是专门为同构图设计的,这对于具有各种类型节点和边的许多现实世界问题来说是不够的,例如,上面提到的学生-练习概念关系。最近,已经为解决图异质性做出了很多努力,主要侧重于保留基于元路径的结构信息。例如。metapath2vec [11] 和 GTN [50] 使用手动设计或自动学习的元路径捕获层次结构。 HAN [46] 和 HetG [51] 考虑多级信息和注意力机制以进一步改进异构图学习。

3 Preliminaries

在本节中,我们首先介绍学生-练习-概念关系图,如图 2(a)所示。然后我们正式定义了关系图驱动的认知诊断问题。

3.1 Relation Map

关系图表现为三个局部图,从上到下分别是概念依赖图、练习-概念关联图和学生-练习交互图。

3.1.1 Concept dependency map

由专家标记的具有教育依赖关系的概念依赖关系图可以表示为图 G 𝑐 ( C , R 𝑐 ) G_𝑐 (C, R_𝑐 ) Gc(C,Rc)。在这个图中,C 是一组概念, R 𝑐 = R 𝑐 𝑟 , 𝑟 = 1 , . . . , 𝑅 R_𝑐 = R^𝑟_𝑐 , 𝑟 = 1, . . . , 𝑅 Rc=Rcr,r=1,...,R 是一组多重教育依赖关系,其中𝑟 代表某种类型的教育依赖关系(例如,先决条件和相似性)。

3.1.2 Exercise-concept Correlation Map

练习-概念相关图 G 𝑞 𝑐 ( Q ∪ C , R 𝑞 𝑐 ) G_{𝑞𝑐}( Q ∪ C, R_{𝑞𝑐}) Gqc(Q∪C,Rqc) ,可以表示为双向练习-概念二部图,其中 Q 是一组练习,C 是一组概念, R 𝑞 𝑐 R_{𝑞𝑐} Rqc 是指一组相关性在练习和概念之间。此外,关系 𝑟 𝑞 𝑖 ↔ 𝑐 𝑗 = 1 𝑟_{𝑞_𝑖↔𝑐_𝑗} = 1 rqi↔cj=1是指练习 𝑞 𝑖 𝑞_𝑖 qi 包括主要概念 𝑐 𝑗 𝑐_𝑗 cj 。例如,练习 𝑞 1 𝑞_1 q1在图1(c)中有主要概念 𝑐 2 𝑐_2 c2和 𝑐 4 𝑐_4 c4。

3.1.3 Student-Exercise Interaction Map

学生-练习互动数据可以表示为双向学生-练习二部图 G 𝑠 𝑞 ( S ∪ Q , R 𝑠 𝑞 ) G_{𝑠𝑞}( S ∪ Q, R_{𝑠𝑞}) Gsq(S∪Q,Rsq),其中 S 是一组学生,Q 是一组练习, R 𝑠 𝑞 R_{𝑠𝑞} Rsq 是指来自训练数据。如果关系 𝑟 𝑠 𝑖 ↔ 𝑞 𝑗 𝑟_{𝑠_𝑖↔𝑞_𝑗} rsi↔qj = 1,学生 𝑠 𝑖 𝑠_𝑖 si选择了练习 𝑞 𝑗 𝑞_𝑗 qj并回答了它。请注意,在此我们实际上并未透露学生的练习反应数据(即答对与否)。

3.1.4 Relation Map in RCD

在介绍了上述三个局部映射之后,这里我们将关系映射定义为 G ( G 𝑐 ∪ G 𝑞 𝑐 ∪ G 𝑠 𝑞 , R 𝑐 ∪ R 𝑞 𝑐 ∪ R 𝑠 𝑞 ) G(G_𝑐 ∪G_{𝑞𝑐} ∪G_{𝑠𝑞},R_𝑐 ∪ R_{𝑞𝑐} ∪ R_{𝑠𝑞}) G(Gc∪Gqc∪Gsq,Rc∪Rqc∪Rsq),其中包含概念之间的教育依赖关系,练习 - 概念练习互动图和学生图2(a)。对于层次关系图,自然呈现出多层次的结构。从map层面来看,map由三个跨层的局部地图组成。从节点层面来看,每个局部map都有一个相对独立的map源(即节点和关系)。

3.2 Problem Statement

设 S = { 𝑠 1 , 𝑠 2 , . . . , 𝑠 𝑁 } S = \{𝑠_1, 𝑠_2, . . . , 𝑠_𝑁 \} S={s1,s2,...,sN}是𝑁学生的集合, Q = { 𝑞 1 , 𝑞 2 , . , 𝑞 𝑀 } Q = \{𝑞_1, 𝑞_2, . , 𝑞_𝑀\} Q={q1,q2,.,qM}是𝑀练习的集合, C = { 𝑐 1 , 𝑐 2 , . , 𝑐 𝐾 } C = \{𝑐_1, 𝑐_2, . , 𝑐_𝐾\} C={c1,c2,.,cK}是𝐾知识概念的集合。 R 𝑞 𝑐 = { 𝑟 𝑞 𝑖 ↔ c 𝑗 ∣ 𝑞 𝑖 ∈ Q , 𝑐 j ∈ C } R_{𝑞𝑐} =\{ 𝑟_{𝑞_𝑖↔c_𝑗} | 𝑞_𝑖 ∈Q, 𝑐_j ∈C\} Rqc={rqi↔cj∣qi∈Q,cj∈C} 是练习和概念之间相关性的集合。假设每个学生单独选择一些习题进行练习。我们将某个学生的反应记录记录为一个三元组 ( 𝑠 , 𝑞 , 𝑟 𝑠 𝑞 ) (𝑠, 𝑞, 𝑟_{𝑠𝑞}) (s,q,rsq),其中 𝑠 ∈ S , 𝑞 ∈ Q 𝑠∈S, 𝑞∈Q s∈S,q∈Q, 𝑟 𝑠 𝑞 𝑟_{𝑠𝑞} rsq 是学生𝑠在练习𝑒上得到的分数。设L是反应记录的集合。如上所述,我们有分层关系图G。然后,我们给出一个由关系图驱动的认知诊断的清晰表述:

给定:学生的回答记录L,练习和概念的相关性R𝑞𝑐和关系图G;

目标:通过对学生成绩预测过程的建模来诊断学生的认知状态(即对特定知识概念的熟练程度)。

4 RCD: Relation map driven cognitive diagnosis

在本节中,我们首先简要介绍我们的模型的一般描述。然后我们详细介绍模型的各个部分。最后,我们证明了模型的可扩展性。

Overview. 我们的 RCD 模型可以基于异构关系图共同学习学生、练习和概念的关系感知表示,并利用学习到的表示来推断学生对概念的熟练程度。如图 2 所示,RCD 包含三个主要部分:嵌入层、融合层和可扩展诊断层。具体来说,通过获取响应记录,嵌入层输出概念、练习和学生的矢量化嵌入表示。在融合层,我们实现了多层次的注意力结构来自动平衡多层关系图之间的交互信息,从而有效地嵌入学习。融合交互信息后,诊断层利用关系感知嵌入,通过预测每对学生练习的反应分数来推断学生的认知水平。特别是,我们的模型具有卓越的可扩展性,因为它可以自然地将额外的相互作用和结构信息融合到当前方法中并提高它们的性能。

4.1 Embedding Layer

它用𝑑维可训练矩阵

S

∈

R

𝑁

×

𝑑

,

Q

∈

R

𝑀

×

𝑑

和

C

∈

R

𝐾

×

𝑑

S ∈ R^{𝑁×𝑑} , Q ∈ R^{𝑀×𝑑} 和 C ∈ R^{𝐾×𝑑}

S∈RN×d,Q∈RM×d和C∈RK×d 分别对学生、练习和知识概念进行编码。这里的𝑁、𝑀 和𝐾 分别是学生、练习和概念的数量。对于学生

𝑠

𝑧

𝑠_𝑧

sz ,她前面提到的因子

𝒔

𝑧

0

𝒔^0_𝑧

sz0 是通过将他的 one-hot 表示向量

𝒙

𝑧

𝒙^𝑧

xz 与可训练矩阵 S 相乘得到的,即学生嵌入矩阵 S 的第 𝑧 行的转置。 同样,练习

𝑞

𝑑

𝑞_𝑑

qd 的嵌入

q

d

0

q^0_d

qd0是矩阵Q的第𝑑行的转置以及每个相关概念

𝑐

𝑘

𝑐_𝑘

ck的嵌入

𝒄

𝑘

0

𝒄^0_𝑘

ck0是矩阵C的第𝑘行的转置。我们对嵌入层建模:

𝒔

𝑧

0

=

x

z

T

S

,

q

d

0

=

x

d

T

Q

,

𝒄

𝑘

0

=

x

k

T

C

𝒔^0_𝑧 = x^T_zS,\ q^0_d = x^T_dQ,\ 𝒄^0_𝑘 = x^T_kC

sz0=xzTS, qd0=xdTQ, ck0=xkTC(1)

s

z

,

q

d

,

c

k

∈

R

d

a

n

d

x

z

∈

{

0

,

1

}

N

,

x

d

∈

{

0

,

1

}

M

,

x

k

∈

{

0

,

1

}

K

s_z, q_d, c_k \in R^d\ \ and\ \ x_z \in \{0,1\}^N, x_d \in \{0,1\}^M, x_k \in \{0,1\}^K

sz,qd,ck∈Rd and xz∈{0,1}N,xd∈{0,1}M,xk∈{0,1}K

4.2 Fusion Layer

在获得每个学生 𝑠 𝑧 𝑠_𝑧 sz的嵌入 𝒔 𝑧 0 𝒔^0_𝑧 sz0、每个练习 q d q_d qd的嵌入 q d 0 q^0_d qd0和每个概念 c k c_k ck 的嵌入 𝒄 𝑘 0 𝒄^0_𝑘 ck0的矢量表示后,从上一层开始。为了解决第一个挑战,即对学生-运动-概念之间共存的异质性和组织性进行建模,融合层通过迭代式多级融合对互动和结构关系进行统一建模。具体来说,在每个迭代𝑙+1,我们的融合操作会更新学生 𝑠 𝑧 𝑠_𝑧 sz的嵌入 𝒔 𝑧 𝑙 + 1 𝒔^{𝑙+1}_𝑧 szl+1。练习 q d q_d qd的嵌入 𝒒 𝑑 𝑙 + 1 𝒒^{𝑙+1}_𝑑 qdl+1和概念 𝑐 𝑘 𝑐_𝑘 ck的嵌入 𝒄 𝑘 𝑙 + 1 𝒄^{𝑙+1}_𝑘 ckl+1,如图2(b)所示。在下文中,我们将分别介绍如何更新概念、练习和学生的嵌入。

4.2.1 Knowledge Concept Fusion

对于每个知识概念 𝑐 𝑘 𝑐_𝑘 ck,让 𝒄 𝑘 𝑙 𝒄^{𝑙}_𝑘 ckl表示它在第 𝑙 迭代中的嵌入。每个概念出现在概念依赖图 G 𝑐 G_𝑐 Gc中,并且在练习-概念关联图 G 𝑞 𝑐 G_{𝑞𝑐} Gqc 中也扮演着重要的角色。

在 G 𝑐 G_𝑐 Gc中,知识概念之间存在多个教育依赖关系 R 𝑐 R_𝑐 Rc。对于那些有向依赖关系,例如先决关系[8]和补救关系[38],前者的熟练程度预计高于后者[8, 29],其中影响从前驱概念单向传播到后继概念在有向依赖之间。因此,我们将这种类型的依赖定义为 G 𝑐 G_𝑐 Gc中的有向关系,其中概念可以与其前驱概念交互,而不是与后继概念交互。而对于那些无向依赖,例如相似关系[47]和协作关系[19],某个概念熟练程度的提升带来了对其相邻概念的提升,反之亦然,这可以进一步解释为影响是双向的在邻居概念之间传播。受这些观察的启发,我们将这种类型的依赖关系定义为 G 𝑐 G_𝑐 Gc 中的双向关系,其中邻居概念可以相互交互。此外,在 G 𝑞 𝑐 G_{𝑞𝑐} Gqc 中,概念 c k c_k ck 与一组练习相关,其中概念可以与相关练习进行交互。

因此, c k c_k ck 受到来自 G 𝑐 G_𝑐 Gc 的概念依赖聚合和来自 G 𝑞 𝑐 G_{𝑞𝑐} Gqc 的运动相关聚合的影响。让 ˜ 𝒑 𝑙+1 𝑟 表示概念依赖的聚合嵌入,而˜ 𝒆 𝑙+1 𝑘 表示运动相关性的聚合嵌入。然后,每一个概念的更新嵌入𝒄𝑙+ 1个𝑘被建模为:𝒄𝑙+ 1个𝑘=𝒄𝑙𝑘+ O𝑟∈R𝑐η𝑙+ 1𝑘𝑟〜𝒑𝑙+ 1个𝑟+η𝑙+ 1个𝑘1〜𝒆𝑙+ 1个𝑘,(2 )~𝒑𝑙+ 1𝑟= O𝑎∈𝑁𝑟𝑘α𝑙+ 1𝑘𝑎Wc中𝑙𝒄𝑙𝑎,(3)~𝒆𝑙+ 1个𝑘= O𝑏∈𝑁𝑞𝑘β𝑙+ 1𝑘𝑏WQ𝑙𝒒𝑙𝑏,(4)其中方程. (2) 模型每个概念 𝑐𝑘 如何通过融合概念依赖聚合 ˜ 𝒑 𝑙+1 𝑟 与一定的教育关系 𝑟 和运动相关聚合~ 𝒆 𝑙+1 𝑘 以及它自己的嵌入 𝒄𝑘 来更新其嵌入迭代。由于每个概念都出现在概念依赖图中和练习相关图中,等式。 (3, 4) 对每个关系 𝑟 的概念依赖聚合进行建模,并分别从两个局部映射中进行相关聚合。具体来说, 𝑁𝑟𝑘 和 𝑁𝑞 𝑘 分别是包含 𝑐𝑘 与关系 𝑟 的邻居概念的概念集和包含 𝑐𝑘 的邻居练习的练习集。W𝑙 ∈ R𝑑×𝑑 是用于线性变换的可训练矩阵。

此外,在上面的三个方程中,还有三组权重(即

α

𝑘

𝑎

𝑙

+

1

\alpha^{𝑙+1}_{𝑘𝑎}

αkal+1,

β

𝑘

b

𝑙

+

1

\beta^{𝑙+1}_{𝑘b}

βkbl+1 ,

η

𝑘

𝑟

𝑙

+

1

\eta^{𝑙+1}_{ 𝑘𝑟}

ηkrl+1 和

η

𝑘

1

𝑙

+

1

\eta^{𝑙+1}_{ 𝑘1}

ηk1l+1)。它们自然呈现出多层次的结构。特别地,

α

𝑘

𝑎

𝑙

+

1

\alpha^{𝑙+1}_{𝑘𝑎}

αkal+1表示概念

c

k

c_k

ck和

c

a

c_a

ca之间的概念依赖强度,其中

c

k

c_k

ck和

c

a

c_a

ca在概念依赖图中维持教育依赖关系𝑟。

β

𝑘

b

𝑙

+

1

\beta^{𝑙+1}_{𝑘b}

βkbl+1 表示运动-概念相关图中的运动

𝑞

𝑏

𝑞_𝑏

qb与概念

𝑐

𝑘

𝑐_𝑘

ck之间的相关强度。这两个权重可以看作是节点级别的注意力权重,它对每个概念如何平衡每个局部map中的不同关系进行建模。对于eq.(2),

η

𝑘

𝑟

𝑙

+

1

\eta^{𝑙+1}_{ 𝑘𝑟}

ηkrl+1 和

η

𝑘

1

𝑙

+

1

\eta^{𝑙+1}_{ 𝑘1}

ηk1l+1 是map级别的权重,它们学习不同地图的每个方面的贡献。地图级权重平衡了来自不同map的教育依赖关系和运动相关强度。为了对多级结构进行建模,我们设计了一个多级注意力网络来学习注意力权重。具体来说,我们首先计算节点级权重为:

α

𝑘

𝑎

𝑙

+

1

=

𝑭

𝑐

𝑐

(

[

W

c

𝑙

𝒄

𝑘

𝑙

,

W

c

𝑙

𝒄

𝑎

𝑙

]

)

\alpha^{𝑙+1}_{𝑘𝑎}=𝑭_{𝑐𝑐}([W_c^𝑙𝒄^𝑙_𝑘, W_c^𝑙𝒄^𝑙_𝑎])

αkal+1=Fcc([Wclckl,Wclcal]),(5)

β

𝑘

b

𝑙

+

1

=

𝑭

𝑐

𝑞

(

[

W

q

𝑙

𝒄

𝑘

𝑙

,

W

q

𝑙

q

b

𝑙

]

)

\beta^{𝑙+1}_{𝑘b}=𝑭_{𝑐𝑞}([W_q^𝑙𝒄^𝑙_𝑘, W_q^𝑙q^𝑙_b])

βkbl+1=Fcq([Wqlckl,Wqlqbl]), (6)

其中一个全连接层 𝑭 (·) 用于学习具有连接 [·] 的节点注意力权重,其中偏差是可选的。之后,我们将注意力权重归一化,并以

α

𝑘

𝑎

𝑙

+

1

\alpha^{𝑙+1}_{𝑘𝑎}

αkal+1为例:

α

𝑘

𝑎

𝑙

+

1

=

e

x

p

(

α

𝑘

𝑎

𝑙

+

1

)

∑

j

∈

N

k

r

e

x

p

(

α

𝑘

j

𝑙

+

1

)

\alpha^{𝑙+1}_{𝑘𝑎} = \frac{exp(\alpha^{𝑙+1}_{𝑘𝑎})}{\sum_{j \in N^r_k}exp(\alpha^{𝑙+1}_{𝑘j})}

αkal+1=∑j∈Nkrexp(αkjl+1)exp(αkal+1)(7)

由于它们都具有类似的形式,如eq.(7)所示,我们在没有混淆的情况下省略了以下所有节点和map级注意力建模的归一化步骤。在获得节点级注意力权重

α

𝑘

𝑎

𝑙

+

1

\alpha^{𝑙+1}_{𝑘𝑎}

αkal+1 和

β

𝑘

b

𝑙

+

1

\beta^{𝑙+1}_{𝑘b}

βkbl+1后,通过将聚合信息

p

~

r

l

+

1

\widetilde{p}^{l+1}_r

p

rl+1 和

e

~

k

l

+

1

\widetilde{e}^{l+1}_k

e

kl+1带入 Eq.(2),在map上水平注意权重

η

𝑘

𝑟

𝑙

+

1

\eta^{𝑙+1}_{ 𝑘𝑟}

ηkrl+1 和

η

𝑘

1

𝑙

+

1

\eta^{𝑙+1}_{ 𝑘1}

ηk1l+1可以计算:

η

𝑘

𝑟

𝑙

+

1

=

𝑭

𝑐

p

(

[

𝒄

𝑘

𝑙

,

p

~

r

l

+

1

]

)

\eta^{𝑙+1}_{ 𝑘𝑟} = 𝑭_{𝑐p}([𝒄^𝑙_𝑘, \widetilde{p}^{l+1}_r])

ηkrl+1=Fcp([ckl,p

rl+1]) 和

η

𝑘

1

𝑙

+

1

=

𝑭

𝑐

e

(

[

𝒄

𝑘

𝑙

,

e

~

k

l

+

1

]

)

\eta^{𝑙+1}_{ 𝑘1} =𝑭_{𝑐e}([𝒄^𝑙_𝑘, \widetilde{e}^{l+1}_k])

ηk1l+1=Fce([ckl,e

kl+1])(8)

4.2.2 Exercise Fusion

对于每个练习 𝑞𝑑 ,让 𝒒𝑙𝑑 表示它在第 𝑙 层的嵌入。由于每个练习都出现在练习-概念相关图𝐺𝑞𝑐和学生-练习交互图𝐺𝑠𝑞中。练习 𝑞𝑑 受到来自 𝐺𝑞𝑐 的概念相关聚合和来自 𝐺𝑠𝑞 的学生练习交互聚合的影响。具体来说,在𝐺𝑞𝑐 中,每个练习𝑞𝑑 都有主概念集𝑁𝑐 𝑑,练习可以与包含的概念进行交互。在𝐺𝑠𝑞中,每个练习都会由学生进行练习,并通过练习行为和反应与学生互动。让~𝒖 𝑙+1 𝑑 和~ 𝒗 𝑙+1 𝑑 分别表示相关性和交互性的聚合嵌入,类似于概念融合,每个练习𝑞𝑑的更新嵌入𝒒𝑙+1 𝑑可以计算为:𝑙+1 𝒒𝑙𝑑+γ𝑙+ 1个𝑑1〜𝒖𝑙+ 1𝑎+γ𝑙+ 1𝑑2〜𝒗𝑙+ 1个𝑏,(9)~𝒖𝑙+ 1 d = O𝑎∈𝑁𝑐𝑑μ𝑙+ 1𝑑𝑎WCU𝑙𝒄𝑙𝑎,(10 ) ˜𝒗 𝑙+1 𝑑 = Õ 𝑏 ∈𝑁𝑠 𝑑 𝜈𝑙+1 𝑑𝑏 Ws 𝑙 𝒔𝑙𝑏 , (11) 其中方程。 (9) 展示了每个练习 𝑞𝑑 如何融合来自不同地图的概念相关聚合 ˜ 𝒖 𝑙+1 𝑎 和学生交互聚合 ˜ 𝒗 𝑙+1 𝑏,以及来自前一次迭代的自己的嵌入 𝒒𝑙𝑑。 𝑁𝑐 𝑑 和 𝑁𝑠 𝑑 分别表示练习 𝑞𝑑 的相关概念和学生的集合,而 𝛾𝑙+1 𝑑1 和 𝛾𝑙+1 𝑑2 是从𝑞𝑐𝑑2 是映射级的聚合权重𝑞𝑐𝑐𝑑2 的映射关系聚合。 𝜇𝑙+1 𝑘𝑎 和 𝜈𝑙+1 𝑘𝑏 是节点级权重,用于模拟每个练习如何平衡每个局部地图中的相关聚合和交互聚合。上述三组权重可以建模为类似于等式所示的形式。 (5 - 8)。

4.2.3 Student Fusion

一般来说,融合层在经过𝐿次的迭代融合过程后,统一建立学生-练习-概念之间的互动和结构关系。

4.3 Extendable Diagnosis Layer

通过学生、练习和概念的融合关系感知表示(即分别为 𝒔𝑧 、 𝒒𝑑 和 𝒄𝑘 ),我们最终预测学生的运动表现并通过诊断层中的学生反应记录联合训练 RCD。为了保持 RCD 作为通用框架,诊断层经过精心设计,以兼容大多数先前工作所遵循的统一诊断模式,可以正式描述如下。学生𝑠𝑧的各记录练习锻炼𝑞𝑑包含𝑛概念{𝑐𝑘}𝑛1,诊断层预测正确𝑞𝑑作为𝑠𝑧答案的概率:𝑦𝑞𝑑= A(S(𝒉𝑧,𝒉𝑑)),𝑤ℎ𝑒𝑟𝑒S(𝒉𝑧,𝒉𝑑 ) = T (U(𝒉𝑧 − 𝒉𝑑 ))。 (13) 𝒉𝑧 代表学生因素(如能力水平),𝒉𝑑 代表运动因素(如难度水平)。 S(·)是一个评分函数,用于评估学生对练习中每个概念的表现,A(·)是一个累积函数,例如平均运算,它根据练习中包含的概念有选择地累积效用。具体来说,评分函数由两部分组成。首先,效用函数 U(·) 量化了学生与由 (𝒉𝑧 − 𝒉𝑑 ) 表示的练习之间的优势效用,例如,将学生能力与练习难度进行比较。然后,变换函数 T (·) 将分数归一化为概率预测。

在 RCD 的典型实现中,A(·) 是对相关概念的平均运算,U(·) 是表示为 𝑭 (·) 的全连接层,输出标量,T (·) 是常用的 Sigmoid 𝜎 (·)。

为了从关系感知表示中生成学生因子 𝒉𝑧 和练习因子 𝒉𝑑,我们通过神经网络 𝒇𝑠𝑐 和 𝒇𝑞𝑐 将概念嵌入到学生和练习嵌入中。形式上,RCD的诊断层是:𝑦𝑞𝑑= 1𝑛Õ𝑐𝑘σ(𝑭(𝒉(𝑘)𝑧 - 𝒉(𝑘)d)),(14)𝒉(𝑘)𝑧=σ(𝒇𝑠𝑐(𝒔𝑧⊕𝒄𝑘) ), (15) 𝒉(𝑘) 𝑑 = 𝜎(𝒇𝑞𝑐 (𝒒𝑑 ⊕ 𝒄𝑘 ))。 (16)

我们可以用每个诊断预测 𝑦 与其对应的基本事实 𝑟 之间的交叉熵损失联合训练 RCD:损失 = − Õ 𝑖 (𝑟𝑖 log𝑦𝑖 + (1 − 𝑟𝑖 ) log (1 − 𝑦)𝑖 ) (17)

通过上述损失优化,方程中的𝒉(𝑘) 𝑧的向量。 (15) 表示学生𝑠𝑧 对概念𝑐𝑘 的知识熟练程度。如果我们只是想估计她的掌握值,受 [26] 的启发,我们将练习因子 𝒉(𝑘) 𝑑 屏蔽为零,因为 0 = (0, 0, . . . , 0),并从方程中获得掌握水平估计. (14):

最后,我们演示了 RCD Eq 的诊断层如何。 (14, 15, 16) 也适用于一般的诊断模式方程。 (13).事实上,我们可以利用融合层的输出来构建任意形式的 CD 方法。这里我们以一般方法为例。通常,为了扩展现有的 CD 模型,我们将学生因子和运动因子替换为 RCD 输出的因子(即𝒉𝑧 和 𝒉𝒅),然后专门化效用和累积函数。代表性模型的可扩展性如下所示:

IRT。采取IRT的典型形成:𝑦=σ((ℎ𝑝𝑟𝑜 - ℎ𝑑𝑖𝑓𝑓)×ℎ𝑑𝑖𝑠𝑐)为例,其中ℎ𝑝𝑟𝑜,ℎ𝑑𝑖𝑓𝑓和ℎ𝑑𝑖𝑠𝑐降级学生的熟练程度,分别锻炼困难和歧视。为了从IRT扩展,在效用函数U(·)中,我们将𝒉𝑧和𝒉𝒅分别投影到一维ℎ𝑝𝑟𝑜和ℎ𝑑𝑖𝑓𝑓,并将ℎ𝑑𝑓设置为额外的训练参数𝑐;对于累积函数A(·),我们简单地将其设置为恒等。

MIRT。

MIRT是IRT的多维扩展[2]:𝑦=𝜎(𝑸𝒆·(𝒉𝑠 − 𝒉𝑒)),其中𝒉𝑠和𝒉𝑒是学生和练习的潜在特征向量,是相关概念的一个-𝑒 𝑒。为了从 MIRT 扩展,我们只需将𝒉𝑠 和 𝒉𝑒 替换为我们的𝒉𝑧 和 𝒉𝒅,设置效用函数 U(·) 为恒等式,并将累加函数 A(·) 从平均运算改为求和运算。

NCD。 NCD 更普遍地将学生-练习交互建模为:𝑦 = 𝐹 (𝑸𝒆 ◦ 𝒉𝒔 − 𝒉𝒅𝒊𝒇 𝒇 × ℎ𝑑𝑖𝑠𝑐 ),其中表示全多层连接层。与IRT和MIRT类似,我们用我们的𝒉𝑧和𝒉𝒅替换𝒉𝑠和𝒉𝑑𝑖𝑓𝑓,将ℎ𝑑𝑖𝑠𝑐视为基于累加函数的神经网络中的可训练参数(基于累加和效用函数)(A·U·集合)。

MF。根据 [44],MF 可以被视为 NCD 模型的一个特例,其中 𝒉𝑑𝑖 𝑓 𝑓 ≡ 0 和 ℎ𝑑𝑖𝑠𝑐 ≡ 1。因此,从 MF 扩展很简单。此外,我们还可以通过将分数矩阵分解为 𝒉𝑧 和 𝒉𝑑 来实现 MF。

5 Experiments

由于这项工作的主要贡献是设计具有交互和结构信息的关系图,以实现准确且可解释的认知诊断 (CD),因此我们进行了实验以回答以下研究问题:

RQ1:与现有的 CD 模型相比,我们提出的RCD 在准确性方面表现如何?

RQ2:当将 RCD 混合交互和结构信息用于当前方法时,模型的性能如何?

RQ3:RCD 对多层次学生-练习-概念交互建模的有效性如何?

RQ4:RCD 在关系图中捕捉学生-练习概念交互的能力如何?

RQ5:RCD 对 CD 诊断学生知识状态的解释如何?

5.1 Dataset Description

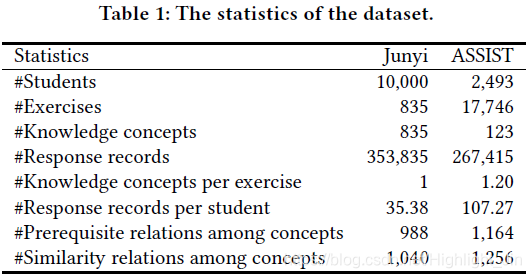

我们在两个真实世界的数据集上进行实验,即 Junyi 和 ASSIST,它们都包含学习者的运动表现记录和运动概念相关性。此外,君易还提供了专家标注的概念依赖关系。在这两种学习系统中,学生可以重新提交他们的答案,直到他们通过评估。由于这些原始数据集不适合静态诊断,我们首先对每个数据集进行预处理,对每个学生的多个提交仅采用第一个提交,以受到 [21] 的启发。为了保证每个学生都有足够的数据进行诊断,我们删除了每个数据集尝试少于 15 条响应记录的学生,类似于 [31, 44]。数据集的完整统计信息如表 1 所示。

5.1.1 Junyi.

对于Junyi数据集,概念依赖关系包含前提条件和相似性。在前提关系中,每个概念对(𝑐𝑖 , 𝑐 𝑗)表示前者是后者的前提条件,例如,(一位数加法,一位数乘法)。在相似性关系中,由于原始数据格式为(𝑐𝑖 , 𝑐 𝑗 , value),其中value表示两个概念之间的相似性强度,1≤value≤9,例如。(vertical_angles, angle_types, 5.22),我们将阈值设为5.0,得到相似关系,即如果值≥5.0,𝑐𝑖和𝑐𝑗就相似。此外,我们随机选择10,000个学习者的响应记录,以得到与[49]类似的数据集。

此外,我们根据反应记录进行分析,以验证教育依赖性的存在。受[29, 40]的启发,我们为概念对(𝑐𝑖 , 𝑐 𝑗 )定义了以下概率方程。𝑃𝑖 𝑐 = 𝑛𝑐 (𝑐 𝑐 |𝑐 )/𝑛(𝑐 𝑐 |𝑐 ) 其中𝑛(𝑐 𝑐 |𝑐 ) 和𝑛𝑐 (𝑐 𝑐 |𝑐 ) 分别是概念𝑐𝑗被回答和概念𝑐𝑗在𝑐𝑖被正确回答后立即被回答的计数。

我们分别计算先决条件和相似关系的概率,并表示为𝑃𝑝 𝑖 𝑗和𝑃𝑠 𝑖 𝑗 。那么,让𝑃𝑛𝑗=𝑛𝑐(𝑐 𝑐 )/𝑛(𝑐 𝑐 )表示非条件正确性概率,其中𝑛𝑐(𝑐 𝑐 )和𝑛(𝑐 𝑐 )分别为正确回答和𝑐 𝑐 的计数。如图3所示,我们可以得到,学生在掌握了相关知识概念后,正确回答的概率会提高。这一结果表明,概念之间存在着教育依赖性。

5.1.2 ASSIST.

对于ASSIST数据集,原始数据中没有明确提供教育依赖关系。为了构建概念结构,我们提供了一种基于某些统计数据的实施方法,其灵感来自[29, 40]。在此,我们定义了与Junyi类似的两类教育关系(即前提关系和类似关系),并引入了以下矩阵来协助构建概念依赖图。

正确矩阵是一个概率矩阵,表示为C。我们根据行使记录计算矩阵C,其中C𝑖, 𝑗是Í𝑛𝑖, 𝑗 𝑛𝑖,𝑘,如果𝑖≠𝑗;否则,为0。这里,𝑛𝑖, 𝑗代表概念𝑗被正确回答后,紧接着𝑖被正确回答的计数

过渡矩阵是一个二元过渡矩阵,用T表示,其中T𝑖, 𝑗=1表示概念𝑖有一条边指向𝑗。为了得到过渡矩阵,我们首先计算𝑇˜:𝑇˜𝑖 𝑗 = 𝐶𝑖 𝑗-𝑚𝑖𝑛(𝐶) 𝑚𝑎𝑥(𝐶)-𝑚𝑖𝑛(𝐶) 。

𝑇˜𝑖 𝑗是概念𝑖与概念𝑗之间存在某种教育关系的概率。然后,我们通过T𝑖来确定关系,如果𝑇˜𝑖 𝑗>ℎ𝑟𝑒𝑠ℎ𝑜𝑙𝑑,𝑗=1。在本文中, 我们将𝑡ℎ𝑟𝑒𝑠ℎ𝑜𝑙𝑑设为矩阵T的平均值的三次方

概念依赖图是概念依赖矩阵。特别是,概念𝑟𝑖与概念𝑐𝑖之间的依赖关系𝑗表示前提条件,如果T𝑖,𝑗=1,但T𝑗,𝑖≠1,这表示𝑐𝑗是𝑐𝑖的继承者。而𝑟𝑖 𝑗表示相似性,如果T𝑖, 𝑗 ×T𝑗, 𝑖 = 1.

5.2 Experimental Settings

5.2.1 Baselines and Evaluation Metrics

为了验证我们提出的RCD模型的有效性,我们将其与一些基线进行比较。

具体来说,比较的基线从两个方面选择。一个是CD领域的代表性方法,如IRT、MIRT、MF和NCD。具体说明如下。

- IRT[13]作为最流行的CD方法,通过一个线性函数对单维的学生和练习的特征进行建模。

- MIRT[1]是IRT的一个多维扩展,对学生和练习的多种知识能力进行建模。

- MF[28, 41]通过分解分数矩阵预测学生的成绩,得到学生和练习的潜在特征向量。

- NCD[44]是最新的深度学习CD模型之一。

它用神经网络对高阶和复杂的学生-练习互动函数进行建模。

另一个方面是竞争性的异质图表示学习方法,如下图所示。- metapath2vec[11]设计了一个基于元路径的随机行走,并利用skip-gram来学习异质图。

- GTN[50]是一种半监督的方法,可以自动学习有用的元路径。我们根据局部地图生成元路径的邻接矩阵。

- HAN[46]利用结构和节点特征进行网络嵌入。我们为更好的HAN设置了多条元路径。

- HetG[51]基于重启的随机行走对节点级信息进行采样,并通过LSTM[18]聚合融合这些节点。

我们通过设置每个路径的深度为5,每个节点的采样次数为20来实现HetG。

为了衡量我们模型的性能,我们从回归和分类的角度采用不同的指标。

从回归的角度来看,我们选择均方根误差(RMSE)[32]来量化预测分数(即连续变量范围为0和1)和实际分数之间的距离。从分类的角度来看,我们认为学生回答错误或正确可以分别代表0和1。因此,我们使用预测准确率(ACC)[44]和ROC曲线下面积(AUC)[5]进行模型评估。

5.2.2 Parameter Settings.

为了设置训练过程,我们用Xavier初始化[29]来初始化所有网络参数。每个参数都是从𝑈(- p 2/(𝑛𝑖𝑛 + 𝑛𝑜𝑢𝑡), p 2/(𝑛𝑖𝑛 + 𝑛𝑜𝑢𝑡)中采样,其中𝑛𝑖𝑛和𝑛𝑜𝑢𝑡分别表示送入和送出神经元的数量。我们使用亚当算法[23]进行优化,并将迷你批次大小设置为256。为了公平起见,我们将学生、练习和概念的嵌入维度设置为所有关系图驱动方法以及NCD的概念数。此外,我们只是将融合操作的迭代次数设置为2,以探索高阶复杂的学生-练习-概念之间的相互作用。我们用PyTorch实现了所有的模型,并在一台有四个2.0GHz英特尔至强E5-2620 CPU和一个Tesla K2/0m GPU的Linux服务器上进行实验。所有的模型都被调整为具有最佳性能,以确保公平性3。

5.3 Performance Comparison (RQ1 and RQ2)

为了回答RQ1和RQ2,我们将RCD与几个基线在学生成绩预测上的表现进行了比较。此外,我们通过将结构信息融合到当前基于RCD的方法中来实现一些基于关系的方法(即R-IRT、R-MIRT、R-MF和R-NCD)。特别是,我们另外通过神经网络将概念因素融合到类似于公式(15,16)的学生和练习因素中,以提高性能,其他设置也根据4.3小节的描述通过神经网络进行适当的强化。表2报告了所有模型对学生成绩预测的总体表现,最好的分数用黑体表示。有几个观察结果。首先,RCD在所有的数据稀疏度下都表现最好,这表明对CD任务的多层次的学生-练习-概念的交互作用进行建模可以取得出色的表现,这可以回答RQ1。其次,几乎所有基于关系图的方法都比不考虑这种复杂交互作用的基线表现更好。这一观察结果表明,为CD建立学生、练习和概念之间完整而全面的交互模型是必要的,并回答了RQ2。最后,NCD在基线中表现最好,可能是因为NCD建立了高阶学生-练习的关系,比那些线性建模方法具有令人满意的近似能力。

这些证据表明,整合多层次的互动关系可以提高学生成绩预测的准确性。在下文中,我们进一步对训练数据进行实验,以验证RCD的建模能力。

5.4 The Effectiveness of Multi-level Relations Modeling (RQ3)

为了回答RQ3,我们将RCD与几种有竞争力的异质图表示学习方法在成绩预测任务上进行比较。具体来说,我们在融合层采用不同的图学习方法(即HetG、HAN、GTN和metapath2vec),并设置相同的诊断层。如图4所示,RCD获得了最好的分数。这一结果表明,多层次的融合建模适合于建立多层学生-练习-概念的互动模型。同时,HAN和HetG作为其精心设计的分层聚合函数也取得了良好的性能。这些结果可以证明,我们提出的RCD模型具有突出的建模能力。

5.5 Relation Map Analysis (RQ4)

为了回答RQ4,我们分别对概念依赖图、练习-概念相关图和学生-练习互动图进行了一些有趣的可视化实验,以证明RCD的互动关系建模能力。

5.5.1 Concept Similarity

在概念依赖图中,我们探索知识概念之间的相似性。具体来说,在通过训练过的模型获得每个概念嵌入后,我们用欧氏距离来衡量每对概念之间的相似性。我们分别计算具有相似性和先决条件关系以及无明确关系的概念之间的相似度。

这里我们定义,如果概念超过两跳就没有关系。图5以方框图的形式说明了概念对的结果。从图中我们可以看出,具有相似关系的概念在每个数据集上都有最接近的相似度。同时,具有相似或先决关系的概念比没有明确关系的概念更接近。这些结果清楚地表明,RCD可以很好地捕捉概念之间的关系。

5.5.2 Exercise-Concept Correlation

在练习-概念相关图中,我们旨在分析练习和从RCD中学到的概念之间的关系。具体来说,在每一对练习(𝑞𝑖 , 𝑞𝑗)之间,存在着三种关系。(1) 𝑞𝑖的主要概念与𝑞𝑗相似;(2) 𝑞𝑖的主要概念是𝑞𝑗的先决条件,反之亦然;(3) 𝑞𝑖和𝑞的概念之间没有明确关系。在这一部分中,我们使用了Junyi中的所有习题,并在ASSIST中随机抽取了2000个习题。我们根据这三种关系将习题对划分为三组,并计算每对习题的欧氏距离。此外,我们还测量了从没有关系融合过程的模型中学到的习题之间的距离,以进行比较。图6显示了结果。(1)通过RCD学习的习题之间的距离,与相似的、先决条件的和没有关系的习题之间的距离呈现明显的增加趋势;(2)对于没有关系融合的模型,很难区分习题之间的不同关系。这些发现表明,RCD有很好的能力来学习习题和知识概念之间的关联。

5.5.3 Student Exercising Interaction

在学生-习题互动图中,我们旨在探索RCD是否能够捕获学生和习题之间的互动。具体来说,受[15]的启发,我们首先定义每个学生-练习互动关系𝑟𝑠𝑞的嵌入为。𝑓 (𝑟𝑠𝑞) = 𝑓 (𝑠) - 𝑓 (𝑞), 其中 𝑓 (𝑠) 和 𝑓 (𝑞) 分别表示学生𝑠和练习𝑞从RCD学到的嵌入表示。由于练习的交互关系可以反映学生的表现,我们根据真实的表现数据,将每个关系𝑟𝑠𝑞明确标记为 "𝑐𝑜𝑟𝑟𝑒𝑐 "或 “𝑐𝑜𝑟𝑟𝑒𝑐”。然后,我们将所有从数据集中提供的学生练习回答投射到向量𝑓(𝑟𝑠𝑞),并利用T-SNE方法[42]将向量维度降低到二维空间。我们随机选择10,000个相互作用进行可视化。如图所示。7,相同颜色的交互有相同的标签。我们可以看到,回答正确的互动主要集中在图的左侧,而回答错误的互动主要集中在另一侧。这说明我们的关系图可以捕捉到学生和练习之间的互动关系。此外,图中也有一些混乱的互动点。这是因为学生的练习反应是一个复杂的过程,仅仅根据学生在概念上的状态来估计学生的表现是不够准确的。例如,即使一个学生没有掌握某些概念,她也可能在巧合下正确地回答相关的练习。我们将在未来继续探索更深层次的互动。

5.6 Interpretation of the Diagnosis (RQ5)

我们将诊断报告可视化,并评估RCD的解释。这种可视化帮助学生和教师有效而直观地认识到前者的知识状态。在这里,我们根据学生的诊断能力与概念依赖图中给定的教育依赖关系是否合理来评估其可解释性。我们随机抽出一个学生,在图8中描述了她对一个概念子集的熟练程度。

图8(a)显示了概念子集的依赖结构,其中包含相似性和先决条件关系。图8(b)显示了诊断结果,雷达图上的每一个点都代表了对某个知识概念的掌握程度。特别是,红线(有融合)表示通过整合关系图(由训练有素的模型提供)的诊断能力,蓝线(无融合)表示忽略融合过程的能力。从图中可以看出,概念○1(交替外角)、○3(平行线1)和○5(线段加法)的熟练度在融合概念依赖关系后得到提升,其中概念○3和概念○5作为○1的相似邻居。同时,概念○4(同侧外角)是稳定的,而概念○2(对应角)明显减少,其中○2是○4的继承者。这些观察表明。(1)相似知识概念的熟练程度可以相互影响;(2)沿着先决条件关系的影响在RCD中只是单向传播的。从结果中,我们可以看出,由于对概念依赖关系的建模能力,RCD能够为CD诊断学生的知识状态提供更好的可解释性见解。

6 Conclusion

在本文中,我们提出了一个通用的认知诊断(CD)框架,即关系图驱动的认知诊断(RCD),它全面考虑了学生-练习-概念之间的关系来进行认知诊断。具体来说,我们首先将学生、练习和概念表示为分层布局中的单个节点,并构建了三个定义明确的局部关系图以纳入层间和层内关系。然后,我们设计了一个多层次的注意力网络来整合每个局部地图中的节点级关系聚合,并平衡不同地图的地图级聚合。之后,我们设计了一个可扩展的诊断函数来预测学生的成绩。最后,在真实世界的数据集上进行的广泛实验清楚地表明了我们的RCD框架的有效性和可扩展性。我们希望这项工作能带来进一步的研究。

1371

1371

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?