cs231n每半年更新一次,最近看了新的版本,整理了下之前学习的笔记和作业。

.Diffuculty of Recogonition:

illumination, deformation, Background Clutter, Intraclass variation,etc..

1.Nearest Neighbor Method(现在深度学习框架内很少使用)

train:O(1)

test:O(n)

test时将待估计的图片image_e与train所有的N张数据比较,选距离最近的一张image_i,那么train_i对应的label就是待估计的图片的label。 当然实际常常使用KNN算法,在K张最近(这个近可以用各类距离来衡量,也可以用自定义的方式来衡量)的图片中,如果某个label的图片数量最多,则image_e的label就是这个label。

如果训练集太大,将test图像与每个traing数据计算数据量太大,则可使用pproximate Nearest Neighbor library (e.g. FLANN)

如何选K?

交叉验证来训练:最好将训练数据分N段,每次选择一部分作为为traing, 一部分(往往是一段)作为validataion,在validataion中尝试不同的K值(分一部分作为validatiaon,相当于在测试过程中不断做:test-train-test的过程)

2.Linear Classification

将任何输入和输出之间的关系视为一个函数时,深度学习为了拟合非线性函数,基本架构是一层线性分类器+一层非线性函数(Relu,softmax,etc..)

(以下都以cifar-10为例)

f的值是一个10x1的向量,分别表示这10个label的score高低,这10维的向量中哪个元素最高,就意味着这个图像x属于该元素对应的类别。

2.1 loss(cost, objective) function

loss function的结果作为评价如今模型W等参数好坏/是否收敛的指标。其中loss function有很多形式,具体可参见:参见我的文章机器学习中常用的loss function

2.2 weight W and bias b

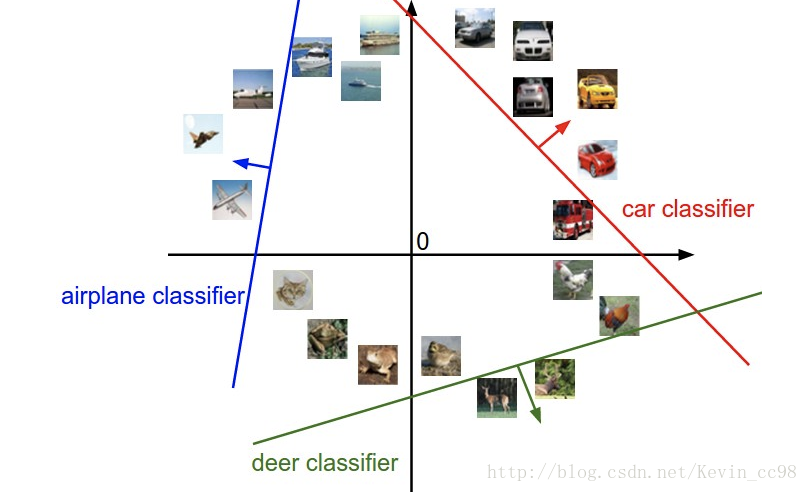

从几何上,W的作用可以解释为:(如果将image的像素压栈成一列,则如cafar-10的图像都在3072维的空间上)改动(1)式子中的weight任一行,相当于将图像在图像空间中旋转一个不同的角度,如图:

(该图是将图像空间”压”到二维平面上)

car的红色箭头表示score增长的方向,红线以左是score为0的部分。

如果label有10个,则W(10x3072)相当于10个不同的高纬度直线,各自将3072维度的空间切割开,使得不同的label对应的图像在直线的一边。

从模板上,W可以解释为:

W的每一行都是与相应的image内积,而W是归一化的,我们知道,当两个向量a,b的模都固定且b固定时,a平行于b时,也即是a的各维参数分布和b相同,a*b=|a||b|cosr有最大的值。从图中也可以发现,对应分类的模板具有和类别模糊相似的特征,比如大约能看出这是汽车,马等:

而b的作用,在于平移高纬直线,以免如果image的图像像素值为0时获得score为0.

常见的做法是将w,b合为一个矩阵:用齐次表达

2.3 regularization

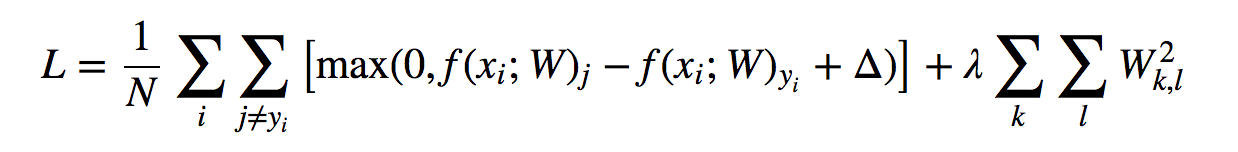

如果把W看做一个模板的话,在整个数据集上,nW和W的效果是一样的。我们可以归一化数据集,同样也可以归一化W。常见的做法用W的L2范式:

在所有loss function小项之后,加一个这个正则项:

所谓正则,就是纠正、调整的意思。

W正则化还有个好处是更倾向考虑到输入的所有维度。对于只考虑一小部分维度的W和考虑到所有维度(当然对应权重会更小)的W,当Wx结果一样时,后者的正则项会更小。这样也有助于减少overfitting.

而上文的

λ

是数据项(前边的项)和正则项之间进行权衡,

所以以SVM loss的最终版评价W的损失函数为:

3645

3645

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?