前言

感受野(receptive field):从CNN可视化的角度来讲,就是输出feature map某个节点的响应对应的输入图像的区域就是感受野。

一、感受野的概念

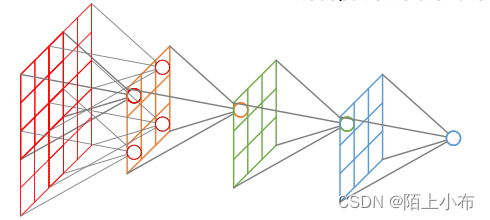

- 在卷积神经网络中,感受野(Receptive Field)的定义是卷积神经网络每一层输出的特征图(feature map)上的像素点在输入图片上映射的区域大小。再通俗点的解释是,特征图上的一个点对应输入图上的区域,如图所示。

二、感受野的例子

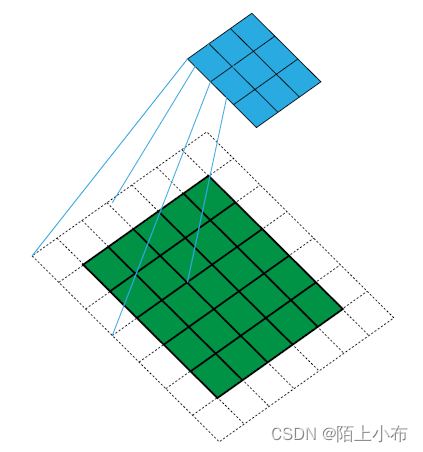

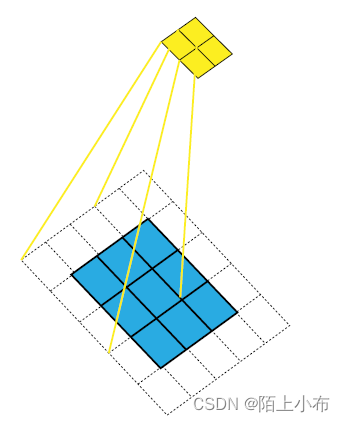

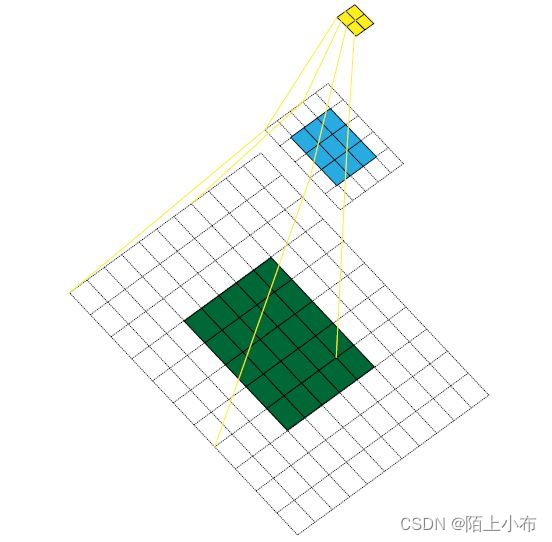

在学习计算感受野之前,先可视化一下感受野吧。举一个例子,原始图像为5✖5,卷积核(Kernel Size)为3✖3,padding 为1✖1,stride为2✖2,依照此卷积规则,连续做两次卷积。熟悉卷积过程的朋友都知道第一次卷积结果是3✖3大小的feature map,第二次卷积结果是2✖2大小的feature map。整个过程如图所示:

第一次卷积得到3✖3的 feature map,RF为3✖3

第二次卷积得到2✖2的feature map

黄色feature map对应的感受野是7✖7大小

如图所示,第一层卷积结束后,感受野是3✖3。在第二层卷积结束了,感受野是7✖7

三、感受野大小的计算

- 感受野计算时有下面几个知识点需要知道:

1.最后一层(卷积层或池化层)输出特征图感受野的大小等于卷积核的大小。

2.第i层卷积层的感受野大小和第i层的卷积核大小和步长有关系,同时也与第i+1层感受野大小有关。

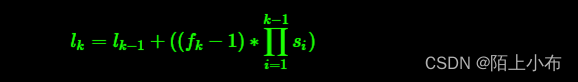

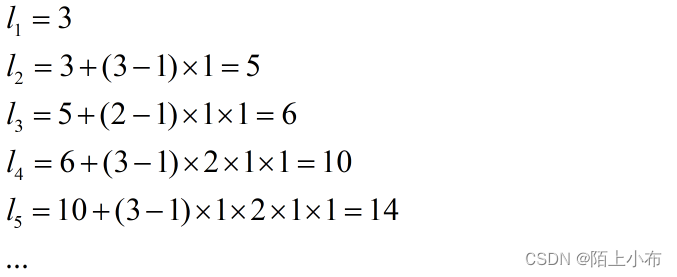

3.计算感受野的大小时忽略了图像边缘的影响,即不考虑padding的大小。 - 具体计算公式如下:

其中l为感受野大小,f为卷积核大小,或者是池化层的池化尺寸大小,s为步长,k代表网络层数。

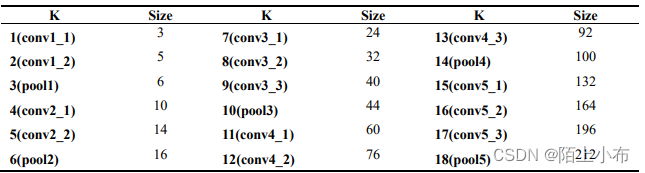

四、计算VGG-16网络每层的感受野

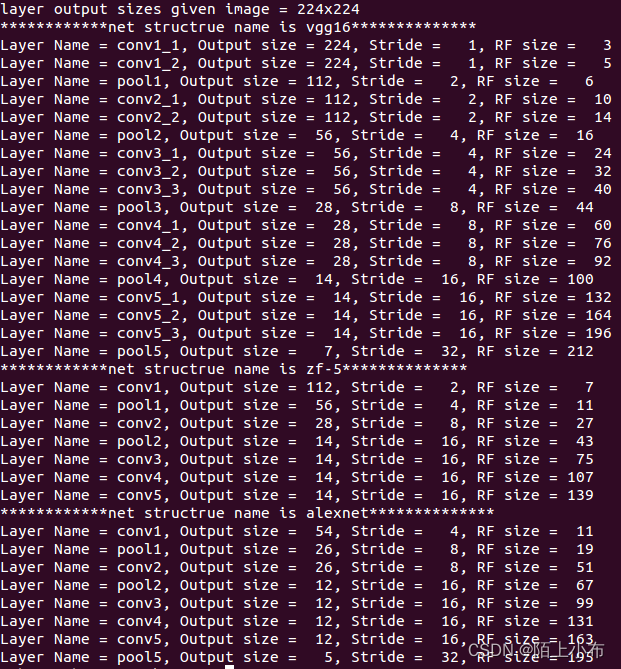

用python实现了计算Alexnet zf-5和VGG-16网络每层输出feature map的感受野大小,实现代码:

#!/usr/bin/env python

net_struct = {'alexnet': {'net':[[11,4,0],[3,2,0],[5,1,2],[3,2,0],[3,1,1],[3,1,1],[3,1,1],[3,2,0]],

'name':['conv1','pool1','conv2','pool2','conv3','conv4','conv5','pool5']},

'vgg16': {'net':[[3,1,1],[3,1,1],[2,2,0],[3,1,1],[3,1,1],[2,2,0],[3,1,1],[3,1,1],[3,1,1],

[2,2,0],[3,1,1],[3,1,1],[3,1,1],[2,2,0],[3,1,1],[3,1,1],[3,1,1],[2,2,0]],

'name':['conv1_1','conv1_2','pool1','conv2_1','conv2_2','pool2','conv3_1','conv3_2',

'conv3_3', 'pool3','conv4_1','conv4_2','conv4_3','pool4','conv5_1','conv5_2','conv5_3','pool5']},

'zf-5':{'net': [[7,2,3],[3,2,1],[5,2,2],[3,2,1],[3,1,1],[3,1,1],[3,1,1]],

'name': ['conv1','pool1','conv2','pool2','conv3','conv4','conv5']}}

imsize = 224

def outFromIn(isz, net, layernum):

totstride = 1

insize = isz

for layer in range(layernum):

fsize, stride, pad = net[layer]

outsize = (insize - fsize + 2*pad) / stride + 1

insize = outsize

totstride = totstride * stride

return outsize, totstride

def inFromOut(net, layernum):

RF = 1

for layer in reversed(range(layernum)):

fsize, stride, pad = net[layer]

RF = ((RF -1)* stride) + fsize

return RF

if __name__ == '__main__':

print "layer output sizes given image = %dx%d" % (imsize, imsize)

for net in net_struct.keys():

print '************net structrue name is %s**************'% net

for i in range(len(net_struct[net]['net'])):

p = outFromIn(imsize,net_struct[net]['net'], i+1)

rf = inFromOut(net_struct[net]['net'], i+1)

print "Layer Name = %s, Output size = %3d, Stride = % 3d, RF size = %3d" % (net_struct[net]['name'][i], p[0], p[1], rf)

#receptiveField.py

执行后的结果如下:

6621

6621

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?