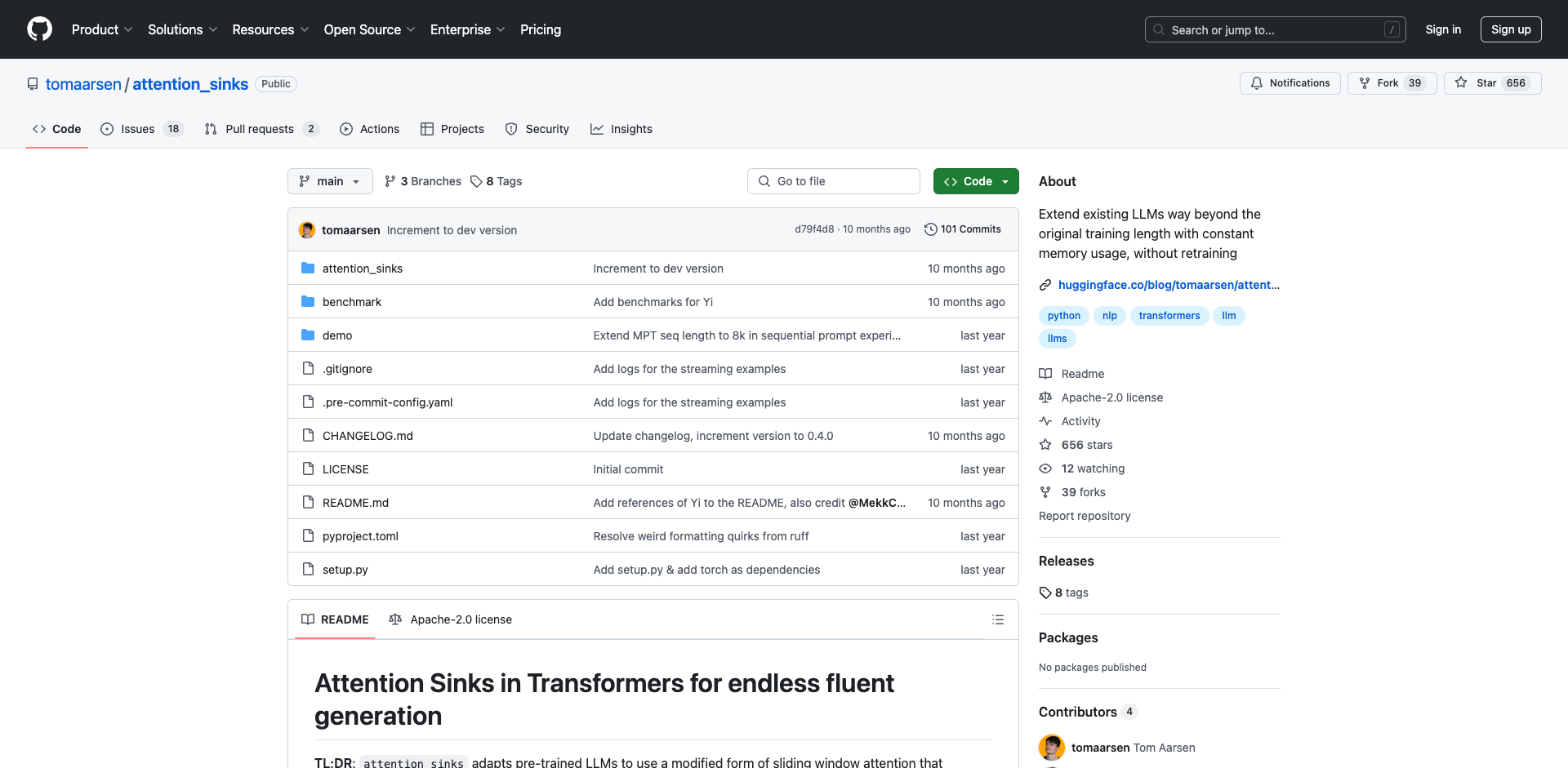

Attention Sinks 简介

Attention Sinks 是一种新的注意力机制,可以让预训练语言模型生成无限长度的连贯文本,同时保持恒定的内存使用。它通过保留初始 token 的注意力信息(称为"注意力池"),并使用滑动窗口来处理最近的 token,从而实现了高效的长文本生成。

Attention Sinks 的主要优势包括:

- 能够生成无限长度的流畅文本,而不会出现质量下降

- 内存使用保持恒定,不会随着生成长度增加而增加

- 不需要对模型进行重新训练,可以直接应用于现有的预训练模型

使用方法

使用 Attention Sinks 非常简单,只需要将模型导入从 attention_sinks 替换为 transformers:

from attention_sinks import AutoModelForCausalLM

model = AutoModelForCausalLM.from_pretrained("meta-llama/Llama-2-7b-hf", device_map="auto")

生成文本的方式与 transformers 相同:

import torch

from transformers import AutoTokenizer, TextStreamer, GenerationConfig

from attention_sinks import AutoModelForCausalLM

model_id = "meta-llama/Llama-2-7b-hf"

model = AutoModelForCausalLM.from_pretrained(

model_id,

device_map="auto",

torch_dtype=torch.float16,

attention_sink_size=4,

attention_sink_window_size=1020,

)

tokenizer = AutoTokenizer.from_pretrained(model_id)

text = "Attention Sinks 的主要优势是"

input_ids = tokenizer.encode(text, return_tensors="pt").to(model.device)

with torch.no_grad():

streamer = TextStreamer(tokenizer)

generated_tokens = model.generate(

input_ids,

generation_config=GenerationConfig(

use_cache=True,

min_new_tokens=100,

max_new_tokens=1000,

),

streamer=streamer,

)

相关资源

- Attention Sinks GitHub 仓库 - 官方实现和文档

- Efficient Streaming Language Models with Attention Sinks 论文 - 介绍 Attention Sinks 原理的论文

- Hugging Face Blog: Attention Sinks - 详细介绍 Attention Sinks 工作原理的博客文章

- Attention Sinks 演示脚本 - 展示无限长度文本生成的演示代码

- Attention Sinks FAQ - 常见问题解答

总结

Attention Sinks 为大型语言模型的长文本生成提供了一个简单而有效的解决方案。它不仅能够生成无限长度的流畅文本,还能保持恒定的内存使用,是一个值得关注和尝试的新技术。无论是对于研究人员还是实践者,Attention Sinks 都提供了广阔的应用前景。

项目链接:www.dongaigc.com/a/attention-sinks-introduction-guide

https://www.dongaigc.com/a/attention-sinks-introduction-guide

www.dongaigc.com/p/tomaarsen/attention_sinks

https://www.dongaigc.com/p/tomaarsen/attention_sinks

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?