最近更新时间:2023.7.11

最早更新时间:2023.4.20

本文将对对比学习相关内容进行介绍。

损失函数见我撰写的另一篇博文:机器学习/深度学习中的常用损失函数公式、原理与代码实践(持续更新ing…)

1. 对比学习

对比学习是表征学习,意在使相似样本表征相近,使不相似的更远。

看起来很像度量学习(metric learning)

pre-text task:代理任务

- instance discrimination个体判别(一张图片算一类):随机裁剪+增广(transform)得到两张新图(正样本),其他图片都算负样本

2. NLP对比学习

- (2021 NeurIPS) SimCSE: Simple Contrastive Learning of Sentence Embeddings:无监督版以同一输入经Bert后的不同输出为相似样本(因dropout产生不同输出),有监督版用NLI数据集实现

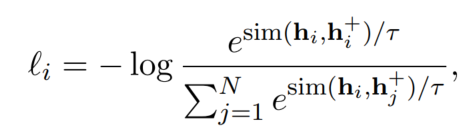

训练目标(看起来像softmax,目标也确实相似:最大化正确类别的概率,并最小化错误类别的概率):

- (2023 EANN) DACL: A Domain-Adapted Contrastive Learning Approach to Low Resource Language Representations for Document Clustering Tasks

- (2023) Efficient Document Embeddings via Self-Contrastive Bregman Divergence Learning:用SimCSE训练Longformer(结合了其他模型,具体的我还没看)

3. 图对比学习

- (2023 TKDD) Multi-View Graph Representation Learning Beyond Homophily

- (2023 Information Sciences) Enhanced contrastive representation in network

1401

1401

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?