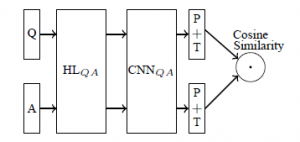

最近在做问答系统,用CNN深度学习模型分别对问题、正答案和负答案提取特征,得到各自的特征向量。正答案与问题之间的距离比负答案与问题之间的距离要近,距离用夹角的cos值来表示,目标函数是由此确定的。模型出自《Applying Deep Learning To Answer Selection: A Study And An Open Task》,如图1所示。

图 1

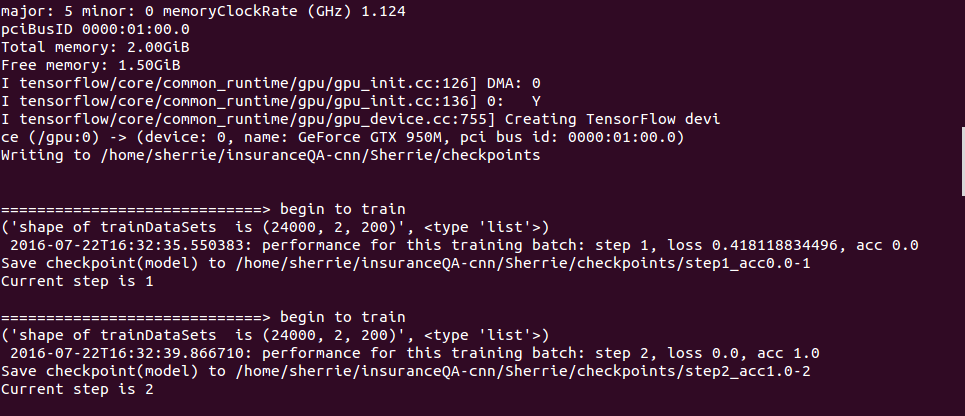

用tensorflow架构实现该模型,然而做模型优化时,5步以内模型的loss就为0了,精度达到了1,如图2所示。‘

图 2

迷糊了一个星期,才找到问题点。

原来是因为在用CNN做特征提取时,我对三个输入(问题、正答案、负答案)分别做了模型weight初始化,相当于建立了三个CNN分别对问题、正答案、负答案做特征抽取。代码如下,调用了conv函数三遍,初始化了W三次,建立了三个CNN模型。

# define a convolution function

def conv(input_data):

pooled_outputs = []

for i, filter_size in enumerate(filter_sizes):

with tf.name_scope("conv-maxpool-%s" % filter_size):

# Convolution Layer

filter_shape = [filter_size, embedding_size, 1, num_filters]

W = tf.Variable(tf.truncated_normal(filter_shape, stddev=0.1), name="W")

b = tf.Variable(tf.constant(0.1, shape=[num_filters]), name="b")

conv

在构建问答系统中,使用CNN模型对问题、正答案和负答案进行特征提取。初始模型在5步内损失为0,精度达到1,导致过拟合。原因在于对每个输入独立初始化权重,构建了三个CNN模型,减弱了模型对负答案的约束。修正方法是共享权重,确保所有输入使用同一CNN模型,从而改善模型表现。

在构建问答系统中,使用CNN模型对问题、正答案和负答案进行特征提取。初始模型在5步内损失为0,精度达到1,导致过拟合。原因在于对每个输入独立初始化权重,构建了三个CNN模型,减弱了模型对负答案的约束。修正方法是共享权重,确保所有输入使用同一CNN模型,从而改善模型表现。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?