前言

本文隶属于专栏《机器学习数学通关指南》,该专栏为笔者原创,引用请注明来源,不足和错误之处请在评论区帮忙指出,谢谢!

本专栏目录结构和参考文献请见《机器学习数学通关指南》

正文

🎯 一句话总结

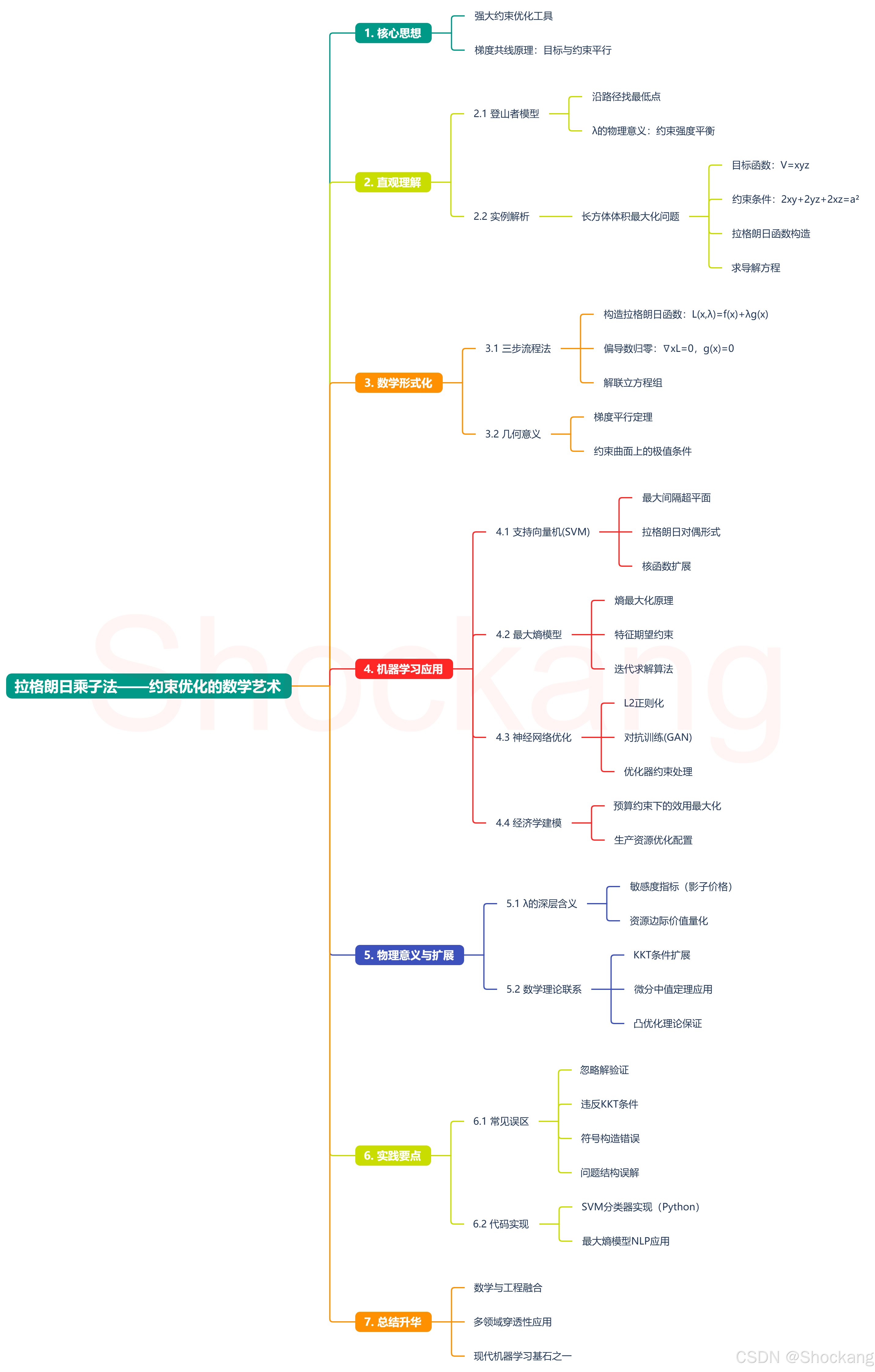

拉格朗日乘子法(拉格朗日乘数法)是处理带约束优化问题的强大工具,它通过引入乘子λ将约束条件和目标函数巧妙结合,找到两者"妥协"下的极值点。核心思想是:在极值点处,目标函数的梯度与约束条件的梯度方向平行,形成一种数学上的"平衡状态"。

🧠 直观理解方式

📊 满山行走寻找最低点

- 想象你是一位登山者,目标是找到山峰最低处(目标函数的最小值),同时必须严格沿着一条特定路径行走(约束条件)。

- 拉格朗日乘子λ的作用:类似"路径约束强度",它量化了违反路径约束的代价与寻找极值的收益之间的平衡关系。

- 关键洞察:当你站在满足约束的路径上的最低点时,山体下降方向(目标函数梯度)与路径延伸方向(约束函数梯度)必然共线,否则你还可以沿着路径继续下行。

🧩 实例解析

长方体体积最大化问题:求体积最大的长方体,但必须满足表面积固定(约束条件 2xy + 2yz + 2xz = a²)。

- 目标函数:

V = xyz(最大化体积) - 构造拉格朗日函数:

L(x, y, z, λ) = xyz + λ(2xy + 2yz + 2xz - a²) - 求导数并令其等于零:

∂L/∂x = yz + λ(2y + 2z) = 0 ∂L/∂y = xz + λ(2x + 2z) = 0 ∂L/∂z = xy + λ(2x + 2y) = 0 - 联立求解:得到

x = y = z = a/√6(证明立方体形状能获得最大体积)

🔍 关键步骤与数学形式

🔄 三步流程法

-

构造拉格朗日函数:整合目标函数和约束

L ( x , λ ) = f ( x ) + λ ⋅ g ( x ) L(\mathbf{x}, \lambda) = f(\mathbf{x}) + \lambda \cdot g(\mathbf{x}) L(x,λ)=f(x)+λ⋅g(x)f(x):原始目标(如体积、利润等)g(x)=0:约束条件(如资源限制、物理条件)

-

求偏导数并令其为零:对所有变量和乘子λ分别求导

- 变量偏导: ∇ x L = ∇ f + λ ∇ g = 0 \nabla_{\mathbf{x}}L = \nabla f + \lambda\nabla g = 0 ∇xL=∇f+λ∇g=0(梯度共线条件)

- 约束方程: g ( x ) = 0 g(\mathbf{x}) = 0 g(x)=0(必须满足原始约束)

-

解联立方程组:求解候选极值点及λ值。

🌐 几何意义解读

- 梯度平行定理:在极值点处,目标函数的梯度 ∇ f \nabla f ∇f 与约束条件的梯度 ∇ g \nabla g ∇g 必须平行,即存在一个比例因子λ使得 ∇ f = − λ ∇ g \nabla f = -\lambda\nabla g ∇f=−λ∇g。

- 这一条件保证了在约束曲面上移动时,目标函数无法获得进一步的改进。

🔗 机器学习中的应用场景

🤖 支持向量机(SVM)

SVM的核心问题是寻找最大间隔超平面,这正是一个典型的约束优化问题:

- 目标:最大化分类间隔( 1 ∣ ∣ w ∣ ∣ \frac{1}{||w||} ∣∣w∣∣1)

- 约束:所有样本点被正确分类( y i ( w T x i + b ) ≥ 1 y_i(w^T x_i + b) \geq 1 yi(wTxi+b)≥1)

- 拉格朗日函数: L ( w , b , α ) = 1 2 ∣ ∣ w ∣ ∣ 2 − ∑ i = 1 n α i [ y i ( w T x i + b ) − 1 ] L(w,b,\alpha) = \frac{1}{2}||w||^2 - \sum_{i=1}^{n}\alpha_i[y_i(w^T x_i + b)-1] L(w,b,α)=21∣∣w∣∣2−∑i=1nαi[yi(wTxi+b)−1]

- 求解此问题能得到支持向量和最优分类边界

通过构建拉格朗日对偶问题,SVM的求解变得更加高效,特别是在引入核函数处理非线性分类时。

📈 最大熵模型

最大熵模型通过拉格朗日乘子法求解带约束的最大熵问题:

- 目标:最大化概率分布的熵( H ( P ) = − ∑ x P ( x ) log P ( x ) H(P) = -\sum_x P(x)\log P(x) H(P)=−∑xP(x)logP(x))

- 约束:满足经验分布的特征期望( ∑ x P ( x ) f i ( x ) = E p d a t a [ f i ] \sum_x P(x)f_i(x) = E_{p_{data}}[f_i] ∑xP(x)fi(x)=Epdata[fi])

- 使用拉格朗日乘子法转换为对偶问题,通过迭代算法(如改进的迭代尺度法IIS、BFGS等)求解

🧮 神经网络优化

在深度学习中,拉格朗日方法应用于:

- 权重正则化:L2正则化可以看作是网络参数大小的软约束

- 约束优化技术:如Adam、RMSprop等优化算法中的约束条件处理

- 对抗训练:在生成对抗网络(GANs)中的极小极大问题

📊 经济学建模

- 预算约束下的效用最大化:消费者在有限预算下最大化效用函数

- 生产资源分配:企业在资源约束下最大化生产效益

🧩 拉格朗日乘子λ的物理意义

拉格朗日乘子λ不仅是数学工具,还有深刻的实际意义:

- 敏感度指标:λ表示如果约束条件放宽一个单位,目标函数值可以改进的程度(经济学中称为"影子价格")

- 资源价值量化:在资源分配问题中,λ反映了稀缺资源的边际价值

- 例证:若体积优化问题的λ=5,表示允许表面积增加1单位,体积最多可增加5个单位

🔄 与其他数学概念的联系

-

KKT条件:拉格朗日乘子法的扩展,处理同时包含等式和不等式约束的优化问题,在SVM和最大熵模型中广泛应用

-

微分中值定理:拉格朗日乘子法是微分学在优化领域的延伸应用(极值点导数特性)

-

泰勒展开与可微性:多变量条件下目标函数和约束均需可微,以便构造和求解拉格朗日函数

-

凸优化理论:当目标函数为凸函数、约束为凸集时,拉格朗日方法能保证找到全局最优解

⚠️ 常见误区与注意事项

-

误区一:只解方程不验证:拉格朗日法提供候选解,需结合问题背景验证(如长方体边长必须大于零)

-

误区二:忽略KKT条件:对于不等式约束问题,必须考虑互补松弛性等KKT条件

-

误区三:漏乘子或符号错误:构造函数时乘子λ需正确参与所有相关约束

-

误区四:忽略问题结构:在机器学习应用中,理解原问题与对偶问题的关系可显著简化计算复杂度

📝 实际应用案例

🔍 SVM中的实现

# 基于拉格朗日对偶形式的SVM简化实现

from sklearn.svm import SVC

from sklearn.datasets import make_classification

import matplotlib.pyplot as plt

# 生成二分类数据集

X, y = make_classification(n_samples=100, n_features=2, n_redundant=0,

n_informative=2, random_state=42, n_clusters_per_class=1)

# 训练SVM模型(底层使用拉格朗日乘子法求解)

clf = SVC(kernel='linear', C=1.0)

clf.fit(X, y)

# 绘制决策边界和支持向量

plt.scatter(X[:, 0], X[:, 1], c=y, cmap=plt.cm.Paired, edgecolors='k')

ax = plt.gca()

xlim = ax.get_xlim()

ylim = ax.get_ylim()

# 创建网格以绘制决策边界

xx = np.linspace(xlim[0], xlim, 30)

yy = np.linspace(ylim[0], ylim, 30)

YY, XX = np.meshgrid(yy, xx)

xy = np.vstack([XX.ravel(), YY.ravel()]).T

Z = clf.decision_function(xy).reshape(XX.shape)

# 绘制决策边界和间隔

ax.contour(XX, YY, Z, colors='k', levels=[-1, 0, 1], alpha=0.5, linestyles=['--', '-', '--'])

# 高亮支持向量

ax.scatter(clf.support_vectors_[:, 0], clf.support_vectors_[:, 1], s=100,

linewidth=1, facecolors='none', edgecolors='k')

plt.title('SVM分类器与支持向量')

plt.show()

📊 最大熵模型应用

最大熵模型在自然语言处理中应用广泛,通过拉格朗日乘子法解决约束下的熵最大化问题,特别适用于文本分类、词性标注等任务。

💡 总结

拉格朗日乘子法是带着约束找最优的数学艺术:通过构造拉格朗日函数将约束融入目标,利用导数条件找到梯度共线的平衡点。它的应用覆盖了从经典优化问题到现代机器学习算法的多个领域,是解决约束优化问题的强大工具。,

7347

7347

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?