作者丨紫薯萝卜@知乎

来源丨htttps://www.zhihu.com/question/47817909/answer/110895292

编辑丨3D视觉工坊

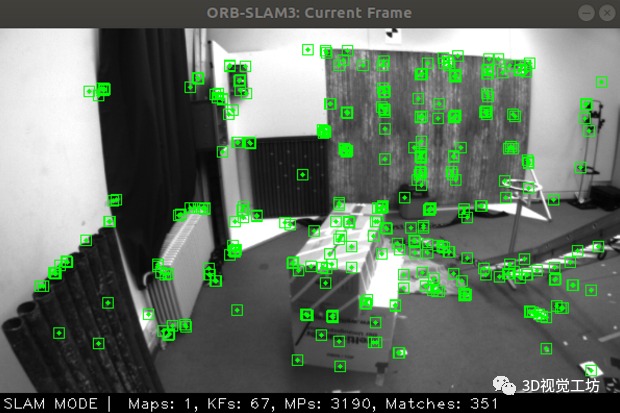

躺了一年多的动态环境下激光定位的坑,忍不住来强答一发。标签虽然是视觉SLAM,但不管激光也好视觉也好,SLAM也好定位也好,都会面临环境动态性问题。

环境中的物体通常可以分成三类:

静态物体:长时间稳定不变的物体,如墙、柱子等。

半静态物体:大部分时间是静止的,但会在某个时刻发生变化。如时而开时而关的门,路边的停车。

动态物体:移动的物体,如移动的行人、车辆。

通常的SLAM、定位算法都是基于静态环境假设的,也就是假设环境中都是第一类物体,显然,现实环境中并不是这样。不过,视觉中的RANSAC匹配,2D下的MCL等算法都有一定的鲁棒性,能够适应少量的动态变化,所以只要第二、三类物体在环境中占的比重不大,那些基于静态假设的算法一般也还是work的。当然,动态环境的挑战还是要直面的,特别是在项目已经接了,发现现场环境全是二、三类物体,再说做不了已经晚了,必须得硬着头皮上的情况下,o(╯□╰)o。

处理动态环境其实就是处理第二、三类物体,思路一般就两种:要么剔掉,要么建模。通常的作法是:

1. 对于第三类物体,直接当做outlier剔掉。因为这类物体在连续观测帧中是移动的,所以先将相邻帧进行匹配,得到匹配关系R,t,再将不满足匹配关系的关联对当做outlier剔除,图像中可以用RANSAC,激光帧可以ICP。值得注意的是,新出现在视野中的点,也无法与历史帧关联,但不应该被当成outlier,可以先通过视野判断,将新出现在视野中的点抽离出来,剩下的再去剔outlier。但在一些情况仍然有问题,这些极端情况目前也没有太好的解决方法(也可能是我了解的太少,大家如果有思路,欢迎交流。)

当动态物体很大,占据视野很大一部分的时候,比如,机器人跟在一个很大的车后面行驶,我们希望的outlier(车),会被算法当成inlier,而我们希望的inlier(两侧的墙等参照物)被错误当成了oulier剔除。

在长走廊环境下,如果存在移动物体,会被错误的当成静态物体来做匹配。这其实是匹配算法的问题,在走廊中,前后维度的不确定度很大,而移动物体被错误的用来修正前后维度的不确定度。试想一下:在一个平行的走廊,观测到一个物体离你越来越近,这有几种可能:1)物体没动,你在往前运动,2)物体往你动,你没动。3)物体也在动,你也在动。而匹配算法同样也是基于静态性假设,所以它会优先相信第一种情况。但事实可能是后面两种情况。当然,我们可以用物理里程计做一定的参考,但物理里程计也是有噪声的,如果动态物体移动的速度在里程计噪声范围内,里程计也是没法参考的。

2. 对于第二类物体,一般是环境发生的变换,所以需要把这些变化建模、更新到地图当中,也就是动态地图更新。在2D-SLAM中,如果用的栅格地图,环境变化后可以根据新的观测对栅格地图的值进行更新(如Gmapping),更厉害的就是直接构建动态地图模型,比如对每个栅格用HMM构建动态模型。Graph-SLAM中,因为存的是一些关键帧或者点云,所以当发现环境变化时,需要找到历史的那几帧过期的关键帧剔掉。VSLAM了解的不是太多,特征点地图、关键帧地图一般也是可以更新的吧。地图更新会来带的一个新的问题在它依赖于定位或匹配的稳定性和精度,如果匹配失败,地图可能会被错误的更新,当地图被错误更新后,在错误地图上的定位出的位置就也有可能是错的,进而地图进一步被错误更新,恶性迭代...虽然最后也能形成一张新的地图,老的地图被完全覆盖掉了,但是对于导航而言,之前在老地图上的导航目标点等没有被更新,新的地图已经无法再进行导航了。

动态环境问题对SLAM或定位来说,仍然没有很好的解决方案。所以现在一般通过多传感器融合来规避这些问题,像激光、视觉、惯导里程等,因为通常环境变化不会对所有传感器产生影响,实在不行,还有惯导可以起作用。另外,有一种比较新的思路是抛弃全局SLAM,不再建模全局地图,而是进行相对SLAM,因为对机器人来说SLAM的目的还是用来导航,导航只关心机器人能够准确的移动到环境中的某个位置,并不关心地图是不是有误差,所以只需要构建一张位姿的拓扑图,机器人沿着拓扑路径就可以导航到某个点。

本文仅做学术分享,如有侵权,请联系删文。

干货下载与学习

后台回复:巴塞罗那自治大学课件,即可下载国外大学沉淀数年3D Vison精品课件

后台回复:计算机视觉书籍,即可下载3D视觉领域经典书籍pdf

后台回复:3D视觉课程,即可学习3D视觉领域精品课程

3D视觉工坊精品课程官网:3dcver.com

2.面向自动驾驶领域的3D点云目标检测全栈学习路线!(单模态+多模态/数据+代码)

3.彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进

4.国内首个面向工业级实战的点云处理课程

5.激光-视觉-IMU-GPS融合SLAM算法梳理和代码讲解

6.彻底搞懂视觉-惯性SLAM:基于VINS-Fusion正式开课啦

7.彻底搞懂基于LOAM框架的3D激光SLAM: 源码剖析到算法优化

8.彻底剖析室内、室外激光SLAM关键算法原理、代码和实战(cartographer+LOAM +LIO-SAM)

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿,加微信:dddvision

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列、三维点云系列、结构光系列、手眼标定、相机标定、激光/视觉SLAM、自动驾驶等)、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近6000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~

3738

3738

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?