Array

第一节:Array总论

0)Linear List一般在国内被翻译为“线性表”,它包含两部分:一是Array,二是Linked List。但是在国外却没有这个概念,在国外只有Array与LInked List的概念。

1)数组必须是连续的,也就是“back to back”

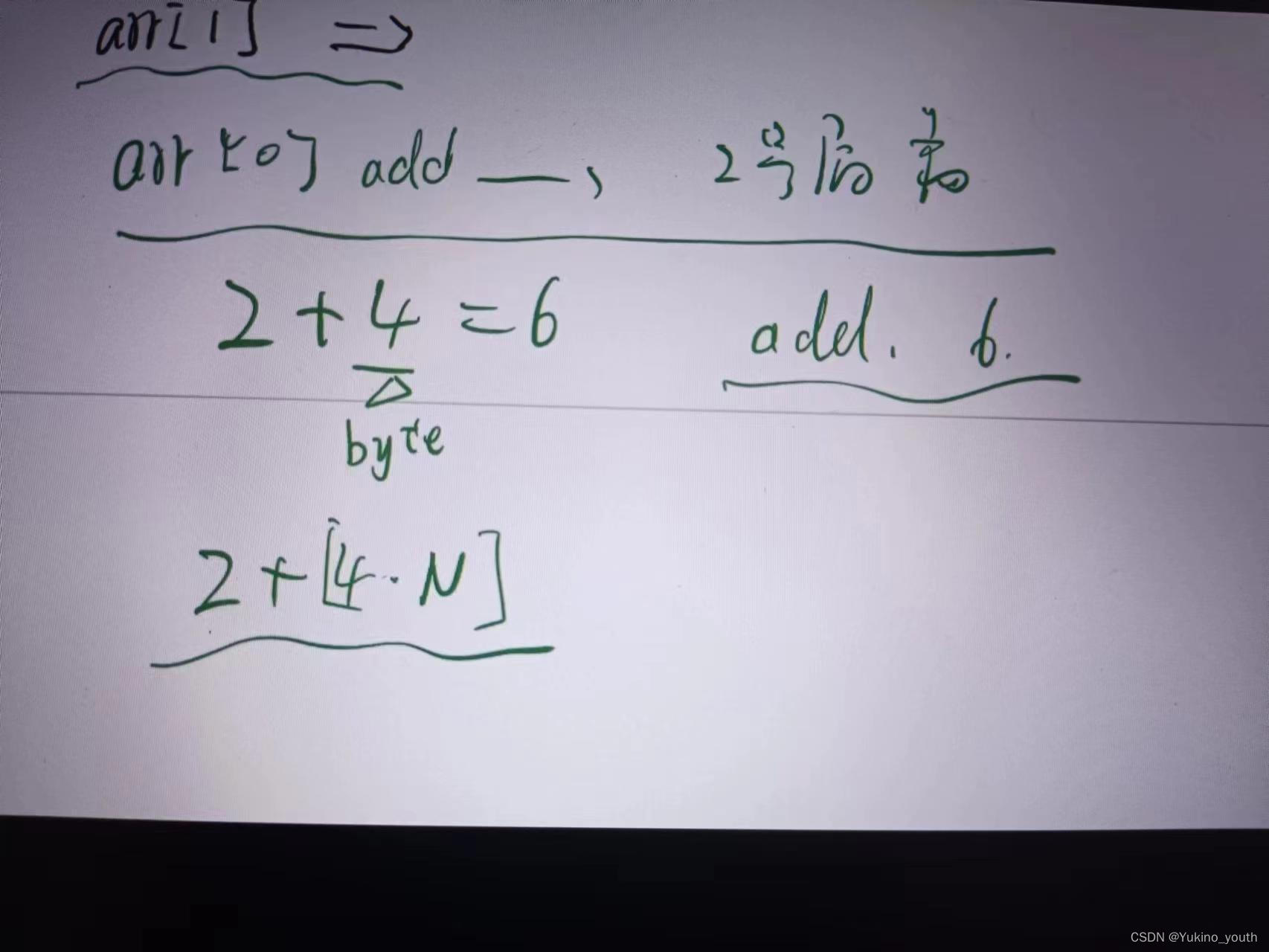

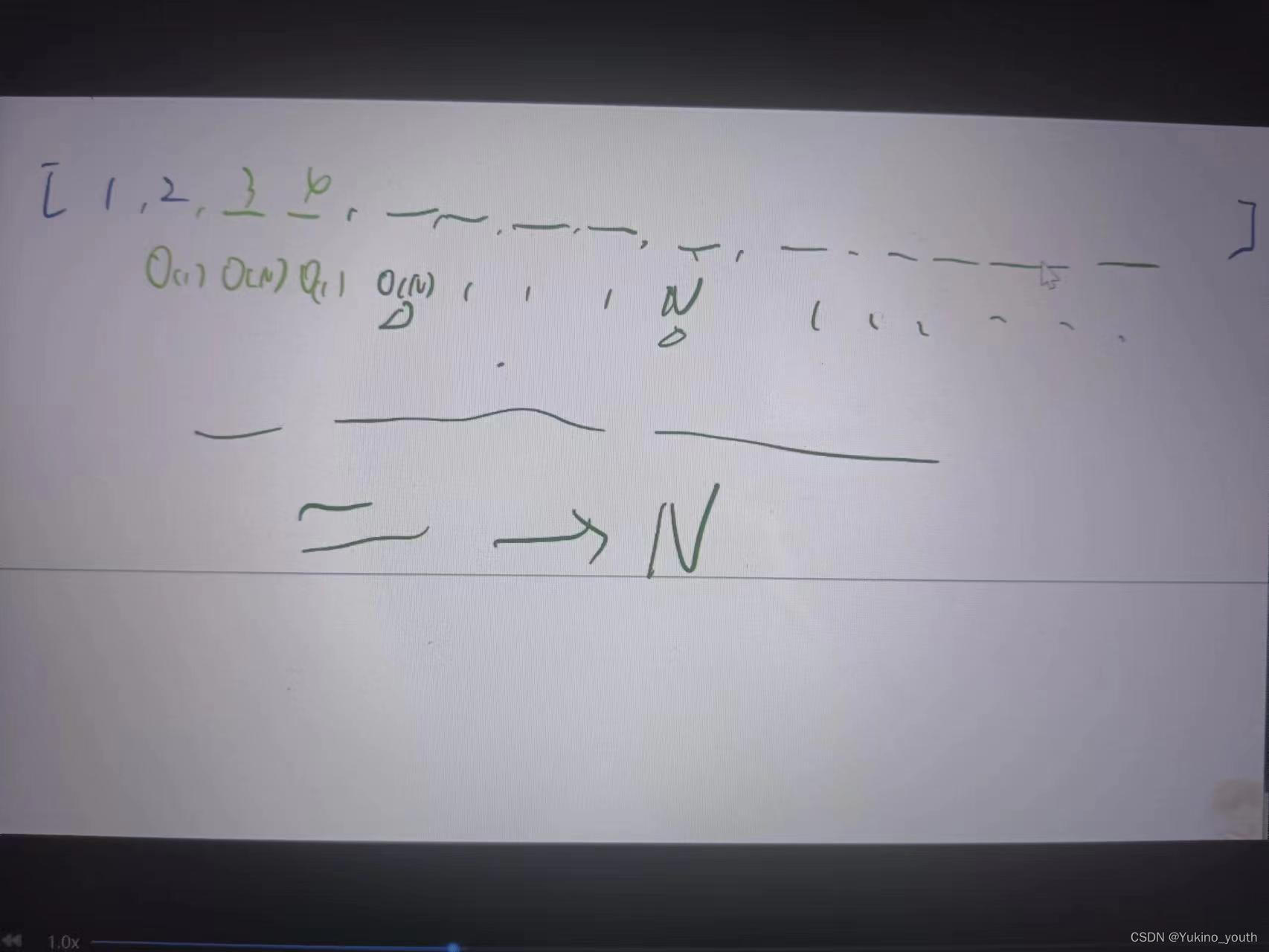

2)数组元素地址的查找,如下图所示:

比如我查第一个元素,那么计算机就会从第一个格子开始查找,直到找到“00000001”中的1为止。那如果我还要查找第二个元素,这个时候,计算机就不会挨个去查找了,而是在第一个元素的地址的基础上再加上4个字节,这样就可以找到第二个元素的地址了,并且可以省很多时间,以此类推,第3个,第4个,甚至是第N个元素地址的查找也都是这样的。

第二节:静态数组

0)数组在按照下标(index)查询时,其时间复杂度为O(1)

1)数组元素的更改:有一个数组array[ ]={1,2,3,4},如果我把array[1]改成6,那么时间复杂度也为 O(1)

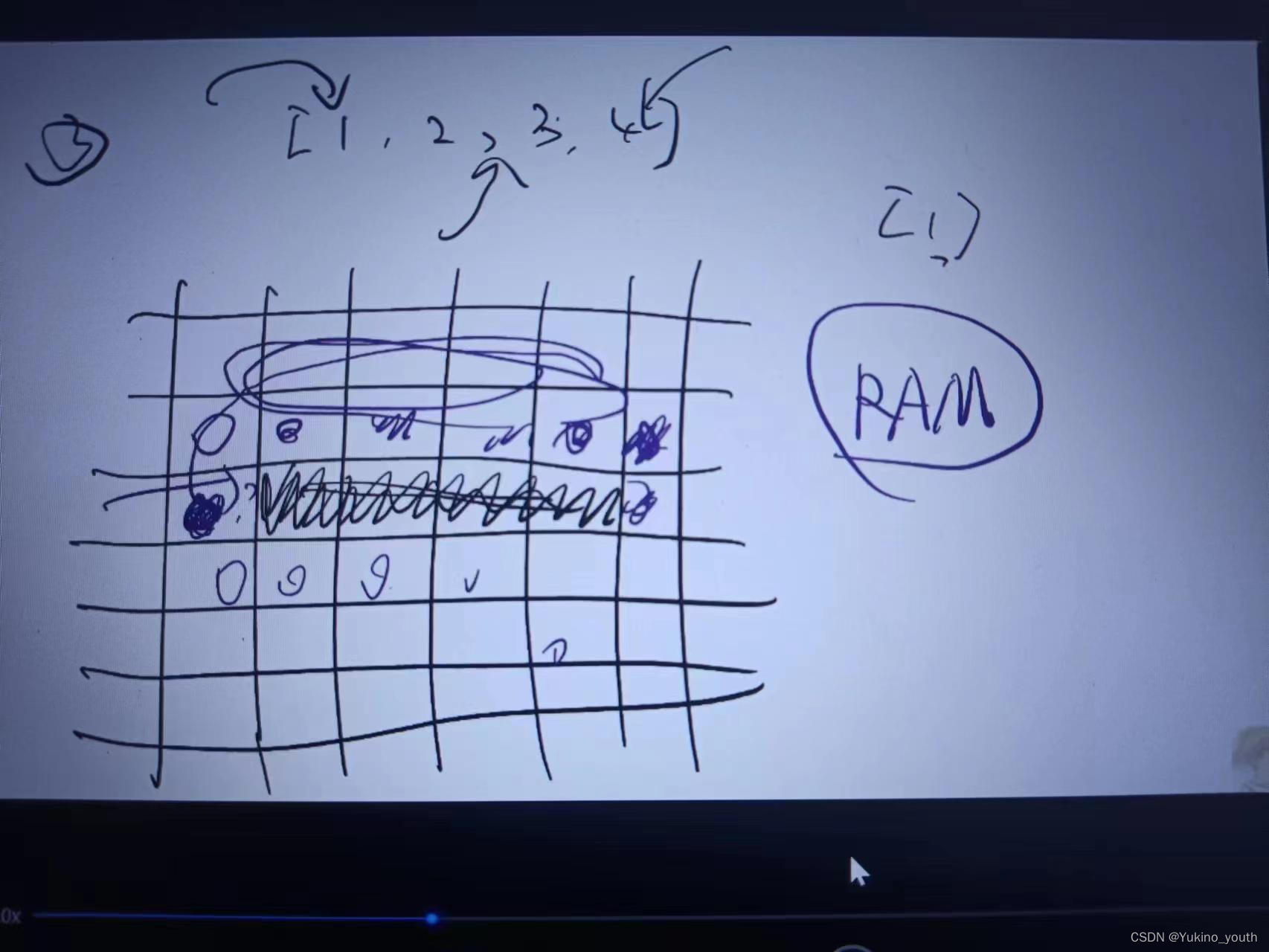

2)数组元素的增加:由于数组具有“back to back”的特性,所以数组不可能在某一个地方插入一个元素

比如在这幅图中,黑色部分存储了一个数组的数据,那么就不能在它前面或后面的格子再插入任何数据,因为不确定这些格子是否为空。

那么这种情况下该怎么办才能增加数组的元素呢?下面来举个例子:

微软和谷歌的程序员都生病了,他们都需要住院,而且谷歌的程序员非要跟微软的程序员住在一起,因为他们可以进行技术交流。但是这个时候院长却为难了,因为微软程序员所在的楼层已经住满了,容不下谷歌的程序员。那么院长就想出来了一个办法:让谷歌程序员去其他空楼层住院,并且让微软程序员全部搬进谷歌程序员所在的楼层,这样就实现了谷歌程序员的愿望。

现在再抽象到理论层面:数组在增加元素时,会进行一个“先复制再转移”的操作,即先在内存当中复制一份原来的数组,然后再对这个副本进行插入处理。时间复杂度为O(N)

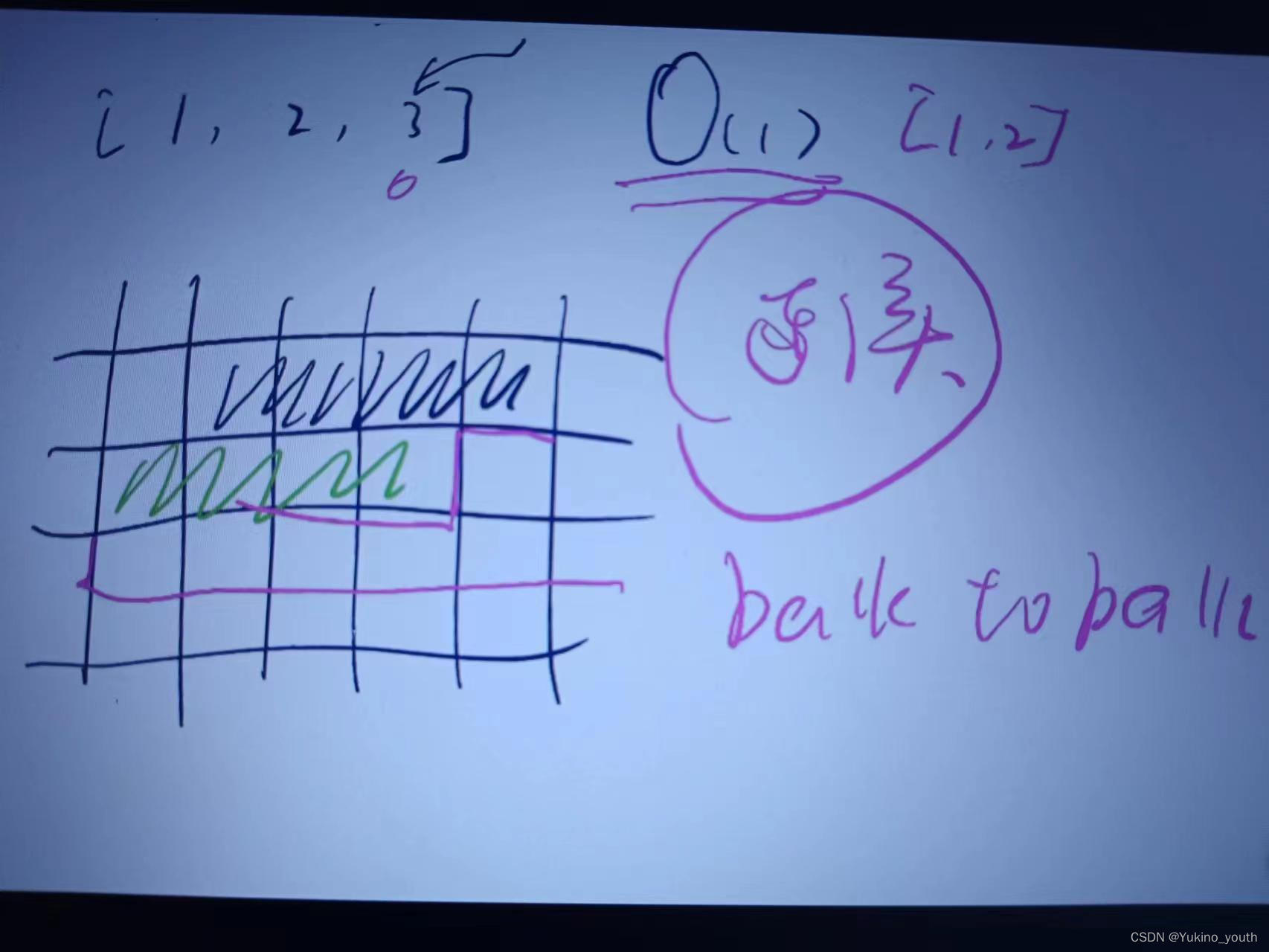

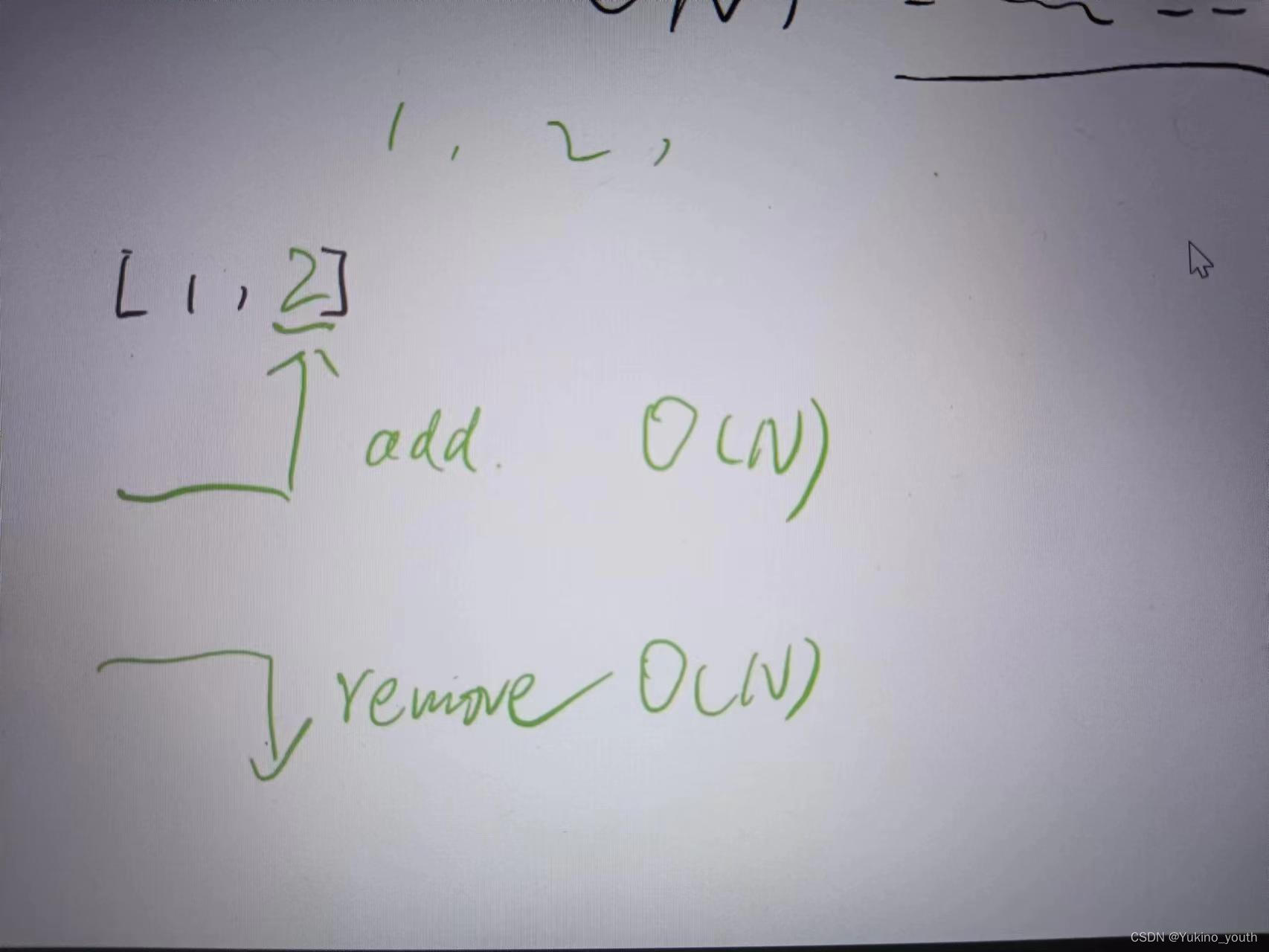

4)数组元素的删除:比如有一个数组为array[ ]={1,2,3}

但我想把3给它删了,那么直接把3所占的那4个格子给它删了就行(如下图所示)

但是这种情况仅限于“back to back”的情况,即从数组的尾部进行删除时,它才能如此之快,其时间复杂度为O(1)。

然而,非“back to back”情况就没有那么容易了。如下图所示:

还是有一个数组array[ ]={0,1,2},但这一次我要把0给删了,那么这个时候就并不仅仅是删除这么简单了,因为把0删除了之后,这个数组就没有了首元素,而一个数组又必须要有首元素(遵循“back to back”的原则)所以要将0之后的每一个元素都向前移动4个字节,即1向前移动一位,2向前移动一位,以此类推。也就是有多少个数据就要移动多少次,那么它的时间复杂度就是O(N)。并且从数组的中间删除的空间复杂度也是O(N)。

5)标记-清除

还是有一个数组array[]={1,2,3,4.......后面还有很多数据},还是从头部删除,但是这次并不止删除一个元素,我要把“1,2,3”这三个元素都删了,如果直接进行删除的话,就要执行3次O(N)的操作,这样就会很麻烦。但是我可以把这3个元素都进行标记,然后统一进行删除,那么这样就相当于只执行了一次O(N)的操作。当要删除的元素为N个时,如果不进行标记,那么其时间复杂度就为O(),但如果进行标记,那它的时间复杂度就为O(N)。进行这样的操作就可以在元素过多时大大节省时间。

第三节:动态数组

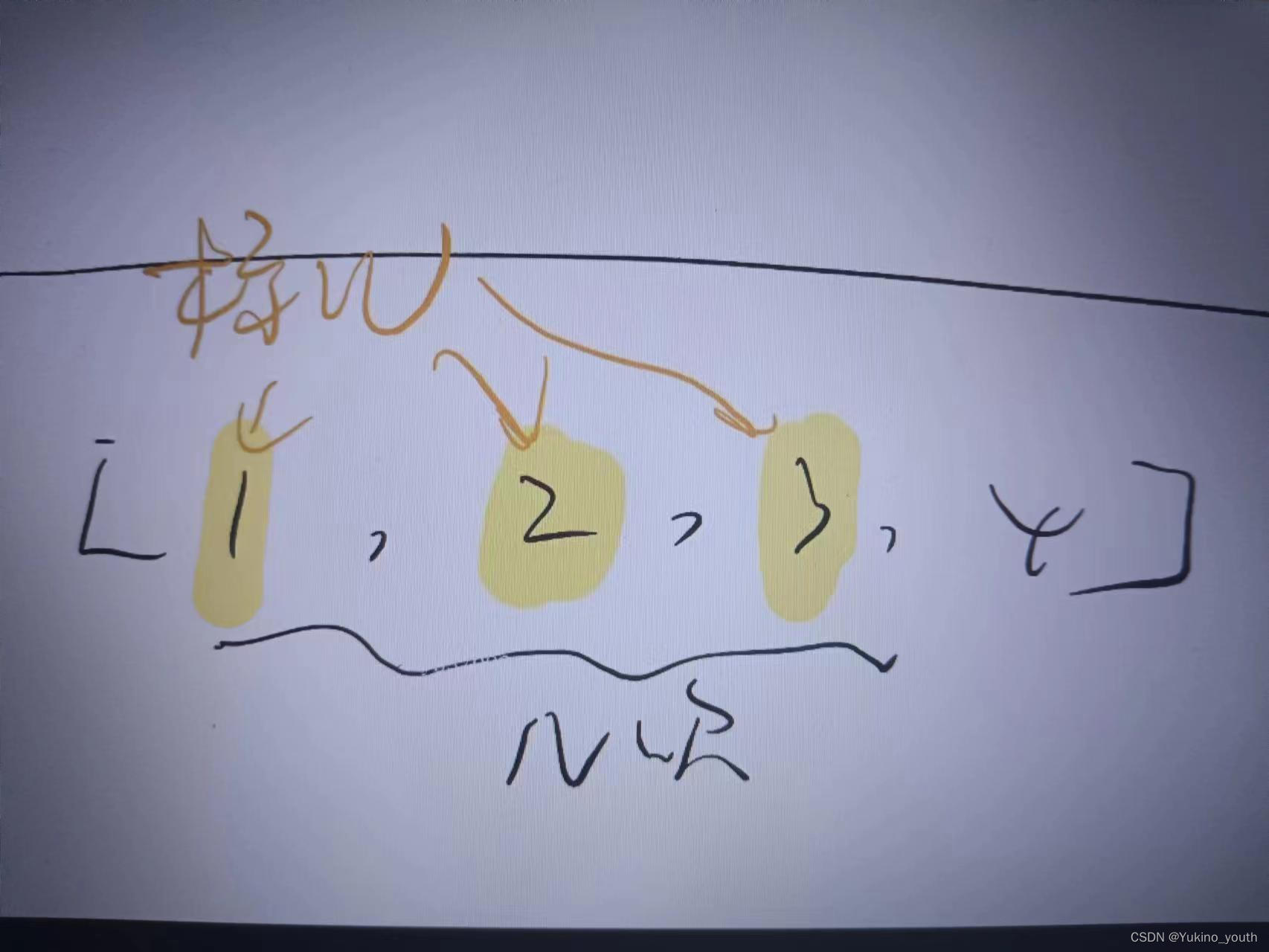

0)数组扩容:动态数组在增加元素时具有扩容功能,就比如一个数组array[]={1,2,3},这个数组的容量太小了,我要对它进行扩容,那么此时这个数组的容量就会增加一倍,即{1,2,3,4,5,6}。并且在扩容时的第一个元素其时间复杂度为O(N),而后元素的复杂度为O(1),如下图所示:

即扩容时复杂度为O(N),不扩容时复杂度为O(1),这就是大名鼎鼎的“平摊分析”。

举个例子:有一个人犯了罪,但是他出狱后改过自新,从新做人,为社会做了很多好事,这就叫“将功补过”。

那么抽象到理论层面也是一样的,数组在扩容时为O(N),很浪费时间,但是它就会在后面跟一系列O(1)来减少时间复杂度。

1)复杂度震荡:还是一个数组,我在需要时就要对其扩容,但是在不需要时就要对其减容,那么该数组就会反复拉扯,如下图所示:

该数组会在2处进行来回摆动,那么这个时候就出现了一个标准:减容时只减四分之一,这样就不会出错。

1503

1503

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?