import numpy as np

# 定义一个矩阵 A

A = np.array([[2, 1, 5], [2, 7, 5],[2, 1, 2]])

# 计算 A 的转置矩阵

A_T = A.T

# 计算 A 和 A 的转置矩阵的乘积

B = np.dot(A_T, A)

# 对 B 进行特征值分解

eigenvalues, eigenvectors = np.linalg.eig(B)

# 对特征值进行排序

idx = eigenvalues.argsort()[::-1]

eigenvalues = eigenvalues[idx]

eigenvectors = eigenvectors[:,idx]

# 奇异值的平方根

sigma = np.sqrt(eigenvalues)

# 获取秩

r = len(sigma)

# 计算矩阵 U

U = np.zeros((A.shape[0], r))

for i in range(r):

U[:,i] = np.dot(A, eigenvectors[:,i]) / sigma[i]

# 计算矩阵 V

V = eigenvectors

# 构建奇异值矩阵 S

S = np.zeros((A.shape[0], A.shape[1]))

S[:r, :r] = np.diag(sigma)

# 输出结果

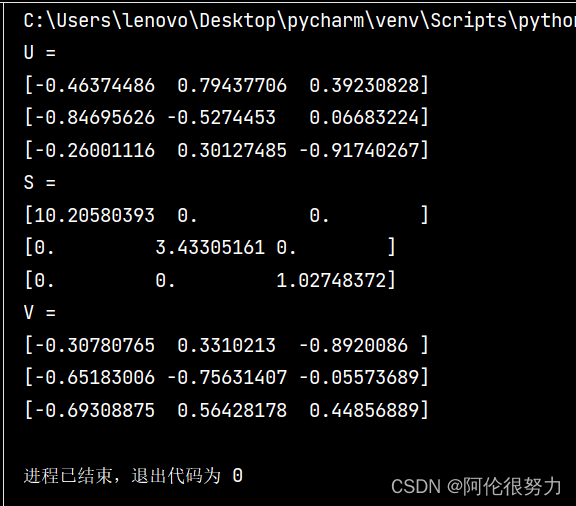

print("U = ")

for i in U:

print(i)

print("S = ")

for i in S:

print(i)

print("V = ")

for i in V:

print(i)

import numpy as np

# 输入矩阵

A = np.array([[2, 1, 5],

[2, 7, 5],

[2, 1, 2]])

# 计算奇异值分解

U, S, Vt = np.linalg.svd(A)

# 输出结果

print("左奇异向量 U:")

print(U)

print("奇异值 S:")

print(S)

print("右奇异向量 V^T:")

print(Vt)

心得:

1.没有直接使用numpy库里的SVD函数进行奇异值分解计算,但是还是借用numpy库用于矩阵的转置,求特征值,特征向量,矩阵乘积,特征值分解等一系列操作。

2.进行矩阵的奇异值分解(Singular Value Decomposition,SVD),可以按照以下步骤进行:

1)对于一个 m × n 的矩阵 A,首先计算它的转置矩阵 A^T 与 A 的乘积 B = A^T × A。

2)对矩阵 B 进行特征值分解,得到 B 的特征值和对应的特征向量。

3)将 B 的特征值按照从大到小的顺序排列,并选取前 r 个非零特征值(r 是矩阵 A 的秩)。

4)取出这 r 个特征值对应的特征向量,组成一个正交矩阵 U。

5)计算矩阵 A 的右奇异向量矩阵 V。对于每一个选取的非零特征值,对应的右奇异向量就是 B 的特征向量除以特征值的平方根。

6)将前面选取的 r 个非零特征值构成一个对角矩阵 Σ。

7)最后,可以用 U、Σ 和 V 重新组合成矩阵 A 的奇异值分解:A = U × Σ × V^T。

考虑一个问题:对于V其实是AA^T的特征向量,那么U其实就是A^TA的特征向量,这样去求,会使算法编写更简单些,但是时间复杂度上升了。

3.关于SVD的在机器学习中的运用:

SVD 可以用于将高维数据降维,保留数据集中最重要的特征。在机器学习中,降维可以帮助减少数据的复杂度,降低计算成本,并有助于消除冗余信息。SVD 在诸如主成分分析(PCA)等方法中被广泛使用,用于提取数据的主要特征。

4478

4478

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?