今天来介绍Yolo,Yolo系列时目前比较火的目标检测算法,在2023年,yolo已经更新到了Yolov8了,今天就来安装和使用Yolov8。

首先来简单的介绍一下,YOLOv8 是YOLO 系列实时物体检测器的最新迭代产品,在精度和速度方面都具有尖端性能。在之前YOLO 版本的基础上,YOLOv8 引入了新的功能和优化,使其成为广泛应用中各种物体检测任务的理想选择。以下是ultralytics的开源地址:

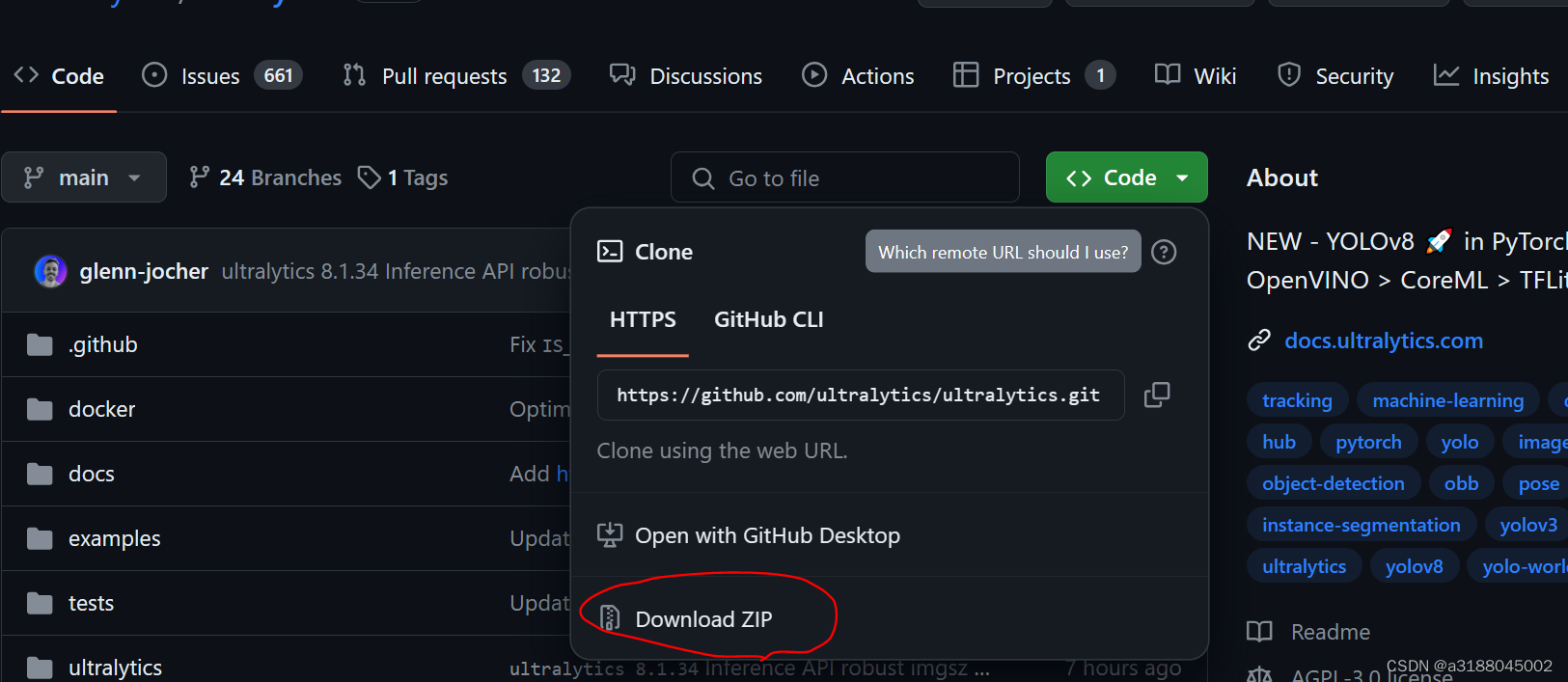

https://github.com/ultralytics/ultralytics

点开连接后,点击下载ZIP,下载后解压打开。里面有相关的教程。

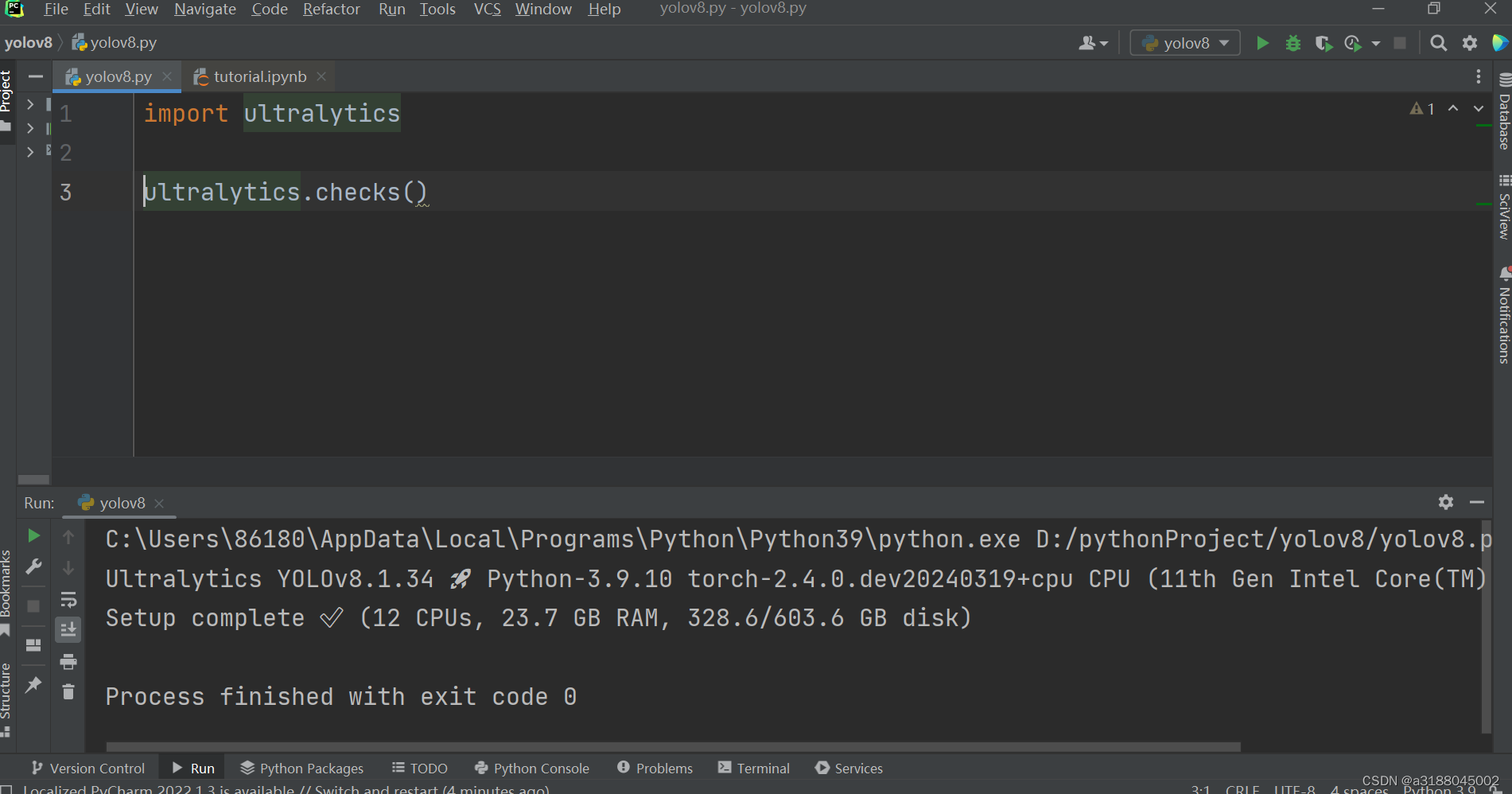

现在打开pycharm,在终端里输入pip install ultralytics,安装好ultralytics后,导入ultralytics后输入ultralytics.checks(),检查目前的版本。

接下来就可以使用Yolov8的相关功能,今天我们

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1598

1598

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?