一、前言:

- 在训练时,为什么随着网络深度的增加,会出现错误率更高的情况呢?

- 梯度消失、梯度爆炸现象

- 假设梯度<1的时候,在反向传播时,导致越乘越小,逐渐趋近于0

- 假设梯度>1的时候,在反向传播时,导致越乘越大

- 退化问题

- 残差结构来解决退化问题

- 梯度消失、梯度爆炸现象

二、Residual结构

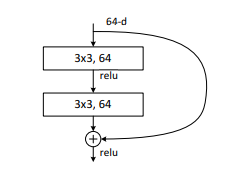

1、残差结构初步

- 低层的神经网络

- 输入:channel是64,3*3的卷积核,个数为64个。

- 主分支与shortcut的输出特征矩阵shape必须相同。

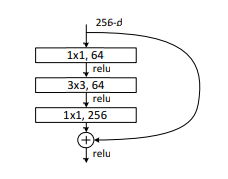

- 高层的神经网络

1. 第一个卷积层:降维度,将256->64

2. 第二个卷积层:进行卷积

3. 第三个卷积层:升维度,将64->256

2、分析残差结构

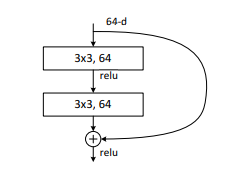

- 这里的实线代表输入和输出的shape不变

- 下采样:这里的虚线代表输入和输出的shape发生了改变

- 通过stride=2,使得高度变为原来的一半,通过使用128个卷积核,来使得深度变为原来的二倍

- shortcut分支使用1*1的卷积核改变了深度,从而保证了主分支与shortcut分支的shape相同,从而可以相加。

3、论文中针对不同的layer的参数

- 不同层次的参数设置

1679

1679

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?