Gemma 3 新模型上线,本地实操教程新鲜出炉!

微信搜索关注《AI科技论谈》

上周三(3月12日),大语言模型界迎来重磅消息 ——Gemma 3 正式发布!迅速成为 AI 爱好者们热议的焦点。

Gemma 3 共有 4 种参数规模版本,10 亿参数(1B)、40 亿参数(4B)、120 亿参数(12B)和 270 亿参数(27B),涵盖预训练和指令微调版。

其中,4B、12B、27B 版本支持多模态,上下文窗口最大 128K;1B 版本小巧快速且功能强。各版本在 Kaggle、HuggingFace 均可下载。

今天重点教大家如何在本地电脑上快速开启 Gemma 3 模型,让你第一时间体验这款新模型的魅力,赶紧来试试!

1 安装Ollama

首先,安装Ollama,安装过程非常简单。

访问Ollama(https://ollama.com/download)页面,选择你的操作系统平台(可在MacOS、Linux和Windows之间选择)。按照安装说明进行操作,然后你就可以在控制台中启动Ollama了。

2 加载模型

在控制台中,运行:

ollama run gemma3

当你首次使用某个模型时,Ollama会下载在本地运行该模型所需的资源。

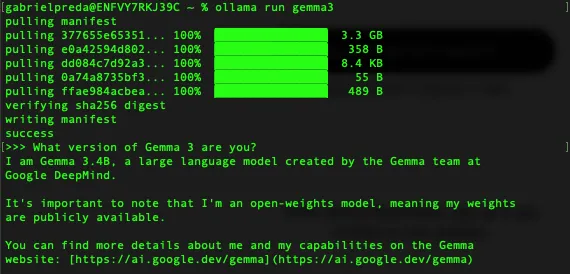

首次使用ollama运行gemma3

为了确保加载的模型正确,这里第一个问题是关于所加载的模型。默认情况下,下载的是40亿参数的模型。

3 多模态查询

接下来,让我们查看一张超酷的图片。从Vecteezy网站上下载了一张猫咪图片:

三只戴着眼镜的酷猫

要向Gemma3:4B模型发起查询,需在Ollama shell控制台中运行以下查询:

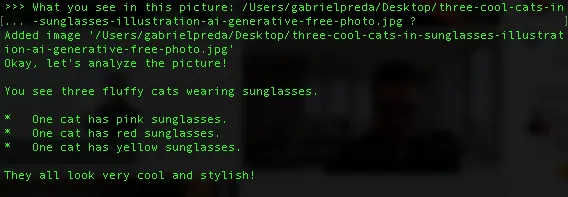

>>> What you see in this picture: /Users/gabrielpreda/Desktop/three-cool-cats-in-sunglasses-illustration-ai-generative-free-photo.jpg ?

先输入查询内容,然后将图片拖到控制台。除了查询内容,你还提供了图片的路径;模型会加载并处理该图片。完成这些操作后,会生成一个提示,确认图片已成功加载,然后针对多模态输入(文本查询和图片)生成答案。

下图展示了查询内容、上传确认提示以及对第一个问题的回答。

多模态输入和模型回答

该模型能够识别出图片中三只戴着太阳镜的猫咪。此外,还更详细地描述了每只猫咪太阳镜的颜色。该模型还注意到了猫咪毛茸茸的特点。

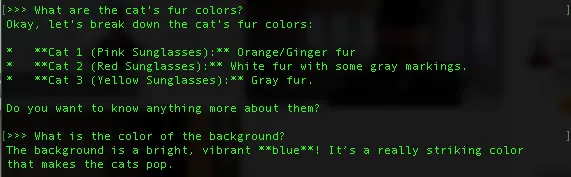

接下来,我们可以进一步探索并优化查询。在下图中,可以看到与模型围绕图片构图展开的对话延续。首先,询问每只猫咪的毛发颜色细节。然后,询问背景颜色。

就同一图片细节与模型进行更深入的探讨

从模型对第二个和第三个问题的回答中,我们更加确信该模型真的能够解读场景构图。关于猫咪的每一个描述都是正确的:太阳镜颜色和毛发信息匹配正确,图片中猫咪的顺序(从左到右)也正确。背景颜色也描述准确。

推荐书单

《深入浅出机器学习:从数据到AI算法》

《深入浅出机器学习:从数据到大模型》是一本旨在帮助读者系统学习机器学习的著作。本书通过深入浅出的方式,将复杂的机器学习理论和技术讲解得深入浅出。

本书从机器学习的基础开始,为读者提供了对数据处理、特征工程和模型评估等核心概念的全面介绍。读者将学习如何准备和清洗数据,如何选择和构建合适的特征,并学会使用各种评估指标来评估模型性能。

然后,本书深入探讨了常见的机器学习算法和技术。详细解释了线性回归、逻辑回归和神经网络等算法的原理和应用,通过丰富的示例和实践项目,掌握这些算法的实现和调优技巧。

本书聚焦于大规模模型和深度学习,介绍了深度学习的基本原理和常用的深度学习框架,如TensorFlow和PyTorch。读者将学习如何构建深度神经网络,如何进行模型训练和调优,并了解大规模机器学习系统的实现和部署。

5折购买链接:https://item.jd.com/14387333.html

精彩回顾

QwQ-32B本地部署教程来了,全新开源推理大模型,性能比肩DeepSeek满血版

解读Deep Research:传统RAG已死,带你实现Agentic RAG

45

45

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?