感受野指的是一个特定的CNN特征(特征图上的某个点)在输入空间所受影响的区域。

一个感受野可以用中心位置(center location)和大小(size)来表征。然而,对于一个CNN特征来说,感受野中的每个像素值(pixel)并不是同等重要。一个像素点越接近感受野中心,它对输出特征的计算所起作用越大。这意味着某一个特征不仅仅是受限在输入图片中某个特定的区域(感受野),并且呈指数级聚焦在区域的中心。

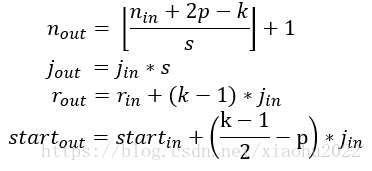

特征图大小计算公式

假设输入特征图大小为5×5,采用的卷积参数如下:卷积核大小k=3×3,padding大小p=1×1,步长s=2×2。经过一次卷积之后,得到大小为3×3的输出特征图(绿色)。在这个特征图上继续采用相同的卷积,得到一个2×2的特征图(橙色)。输出特征图的大小可以通过如下公式计算:

为了简化,这里假定CNN架构是对称的,并且输入图片是方形的。因此所有的卷积层的所有参数在两个维度上都是相同的。如果CNN架构或者输入图片是非对称的,你可以为各个维度单独计算特征图的属性。

感受野计算公式

为了计算CNN每一层的感受野,除了要知道特征图每个维度的特征数

n

n

n,还需要记录每一层的其他信息,这包括当前层的感受野大小

r

r

r,两个相邻特征的距离(跳跃的距离)

j

j

j,和左上角特征(第一个特征)的中心坐标

s

t

a

r

t

start

start。注意感受野(其实是特征图第一个特征的感受野)的中心坐标就等于这个特征的中心坐标,就如前面可视化中所示。当采用的卷积其核大小为

k

k

k,padding大小为

p

p

p,步长为

s

s

s,输出特征图的感受野可以按照如下公式计算:

第一个式子根据输入特征图大小以及卷积参数计算输出特征图大小,前面已经说过。

第二个式子计算输出特征图的特征间的间隔j,其等于上一层的间隔值乘以卷积的步长,所以间隔值将是按照步长呈指数级增长。

第三个式子计算输出特征图的感受野大小,其等于前一层感受野大小加上(k−1)∗jin,所以感受野是呈指数级增加,并且还有一个因子k−1。

第四个式子计算输出特征图的第一个特征感受野的中心坐标,其等于第一层的中心坐标加上(k−1)/2∗jin,再减去p∗jin,注意两项都要乘以前一层的间隔距离以得到实际距离。

对于第一层,一般是输入图片,其各项值为:n=image_size,r=1,j=1,start=0.5。图3给出了一个如何计算感受野的实例,图中的坐标系统中,输入层的第一个特征中心位置记为0.5。通过利用上面公式迭代地进行计算,你可以计算出CNN中所有特征图的感受野信息。

给出一个更简洁的计算公式,对于第k层的感受野大小计算如下:

l k = l k − 1 + ( ( f k − 1 ) ∗ ∏ i = 1 k − 1 s i ) l_k = l_{k-1} + ((f_k - 1) * \prod_{i=1}^{k-1}s_i) lk=lk−1+((fk−1)∗∏i=1k−1si)

其中

l

k

−

1

l_{k−1}

lk−1 是第

k

−

1

k−1

k−1 层的感受野大小,而

f

k

f_k

fk 是当前层的卷积核大小,

s

i

s_i

si 是第

i

i

i 层的步长。

从这个公式可以看到,相比前一层,当前层的感受野大小在两层之间增加了

(

f

k

−

1

)

∗

∏

i

=

1

k

−

1

s

i

(f_k - 1) * \prod_{i=1}^{k-1}s_i

(fk−1)∗∏i=1k−1si ,如果stride大于1的话,这是一个指数级增加。

这个公式也可以这样理解,对于第

k

k

k 层,其卷积核为

f

k

f_k

fk,那么相比前一层需要计算

f

k

f_k

fk个位置(或者神经元,意思是

k

k

k 层的一个位置在

k

−

1

k−1

k−1 层的视野大小是

f

k

f_k

fk ),但是这些位置要一直向前扩展到输入层。对于第一个位置,扩展后的感受野为

l

k

−

1

l_{k−1}

lk−1 ,正好是前一层的感受野大小,但是对于剩余的

f

k

−

1

f_k-1

fk−1个位置就要看stride大小,你需要扩展到前面所有层的stride(注意不包括当前层的stride,当前层的stride只会影响后面层的感受野),所以需要乘以

∏

i

=

1

k

−

1

s

i

\prod_{i=1}^{k-1}s_i

∏i=1k−1si,这样剩余

f

k

−

1

f_k-1

fk−1个位置的感受野大小就是

(

f

k

−

1

)

∗

∏

i

=

1

k

−

1

s

i

(f_k - 1) * \prod_{i=1}^{k-1}s_i

(fk−1)∗∏i=1k−1si,和第一个位置的感受野加到一起就是上面的公式了。

其实这个公式算是整合了前面的公式2和公式3(第一层的j=1),两个本质上是一致的,不过如果你仅想计算感受野大小可以用这个公式更方便。

总结

在CNN中,感受野应该是一个很重要的东西,但是往往被大家忽略,图像分割模型DeepLab就提到了感受野大小的问题,但是那里并没有给出计算公式,如果采用上面的公式就可以快速得到结果。对于图像分割,感受野大小对分割效果是有很大影响的,所以DeepLab采用了扩展卷积(Atrous Convolution, Dilated Convolution)来增加感受野大小。对于空洞卷积来说,你可以将其转化为普通卷积(卷积核大小增加)来计算特征图的感受野。另外,上面的公式同样适用于池化层,因为其在结构上与卷积层是类似的。

2889

2889

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?