卷积层

PyTorch + TensorBoard 可视化

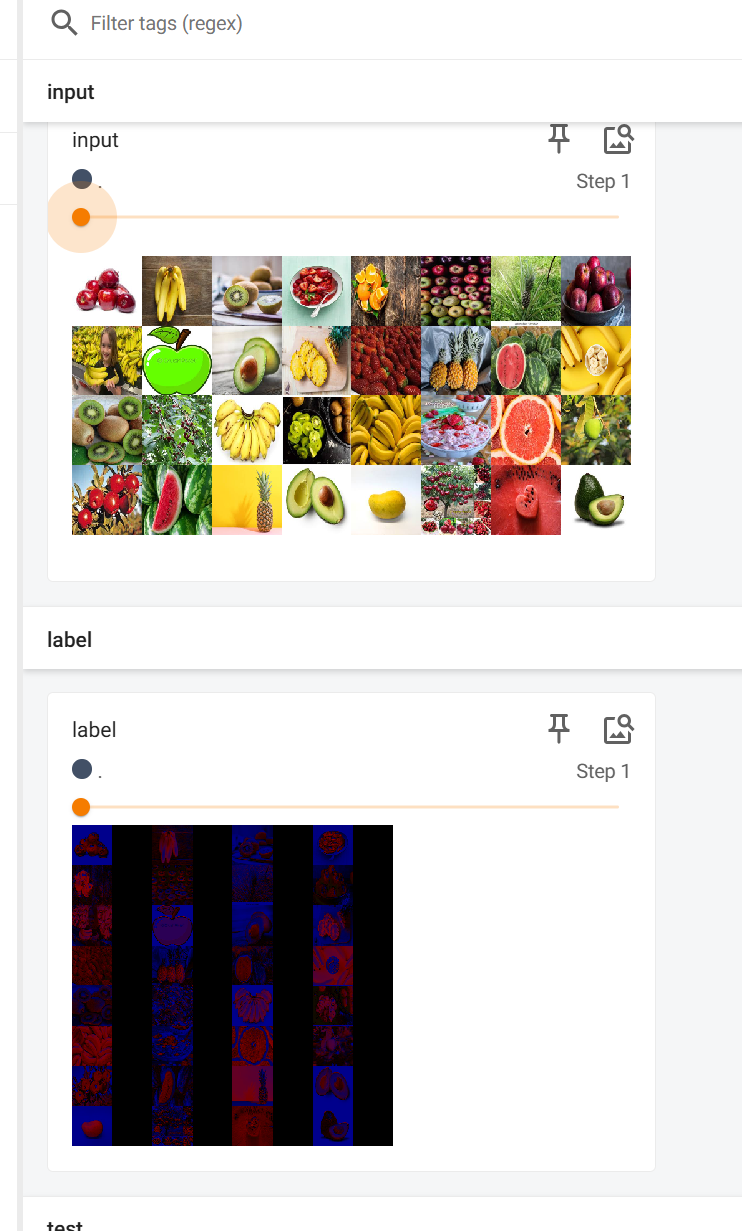

本示例通过一个简单的卷积神经网络 ,演示了如何使用 PyTorch 加载图像数据、执行前向传播,并使用 TensorBoard 可视化输入和输出图像。

引入所需的库

import torch

import torchvision

from torch import nn

from torch.nn import Conv2d

from torch.utils.tensorboard import SummaryWriter

from torchvision import transforms

from torch.utils.data import DataLoader

数据加载与预处理

# 图像预处理:缩放为 224x224,并转为张量

data_transforms = transforms.Compose([

transforms.Resize((224, 224)),

transforms.ToTensor()

])

# 加载数据集,root 文件夹需符合 ImageFolder 的结构规范

dataset = torchvision.datasets.ImageFolder(

root=r'D:/My_Work/StudyDeepLearning/day3_code/dataset/test',

transform=data_transforms

)

# 使用 DataLoader 批量加载数据,batch_size 为 32,打乱顺序

dataloader = DataLoader(dataset=dataset, batch_size=32, shuffle=True)

定义网络结构

class TuDui(nn.Module):

# 定义了一个自定义神经网络模型类 TuDui,继承自 PyTorch 的 nn.Module

def __init__(self):

# 构造函数中先调用父类构造函数,初始化 nn.Module 的内部结构

super(TuDui, self).__init__()

# 定义一个卷积层:输入通道3(RGB),输出通道6,卷积核大小3x3

self.conv1 = Conv2d(in_channels=3, out_channels=6, kernel_size=3, stride=1, padding=0)

def forward(self, x):

# 调用卷积层执行前向传播

x = self.conv1(x)

return x

创建模型实例并打印结构

tudui = TuDui()

print(tudui) # 输出模型结构,用于检查网络定义是否正确

使用 TensorBoard SummaryWriter 可视化结果

writer = SummaryWriter("logs") # 创建日志目录 logs/

step = 0 # 步数计数器

遍历数据集并前向传播

for data in dataloader:

imgs, label = data # 获取一批图片和标签

output = tudui(imgs) # 前向传播,得到输出特征图

# 打印输入和输出的张量维度

print(imgs.shape) # [32, 3, 224, 224]

print(output.shape) # [32, 6, 222, 222],因为卷积减少了2个像素(padding=0, kernel=3)

# 可视化输入图像(最多3通道)

writer.add_images("input", imgs, step)

# 为了可视化输出(6通道),这里只选择其中3个通道重新 reshape

output = torch.reshape(output, (-1, 3, 222, 222)) # 每次最多3通道可显示

writer.add_images("label", output, step)

step += 1

关闭 SummaryWriter

writer.close()

之后可在命令行中使用以下命令打开 TensorBoard:

tensorboard --logdir=logs

小结

937

937

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?