系列总目录 链接→ [系统配置、包/库安装、问题修复]

注意:

- Ubuntu18.04默认GCC-7,由于CUDA 9.x不支持GCC-7(下载页面没有对ubuntu18的支持),所以需要安装低版本的5或者<= 6.3.0,并设置为默认版本。否则应安装10.0以上版本CUDA

- Nvidia显卡驱动与CUDA版本对应关系,显卡驱动版本越高,就可支持越高版本的CUDA,并对低等级驱动向下支持

安装步骤

-

查看是否安装了cuda

# 法1 cat /usr/local/cuda/version.txt # 法2 nvcc --version -

若没有安装,则查看是否有N卡驱动,若无N卡驱动,则到

软件与更新 -> 附加驱动中安装驱动 -

查看N卡驱动支持的cuda版本

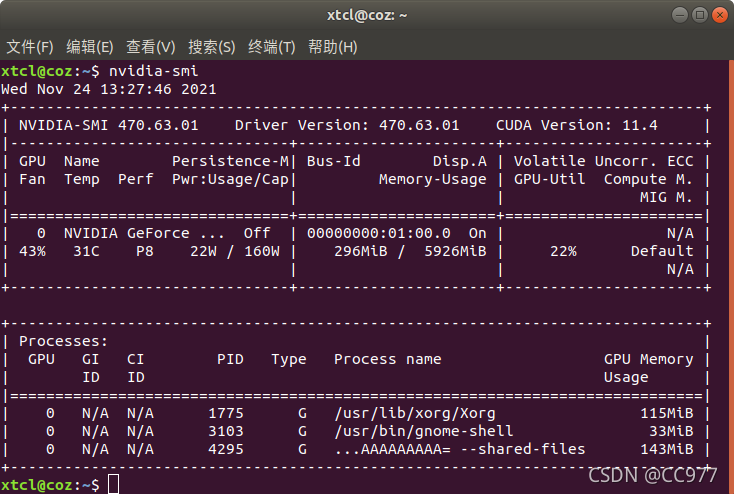

nvidia-smi如下图支持最高CUDA版本是11.4

-

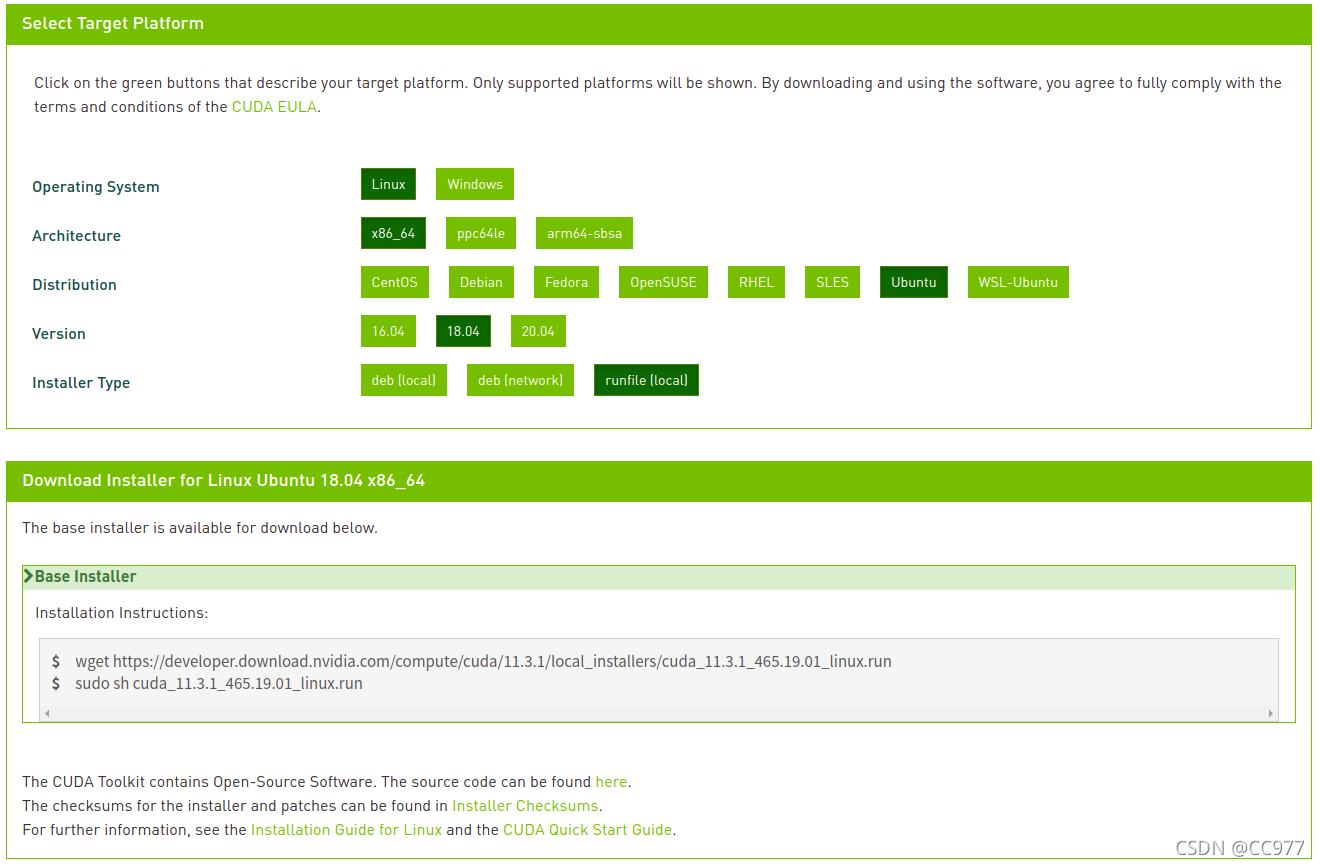

到cuda-toolkit-archive,选择需要的CUDA下载

-

如下图,选择

runfile(local),并使用生成的指令进行下载和安装

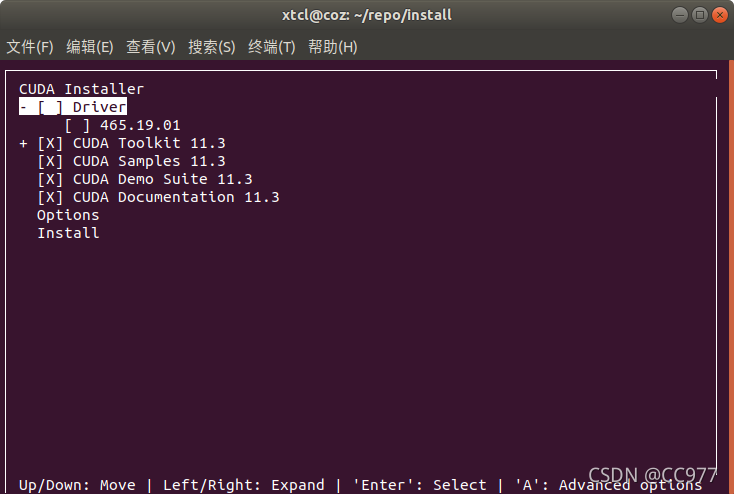

若第1步提示Existing package manager installation of the driver found. It is strongly recommended that you remove this before continuing.,选择continue,在下一步中去除driver项,之后选择install:

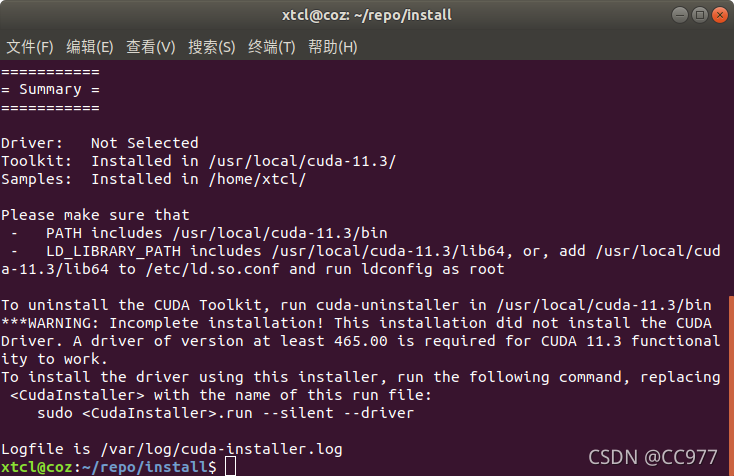

安装完成后,显示如下:

-

在

~/.bashrc文件中添加如下环境变量:export PATH=/usr/local/cuda-11.3/bin${PATH:+:${PATH}} export LD_LIBRARY_PATH=/usr/local/cuda-11.3/lib64${LD_LIBRARY_PATH:+:${LD_LIBRARY_PATH}} -

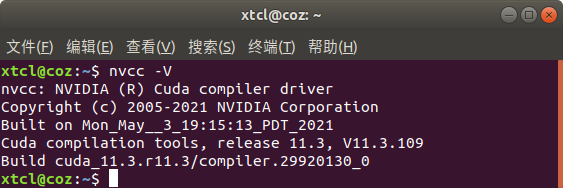

验证是否安装成功

nvcc -V

-

安装cuDNN,到cudnn-archive下载和CUDA对应的版本

1.Navigate to your <cudnnpath> directory containing the cuDNN tar file. 2.Unzip the cuDNN package. $ tar -xvf cudnn-linux-x86_64-8.x.x.x_cudaX.Y-archive.tar.xz 3. Copy the following files into the CUDA toolkit directory. $ sudo cp cudnn-*-archive/include/cudnn*.h /usr/local/cuda/include $ sudo cp -P cudnn-*-archive/lib/libcudnn* /usr/local/cuda/lib64 $ sudo chmod a+r /usr/local/cuda/include/cudnn*.h /usr/local/cuda/lib64/libcudnn*按照↑教程,可下载

cuDNN Library for Linux (x86_64)用复制的方式安装,使用如下命令查看安装版本cat /usr/local/cuda-11.3/include/cudnn.h | grep CUDNN_MAJOR -A 2 -

也可下载

Runtime Library和Developer Library的deb包,使用sudo dpkg -i xxx.deb命令进行安装,使用如下命令查看安装版本cat /usr/include/cudnn_version.h | grep CUDNN_MAJOR -A 2 -

在

~/.bashrc文件中添加cudnn环境变量如下:export LD_LIBRARY_PATH=/usr/local/cuda-11.3/targets/x86_64-linux/lib${LD_LIBRARY_PATH:+:${LD_LIBRARY_PATH}} -

多版本CUDA安装重复上述步骤即可,最后通过更改第6步、第10步中环境变量切换CUDA版本

Cuda使用中的一些问题

- cmake error,报错找不到

cuda_cublas_device_library。

解决:出错版本为cuda10.2。cuda10.0版本的libcublas.so在其lib64目录下,cuda11.x版本的libcublas.so在其targets/x86_64-linux/lib/目录下,但cuda10.2放在系统目录中,要升级到高版本cmake才能让其主动找到对应文件。经查其他博文,cuda10.2需要camke3.17以上。cmake升级参考cmake 升级,cmake下载时下那个源码包。

在CMakeLists中优雅地使用Cuda & Cudnn& TensorRT

cmake中有一等语言的说法,可以通过project()和enable_language()命令启用

cuda中的policy:

CMP0091 New in version 3.15.

CMP0136 New in version 3.24.

CMP0141 New in version 3.25.

CMP0146 New in version 3.27.

1. 查找CUDA

```cmake

## CUDA 法1 ,使用find_package(已弃用)

# set(CUDA_TOOLKIT_ROOT_DIR /usr/local/cuda-11.1)

# 若指定了REQUIRED,又不能根据系统路径中的nvcc确定路径,则需要上面的指定

find_package(CUDA 11 REQUIRED)

## CUDA 法2

if (NOT CUDA_TOOLKIT_ROOT_DIR)

set(CUDA_TOOLKIT_ROOT_DIR /usr/local/cuda)

endif()

find_path(CUDA_INCLUDE_DIR cuda_runtime.h

HINTS ${CUDA_TOOLKIT_ROOT_DIR}

PATH_SUFFIXES include

)

MESSAGE(STATUS "Found CUDA headers at ${CUDA_INCLUDE_DIR}")

## CUDA 法3 (推荐)

set(CUDAToolkit_ROOT /usr/local/cuda-11.3/)

if(NOT CMAKE_CUDA_COMPILER)

include(FindCUDAToolkit)

if(CUDAToolkit_FOUND)

message("Found CUDA: true")

message("NVCC : ${CUDAToolkit_NVCC_EXECUTABLE}")

set(CMAKE_CUDA_COMPILER ${CUDAToolkit_NVCC_EXECUTABLE})

endif()

endif()

if(CMAKE_CUDA_COMPILER)

enable_language(CUDA)

endif()

# add_executable(test main.cpp)

# 链接cuda库如下,其中名称可参考https://cmake.org/cmake/help/latest/module/FindCUDAToolkit.html

target_link_libraries(test CUDA::cudart CUDA::cublas)

```

2. TensorRT

2.1 查找TensorRT头文件路径

find_path(TENSORRT_INCLUDE_DIR NvInfer.h

HINTS ${TENSORRT_ROOT} ${CUDA_TOOLKIT_ROOT_DIR}

PATH_SUFFIXES include)

MESSAGE(STATUS "Found TensorRT headers at ${TENSORRT_INCLUDE_DIR}")

2.2 查找TensorRT库

包括查找libnvinfer.so、libnvinfer_plugin.so、libnvparsers.so、libnvonnxparser.so等,可根据需要添减

find_library(TENSORRT_LIBRARY_INFER nvinfer

HINTS ${TENSORRT_ROOT} ${TENSORRT_BUILD} ${CUDA_TOOLKIT_ROOT_DIR}

PATH_SUFFIXES lib lib64 lib/x64)

find_library(TENSORRT_LIBRARY_INFER_PLUGIN nvinfer_plugin

HINTS ${TENSORRT_ROOT} ${TENSORRT_BUILD} ${CUDA_TOOLKIT_ROOT_DIR}

PATH_SUFFIXES lib lib64 lib/x64)

find_library(TENSORRT_LIBRARY_PARSERS nvparsers

HINTS ${TENSORRT_ROOT} ${TENSORRT_BUILD} ${CUDA_TOOLKIT_ROOT_DIR}

PATH_SUFFIXES lib lib64 lib/x64)

find_library(TENSORRT_LIBRARY_ONNXPARSER nvonnxparser

HINTS ${TENSORRT_ROOT} ${TENSORRT_BUILD} ${CUDA_TOOLKIT_ROOT_DIR}

PATH_SUFFIXES lib lib64 lib/x64)

set(TENSORRT_LIBRARY ${TENSORRT_LIBRARY_INFER} ${TENSORRT_LIBRARY_INFER_PLUGIN} ${TENSORRT_LIBRARY_PARSERS} ${TENSORRT_LIBRARY_ONNXPARSER})

MESSAGE(STATUS "Find TensorRT libs at ${TENSORRT_LIBRARY}")

# # 检查TensorRT是否已经安装,并获取其头文件和库文件路径等相关信息

find_package_handle_standard_args(

TENSORRT DEFAULT_MSG TENSORRT_INCLUDE_DIR TENSORRT_LIBRARY)

if(NOT TENSORRT_FOUND)

message(ERROR "Cannot find TensorRT library.")

endif()

2.3 链接头文件路径和库

target_include_directories(test PUBLIC ${TENSORRT_INCLUDE_DIR} ${CUDA_INCLUDE_DIR})

target_link_libraries(test PUBLIC ${TENSORRT_LIBRARY})

895

895

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?