ISTOCK

来源:IEEE电气电子工程师学会

当一个国际研究团队着手创建一个“人工智能科学家”来处理整个科学研究过程时,他们也不知道这一想法会走多远。他们创建的系统真的能够产生有趣的假设、进行实验、评估结果和撰写论文吗?

研究人员Cong Lu说,他们最终得到的是一种人工智能工具,他们认为这相当于一名早期的博士生。AI科学家可以处理和分析大量的数据,提取有意义的见解,使研究人员能够识别出通过传统方法可能不容易辨别的模式、相关性和趋势。但是,也许就像一个还不了解伦理学的早期博士生一样,尽管研究人员尽最大努力保持诚实,AI科学家的出现也带来了一些挑战和伦理考虑。

Lu是不列颠哥伦比亚大学的博士后研究员,他与其他几位学者以及总部位于东京的热门初创公司Sakana AI的研究人员合作完成了这个项目。该团队最近在ArXiv服务器上发布了一篇关于这项工作的预印本(https://arxiv.org/abs/2408.06292)。虽然预印本包括对局限性和伦理考虑的讨论,但它也包含了一些相当浮夸的语言,将人工智能科学家称为“科学发现新时代的开始”,以及“第一个全自动科学发现的综合框架,使前沿大语言模型(LLMs,https://spectrum.ieee.org/tag/large-language-models)能够独立进行研究并传达他们的发现” 。

这位人工智能科学家似乎捕捉到了时代精神。它正搭乘了人们对人工智能科学的热情浪潮,但一些批评者认为,等到这股浪潮褪去,并不会带来任何有价值的东西。

“

“人工智能科学”热潮

这项研究是人工智能科学更广泛趋势的一部分。可以说,谷歌DeepMind早在2020年就开始了这场热潮,当时它推出了AlphaFold,这是一个人工智能系统,以前所未有的准确性预测蛋白质的3D结构,让生物学家感到惊讶。自从生成式人工智能出现以来,更多的大企业参与其中。SonyAI高级研究科学家Tarek Besold领导了该公司的人工智能科学发现项目(https://ai.sony/projects/scientific_discovery/),他说,人工智能科学是“人工智能社区可以团结起来努力推进底层技术的目标,但更重要的是,它还可以帮助人类解决我们时代一些最紧迫的问题。”

然而,这场运动也有批评者。2023年,谷歌DeepMind发表了一篇论文,声称发现了220万种新的晶体结构(“相当于近800年的知识”),不久之后,两位材料科学家对拟议结构进行了随机抽样分析,并表示他们发现“很少有证据表明化合物满足新颖性、可信度和实用性的三重要求

(https://pubs.acs.org/doi/10.1021/acs.chemmater.4c00643)。”换句话说,人工智能可以快速产生很多结果,但这些结果可能实际上没有用。

“

人工智能科学家是如何工作的

就人工智能科学家而言,Lu和他的合作者只在计算机科学上测试了他们的系统,要求它研究与大型语言模型相关的主题,这些模型为ChatGPT等聊天机器人以及人工智能科学家本身提供动力,并为DALL-E等图像生成器提供动力。

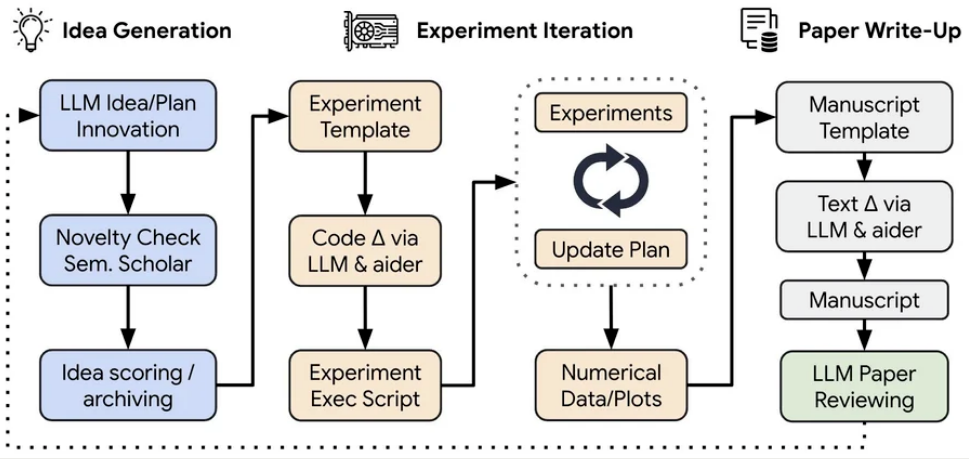

人工智能科学家的第一步是假设生成。给定它正在研究的模型的代码,它可以自由地为可以运行的实验生成想法,以提高模型的性能,并对每个想法的趣味性、新颖性和可行性进行评分。它可以在这一步进行迭代,生成得分最高的想法的变体。然后,它在Semantic Scholar中运行一个检查,看看它的建议是否与现有的工作过于相似。接下来,它使用一个名为Aider的编码助手来运行它的代码(https://aider.chat/),并以实验日志的形式记录结果。它可以利用这些结果为后续实验提供思路。

下一步是让人工智能科学家使用基于会议指南的模板将其结果写在一篇论文中。但是,Lu表示,该系统很难写出一篇连贯的九页论文来解释其结果——“写作阶段可能和实验阶段一样难做到,”他说。因此,研究人员将这个过程分为许多步骤:人工智能科学家一次写一个部分,并将每个部分与其他部分进行核对,以清除重复和矛盾的信息。它还再次通过语义学者来查找引文并建立参考书目。

但还有幻觉的问题(https://spectrum.ieee.org/ai-hallucination)——人工智能制造东西的技术术语。Lu说,虽然他们指示人工智能科学家只使用其实验期刊中的数字,但“有时它仍然会不遵守”。模型不遵守的时间不到10%,但“我们认为10%可能是不可接受的。他说,他们正在研究一种解决方案,例如指示系统将论文中的每个数字与实验日志中出现的位置联系起来。但该系统也出现了不太明显的推理和理解错误,这些错误似乎更难纠正。

在一个你可能没有看到的转折中,这位人工智能科学家甚至包含了一个同行评审模块来评估它所发表的论文。Lu说:“我们一直都知道,我们想要某种自动化的(评估),这样我们就不必花几个小时来处理所有的手稿。” 他们根据领先的人工智能会议NeurIPS的评审指南对评估员进行了建模,发现它总体上比人类评估员更严厉。理论上,同行评审功能可用于指导下一轮实验。

“

对人工智能科学家的批评

虽然研究人员将他们的人工智能科学家局限于机器学习实验,但Lu说,该团队与其他领域的科学家进行了一些有趣的对话。Lu表示,理论上,人工智能科学家可以在任何可以在模拟中进行实验的领域提供帮助。他说:“一些生物学家表示,他们可以在计算机上做很多事情。” 他还提到量子计算和材料科学是可能的研究领域。

一些对人工智能科学运动持批评态度的人可能会对这种广泛的乐观态度提出质疑。今年早些时候,加州大学伯克利分校计算生物学教授Jennifer Listgarten在《自然生物技术》上发表了一篇论文,认为人工智能不会在多个科学领域取得突破(https://www.nature.com/articles/s41587-023-02103-0)。她写道,与自然语言处理和计算机视觉等人工智能领域不同,大多数科学领域都没有训练模型所需的大量公开数据。

另外两位研究科学实践的研究人员,耶鲁大学的人类学家Lisa Messeri和普林斯顿大学的心理学家M.J.Crockett,于2024年在《自然》杂志上发表了一篇论文,试图打破围绕人工智能科学的炒作(https://www.nature.com/articles/s41586-024-07146-0)。当被问及对这位人工智能科学家的评论时,两人重申了他们对将“人工智能产品视为自主研究人员”的担忧。他们认为,这样做可能会将研究范围缩小到适合人工智能的问题,并失去推动真正创新的观点多样性。他们告诉IEEE Spectrum:“虽然‘人工智能科学家’承诺的生产力听起来可能对一些人很有吸引力,但发表论文和产生知识是不一样的,忘记这一区别可能会导致我们在理解较少的情况下产生更多的成果。”

但其他人认为这位人工智能科学家的研究是朝着正确方向迈出的一步。SonyAI的Besold表示,他认为这是一个很好的例子,说明当今的人工智能在应用于正确的领域和任务时如何支持科学研究。他说:“这可能成为少数几个早期原型之一,可以帮助人们概念化当人工智能应用于科学发现世界时可能会发生什么。”

“

人工智能科学家的下一步是什么

Lu说,该团队计划继续培养人工智能科学家,他说,在他们寻求提高其性能的过程中,有很多容易实现的成果。至于这些人工智能工具最终是否会在科学过程中发挥重要作用,“我认为时间会告诉我们这些模型有什么好处,”Lu说。在研究项目的早期范围界定阶段,当研究人员试图了解许多可能的研究方向时,这些工具可能很有用——尽管批评者补充说,我们必须等待未来的研究,看看这些工具是否真的足够全面和公正,以提供帮助。

或者,Lu说,如果这些模型可以改进到与“一个扎实的三年级博士生”的表现相匹配的程度,那么对于任何试图追求一个想法的人来说,它们都可能是一个力量倍增器(至少,只要这个想法是在一个适合人工智能的领域)。Lu说:“到那时,任何人都可以成为教授并开展研究工作。这是我所期待的令人兴奋的前景。”

“”未来知识库“”是欧米伽未来研究所建立的在线知识库平台,收藏的资料范围包括人工智能、脑科学、互联网、超级智能,数智大脑、能源、军事、经济、人类风险等等领域的前沿进展与未来趋势。目前拥有超过8000篇重要资料。每周更新不少于100篇世界范围最新研究资料。欢迎扫描二维码或点击本文左下角“阅读原文”进入。

270

270

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?