背景

之前在网上搜索了好多好多关于CNN,卷积神经网络的文章,很多都讲如何卷积、卷积层如何操作、具体如何进行卷积计算、卷积的好处。我也在此之前走了好多弯路,已经很了解如何卷积了,但是却不知道物理意义上,卷积与神经网络之间的联系。

但是鉴于大量的文章在网络上层出不穷地重复与累赘,更重要的是对于 卷积神经网络 一词当中,很多人都忽略了 神经网络 而去强调如何 卷积,因此本文主要讲述卷积神经网络中最重要的部分, 神经网络。希望看完这篇文章和相关卷积神经网络ConvsNet的人能够搞懂 NN 与 Conv 之间的联系与物理意义。

1.人工神经网络

1.1 神经元模型

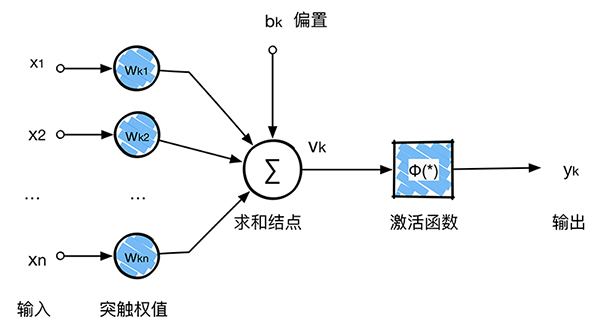

神经元是神经网络操作的基本信息处理单位。下图给出了神经元的模型model,这张图是后续章节单重将要探讨的设计(人工)神经网络Big Family的基础。我们在这里给出了神经元模型的三种基本元素:

突触 或者 链接链集, 每一个都由其 权值 或者 强度 作为特征。具体来说,在连接到神经元k的突触 j 上的输入信号 xj 被乘以 k 的突触权值 wkj 。 注意突触权值 wkj 下标的写法很重要。第一个下标指正在研究的这个神经元,第二个下标指权值所在的突触的输入端。和人脑的突触不一样的是,人工神经元的突触权值只有一个范围,可以取正值也可以取负值。

加法器,用于求输入信号干杯神经元的相应突触加权的和。这个操作构成一个线性组合器。

激活函数,用来限制神经元输出振幅。由于通过激活函数将输出信号压制(限制)到允许范围之内的一定值,故而激活函数也被称之为压制函数。通常,一个神经元输出的正常幅度范围可写成单位区间 [0, 1] 或者另一种区间 [-1, +1]。

图1的神经元也包括了一个外部偏置(bias),记为 bk 。偏置 bk 的作用是根据其为正或为负,相应地增加或降低激活函数的网络输入。

用数学的公式来表示,我们可以用下面的方程描述上图1的神经元 k :

其中 x1,x2,...,xn

本文深入探讨了人工神经网络中的神经元模型,包括突触权重、加法器、激活函数(sigmoid、tanh、ReLU)的作用,并介绍了神经网络作为有向图的结构。此外,还强调了在卷积神经网络中,激活函数的重要性,特别是ReLU的效率优势。通过理解这些基础,可以更好地理解CNN中神经元与卷积的关系。

本文深入探讨了人工神经网络中的神经元模型,包括突触权重、加法器、激活函数(sigmoid、tanh、ReLU)的作用,并介绍了神经网络作为有向图的结构。此外,还强调了在卷积神经网络中,激活函数的重要性,特别是ReLU的效率优势。通过理解这些基础,可以更好地理解CNN中神经元与卷积的关系。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2663

2663

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?