部分内容引用到

http://www.cnblogs.com/heaad/archive/2011/03/07/1976443.html

newff函数

<1>newff函数语法

newff函数参数列表有很多的可选参数,具体可以参考Matlab的帮助文档,这里介绍newff函数的一种简单的形式。

语法:net = newff ( A, B, {C} ,‘trainFun’)

参数:

A:一个n×2的矩阵,第i行元素为输入信号xi的最小值和最大值;

B:一个k维行向量,其元素为网络中各层节点数;

C:一个k维字符串行向量,每一分量为对应层神经元的激活函数;

trainFun :为学习规则采用的训练算法。

<2>常用的激活函数

常用的激活函数有:

a) 线性函数 (Linear transfer function) f(x)=x

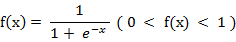

该函数的字符串为’purelin’。b) 对数S形转移函数( Logarithmic sigmoid transfer function )

该函数的字符串为’logsig’。

c) 双曲正切S形函数 (Hyperbolic tangent sigmoid transfer function )

也就是上面所提到的双极S形函数。

该函数的字符串为’ tansig’。

Matlab的安装目录下的toolbox\nnet\nnet\nntransfer子目录中有所有激活函数的定义说明。

<3>常见的训练函数

常见的训练函数有:

traingd :梯度下降BP训练函数(Gradient descent backpropagation)

traingdx :梯度下降自适应学习率训练函数

<4>网络配置参数

一些重要的网络配置参数如下:

net.trainparam.goal :神经网络训练的目标误差

net.trainparam.show : 显示中间结果的周期

net.trainparam.epochs :最大迭代次数

net.trainParam.lr : 学习率

train函数

网络训练学习函数。

语法:[ net, tr, Y1, E ] = train( net, X, Y )

参数:

X:网络实际输入

Y:网络应有输出

tr:训练跟踪信息

Y1:网络实际输出

E:误差矩阵

sim函数

语法:Y=sim(net,X)

参数:

net:网络

X:输入给网络的K×N矩阵,其中K为网络输入个数,N为数据样本数

Y:输出矩阵Q×N,其中Q为网络输出个数

% 采用动量梯度下降算法训练 BP 网络。

% 训练样本定义如下:

% 输入矢量为

% p =[-1 -2 3 1

% -1 1 5 -3]

% 目标矢量为 t = [-1 -1 1 1]

close all

clear

clc

% ---------------------------------------------------------------

% NEWFF——生成一个新的前向神经网络,函数格式:

% net = newff(PR,[S1 S2...SNl],{TF1 TF2...TFNl},BTF,BLF,PF) takes,

% PR -- R x 2 matrix of min and max values for R input elements

% (对于R维输入,PR是一个R x 2 的矩阵,每一行是相应输入的边界值)

% Si -- 第i层的维数

% TFi -- 第i层的传递函数, default = 'tansig'

% BTF -- 反向传播网络的训练函数, default = 'traingdx'

% BLF -- 反向传播网络的权值/阈值学习函数, default = 'learngdm'

% PF -- 性能函数, default = 'mse'

% ---------------------------------------------------------------

% TRAIN——对 BP 神经网络进行训练,函数格式:

% train(NET,P,T,Pi,Ai,VV,TV),输入参数:

% net -- 所建立的网络

% P -- 网络的输入

% T -- 网络的目标值, default = zeros

% Pi -- 初始输入延迟, default = zeros

% Ai -- 初始网络层延迟, default = zeros

% VV -- 验证向量的结构, default = []

% TV -- 测试向量的结构, default = []

% 返回值:

% net -- 训练之后的网络

% TR -- 训练记录(训练次数及每次训练的误差)

% Y -- 网络输出

% E -- 网络误差

% Pf -- 最终输入延迟

% Af -- 最终网络层延迟

% ---------------------------------------------------------------

% SIM——对 BP 神经网络进行仿真,函数格式:

% [Y,Pf,Af,E,perf] = sim(net,P,PiAi,T)

% 参数与前同。

% ---------------------------------------------------------------

%

% 定义训练样本

% P 为输入矢量

echo on

P=[-1, -2, 3, 1;

-1, 1, 5, -3];

% T 为目标矢量

T=[-1, -1, 1, 1];

% 创建一个新的前向神经网络

net=newff(minmax(P),[3,1],{'tansig','purelin'},'traingdm')

% ---------------------------------------------------------------

% 训练函数:traingdm,功能:以动量BP算法修正神经网络的权值和阈值。

% 它的相关特性包括:

% epochs:训练的次数,默认:100

% goal:误差性能目标值,默认:0

% lr:学习率,默认:0.01

% max_fail:确认样本进行仿真时,最大的失败次数,默认:5

% mc:动量因子,默认:0.9

% min_grad:最小梯度值,默认:1e-10

% show:显示的间隔次数,默认:25

% time:训练的最长时间,默认:inf

% ---------------------------------------------------------------

% 当前输入层权值和阈值

inputWeights=net.IW{1,1}

inputbias=net.b{1}

% 当前网络层权值和阈值

layerWeights=net.LW{2,1}

layerbias=net.b{2}

% 设置网络的训练参数

net.trainParam.show = 50;

net.trainParam.lr = 0.05;

net.trainParam.mc = 0.9;

net.trainParam.epochs = 1000;

net.trainParam.goal = 1e-3;

% 调用 TRAINGDM 算法训练 BP 网络

[net,tr]=train(net,P,T);

% 对 BP 网络进行仿真

A = sim(net,P)

% 计算仿真误差

E = T - A

MSE=mse(E)

echo off

figure;

plot((1:4),T,'-*',(1:4),A,'-o')

1367

1367

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?