1、准备大模型

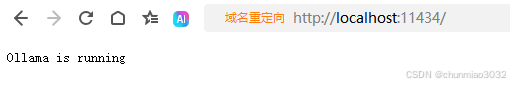

(1)准备使用ollama部署的本地大模型的地址默认是http://localhost:11434

需要部署大模型和嵌入模型(太要求电脑配置了,配置差的最好不要尝试,我i5,16G内存,固态硬盘,集成显卡,deepseek根本跑不起来,llama3勉强能跑起来,但是超级慢,嵌入模型nomic-embed-text:latest跑起来后,向量化个几k的文本文件用了几分钟)

下载ollama:https://ollama.com/download

安装ollama

启动ollama

ollama start启动后,Ollama会在默认端口11434上运行。你可以通过浏览器访问http://localhost:11434

拉取llama3模型

ollama pull llama3运行模型

ollama run llama3查看模型

o

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1976

1976

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?