前置

先打开安装hive、mysql的虚拟机

打开hadoop

start-all.sh

打开hive

nohup hive --service metastore &

nohup hive --service hiveserver2 &

//进入hive

beeline -u jdbc:hive2:192.168.153.145:10000

拷贝文件

conf文件

[root@cp145 ~]# cd /opt/soft/spark312/conf/

[root@cp145 conf]# cp /opt/soft/hive312/conf/hive-site.xml ./

修改文件

<property>

<name>hive.metastore.uris</name>

<value>thrift://192.168.153.145:9083</value>

</property>

jar文件

[root@cp145 ~]# cd /opt/soft/spark312/jars/

[root@cp145 jars]# cp /opt/soft/hive312/lib/hive-beeline-3.1.2.jar ./

[root@cp145 jars]# cp /opt/soft/hive312/lib/hive-cli-3.1.2.jar ./

[root@cp145 jars]# cp /opt/soft/hive312/lib/hive-exec-3.1.2.jar ./

[root@cp145 jars]# cp /opt/soft/hive312/lib/hive-jdbc-3.1.2.jar ./

[root@cp145 jars]# cp /opt/soft/hive312/lib/hive-metastore-3.1.2.jar ./

[root@cp145 jars]# cp /opt/soft/hive312/lib/mysql-connector-java-8.0.29.jar ./

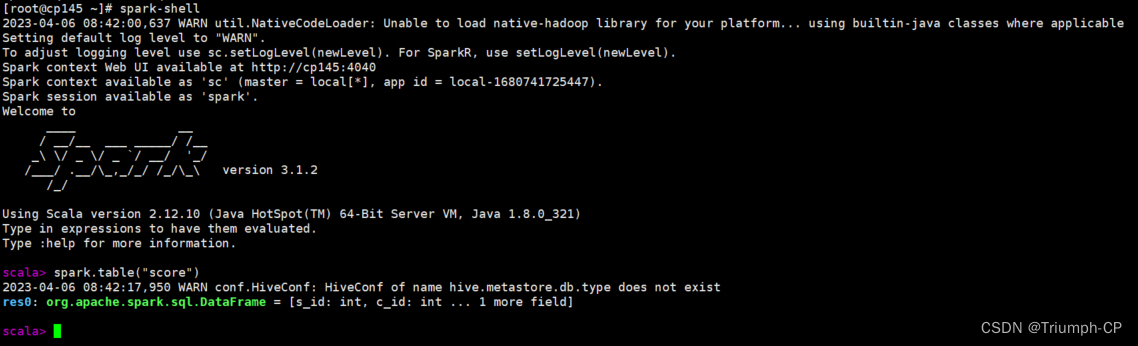

即可使用

spark.table("a")//a 是hive数据库中default中的表,spark只能访问默认数据库中的表

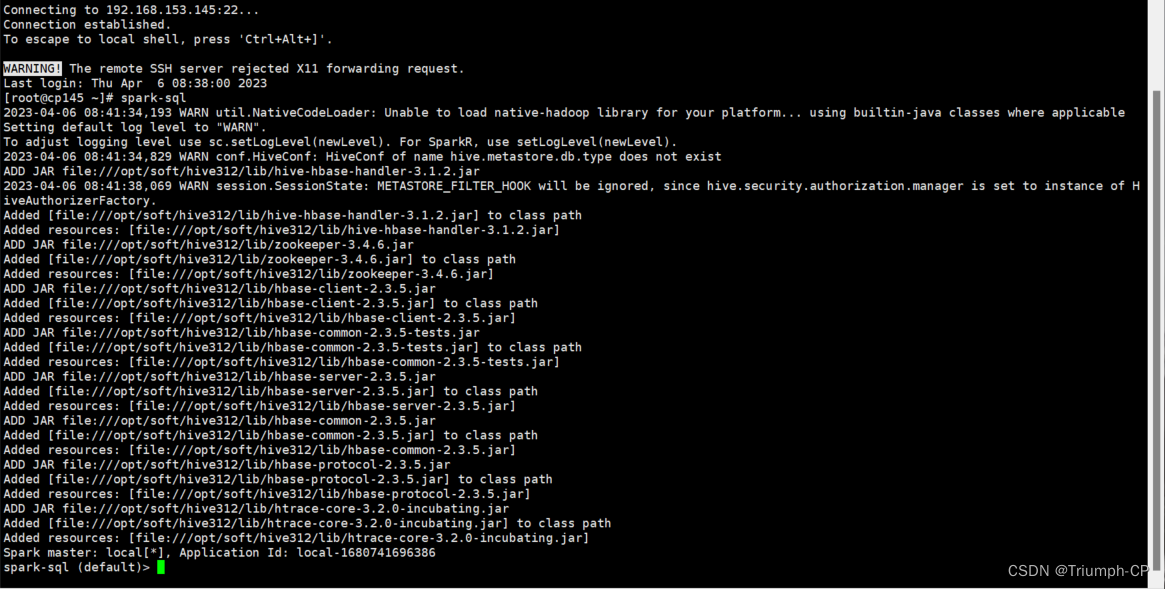

或者使用

spark-sql//也可以进入

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?