这里我们先试着训练一下,我们用官方提供的训练数据进行训练.

也没有说使用CPU可以进行微调,但是我们先执行一下试试:

https://www.heywhale.com/mw/project/6436d82948f7da1fee2be59e

可以看到说INT4量化级别最低需要7GB显存可以启动微调,但是

并没有说CPU可以进行微调.我们来尝试一下:

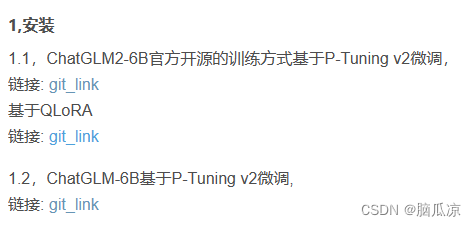

可以看到有这两种微调方式,然后

基于p-tuning v2的,还有基于

QLoRA的,这里我们用官方开源的,P-Tuning v2进行微调

现在还有langchain可以实现,扩展知识库,这个后面我们再说,我先用P-Tuning V2试试,

我们是在CPU下进行的.

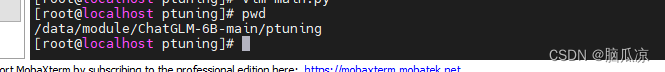

首先进入到

/data/module/ChatGLM-6B-main这个代码路径

里面有个ptuning目录,这是进行p-tuning v2训练的目录,

然后执行:

pip install rouge_chinese nltk jieba datasets

这句话是Pytho

318

318

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?