逻辑回归梳理

一、逻辑回归与线性回归的联系与区别

- 联系

逻辑回归与线性回归都属于广义线性回归模型 - 区别

- 因变量不同,如果是连续的,就是多重线性回归,如果是二项分布,就是logistic回归。logistic回归的因变量可以是二分类的,也可以是多分类的,但是二分类的更为常用,也更加容易解释。所以实际中最为常用的就是二分类的logistic回归。

- 线性回归用于解决回归问题,逻辑回归主要用于解决分类问题。

二、逻辑回归的原理

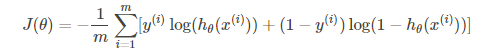

三、逻辑回归损失函数推导及优化

常见的损失函数

机器学习或者统计机器学习常见的损失函数如下:

- 0-1损失函数 (0-1 loss function)

L(Y,f(X))={1,0,Y ≠ f(X)Y = f(X)

L(Y,f(X))={1,Y ≠ f(X)0,Y = f(X) - 平方损失函数(quadratic loss function)

L(Y,f(X))=(Y−f(x))2

L(Y,f(X))=(Y−f(x))2 - 绝对值损失函数(absolute loss function)

L(Y,f(x))=|Y−f(X)|

L(Y,f(x))=|Y−f(X)| - 对数损失函数(logarithmic loss function) 或对数似然损失函数(log-likehood loss function)

L(Y,P(Y|X))=−logP(Y|X)

L(Y,P(Y|X))=−logP(Y|X)

逻辑回归中,采用的则是对数损失函数。如果损失函数越小,表示模型越好。

线性回归的损失函数为平方损失函数,如果将其用于逻辑回归的损失函数,则其数学特性不好,有很多局部极小值,难以用梯度下降法求最优。

代价函数

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2399

2399

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?