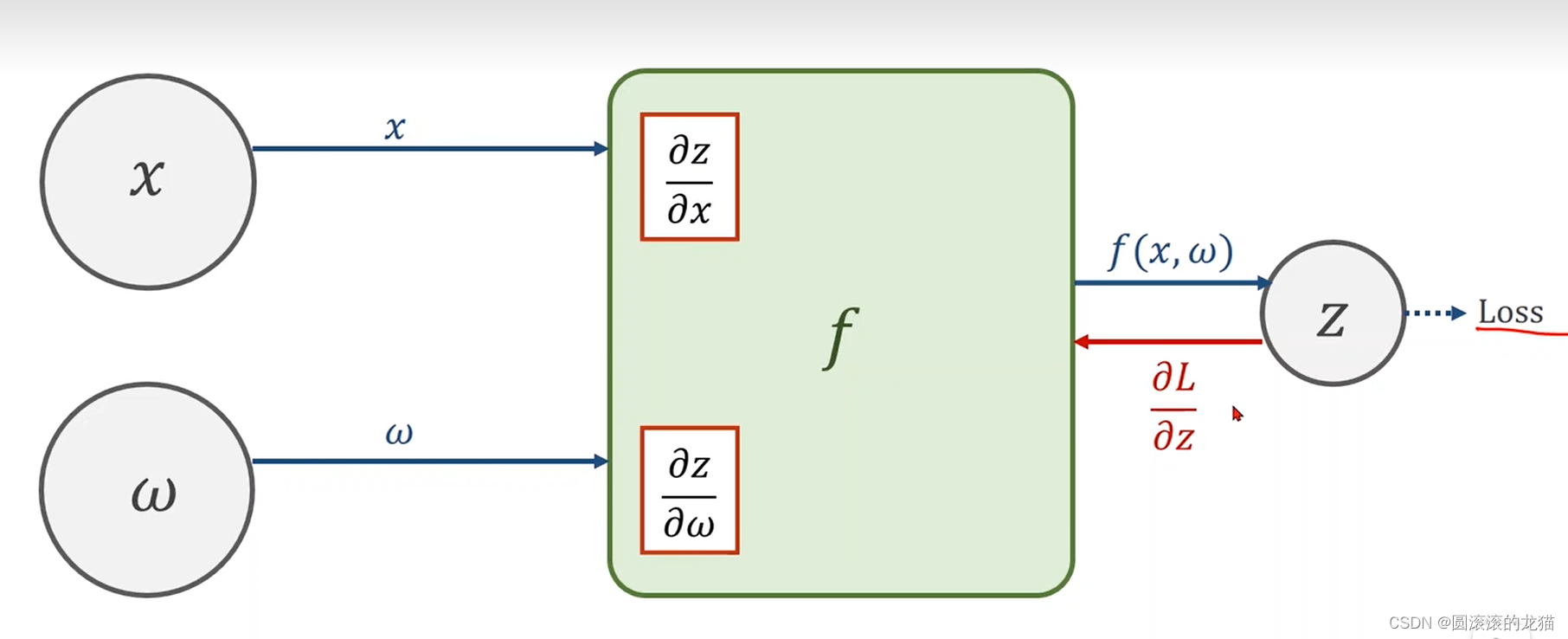

back propagation

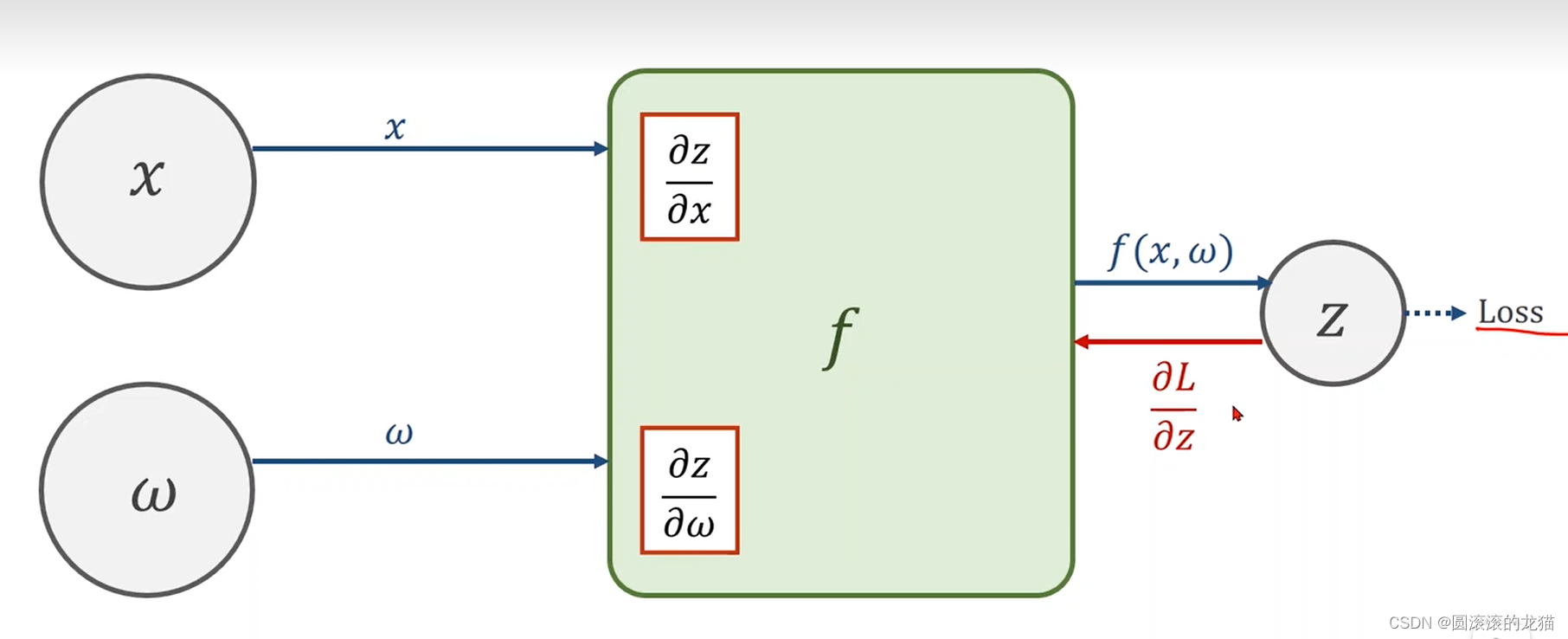

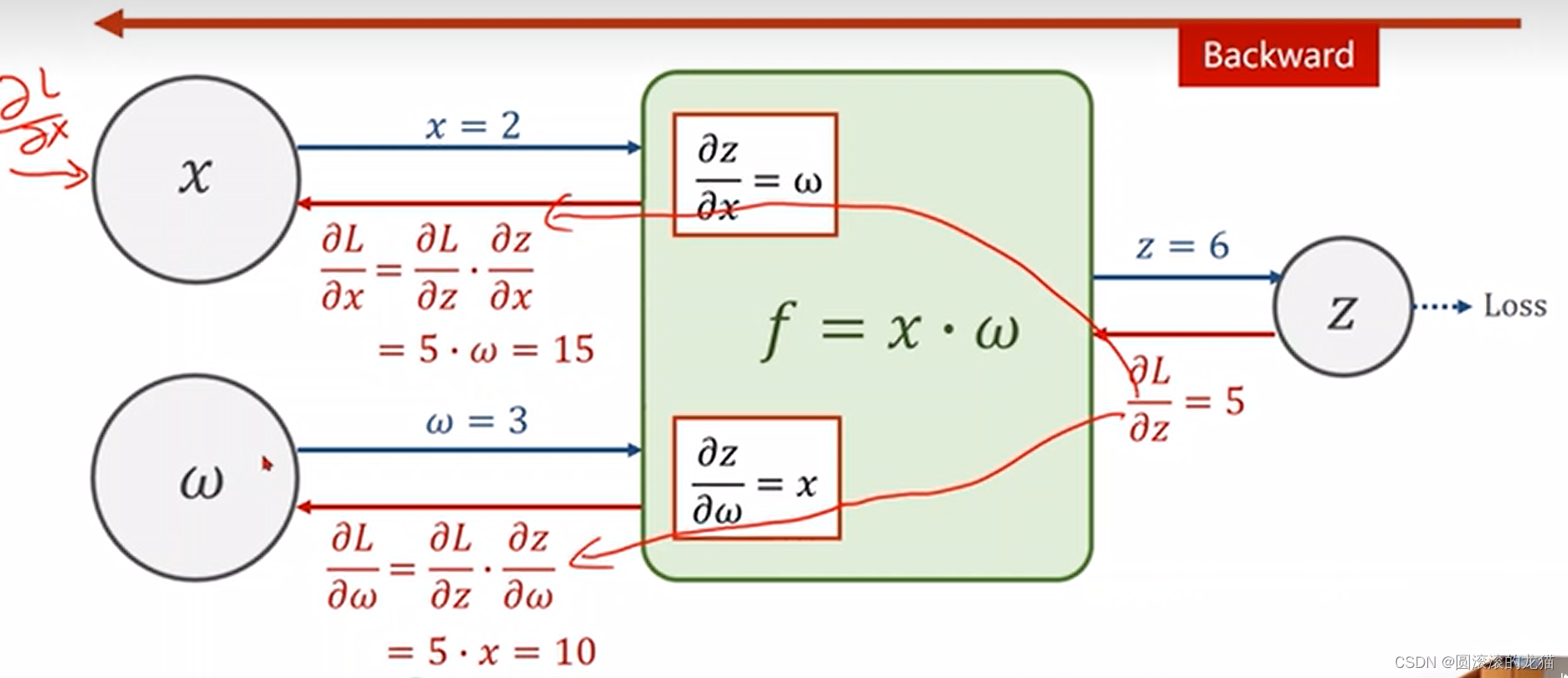

拿到前面传回来的L对z的偏导,再分别算损失值对x和w的偏导

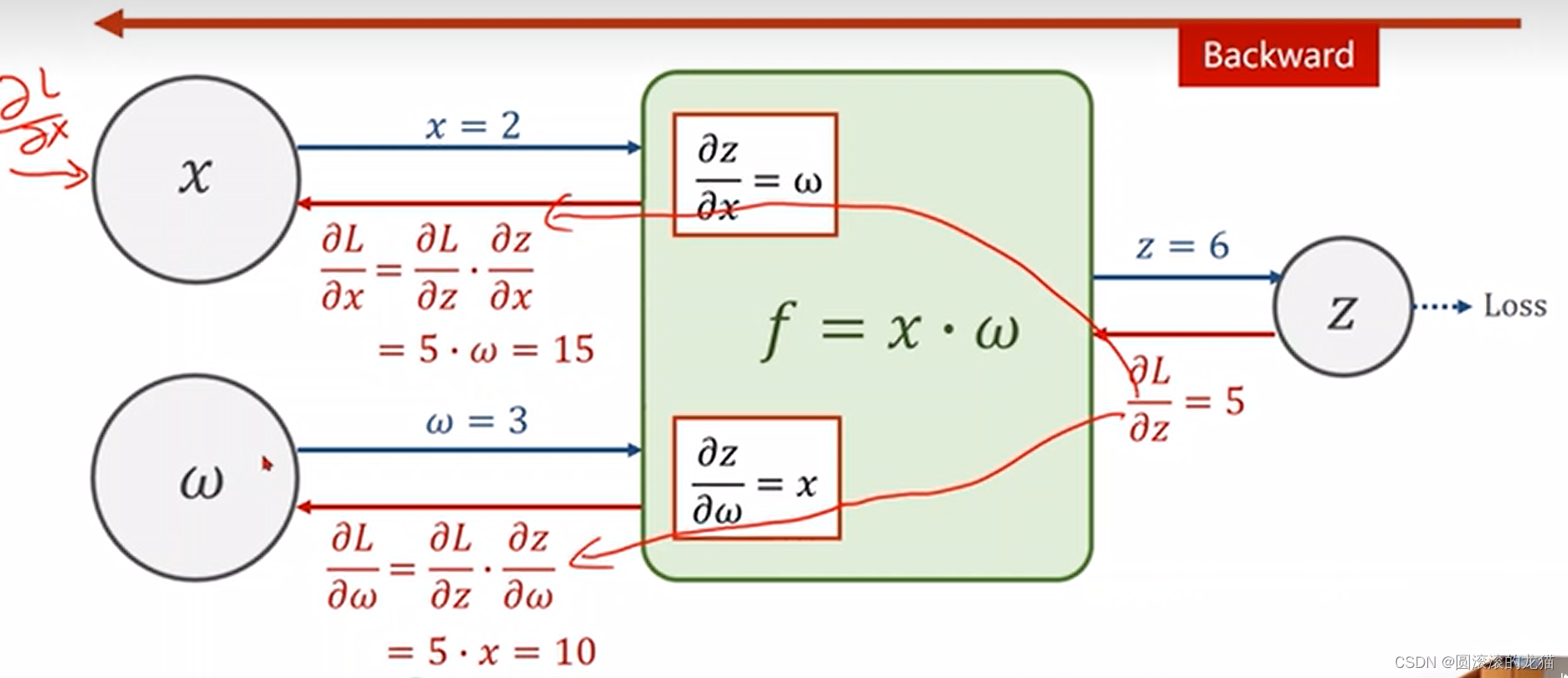

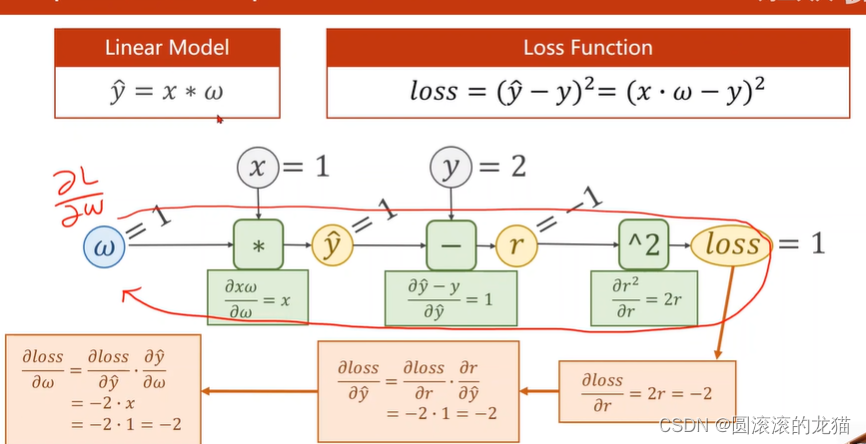

反向传播

前馈过程求局部梯度

反向传播

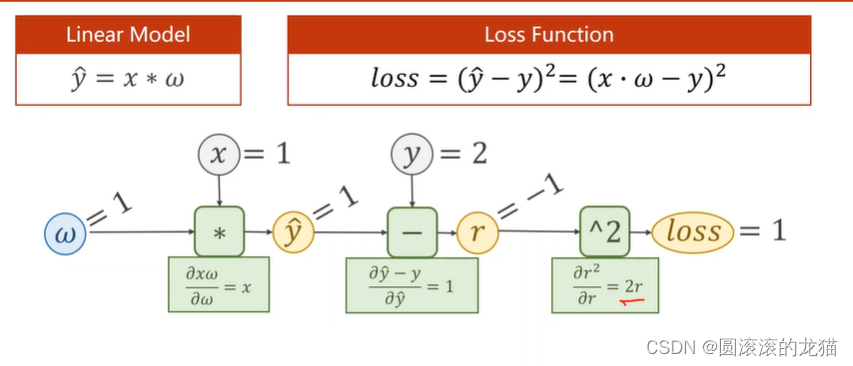

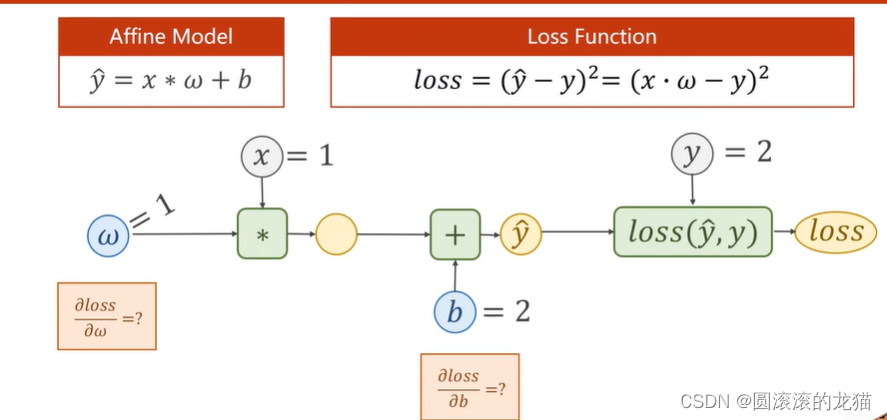

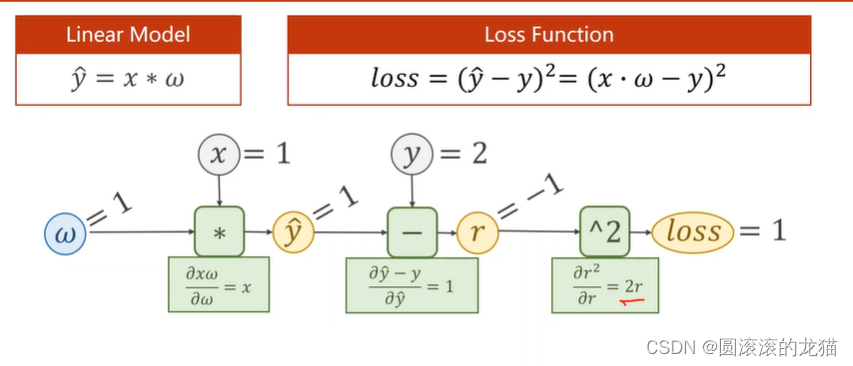

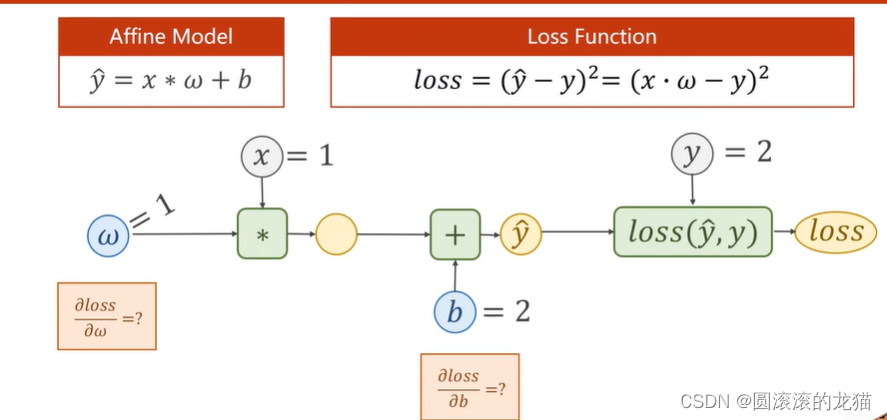

前馈过程w=1 x=1 b=2因此y尖=11+2=3 ,y^-y=3-2=1

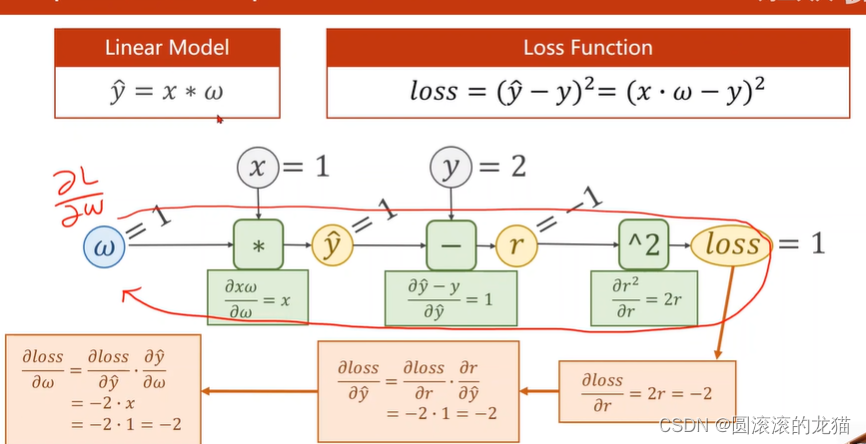

反向传播:假设r=y^-y,因此,loss对r的偏导=2r=2, loss对b的偏导=21=2,loss对w的偏导=2*x=2

神经网络学习8-反向传播

于 2024-06-26 19:47:01 首次发布

back propagation

拿到前面传回来的L对z的偏导,再分别算损失值对x和w的偏导

反向传播

前馈过程求局部梯度

反向传播

前馈过程w=1 x=1 b=2因此y尖=11+2=3 ,y^-y=3-2=1

反向传播:假设r=y^-y,因此,loss对r的偏导=2r=2, loss对b的偏导=21=2,loss对w的偏导=2*x=2

1067

1067

1048

1048

1171

1171

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?